Текст

М. В. Козлов, А. В. Прохоров

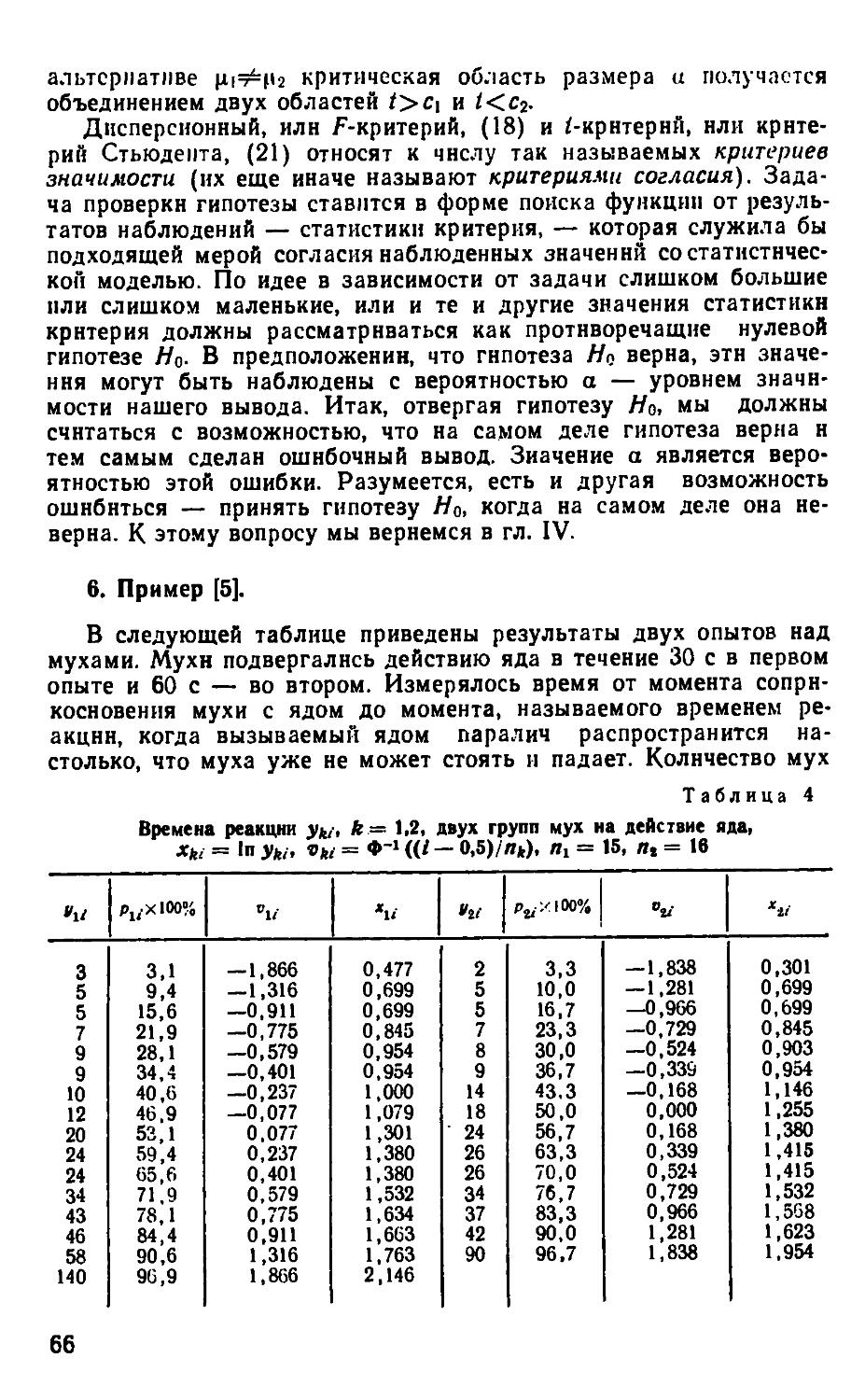

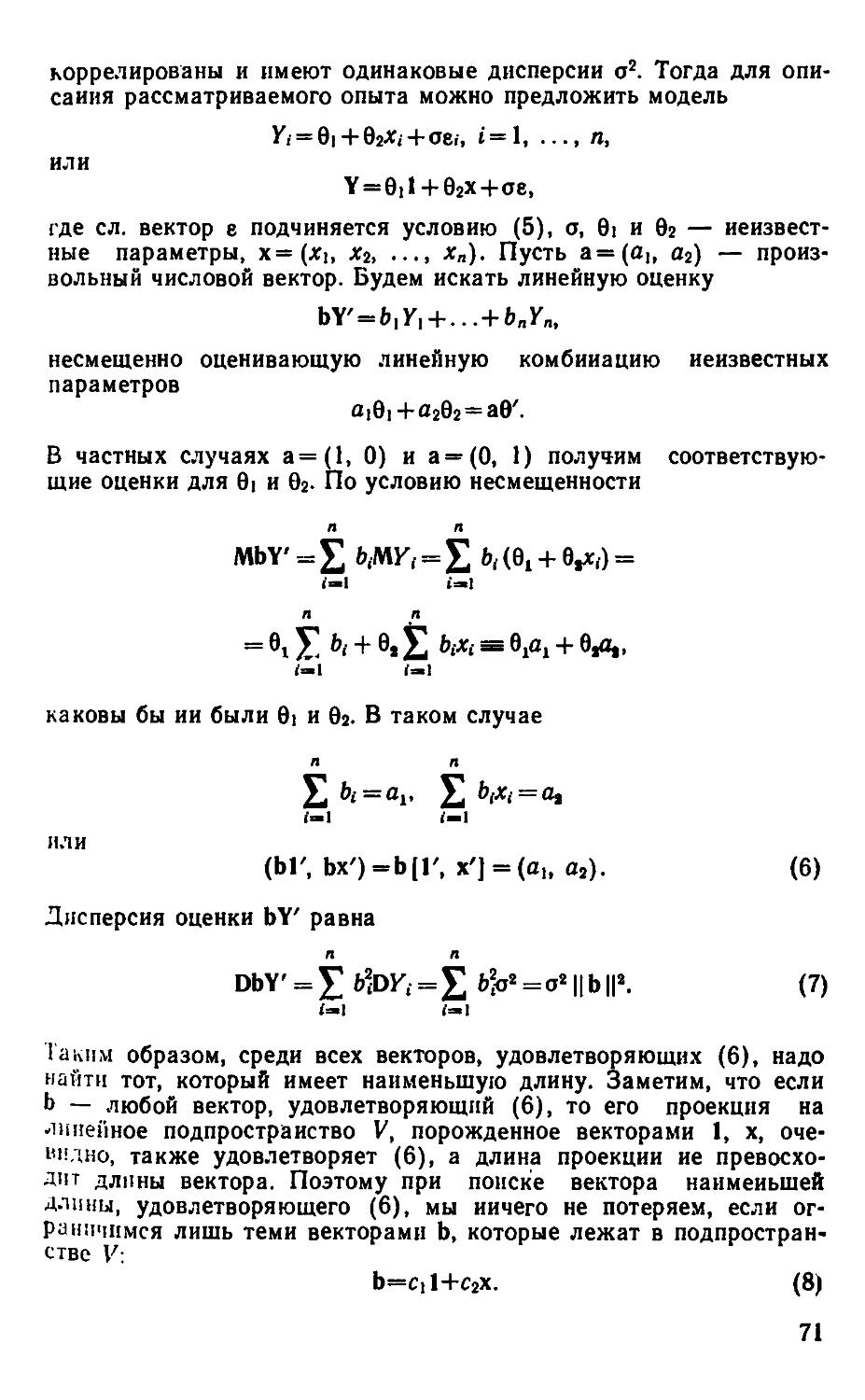

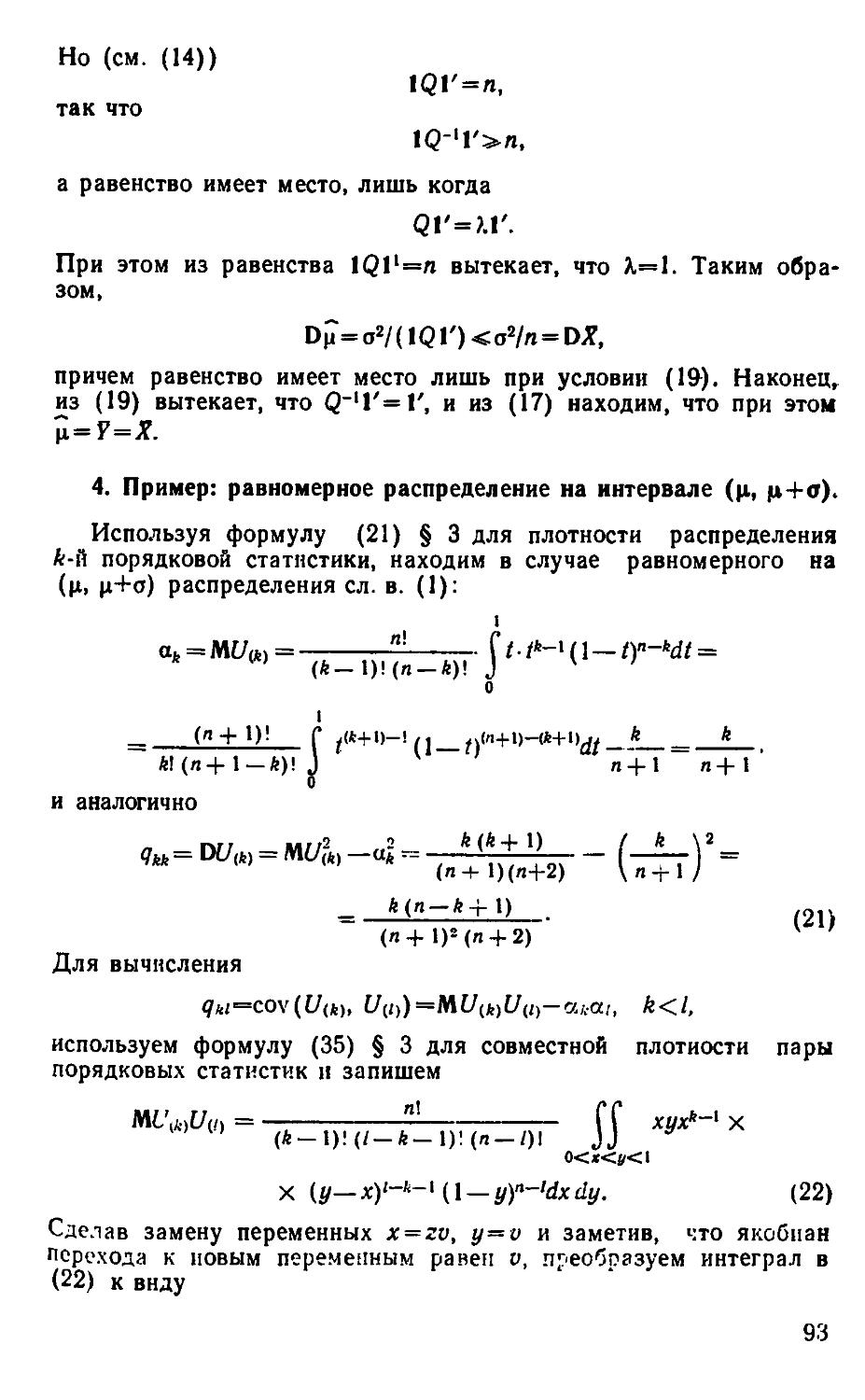

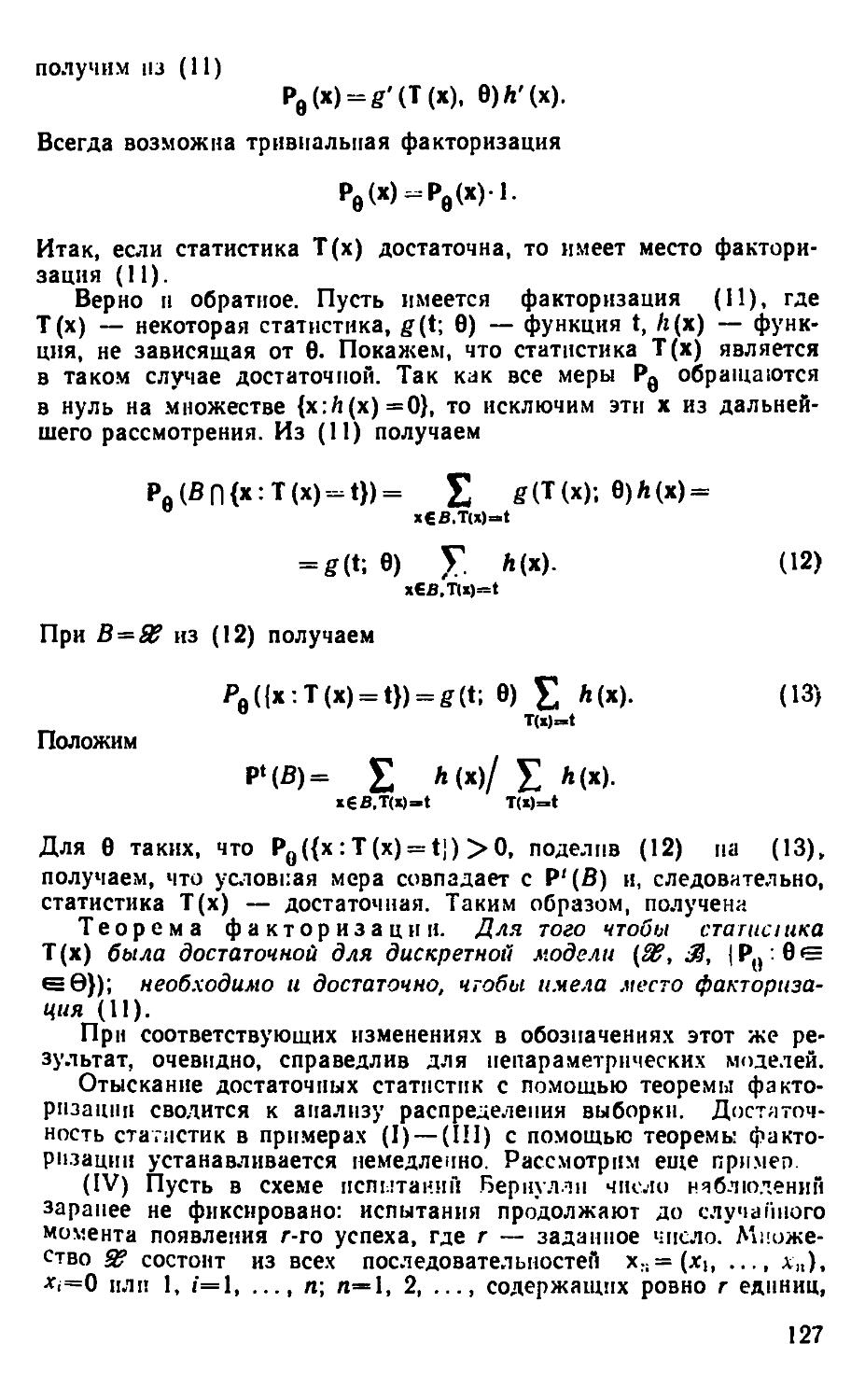

ВВЕДЕНИЕ

В МАТЕМАТИЧЕСКУЮ

СТАТИСТИКУ

ИЗДАТЕЛЬСТВО

МОСКОВСКОГО

УНИВЕРСИТЕТА

1987

УДК 519

Козлов М. В., Прохоров А. В. Введение в математическую ствтнстику.—

М.: Изд-во МГУ, 1987. —264 с.

Книга предназначена для начального изучения математической статистики.

Основные понитни, задачи и методы математической статистики вводятся на

примере простых статистических моделей. Значительное внимание уделено, с од-

одной стороны, численным и графическим иллюстрациям, с другой — логическим

основам математической статистики.

Для студентов университетов, обучающихся по специальностям «Матема-

«Математика», «Прикладная математика», «Механика».

Библиогр. 26 иазв. Ил. 13.

Рецензенты:

академик А. И. Колмогоров,

д-р физ.-мат. наук Ю. Н. Тюрин

Печатается по постановлению

Редакцнонно-нздательского совета

Московского университета

Учебное издание

Михаил Васильевич Козлов,

Александр Владимирович Прохоров

ВВЕДЕНИЕ Б МАТЕМАТИЧЕСКУЮ СТАТИСТИКУ

Зав. редакцией С. И. Зеленский

Редакторы А. А. Локшич, Ф. И. Горобец

Технический редвктор Г. Д. Колоскова

Корректоры //. Л. Мушникова, 7. С. Ми.ичкова

ИБ № 2612

Сдвно в набор 05.06.86. Подписано к печати 05.02.87.

Л-62050 Форнат 60X90/16 Бумага тип. № 3

Гарннтурв литературная. Высокая печать

Усл. печ. л. 16,5 Уч.-изд. л. 17.04

Тираж 11000 экз. Звказ Ni 405

Цеиа 78 коп. Изд. № 4492

Ордена «Знак Почета» издательство Московского университета.

103009. Москва, ул. Герцена. 5/7.

Типография ордена «Знак Почета» изд-ва МГУ.

119899, Москвв, Ленинские горы

1702060000-076 1М_87 @ издательство Московского

077@2)—87 университета, 1987 г.

ОГЛАВЛЕНИЕ

Предисловве . . , , 6

Глава I. СТАТИСТИЧЕСКИЕ МОДЕЛИ И МЕТОДЫ: НАЧАЛЬ-

НАЧАЛЬНЫЕ ПОНЯТИЯ 8

§ I, Вероятность и частота 8

1. Введение. 2. Таблица случайных чисел. 3. Парадокс де Мере.

4. Общая вероятностная модель. 5. Закон больших чисел

§ 2. Эмпирическое распределение вероятностей • 15

1. Эмпирическое распределение дискретной случайной величины.

2. Эмпирическая функция распределении. 3. Статистика Колмогоро-

Колмогорова. 4. Выборочные среднее и дисперсии.

§ 3. Порядковые статистики и задачах оценивании 22

1. Порядковые статистики. 2. Оценивание содержимого урны.

3. Оценка параметра равномерного распределении. 4. Оценивание

параметра сдиига экспоненциального распределении. 5. Доверитель-

Доверительный интервал. 6. Выборочные квантили. 7. Равномерное распреде-

распределение. 8. Доверительные интервалы для квантилей. 9. Совместное

распределение пары порядковых статистик.

§ 4. Параметры сдвига и масштаба: графический анализ .... 31

1. Семейство сдвига-масштаба. 2. Вероятностная бумага. 3. При-

Примеры графического анализа.

§ 5. Экспоненциальное распределение и пуассоиовский процесс . . 36

1. Экспоненциальное распределение. 2. Пуассоновский процесс.

3. Условное распределение точек пуассоновского процесса. 4. При-

Пример.

§ 6. Оценивание параметров экспоненциального распределения ... 44

1. Оценивание параметра сдвига при известном параметре масшта-

масштаба. 2. Оценивание параметра масштаба при известном параметре

сдвига. 3. Точечные оценки ц и о. 4. Распределение интервалов

между порядковыми статистиками. 5. Дисперсии несмещенных оце-

оценок ц*. о*; интериальиое оценивание ц, о. 6. Оценивание по пер-

первым г порядковым статистикам.

§ 7. Свеленяя о иажнейших непрерывных распределениях в /?'... 51

1. Гамма-распределение. 2. Экспоненциальное распределение. 3. Нор-

Нормальное распределение. 4. Распределение ха с я степенями свобо-

свободы. 5. Бета-распределение. 6. Равномерное распределение. 7. Распре-

Распределение Фишера, или /^-распределение. 8. Распределение Стьюдента,

или /-распределение.

§ 8. Нормальное распределение: оценивание параметроп, сравнение

двух выборок 58

1. Доверительные оценки для ц и о2, когда один нз параметров

известен. 2. Несмещенная оценка дисперсии. 3. Доверительные ин-

интервалы для ц я о2, когда оба napu.veipa неизвестно;. 4. Сравнокп?

дисперсии в двух выборках. 5. Задача сравнения средних ц, и ц?.

6. Пример.

Глава II. ЛИНЕЙНАЯ СТАТИСТИЧЕСКАЯ МОДЕЛЬ ... 69

§ 9. Оценивание коэффициентов линейной модели 69

1. Введение. 2. Примеры линейных моделей. 3. Линейная статисти-

статистическая модель. 4. Несмещенные оценки с минимальной дисперсией:

3

матрица полного ранга. 5. Наилучшие оценки в случае матрицы

неполного ранга. 6. Пример: модель с матрицей' неполного ранга.

7. Наилучшие оценки как оценки наименьших квадратов

§ 10. Ковариации, канонвческаи форма линейной модели, обобщении 80

I. Матрицы из случайных элементов. 2. Матрица ковариации.

3. Ковариации наилучших оценок. 4. Пример оптимального выбора

матрицы модели. 5. Каноническая форма линейной модели. 6. Оце-

Оценивание дисперсии. 7. Обобщенней лннейнаи модель

§11. Поридковые линейные оценки дли параметров сдвига и масштаба 89>

1. Обобщенная, линейная модель для семейства сдвига-масштаба.

2. Наилучшие несмещенные оценки. Э. Симметричное распределение.

4. Пример: равномерное распределение иа интервале (ц, ц+а).

5. Пример: экспоненциальное распределение. 6. Пример: нормальное

распределение. 7. Цензурироваинаи выборка. 8. Упрощенные ли-

линейные оценки.

§ 12, Многомерное нормальное распределение . . , . . . . '01

1. Невырожденное нормальное распределение. 2. Случайные векто-

векторы с вырожденной матрицей ковариации. 3. Вырожденное нормаль-

нормальное распределение. 4. Распределение проекций стандартного нор-

нормального вектора.

§ 13. Доверительное оценивание и проверка гипотез в линейной модели

с нормальными наблюдениями . . ........ 109

1. Распределение вектора оценок. 2. Доверительнме области для

параметров и параметрических функций. 3. Проверка гипотез с по-

помощью доверительных эллипсоидов. 4. Пример: сравнение средних

в нескольких нормальных выборках.

Глава III. ДОСТАТОЧНЫЕ СТАТИСТИКИ 116

§ 14. Статистическая модель, подобные статистики , 116

1. Статистическая модель. 2. Подобные статистики.

§ 15. Достаточные статистики в двскретной модели 120-

I. Введение. 2. Примеры. 3. Достаточные статистики: определенве.

4. Критерий достаточности. 5. Достаточные и минимальные доста-

точвые разбиения.

§ 16, Достаточные статистики в непрерывной модели Ш

1. Примеры достаточных статистик. 2. Определение достаточной

статистики, теорема факторизации. 3. Экспоненциальные семейства,

минимальная достаточность.

§ 17. Достаточность и несмещенное оценивание ........ 152

1. Полные достаточные статистики. 2. Наилучшие несмещенные

оценки в дискретной модели. 3. Наилучшие несмещенные оценки в

непрерывной модели.

§ 18. Информации в статистике 168

I. Байесовский подход в статистике. 2. Информация по Шеннону.

3. Информации по Кульбаку. 4. Информация по Фишеру.

§ 19. Неравенство Фреше—Рас—Крамера , г 185

1. Скалярный параметр. 2. Векторный параметр. 3. Границы дис-

дисперсии при нарушении условий регулярности.

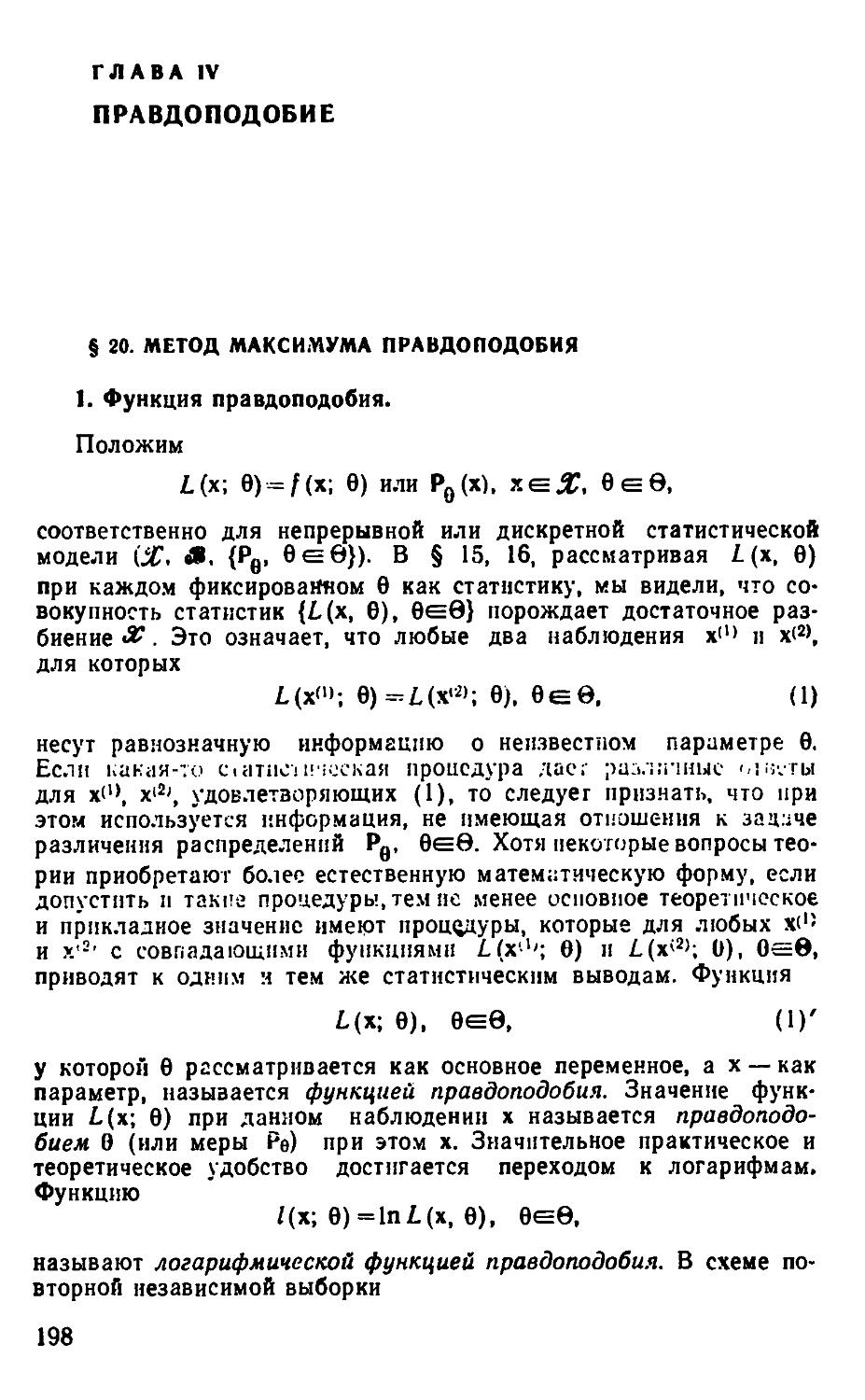

Глава IV. ПРАВДОПОДОБИЕ 198

§ 20. Метод максимума правдоподобия 198

1. Функцнк правдоподобик. 2. Оценки максимального правдоподо-

правдоподобии. 3. Метод Монте-Карло в модели сдвига-масштаба.

§ 21. Критерий отношении правдоподобий 211

1. Проверка статистических гипотез. 2. Лемма Неймана—Пирсона.

3. Примеры. Равномерно наиболее мощные критерии. 4. Близкие ги-

гипотезы, б, Сложные гипотезы,

4

§ 22. Последовательный критерий отношения правдоподобий . . . 226

1. Метод последовательного статистического анализа. 2. Последо-

Последовательный критерий отношения правдоподобий. 3. Среднее число

наблюдений в последовательном критерии.

Глава V. БОЛЬШИЕ ВЫБОРКИ 235

§ 23, Асимптотические свойства оценок 235

1. Состоятельность. 2. Состоятельность оценок максимального прав-

правдоподобии. 3. Асимптотическая нормальность. 4, Преобразонание

статистик. 5. Асимптотическая нормальность выборочных квантилей.

6. Асимптотическая нормальность оценок максимума правдоподобия.

7. Асимптотическая эффективность оценок максимума правдоподо-

правдоподобия. 8. Асимптотическая достаточность. 9. Векторный параметр,

10. Оценинание параметров сдвига и масштаба.

§ 24. Асимптотические свойстна критерия отношения правдоподобий . 256

1. Скалярный параметр. 2. Векторный параметр, 3. Полиномиальное

распределение.

Литература ................ 264

ПРЕДИСЛОВИЕ

По замыслу авторов книга должна служить учебным посо-

пособием для студентов-математиков, знакомых с элементами теории

вероятностей в объеме семестрового курса. Она написана на ос-

основе курсов, читавшихся авторами для студентов механико-мате-

механико-математического факультета Московского университета, специализи-

специализирующихся в области теории вероятностей и математической ста-

статистики.

Среди книг, рассчитанных на первоначальное изучение пред-

предмета, особое место занимают классические труды Г. Крамера

[20] и Б. Л. Ван дер Вардена [10]. Написанные более 30 лет

назад и воспитавшие поколения вероятностников, они пользуются

заслуженным авторитетом и сейчас. Элементы математической

статистики являются составной частью общих курсов по теории

вероятностей, среди которых следует назвать учебники Б. В. Гне-

денко [17], Ю. А. Розанова [18], Б. А. Севастьянова [19],

В. Н. Тутубалина [21]. Недавно изданное учебное пособие по ма-

математической статистике А. А. Боровкова [12] рассчитано на

студентов старших курсов и аспирантов. Отметим также учебник

для вузов Г. И. Ивченко, Ю. И. Медведева [22]. При работе над

книгой авторы использовали методические достижения отечест-

отечественной н зарубежной литературы по математической статистике,

а также опыт и традиции преподавания вероятностных дисцип-

дисциплин на механико-математическом факультете и факультете вы-

вычислительной математики н кибернетики Московского универси-

университета. Особо отметим работу Д. Кокса, Д. Хинкли [14], а также

уже упоминавшуюся книгу Б. Л. Ван дер Вардена, логическая

ясность, простота изложения и отчетливое представление при-

прикладной стороны предмета в которой служили нам образцом.

Книга начинается со знакомства с некоторыми основопола-

основополагающими понятиями математической статистики на примере про-

простейших статистических моделей (гл. I, II). Значительное внима-

внимание уделяется здесь числовым н графическим иллюстрациям, то-

тогда как логика предмета отнесена на второй план. Достаточно де-

детально изучается линейная статистическая модель. Эта модель,

во-первых, служит хорошим источником материала для педагоги-

педагогической практики, во-вторых, открывает подход к теоретическим и

прикладным аспектам регрессионного и дисперсионного анализа.

В настоящей книге линейная модель должна еще и подготовить

читателя к восприятию теоретических основ статистики, которым

уделяется серьезное внимание в последующих разделах.

Вопросам использования информации, содержащейся в стати-

статистических данных, для построения статистических выводов и

формализации самого понятия информации в статистике посвя-

посвящена гл. III, содержащая разделы: достаточность, несмещенное

оценивание, информация в статистике, нижние границы дисперсии

оценок. Гл. IV объединяет некоторые приемы построения стати-

статистических оценок и критериев, основанных иа понятии правдопо-

правдоподобия. Гл. V посвящена асимптотическим свойствам оценок мак-

максимального правдоподобия и критерия отношения правдопо-

правдоподобий.

Ограниченный объем книги не позволил включить некоторые

важные статистические процедуры и затронуть другие разделы

современной математической статистики. Вместо этого авторы

более детально, с большим количеством примеров и повышенным

вниманием к логической стороне вопроса разобрали такие фун-

фундаментальные понятия статистики, как статистическая модель,

достаточность, правдоподобие. Авторы надеются, что тщательная

проработка материала книги поможет читателю самостоятельно

разобрать темы, затронутые нами лишь частично, по другим ис-

источникам, среди которых мы выделим капитальный труд

М. Дж. Кеидалла, А. Стьюарта [24—26]. Библиографический

список в конце книги включает в основном издания иа русском

языке и ии в какой мере ие претендует иа полиоту.

Авторы пользуются возможностью выразить благодарность

своим учителям и коллегам — сотрудникам кафедры теории веро-

вероятностей и кафедры математической статистики и случайных про-

процессов механико-математического факультета МГУ. Авторы бла-

благодарны сотрудникам факультета Н. Н. Марчук, Т. В. Нистрато-

Нистратовой, Т. В. Козьмииой, О. Б. Фисунеико, а также студентам и

аспирантам кафедры математической статистики и случайных

процессов за помощь в оформлении рукописи. Рассматривая кни-

книгу как очередиой шаг в разработке методики преподавания ма-

математической статистики, авторы отдают себе ясный отчет в не-

несовершенстве своего труда и будут благодарны всем, кто выска-

выскажет свои замечания и предложения.

М. В. Козлов, А. В. Прохоров

ГЛАВА I

СТАТИСТИЧЕСКИЕ МОДЕЛИ И МЕТОДЫ:

НАЧАЛЬНЫЕ ПОНЯТИЯ

§ 1. ВЕРОЯТНОСТЬ И ЧАСТОТА

1. Введение.

Процесс познания окружающего мира включает наблюдение и

эксперимент. Результаты наблюдений во многих случаях можно

представить последовательностью действительных чисел

Для того чтобы из ряда наблюдений можно было извлечь по*

лезную информацию, необходимо иметь модель явления. Вероят-

Вероятностные модели оказываются чрезвычайно плодотворными при

анализе явлений, исходы хеЯ? которых обладают некоторой сте-

степенью неопределенности. Понятие неопределенности в теории ве-

вероятностей формализуется путем введения распределения веро-

вероятностей на множестве % всех возможных наблюдений х. В про-

простейшем случае, когда Я? —конечное или счетное множество, за-

задаются вероятности р(х) всех его элементов х, так что О^()^

<1 и

Любое подмножество Л=Я? называют в этом случае событием, а

его вероятность определяют формулой

Пример 1 (случайный выбор с возвращением). Представим

себе урну с N шарами, занумерованными числами от 0 до N — 1,

и рассмотрим опыт, который заключается в n-кратном извлечении

шара «наугад» с последующим его возвращением в урну. Все

возможные неходы опыта могут быть представлены множеством

из Nn последовательностей:

Я?={х=(х, х»):х,=0,.1 N—1; i=l п).

На 9В задается равномерное распределение вероятностей: р(х) =

8

¦=ЛМ» для всех хеЯ?, что отражает равную степень неопределен-

неопределенности каждого возможного нехода.

Пример 2 (случайный выбор без возвращения). Если из

урны с N шарами последовательно извлекаются «наугад» п ша-

шаров без возвращения, n<N, то возможные исходы описываются

множеством нз N(N— 1)... (N — n+l)=Nl/(N — n)\ последова-

последовательностей:

Я?={х= (хи х2,• • •,хп) :дс<=0, \,...N—\, ХгФх}

при

1ФГ, i,/=l л},

а распределение вероятностей на Я?_ снова равномерное: для лю-

любого х

Взаимоотношение явления и его вероятностной модели имеет

статистический характер, т. е. обнаруживается при повторных

наблюдениях за явлением. Частоты исходов в длинном ряду ис-

испытаний стабилизируются, их колебания с ростом числа испыта-

испытаний уменьшаются. Этот эмпирический факт, называемый зако-

законом устойчивости частот, наблюдается в самых различных ситуа-

ситуациях. Уже выходя за пределы реального опыта, полагают, что

при неограниченном повторении частоты стремятся к пределам,

которые и принимают за вероятности соответствующих исходов

или событий.

2. Таблица случайных чисел.

Обратимся к табл. 7.1, а книги Л. Н. Большее а н Н. В. Смир-

Смирнова [1], содержащей 12500 «случайных цифр», которые можно

представлять себе как реализацию опыта, описанного в приме-

примере 1 при N=10, л =12500. Проследим за изменчивостью частот

появления цифры «0» с ростом числа наблюдений. Для облегче-

облегчения анализа сгруппируем первые 100 цифр таблицы (считывае-

(считываемой по строкам) по 10 цифр, последующие 900 —по 100 цифр,

следующие 9000 — по 1000. Наблюдаемые числа и частоты нулей

по группам и суммарно собраны в табл. 1.

Нетрудно подметить, глядя на последний столбец таблицы 1,

что колебания частоты т/п с ростом п затухают.

3. Парадокс де Мере.

Рассмотрим задачу, которая, как утверждают, возникла за

игорным столом и была предложена в 1654 г. Паскалю. Игрок де

Мере полагал, что вероятность р\ получить хотя бы одну едини-

единицу при бросании четырех игральных костей (событие А) меньше

вероятности рг выпадения одновременно двух единиц хотя бы

раз при 24 бросаниях двух костей (событие В), и ставил в игре на

событие В.

SL

Таблица 1

Колебание частоты появления нуля в 10000 случайных цифр

Число ваблю-

девай в группе

10

10

10

10

10

10

10

10

10

10

100

100

100

100

100

100

100

100

100

1000

1000

1000

1000

1000

1000

1000

1000

1000

Чвсло нулей

в группе

2

1

0

2

0

2

0

2

3

2

14

9

13

8

16

14

6

9

8

97

106

99

91

97

91

100

117

89

Частота нулей

в группе

0,2

0,1

0,0

0,2

0.0

0,2

о.о

0,2

03

0,2

0,14

0,09

0,13

0,08

0,16

0,14

0,06

0,09

0,08

0,097

0,106

0,099

0,091

0,097

0,091

0,100

0,117

0,89

Накопленное

число наблю-

наблюдений, п

10

20

30

40

50

60

70

80

90

100

200

300

400

500

600

700

800

900

1000

2000

3000

4000

5000

6000

7000

8000

9000

10000

Накопленное

чнсло нулей, т

2

3

3

5

5

7

7

9

12

14

28

37

50

58

74

88

94

103

111

208

314

413

504

601

692

792

909

998

Накопленная час-

частота нулей, т/п

0,2

0,15

0,10

0,15

0,16

0,116

0,100

0,112

0,133

0,140

0,140

0,123

0,125

0,116

0,123

0,125

0,117

0,114

0,1110

0,1040

0,1046

0,1032

0,1008

0,1001

0,0988

0,0990

0,1010

0,0998

Однако эти вероятности легко вычисляются:

Р(А) =pi = l — E/6L=0,5177..., Р(В) =р2= 1 — C5/36J4=

=0,4914...

Поскольку де Мере не были доступны эти вычисления, то свои

заключения он мог бы основывать на опытных данных. Предста-

Представим себе, что опыт с бросанием четырех игральных костей и опыт

из 24 бросаний двух игральных костей повторяются п раз. Ре-

Результат t-ro испытания, t=l, 2, ..., п, опишем парой (xt, yi), по-

полагая Xi=\ A/1=1), если произошло событие А E), и полагая

# = 0 (t/i=0), если событие А (В) не произошло. Обозначим через

l=\

Естественный вопрос заключается в том, насколько основатель-

основательным является сравнение вероятностей р\ и рг по их частотам

10

ninin и n&jn. Ниже приводятся результаты

игры с помощью таблицы случайных цифр из [1].

моделирования

л

mW „in

mm п/п

25

0,68

0,52

50

0,54

0,50

100

0,53

0,48

250

0,488

0,508

Как видно, хотя Р\>р2, но при п=250 нам «не повезло» —

trfnln < т®/п. Остановив «игру» на этом п, мы могли бы сделать

ошибочное заключение, что pi<p2.

В теории описанному опыту соответствуют две независимые

последовательности испытаний Бернулли с вероятностями поло-

положительного исхода («успеха») в одном случае р\, в другом — р2.

Введем случайные величины (ел. в.) v, и v2, равные числу успе-

успехов в каждой из этих последовательностей.

Вероятность события {vi<v2} для больших п рассчитаем при-

приближенно, пользуясь теоремой Муавра—Лапласа. Сл. в.

vl = (vi—npi)/ynpiqi, q

l—pi, 1=1, 2,

A)

независимы и приближенно нормально распределены с нулевым

математическим ожиданием и единичной дисперсией. Неравенство

vi<v2 после подстановки в него A) запишем в виде

Так как разность независимых нормальных сл. в. распределена

нормально, то левая часть B) при больших п имеет распределе-

распределение, близкое к нормальному, с математическим ожиданием и дне-

персней, равными

i-o—Угш-о=о

M (VPtfi vl — УШг У») =

Таким образом, имеем приближенное равенство (обозначе-

1 + №

= 1.

ние

—ft)+Q.5

11

функция распределения стандартного нормального закона, а сла-

слагаемое 0,5 — поправка на дискретность. Используя таблицу нор-

нормального распределения, для различных п получаем

п

P(v»<vt)

25

0,42

50

0,39

100

0,35

250

0,18

1000

0,12

Итак, даже при я =1000 приблизительно 12 шансов из 100 за то,

что vi окажется меньше V2 и будет сделан неправильный вывод,

что рх<ръ

4. Общая вероятностная модель.

В современной теории вероятностей под вероятностной мо-

моделью понимают тройку объектов (Q, s4, ff>), называемую веро-

вероятностным пространством. Здесь Q — некоторое множество, эле-

элементы которого со называются элементарными событиями, st—

система подмножество множества Q, называемых событиями, & —

вероятностная функция, ставящая в соответствие каждому собы-

событию А число 9*(А), 0<^(Л)а^1, называемое его вероятностью.

В соответствии с аксиоматикой Колмогорова требуется, чтобы

система событий была замкнута относительно перехода к допол-

дополнению и конечному или счетному объединению:

, i=\, 2, ...

а также содержала все Q: Q&s? и притом &(Q) = l (легко ви-

видеть, что конечное или счетное пересечение событий также яв-

является событием); вероятностная мера & должна обладать свой-

свойством счетной аддитивности: если Aif[Aj=0 при 1ф\% то

где индекс i пробегает конечное или счетное множество.

Вероятностная модель явления ставит в соответствие резуль-

результатам наблюдений

Xl, X2,...,Xn C)

последовательность случайных величин (ел. в.)—функций на Q:

*i(<o), X2(<o) *„(©). D)

Полагают, что наблюдения C) являются значениями величин D)

при осуществлении ш. Несмотря на различие объектов C) и D),

в математической статистике принято называть и то и другое

12

выборкой. Статистическим закономерностям числовых данных ре-

реального эксперимента C) отвечают вероятностные утверждения

для случайных величин D).

5. Закон больших чисел.

Табл. 1 составлена по результатам испытаний, порождающих

последовательность «случайных» цифр. Здесь х<е{0, 1, 2,...,9},

Xi(<u) — независимые ел. в., принимающие значения 0, 1, 2,...,9

с равными вероятностями />=1/10. Обозначим через т» число

появлений цифры 0 в первых п испытаниях. Анализ последнего

столбца 1 привел нас к заключению, что частота нуля тп/п с

ростом п совершает затухающие колебания вблизи 1/10. Это —

выражение эмпирического закона устойчивости частот. Соответ-

Соответствующее математическое утверждение — закон больших чисел

C. Б. Ч) для ел. в. Х{. Введем индикаторную ел. в.

'{x,w»=o

I, если Xi (©) = 0,

), если Х<(©)^0,

i=i

Тогда 3.Б.Ч. в усиленной форме выражается соотношением

?* (limvJn=p) = 1.

Л-мо

Для практических целей полезно иметь оценки вероятностей

0>(\vjn-p\<6)

при конечных п. Это можно сделать, используя распределение

вероятностей величины vn:

&>(Vn=m) =Cnmpm(\ — р)п-"\ т=0, 1, 2,.... га, E)

где р=1/10. Для /t=10 расчет по формуле E) дает следующие

значения (см. табл. 5.1 биномиального распределения в [1]):

т

SF (vn < m)

0

0,3486

0,3486

0

0

1

,3874

,7360

2

0.1937

0,9297

3

0,574

0,9871

0

0

4

,0111

,9982

5

0,0014

0,9997

0

0

6

,0001

,9998

При п=100 иепосредственные вычисления по формуле E) не-

нецелесообразны. Хорошее приближение к биномиальному распре-

13

делению E) дает в этом случае распределение Пуассона:

^1m = 0) 1,2

от!

где Л=я/?=10. По табл. 5.3 пуассоновского распределения в [1]

находнм приближенные значения вероятностей

PI

1

0,3639

2

0,5711

3

0,7340

4

0,8490

5

0,9215

6

0,9620

7

0,9822

8

0,9914

При л =1000 для расчета E) надо воспользоваться нормаль-

нормальным приближением

х

( "пгпр <х\ ^ ф(х)= 1 С

\ -/npq ) /2я J

Выпишем для нескольких значений х приближенные значения ве-

вероятностей

из таблицы значений функцни нормального распределення:

X

Рх

1

0,6827

2

0,9545

2,6

0,9916

3

0,9973

Подведем итог приведенным расчетам в форме следующего

соотношения:

^4|vn/n — 0,1 |>6)sa;= 0,01, F)

где при л =10 следует брать 6=0,3; при л=100 —6=0,08; при

„=1000-6=0,025.

Статистический смысл неравенства F) выясняется при много-

многократном повторении опыта, порождающего п случайных цифр.

Допустим, результаты большого числа N таких опытов представ-

представлены последовательностями

х?, 4Л xf, /=1, 2 N,

G)

и пусть mf— число нулей в G). Обозначим через Mt число

тех последовательностей G), для которых выполнено неравенство

|т^/л-р|<6.

14

Тогда имеет место приближенное равенство

MJN?s\— о,

выражающее закон устойчивости частот в примеиении к событию

f 2. ЭМПИРИЧЕСКОЕ РАСПРЕДЕЛЕНИЕ ВЕРОЯТНОСТЕЯ

1. Эмпирическое распределение дискретной случайной велн-

Предположим сначала, что X дискретна и принимает значения

а, Ь, с,... с. вероятностями

Р(в), р(Ь), р(с)

По ряду наблюдений

Xi, Х2,..,Хп A)

вычисляем частоты р(х)=тн(хIп исходов х=а, Ь, с,.... Набор

частот

{р(а), /)(&)....} B)

представляет собой дискретное распределение вероятностей:

его называют эмпирическим распределением (э. р.), отвечающим

наблюдениям A). Э.р. B) является оценкой теоретического рас-

распределения ел. в. X:

{р{а),р(Ь)....). C)

Пример 1. Пусть теоретическое распределение — биноми-

биномиальное:

p(/)=C»ipi(l—p)*-i, /=0, 1 ft. D)

Смоделируем выборку объема л-40 из распределения D) с па-

параметрами А=250, р=0,1, объединяя первые 10000 случайных

цифр из [1] в л=40 групп по 250 цифр и подсчитывая число Xi

нулоП в i-й группе, i—1, 2 40. Результаты представлены ниже:

32

30

25

30

26

26

21

2S

31

22

24

24

22

18

27

31

31

29

31

32

13

30

24

30

25

19

19

22

28

24

17

24

24

23

17

23

26

25

28

20

Эмпирическое и теоретическое распределения представлены в

табл. 2.

15

Таблица 2

Вероятности р (/) = С^р'A—/>)*->;

А — 250: р = 0,1 и их оценки р (/)

по выборке объема л = 40

/

<13

13

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

>32

0,0

0,025

0,05

0,025

0,05

0,025

0,025

0,075

0,05

0,15

0,1

0,075

0,025

0,05

0,025

0,1

0,1

0.05

0,0

рA)

0,0019

@,003)

0,020

0,028

0,038

0,048

0,059

0,068

0,076

0,081

0,083

0,081

0,076

0,068

0,059

0,048

0,038

0,028

Таблица 3

Эмпирическая и теоретическая функции

распределения 7*(х), F(x) для выборки

из биномиального распределения;

b{x)=\F(x)-F{x)\

X

13

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

0,025

0,075

0.1

0,15

0,175

0,2

0,275

0,325

0,475

0,575

0,65

0,675

0,725

0,75

0,85

0,95

1

0,01

0,05

0,07

0,10

0,15

0,21

0,27

0.34

0,42

0,5

0,58

0,66

0.73

0,79

0,85

0,89

0,92

Д (О

0,015

0,025

0,03

0,04

0.025

0,01

0,005

0,015

0,055

0.075

0,07

0,015

0,005

0,04

0,00

0,06

0,08

Теоретическое распределение рассчитано приближенно с

мощью локальной предельной теоремы Муавра—Лапласа:

по-

Ф(*) =

/2S'

E)

значение рA3) вычислено непосредственно по формуле D)

(в скобках указано приближенное значение по формуле E)).

Как видно из табл. 2, относительная погрешность оценки

в интервале 17</<32 достигает 150%. Очевидно, для хорошей

оценки распределения C) необходимо, чтобы доля наблюдений,

приходящихся на каждую из представляющих интерес вероятно-

вероятностей, была достаточно велика. Этого можно добиться группиров-

группировкой, оценивая вероятности не отдельных значений, а группы зна-

значений.

С теоретической* точки зрения намного более полезным яв-

является представление эмпирической информации в виде функции

распределения (ф. р.)

?

/«?*

16

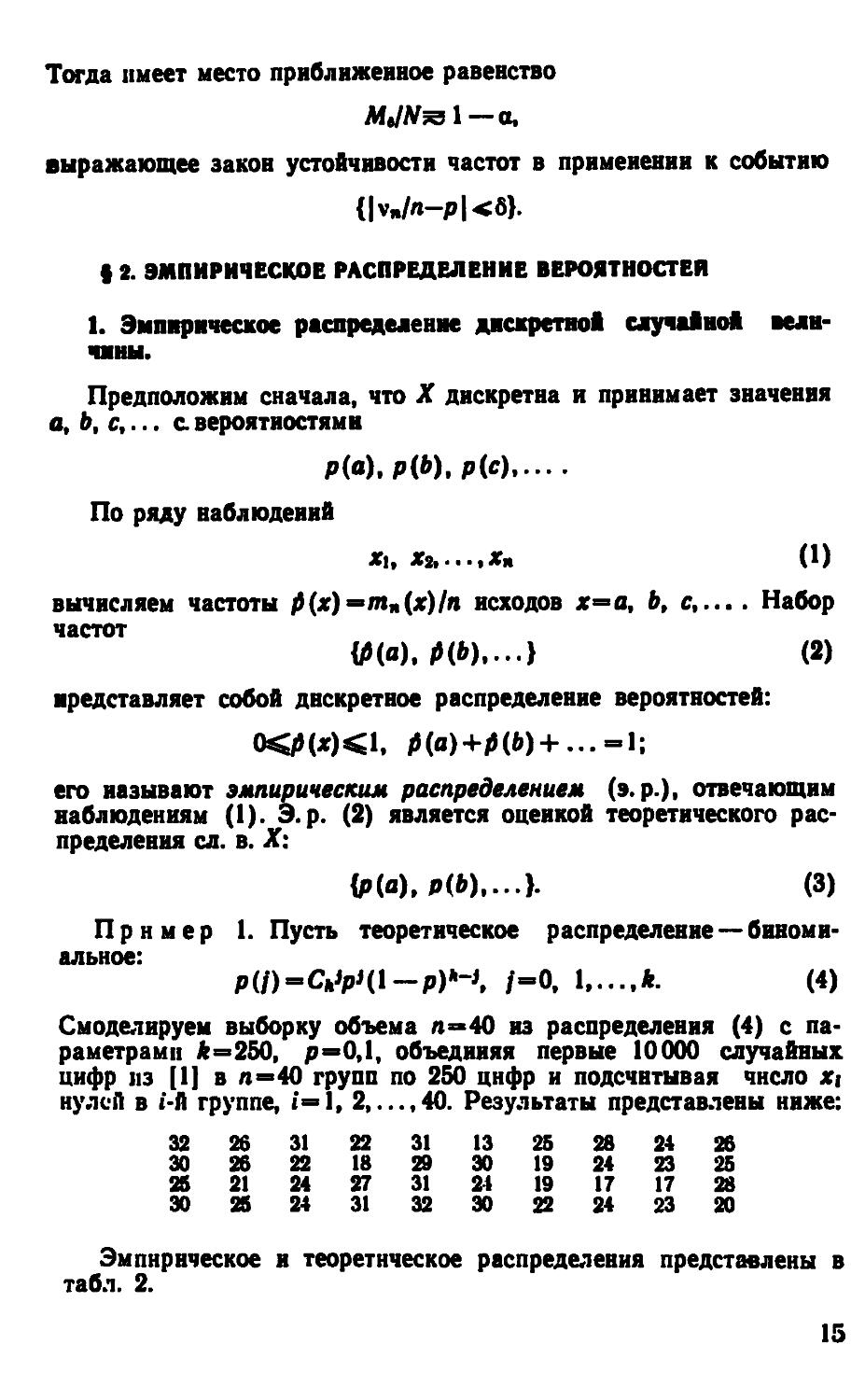

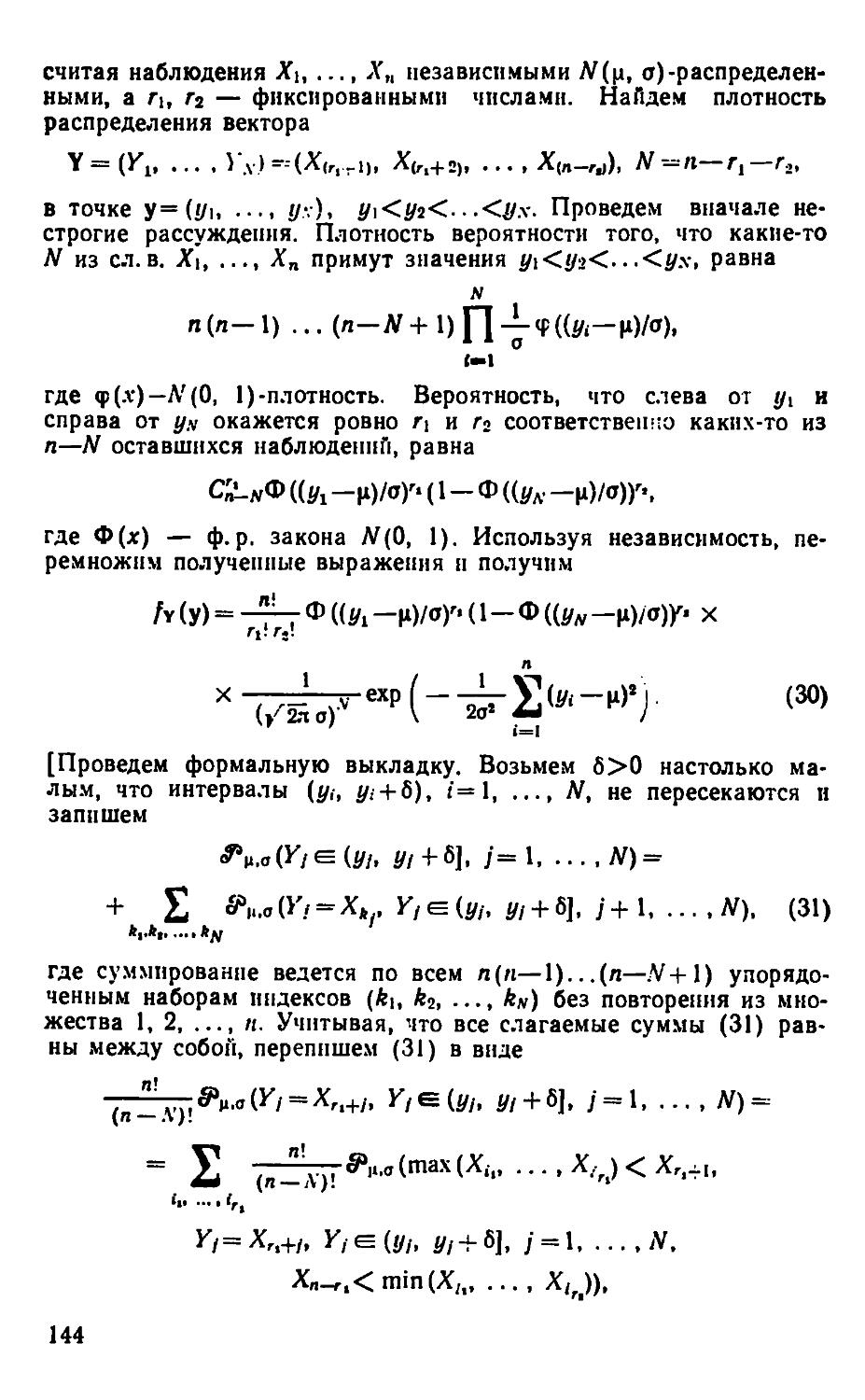

В табл. 3 и на рис. 1 проводится

сравнение F(x) с F(x)=9t(X<.

<х), рассчитанной с помощью

интегральной теоремы Муавра —

Лапласа.

Абсолютная погрешность

Д(х) = \F(x)—F(x) | достигает

0,08 при 13<х<32, а относитель-

относительная погрешность [b(x)/F(x)]X

Х100% при 17<х<32 не превос-

превосходит 40%.

2. Эмпирическая функция рас-

распределения.

12 Я 16 18 20 22 24 26 28 30 3234

Рис. 1. Эмпирическая функция рас-

распределения выборки нз биномиаль-

биномиального распределения р(/)=С^р'A—

р)*-), *=250; р=0,1 н ее нор-

нормальное приближение

Распределение вероятностей

произвольной случайной величи-

величины X характеризуют функцией

распределения (ф.p.) F(x). При

фиксированном х F(x) определяется как вероятность события

{¦?<*}, и ее можно оценить частотой этого события в ряду на-

наблюдений A). Соответствующую частоту принято обозначать

Fn(x). Иногда желательно отметить в обозначениях зависимость

Fn(x) отх=(хих2,...,хп\:

/VI*) =рп(х; хи х*,...,хп) =Fn(x; х).

Используя индикаторы, получаем следующую формулу:

(/д=1| если утверждение А истинно, и /а=0- в противном

случае).

Функция Fn(x), так, как она определена, есть функция рас-

распределения дискретной ел.в., принимающей значения Х\, *2.•••

..., хп с вероятностью 1/л (если какие-то k из Xi совпадают меж-

между собой, то их общему значению приписывается вероятность

kin), и ее называют эмпирической функцией распределения

(э. ф. р.).

Перейдем к вероятностной модели повторных испытаний —

последов ательности

Х\, Лг.• • -,Xn F)

независимых ел.в. с одинаковой ф. p. F(x). В математической

статистике принято употреблять одни и те же термины для ха-

характеристик последовательности ел. в. F) и принятых ими в ре-

17

зультате опыта значений A). В частности,

х,<х}, Х-=(Х} Хп).

также называют э. ф. р. Подчеркнем, что Fn(x; X) при каждом

фиксированном х— случайная величина. Так как

NlFn(x; X)=-±r

то из неравенства Чебышева получаем следующую оценку для

отклонения Fn{x) от F(x):

?an\Fn(x; X)-F(x)\>t)^F(x)(l-F(x))t-*. G)

Лучшую оценку для вероятности в левой части соотношения G)

при больших л можно получить применением интегральной тео-

теоремы Муавра—Лапласа:

*(V7\Fa{x; X)-F(x)\>t)*52(\-ib[t/)fF(x)(l-F(x)))). (8)

Заметим, что правые части G) и (8) зависят от величины F(x),

которую мы как раз и пытаемся оценить по результатам наблю-

наблюдений. Заменяя F(x)(l— F(x)) ее наибольшим возможным зна-

значением 1/4, эту зависимость мы устраним, но ценой огрубления

оценки.

3. Статистика Колмогорова.

Рассмотрим следующую меру расхождения э. ф. р. и теорети-

теоретической ф. р.

называемую статистикой Колмогорова.

Лемма. Распределение вероятностей ел. в. DV(X) не зависит

от ф. p. F{x)=&>(XjS^.x), если только F{x)—непрерывна.

Доказательство. Мы покажем, что распределение ел. в.

?>„(Х) совпадает с распределением D,,{\), где Y= (У.,..., Y,,) —

вектор из независимых равномерно распределенных на [0, 1]

ел. в. Предположим вначале, что F(x) строго монотонная и

F~l(y)—обратная к ней функция. Случайные величины У< =

=/-"(А",) иезазкенмы, л их общая ф. р. при 0<г/<1 равна

18

т. е. Yi равномерно распределена на [0,1]. Для э. ф.р.

Rn(y,V), У=(Уи -.., Yn),

имеем при 0<у<1

/I

Отсюда получаем

sup \Fn(x; X)-F(a)|- sup \Fn(F-l(y); X)-

<F(x)<l 0<tf<l

p \

x:0<F(x)<l

-F{F-l(y))\ - sup \Rri(y; \)-y\. (9)

0<y<\

Остается заметить, что в точках ,v, где F(.v)=0 или F(a-) = 1, с

вероятностью 1 Fn(x; \)=F(x), а войду монотонности Fn a F по

х также и sup \Fn(x; X) — F(x)\ по множеству всех таких х ра-

равен 0. Таким образом, правая и левая части соотношения (9) с

вероятностью единица равны Dn(\) и Dn(\) соответственно.

Следовательно, распределение Dn(X) для ел.в. X, распределен-

распределенных по закону F(x), совпадает с распределением Dn(\[) для ел.в.

Y, распределенных равномерно на отрезке [0,1].

Если F(x) не обязательно строго монотонна, то положим при

0<у<1

F-*(y)=s\ip{x:F(x)=y}.

Заметив, что супремум достигается ввиду непрерывности F{x) и

что поэтому при 0<у<1

нетрудно обнаружить, что проведенные выше рассуждения для

случая строго монотонной F{x) сохраняются без изменения и

для общего случая. ¦

Практическое значение доказанной леммы заключается в том,

что можно выбрать распределение вероятностей F(x) из сообра-

соображений наибольшей простоты численного расчета вероятностей

9>(Dn>6)=a и табулировать набор значений (п, б, а). Напри-

Например, если взять F(x)=sR(x)=x, O^jf^l, то расчеты сводятся к

вычислению объема «-мерной области, высекаемой в единичном

кубе условием

sup |/?„(*; xv хг *„)— jf|>6.

<<l

Как бы трудоемки ни оказались вычисления, но, проделав их

однажды, мы обеспечиваем возможность в случае любой непре-

19

рывноГ| ф. p. F(x) указать а и 6 такие, что при данном п выпол-

выполнено соотношение

n(x; X)— .F(jc)|>6)=a.

A0)

Иначе говоря, полоса Fn(x; Х)±б, —оо<х< + оо, ширины 2в

с границами, строящимися по выборке, с вероятностью 1—а за-

заключает внутри себя неизвестную ф. p. F(x).

Таблицы для значений п= 1A) 100 (от 1 до 100 с шагом 1) и

а=0,01; 0,02; 0,05; 0,1; 0,2 приведены в [1].

Пример 1 (продолжение). Для биномиальной ел. в. X с

параметрами fe = 250, р = 0,1, п = 40 нормированную ел. в. Х* =

= (X— kp)/l/kp(\—р) можно в силу теоремы Муавра—Лапласа

с известной степенью приближения считать распределенной по

нормальному закону с параметрами 0 и 1. Учитывая сказанное,

можно полагать, что для X* соотношение A0) будет выполняться

с некоторой небольшой погрешностью. Выпишем из табл. 6.2 [1]

несколько пар значений а, б, для которых ^(ZLo>6) =а:

(П)

Из рис. 1 и табл. 3 с учетом равенства

sup|Fn{х; х*)-Ф(х)| = sup |Fn(х; х)-Ф((*-kp)lVkp(\-p))\,

Ж

A

б

0,2

0,16547

0,1

0,18913

0,05

0,21012

0,02

0,23194

0,01

0,25205

находим Dn=0,095. Полученное отклонение надо рассматривать

как умеренное, если взглянуть на A1), откуда вытекает, что от-

отклонение на большую величину 0,165 и то происходит в средней

в одном случае из пяти. Н

А. Н. Колмогоровым было найдено предельное распределение

статистики Dn при и->-оо:

< у) =

, У>0,

к(У)= f; (-

Ряд для К (у) быстро сходится, и три члена этого ряда уже мо-

гу 1 обеспечить достаточную степень точности. Таблицу функции

20

К(у) можно найти в [1] (табл. 6.1). Выпишем несколько зна-

значений а=1 — К(у):

A2)

Пример 1 (продолжение). Имеем Vn-Dn = V40-0,095 = 0,60.

Из первого столбца A2) получаем, что примерно в 84 случаях

из 100 следовало бы ожидать отклонен ;е 0,60 или более, т. е. мы

имеем дело с довольно «удачными» результатами наблюдений.

Полезно сравнить точные значения для а, представленные в

A1), со следующими приближенными, получающимися из A2):

у

а

0

0

,60

.84

0

0

,65

.8

0,

0,

77

6

0

0

.90

,4

1

0

.08

О

1

0

,23

.1

1

0

.36

,05

1

0

.52

,02

1

0

,63

.01

а

b = y!Vn

0.2

0.17077

0.1

0,19449

0,05

0,21505

0,02

0,24035

0,01

0,25774

Итак, уже при п = 40 приближение ф. p. Dn с помощью асимпто-

асимптотической формулы очень хорошее. Абсолютная ошибка в опреде-

определении б, такого, что !P(Dw>6)=*a, для а от 0,01 до 0,2 состав-

составляет около 0,005; относительная ошибка в худшем случае равна

примерно 2,2%.

4. Выборочные среднее и дисперсия.

Поскольку э. ф. p. Fn(x) оценивает теоретическую ф. p. F(x),

то можно ожидать, что для функционалов T(F) от F оценкой бу-

будет служить значение T(Fr,), вычисленное по э. ф. p. Fn. К. числу

важнейших функционалов относятся среднее и дисперсия:

Поскольку Fn(x; Х\, Хч хп) отвечает дискретному распре-

распределению с вероятностями 1/л в точках Хи то

n n

T2 {F,,{x; x)) - — V (Xi -II = — Vx?-

П м П mm

x2 =-. si

(-1

21

или, переходя к случайным величинам,

п

7\(Fn(;c; Х)) = Д-?х, = Х,

n n

T 1С I». V\\— ' V^/Y Y\J ^ V^ V2 YJ C2

П АЫ П «v

l-l i-1

Выборочные среднее X и дисперсия So2, как мы увидим в

дальнейшем, оказываются во многих случаях хорошими и, в не-

некоторых отношениях, оптимальными оценками теоретических

значений.

§ 3. ПОРЯДКОВЫЕ СТАТИСТИКИ В ЗАДАЧАХ ОЦЕНИВАНИЯ

1. Порядковые статистики.

Расположим наблюдения

Х\, Хз, •.., Хп A1

в порядке возрастания и перенумеруем их заново:

|. B)

Фактически хц), »=1, 2,...,я, — действительные функции пере-

переменных A):

i(i, X2 хп):

{min(*, Xi-lt xi+i хп), i=\,...,n);

Функцию от результатов наблюдений принято называть стати-

статистикой. Статистики х((о, k=l, 2,...,n, называются порядковыми,

последовательность B) часто называют вариационным рядом.

При переходе от наблюдений A) к случайным величинам

Xi, X2, ..., Хп C)

терминология сохраняется: X(k>, определенное тем же способом,

что и Л(ц,, называется k-й порядковой статистикой, а

-^A)^-^B)^ • • • ^-fyn) D)

— вариационным рядом. Отметим, что э. ф. р. зависит от наблю-

наблюдении через порядковые статистики:

Fn{x; Xi,...,Хп) =Fn(x; Хц),...,Х(П)).

22

Иногда бывает желательно подчеркнуть зависимость порядковых

статистик Xi() от п. В таком случае наряду с обозначениями D)

будем употреблять следующие:

i=l, 2,...,п.

E)

Порядковые статистики широко используются в статистиче-

статистических задачах. Рассмотрим некоторые примеры.

2. Оценивание содержимого урны.

Предположим, что урна содержит неизвестное число шаров N,

занумерованных числами от 1 до N. С целью определения N со-

совершается повторный выбор с волвр; щением объема п. Пусть

Х\, Х2,...,хп — номера извлеченных шаюв. Естественно в качест-

качестве оценки R предложить максимальное из наблюдений:

#=*<*>• F)

Шуточную интерпретацию этой задачи дает В. Феллер [2],

предлагая для оценки числа зарегистрированных в городе авто-

автомобилей встать на перекрестке и записывать номера проезжаю-

проезжающих автомобилей. Приведенные ниже результаты моделирования

этой задачи с помощью таблицы случайных чисел показывают,

что предлагаемая статистическая процедура приводит к хорошим

оценкам. Пусть N=10000, л =10; по табл. 7.1, о [1] получены сле-

следующие значения Х(П) для 10 независимых выборок л-;, .... .vn:

9590, 8947, 9533, 9901, 9511, 9885, 7990, 9776, 9055, 9352. G)

Сл. в. Yi = Xf-N~l g хорошей степенью приближения могут рас-

рассматриваться как равномерно распределенные на [0,1], так что

Для ряда значений у и п=10 имеем

у

0.79

0,1

0.74

0.05

0.63

0.01

Отсюда можно сделать заключение, что в среднем в одном

случае из 10 в качестве оценки N= 10 000 будет появляться зна-

значение .V^7900. Поэтому появление в G) значения 7990 не сле-

следует считать особенным.

Совершенно ясно, что оценка F) всегда дает заниженный ре-

результат: N^X. Вычисляя

23

найдем

Оценку ft можно поправить, устранив систематическое смещение.

Пренебрегая погрешностью, запишем

МA + 1/л)#=ЛЛ (8)

Исправленные значения G) выглядят так (с точностью до еди-

единицы):

10549, 9841, 10486, 10891, 10462, 10873, 8789, 10753, 9960, 10287.

Свойство оценки A + 1/л)#, выражаемое формулой (8), назы-

называется несмещенностью. Вообще говоря, несмещенность — полез-

полезное свойство оценки. Заметим, однако, что устранение смещения

в рассматриваемом случае приводит к увеличению в A + 1/пJ =

= 1,2! раз дисперсии оценки (\-\-l//i)K по сравнению с Л (и во

столько же раз увеличивается выборочная дисперсия ряда (9)

по сравнению с G)).

Возвращаясь к ситуации, когда /V неизвестно, но достаточно

велико, можно по результатам наблюдений av, i=l п, подо-

подобрать такое число М, что последовательность xJM могла бы с

достаточной степенью точности рассматриваться как выборка из

равномерного распределения из отрезка [0, в], где Q^N/M неиз-

неизвестно. В следующем примере эта задача рассматривается более

подробно.

3. Оценка параметра равномерного распределения.

Пусть A)—выборка из равномерного распределения на [0, 0]

с неизвестным 0, C)—соответствующие независимые равномер-

равномерно распределенные ел. в. Поскольку MA'j=e/2, то для оценки 6

можно предложить статистику

Оценка A0), очевидно, несмещенная: М7"(Х) = 0. Учитывая

DX 0/12, получаем

DT{X)=—DXl = ~-

Статистика Хм имеет следующие ф. р., среднее и дисперсию:

^=(n + 2);+i),0'. A1)

24

Сравнивая статистики (l + l/n)Xln) и 7"(Х), замечаем, что обе

они несмещенно оценивают 0, ио дисперсия первой из них, рав-

равная (л(п+2))-'02, в (л+2)/3 раза меньше дисперсии второй.

Для измерения качества оценки часто используют ту или иную

характеристику разброса ее распределения вероятностей, чаще

всего дисперсию. С этой точки зрения оценка Х(п) (или A + 1/л)Х

ХА',„.) существенно лучше, нежели 7"(Х). При больших п сравне-

сравнение Х(п) и Т(\) можно провести более детально. В соответствии

с центральной предельной теоремой при ?>0

?*(\Т{Х)— е|</е/]/Зп)я5 1 —2Ф(— t). A2)

В свою очередь из A1) мы получаем при

«г (о < е-х(п) < ю/п)=«г (х(п)

= 1 —A—*/л)п*5 1— е-'. A3)

Фиксируем U и <2 так, что

1_а= 1 —2Ф(—7t)= 1—е-'-.

Из A2) и A3) вытекает, что с вероятностью, приблизительно

равной 1 — а, выполняется каждое из следующих неравенств:

Т(\) (l+/1/Vn)-1<e<7'(X) (I-fi/уЗя)-1. A4)

Х(п)<в<^(«)A-^2/я)-1. A5)

Таким образом, при больших п ширина первого и второго интер-

интервалов, накрывающих неизвестное значение 0 с вероятностью

1 — а, равна соответственно

Из соотношений A2), A3) вытекает, что сл.в. 7"(X)/X(n) с высо-

высокой вероятностью принимает значение, близкое к 1. Поэтому ин-

интервал, основанный на статистике Т(\), шире интервала, постро-

построенного по Х(п), примерно в l/n-2ti/y3t2. Прн а=0,05 имеем U =

•=1,96, <2 = 2,99, и множитель при Уп равняется 0,76.

4. Оценивание параметра сдвига экспоненциального распре-

распределения.

Предположим, что сл.в. C) независимы и имеют одну и ту

же плотность f(x— 6), где

0, х<0.

Распределение с плотностью f(x) и ф. р. /г(х) = 1 — егх, х>0,

называется экспоненциальным. Оно часто употребляется в теории

надежности как распределение времени до выхода из строя (от-

25

каза) изделия. «Сдвинутое» экспоненциальное распределение

/(х-0), 0>О. интерпретируют как наличие «гарантийного* сро-

срока 0, в течение которого отказ произойти не может.

Порядковая статистика х<и служит естественной оценкой б,

ее распределение дается формулой

,.... Х„>х) = «г»'*-*», л->0,

откуда получаем

= \ — е~\ A6)

т. е. интервал Хц, -г—^—^—^- <0<ХA) с вероятностью 1-а

накрывает неизвестное значение 6.

Среднее значение распределения f(x — 0) равно 6+1, и пото-

потому для оценки 0 можно также предложить статистику 7"(Х) =

= Х— 1. Легко подсчитать, что

М7"(Х)-в,

С другой стороны, из A6) находим

Сравнивая дисперсии оценки 7"(Х) и оценки Х(|)— 1/п (с устра-

устраненным смещением), приходим к выводу, что если измерять ка-

качество оценок значениями их первых двух моментов, то оценка

Х(|)— 1/м предпочтительнее оценки 7"(Х). Используя центральную

предельную теорему, найдем, что распределение X—1 — 6 при

больших п приближенно нормально с нулевым средним и диспер-

дисперсией 1/и:

&(\]'п(Х— 1 — 8) КО - 1—2Ф(—0,

откуда интервал

.V-1 -//|'л<8<.Т-1+//У/Г

ширины порядка 1/f'n накрывает неизвестное 0 с вероятностью

примерно 1 — 2Ф(—О, В то время как аналогичный интервал

A6) имеет длину порядка 1/п.

5. Доверительный интервал.

Для оценивания неизвестного параметра 0 по результатам

наблюдений в разобранных примерах сначала предлагались

так называемые точечные оценки — статистики, значения которых

считались приближением к 0. Погрешность оценивания характе-

характеризовалась двумя первыми моментами оценки —средним и дис-

дисперсией. С другой стороны, рассматривалась интервальная

оценка

7"i(X, а)<0<7-2(Х, а),

26

такая, что вне зависимости от того, каково истинное значенье

параметра 6, оно заключено в данном интервале с вероятностью

1 —а. В этой случае говорят, что построен а-доверительный ин-

интервал для 6, или, иначе, доверительный интервал с коэффициен-

коэффициентом доверия 1 — а (если написанное выше неравенство выпол-

выполняется с вероятностью, приближенно равной 1 —а, то говорят о

приближенном а-доверительном интервале). Отметим, что в

предыдущем параграфе была построена а-доверительная полоса,

заключающая внутри себя неизвестную ф. p. F(x).

6. Выборочные квантили.

В приведенных выше примерах крайние порядковые стати-

статистики выступают в качестве оценок неизвестного параметра, ко-

который определяет «крайнюю» точку носителя распределения ве-

вероятностей выборки. Другое важное применение порядковых ста-

тистнк возникает в задачах оценивания функции, обратной к

теоретической ф. р. Назовем р-квантилью непрерывной ф. р.

F(x) решение xP=xP(F) уравнения

F{xP)-p, 0<р<1. A7)

Для р—1/2 хр называется медианой распределения, для р=1/4

и р=3/4 употребляется название квартиль. Если F строго моно-

монотонна, то xp"F-l(p) определяется соотношением A7) однознач-

однозначно, в прртивном случае для некоторых р уравнение A7) имеет в

качестве решения целый отрезок [х, х] значений хр. Так как при

этом F(x) — F(x)—p, то

<?(Х<=[х, x))-F(x)-F(x)=0.

С точки зрения теории вероятностей значения х из \х, х) вообще

можно не принимать во внимание. Таким образом, неоднознач-

неоднозначность решения уравнения A7) несущественна. Чтобы устранить

связанные с отмеченной неоднозначностью формальные неудоб-

неудобства, можно принять за хР при рф\/2 наименьший корень урав-

уравнения A7): хр**х. Для медианы хщ в случае неоднозначности ее

определения удобнее принять середину отрезка [х, х].

Если р=А/я, 1<?<л—1, то уравнение A7), записанное для

э. ф. р., имеет своим наименьшим решением Хц,,:

Fn (х,Л); *!,..., хп) =p=k/n,

и поэтому x(h) может рассматриваться как естественная оценка

квантили хР. В случае произвольного р выборочной кеантилью

обычно называют X[nrj+i, где [а] обозначает целую часть чис-

числа а.

Нетрудно найти ф. р. порядковой статистики (в предположе-

предположении независимости ел. в. C)):

27

<*) = <*• (Fn (x, X) ^ k/n) =

=Z own-

n

где было использовано, что ел. в. J] /{*,<*} есть число успе-

1

1—1

хов в п испытаниях Бернулли с вероятностью успеха F(x).

7. Равномерное распределение.

В случае независимой выборки из равномерного распределе-

распределения: F(x)=x, 0<х<1, из A8) получаем

5> (X,*) < х) = ? CU1 A -*)"-<. A9)

Дифференцируя A9) по х, имеем

л я—1

или

I. B0)

Таким образом, для ф. р. A9) имеет место следующее представ-

представление

Функция двух переменных

В (а, Ь)= J /—«A —О»-1*, а > 0, Ь > 0, B2)

о

носит название бета-функции Эйлера. Плотность распределения

B1)

[В(а, 6)]-|дсв-1A—хI*-1, 0<х<1, B3)

28

называется бета-плотностью (с параметрами а, Ь), а соответ-

соответствующая ф. р.

К (а, Ь) = [В (а, б)] J f°-' A - /)МЛ, 0 < .* < 1. B4)

называется неполной бета-функцией. Как вытекает из A9), B1),

lx(k, n-k + 1) = ? CU'A -х)"-'. B5)

Для вычисления /х(а, Ь) составлены таблицы (см. [1]). Из

A8) и B5) получаем, что ф. p. k-k порядковой статистики от не-

независимой выборки объема п с непрерывной ф. p. F(x) может

быть выражена через неполную бета-функцию:

?(Xlh&x)=lFlX)(k, n-k+\). B6)

8. Доверительные интервалы для квантилей.

Формула B6) приводит к важному статистическому приложе-

приложению—доверительный границам и интервалам для квантилей не-

непрерывной теоретической ф. р. Именно, подставляя в B6) р-кван-

тиль, получаем

^(*,*,<*р)-/р(*, n-k+\), B7)

т. е. X[h) является нижней а-доверительной границей для р-кван-

тилн хр с а=1 — Ip(k, n — k+\). Аналогично

9>(Х^Хр) = \-1рA, n-1+l), B8)

т. е. Х1П является верхней а-доверительной границей для кванти-

квантили Хр.

При k<l с вероятностью 1 Xltl)<Xw, поэтому

1 -?(xP<Xlh)) -

т. е. доверительный интервал

Х№)<хР<Х(/) B9)

имеет коэффициент доверия

1 —а = /р(Л, п — k+l)— 1P{1, n — 1+l). C0)

Наиболее часто используют доверительный интервал B9) для

медианы распределения xU2, так как для симметричных распре-

распределений медиана совпадает с математическим ожиданием (если

оно существует). Правда, как мы увидим, в случае нормальной

выборки, а также если выборка большая, интервальная оценка,

основанная на порядковых статистиках, проигрывает по сравне-

сравнению с другими методами интервального оценивания.

29

9. Coumclihoc распределение пары порядковых статистик.

Аналогично A8) можно найти совместную ф. р. двух порядко-

порядковых статистик Xih) и Xw, k<l. При х<у

r=ft s=/—г

(=1

х F(*)' (F(«/)- F (x))' A -

Если ф. р. F(x) имеет плотность /(*), то пара (Xlh)t Xin) имеет

совместную плотность, которую можно получить, дифференцируя

по х и у их совместную ф. р. Полезнее, однако, сделать предель-

предельный переход при б-»-0, б>0, в следующем выражении (предпола-

(предполагаем х<у):

C1)

Используя равновероятность всех п\ перестановок Х,,< Х,,< ...

< Х/а). запишем C1) в виде

Х,<...<Х„). C2)

Выражение C2) эквивалентно при 6-»-0 следующему:

< ... <Л'„). C3»

Действительно, если, скажем, в интервал (х, х + 6] попало зна-

значение еще одной ел. в., то вероятность в C2) оценивается сверху

величиной

(F(x+6)-F(x))*(F(y+6)-F(y))~f*(x)f(yN\ «WO,

в то время как вероятность в C3) имеет порядок б2 (при

/(*)/<//)^0)- Используя независимость ел.в. Xf, i=l,...,n, рав-

нозер'.':-!тиость (k—1)! перестановок из 'Хи ..., X/. .\ и (/ — k —

— 1>: лерестаиовок vz Хх.и... ,Х„, получаем для C3) выражение

6~-п! & [X, < ... < Х,_, < л) ^ (.v < X, < л- -г 6) я

х j* (х + л < х„л ,<...< xL_, ¦< у) а° (у < х, <у Л) х

У <Р !,, г 6 < X,,,<...< *,) - о-',;! .-_1_ f (a/--' (f (л- -F- 6)-

30

- F(*

— « — ')

l 6)y-i. C4)

Пределом выражения C4) является совместная плотность

пары порядковых статистик {Xw, Xm), k<l, в точке (х, у), х<у,

и этот предел равен

п\

F(.vf->/(A-)X

(k — \y.(l — к — 1)! (и — iy

X (F(y)-F{x))i-«-*f(y)(\-F(y)r-!. C5)

§ 4. ПАРАМЕТРЫ СДВИГА И МАСШТАБА: ГРАФИЧЕСКИЙ АНАЛИЗ

I. Семейство сдвига-масштаба.

Значительный теоретический и прикладной интерес представ-

представляет статистическая модель независимых наблюдений

Хи А'2)... ^» A)

с общей ф. р. вида F((x—ц)/а), где F(x)—известная непрерыв-

непрерывная ф. р., а параметры сдвига и и масштаба а>0, вообще гово-

говоря, неизвестны. Нормированные ел. в.

Yi={Xi-li)la, i=\, 2 л, B)

очевидно, также независимы и одинаково распределены, а их об-

общая ф.р. равна

^(У,О) =^((Х, - fi)/o<x) =^(Х,««+м) =F(x).

Семейство ф. p. F((x — ц)/а) может быть образовано из лю-

любой ф. p. F(x), однако в математической статистике и ее прило-

жениях употребляют сравнительно небольшой набор распреде-

распределений, которые благодаря особым теоретическим свойствам ча-

часто используются в реальных задачах. К числу таких распреде-

распределений относится прежде всего нормальное

Параметры ц н а семейства Ф((х — м)/а) имеют хорошо из-

известный вероятностный смысл:

MX,- =г. ц + afAYt = ц + о

J= f te~"'2 dt = ц,

— Л

ос

DX( - огМУ2 = о2 -4= [ /2<г-<'. -' Л - о2.

31

Отмешм i а к же семейство экспоненциальных распределений,

задающееся плотностью

г-*, х>0,

Здесь МУ, = 1, DY(=\ и ц ,

Приведем еще один интересный пример, когда семейство ф. р.,

не являющееся сдвиго-масштабным, становится таким после пре-

преобразования. Распределение с ф. р.

-(*/P)*], х>0, (ЗУ

возникает в теории экстремальных значений и часто (под назва-

названием распределение Вейбулла) употребляется в качестве распре-

распределения времени жизни изделия в задачах надежности. Пусть

ел. в. X имеет ф. p. G(x). Тогда ел. в. Z—\nX имеет ф. р.

= 1 — ехр [ — p-vev*] = i _exp [ _6хр (Y (x—In р*))].

Таким образом, если случайная выборка Xit i=l,...,n, взята из

семейства C) с параметрами р>0, у>0. то Zi = \nXu i=l,...

...,п, является случайной выборкой из семейства F((x— ц)/а),

где

F(x) = l — ехр [—expxj, D)

л параметры ц, а связаны с р, у формулами

Отметим, что ф. р. D) также возникает в теории экстремаль-

экстремальных значений.

2. Вероятностная бумага.

Во многих случаях теоретические соображения или предше-

предшествующий опыт позволяют высказать предположение о том, что

случайная выборка х\, хц,...,хп взята из распределения F((x —

— ц)/а) с известной непрерывной F(x), но неизвестными ц, а.

Используя статистический материал х\, хц,...,хп, желательно

проверить это предположение. Соответствующая задача относится

к области теории проверки статистических гипотез. Существуют

различные принципы и разработаны различные методы решения

подобных задач, однако предварительный графический анализ

данных остается полезным инструментом исследования, особенно

для небольшой выборки.

Эмпирическая ф. р. является естественным приближением тео-

теоретической ф. р., но, за исключением выборки из равномерного

распределения (когда теоретическая ф.р. — прямая линия), гра-

графическая подгонка ф. р. из семейства F((x—ц)/ст) к э. ф. р.

32

представляет, очевидно, определенные трудности. Преодолеть их

можно, сраспрямив» график /?((дс— ц)/а). С этой целью, предпо-

предполагая, что F(x) непрерывна и строго монотонна в точках х, в ко-

которых 0<F(x)<l, введем отображение полосы —оо<дс< + оо,

0<у<1 в плоскость по формуле

(х, у)-+(х, F-Чу)), E).

где F~l(y) — функция, обратная к F(x). Отображение E) по ус-

условиям, наложенным на F(x), взанмно-однозначно и взанмно-не-

прерывно в области своего определения. Прн этом отображении

(х, F(x))-+(x, F->(F(x))) = (x, x), F)

т. е. график y = F(x), 0<у<1, переходит в прямую линию у=х

(илн ее интервал, если существуют такие значения х, что F(x) = l

или F(x)=0). Далее,

(х,

т. е. график F({x — ц)/а), ф. р. из рассматриваемого семейства,

переходит в прямую линию

Опишем вытекающую отсюда методику. Пусть Fn(x) — э. ф. р.

случайной выборки из семейства F((x — ц)Дт). График y=Fn(x)

преобразуем в y = F~l(Fn{x)) и подберем наиболее тесно приле-

прилегающую к нему прямую линию

у-(*-?)/* G)

Прн этом а—котангенс угла наклона прямой G) к оси х —

будет служить оценкой параметра а. Оценкой ц будет абсцисса

точки пересечения прямой G) с осью х. Если график у =

= F~l(Fn(x)) систематически уклоняется от линейной зависимо-

зависимости, то есть все основания сомневаться в том, что наблюдаемые

данные взяты из распределения F((x—ц)/а).

При фактической реализации указанного приема нет необхо-

необходимости строить целиком график y=F-l(Fn(x)), а следует отме-

отметить только точки (X(f), F-^iln)), i—l,...n, отвечающие скачкам

Fn(x), и подгонять прямую к этим точкам. Ввиду неудобств, свя-

связанных с точкой (*(„), F-'(l)), обычно строят точки (jcA), F-'X

Х('7(я+1))), 1 = 1, ..., п. Более удачным является выбор точек в

виде uG), F-i((/_o,5)/n)), i=l, 2 п.

Для графической работы с семейством сдвига-масштаба

М(*--ц)/а) удобно изготовить так называемую вероятностную

бумагу, выбрав по оси ординат неравномерный масштаб и при-

приписав точке с декартовой координатой у новую координату у'=

~F(u). В новой системе координат ху' непосредственно наносятся

точки (*A), (j — 0,5)/гс). Оцифровка осн ординат для нормального

закона показана на рис. 2.

2 М. В. Козлов, А. В. Прохоров 33

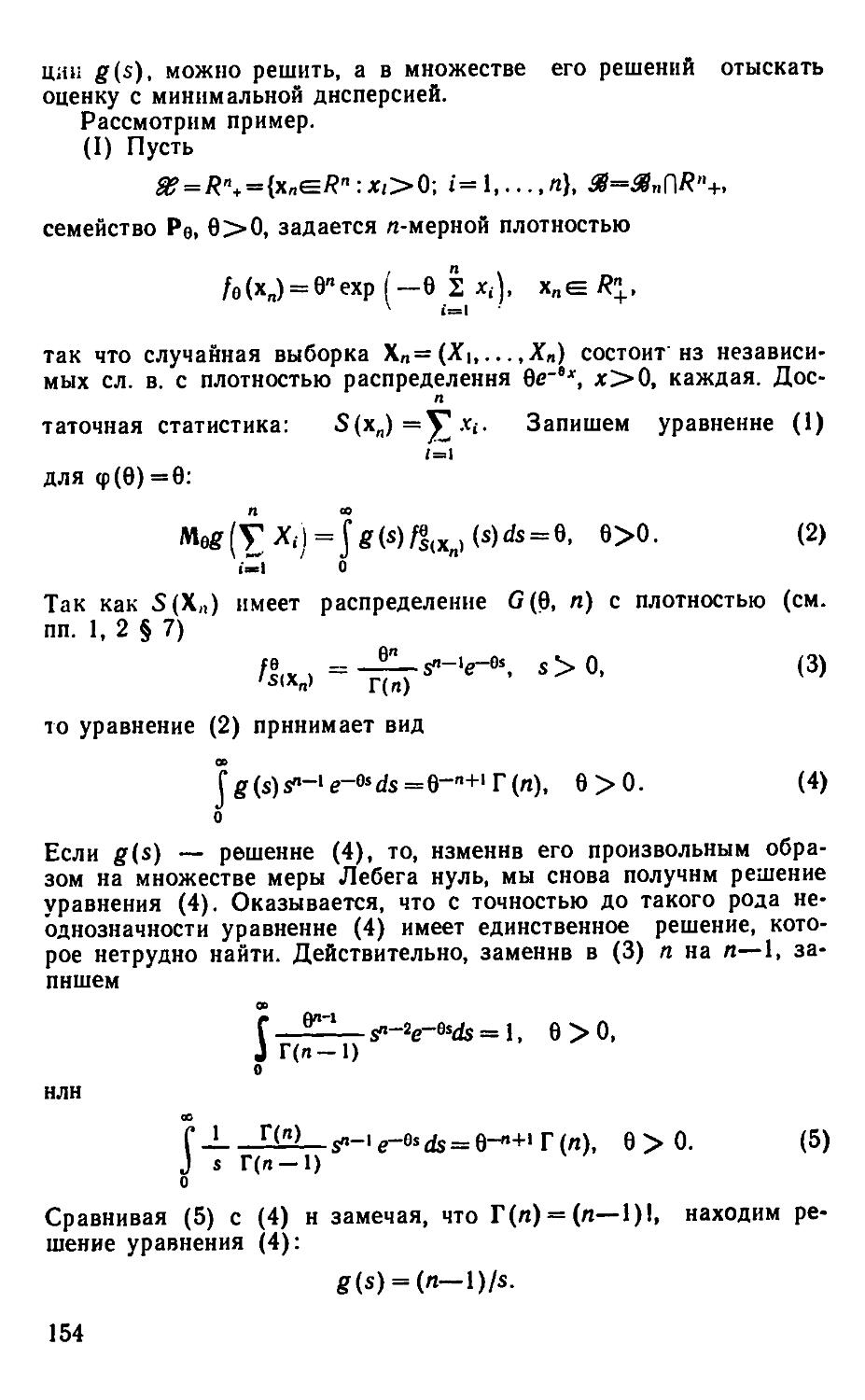

3. Примеры графического анализа.

С помощью таблицы случайных чисел образована выборка

объема я=10 из нормального закона с ц=1, а=2:

—2,504; 0,342; —1,512; 1,636; 4,062; 1,698; —0,916; 0,882;

1,830; —1,168.

Рис. 2. Изготовление нормальной ве-

вероятностной бумаги

1,5

1

0,5

0

0,5

1

1,5

9

I i

-

-

-

У

/

•

I I

1 i 1 ! .

Х-

• ^г _

-

-

-

1 1 1 1

-з -г -1 о

12 3*5

X

Рис. 3. Точки (x,t... Ф-'(A—0.5.10))

и прилегающая прямая для нскус-

ственнип нормальном выоорки

По таблице функции, обратной к нормальной, из [1] находим

ф-1(-

i

i—O,.

10

L)

(-

6E)

-H,125

7D)

(—H,385

8C)

(-H,675

9B)

( )l,036

10.1)

(-) 1,645

Точки (*(«, Ф-1 ((i — 0,5)/10)), 1=1, 2,..., 10, отмечены на

графике (рис. 3), и подобрана на глаз прямая

у=(дс — ц)/а, илн х =

где ц = 0,44; а=1,87. Выборочные среднее и дисперсия равны

х^ -j^xi --0.435; s\ = ±?х*-? - 2,976; s0 = 1,725.

i-l

Как видно, графическое приближение дает оценки ц, а. близ-

близкие к выборочным. Щ

34

В следующей таблице приведены данные о ежегодном потреб-

потреблении в фунтах на душу населения мясных продуктов, включая

птицу и рыбу, в США с 1919 по 1941 г. (считывать по стро-

строкам) [3]:

171

568

146

.3

,0

,7

167

164

160

.0

.7

.2

164,

163.

15G.

5

0

8

169.

162.

156.

3

1

8

179,

160.

1G5.

4

2

4

179

161

174

,2

,2

,7

172.

165,

178,

6

8

7

170,

163,

5

5

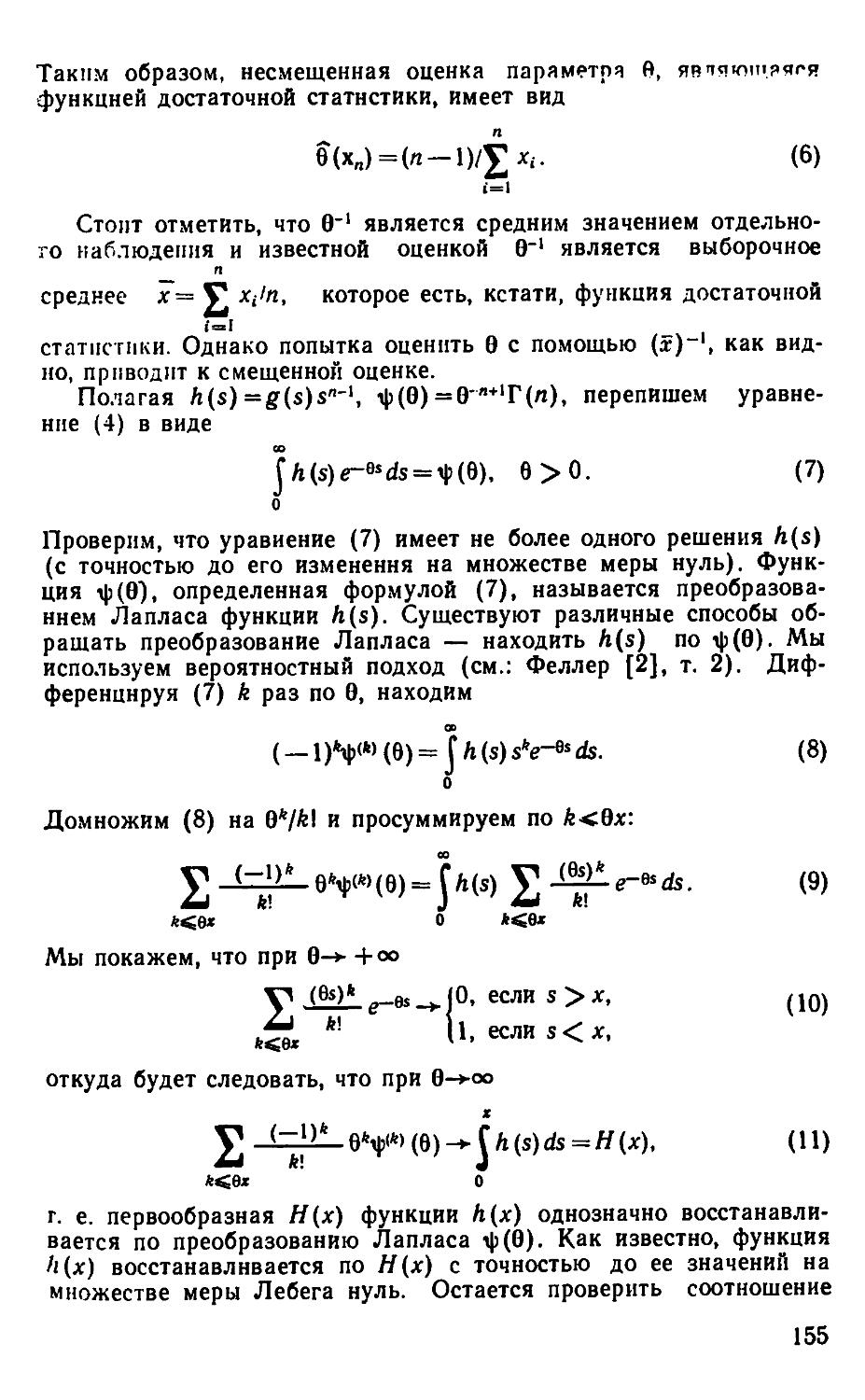

(8)

Эти данные предлагается описать моделью

(9)

где / обозначает год, xt — потребление в этот год. Полином а+

+ bt-rrt2+dt3 призван отразить неслучайные изменения перемен-

переменной xt и называется трендом, коэффициенты а, Ь, с, d подлежат

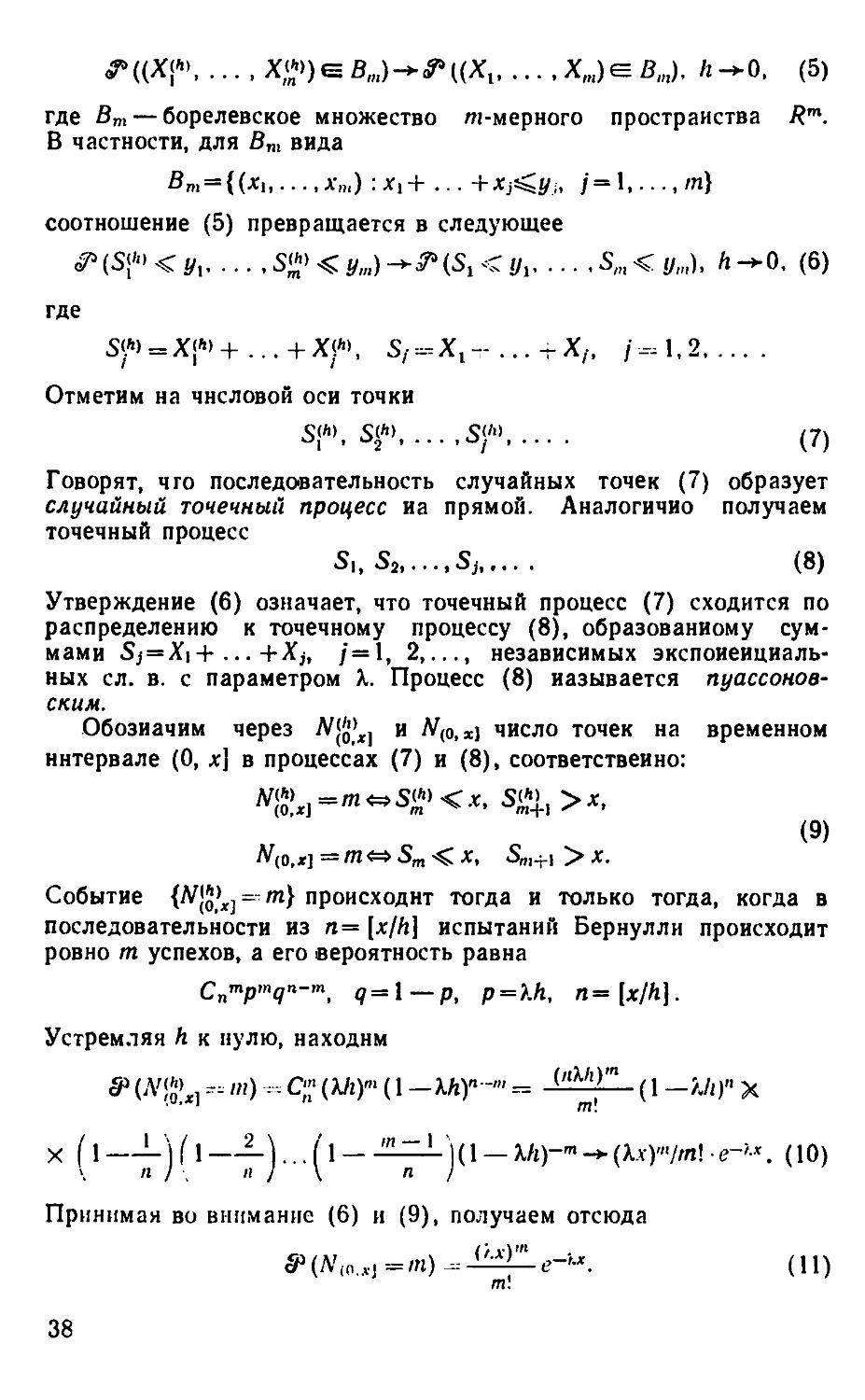

7920 25 30 35

Рис. 4 Ежегодное потребление мяса

в США в 1919—1941 гг. н полино-

полиномиальное приближение

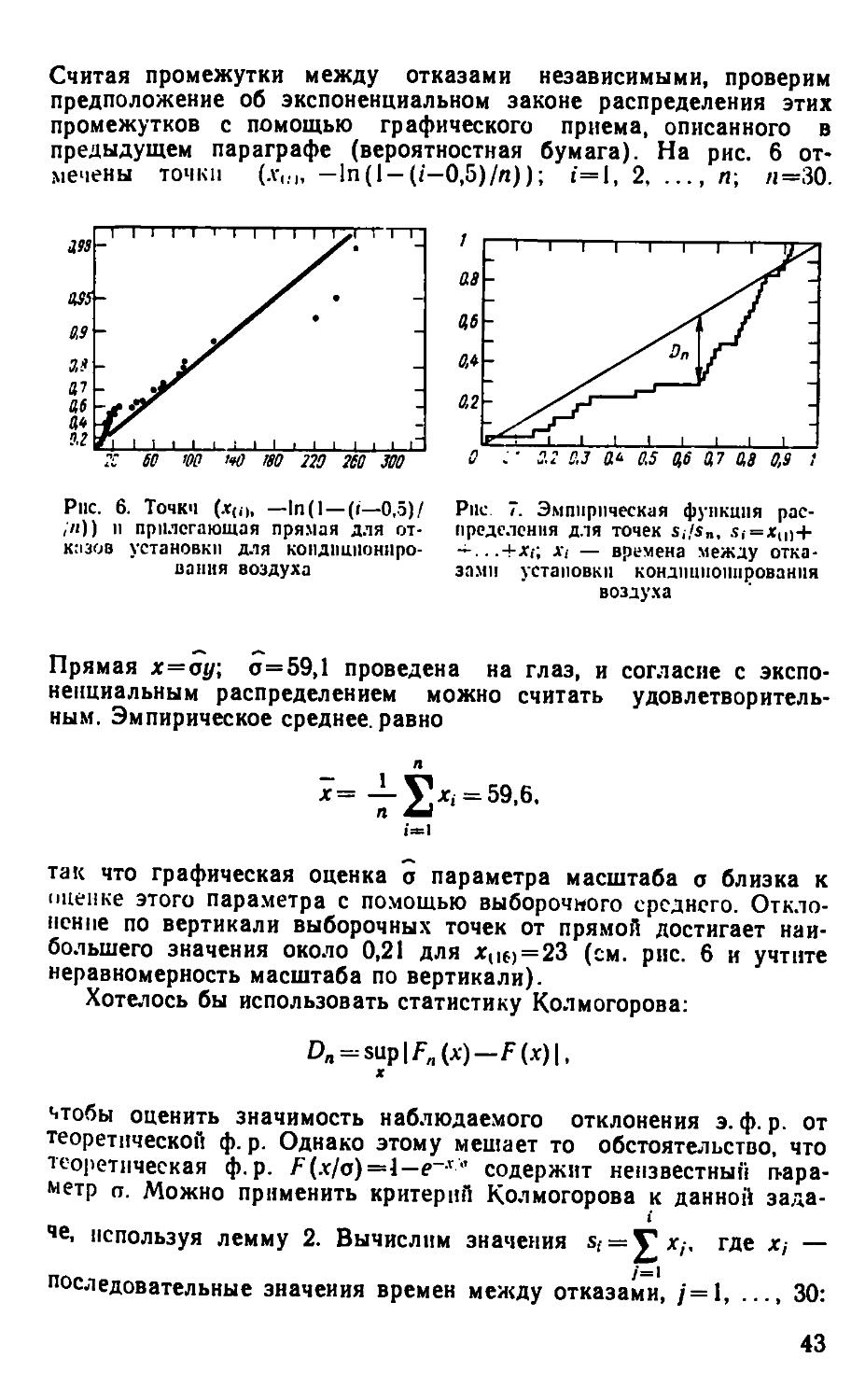

0,99

0,95

0,9

0,7

0,5

0,3

0,1

0,05

0,01

т—1—1—1—

_

-

-

j

S

7 л i i

1—1 1—г—;

х* -

-

i i i

/«5 150 155 160 165 ПО 175 180

Рис. о. Данные о потреблении мяса

в США в 1919—1941 гг., нанесенные

на нормальную вероятностную бу-

бумагу

подбору по наблюдениям (8); е( — случайные колебания в еже-

ежегодном потреблении, их полагают независимыми, одинаково нор-

нормально распределенными ел. в. с нулевым средним и неизвестной

дисперсией. Значения (8) и аппроксимирующий их полином изоб-

изображены на рис. 4.

Попробуем с помощью описанного выше графического приема

проанализировать данные (8) на предмет того, нельзя ли их рас-

рассматривать как выборку из нормального распределения, т. е.

считать, что коэффициенты Ь, с, d в (9) равны нулю, и полагать

колебания в ежегодном потреблении чисто случайными, не содер-

содержащими тренда. Графическое построение на рис. 5 показывает

удовлетворительное согласие с проведенной на глаз прямой

м= 166,5, а = 7,33. A0)

С другой стороны, приведенный в книге [3J статистический ана-

показывает, что данные (8) следует описывать моделью (9),

35

как это и представлено на рнс. 4. Противоречие в толковании

статистических данных (8) позволяет обратить внимание на сле-

следующий важный вывод.

Любой статистический прием направлен на проверку одних

сторон вероятностной модели и не улавливает отклонения в дру-

других направлениях. Поэтому при анализе данных надо ясно пред-

представлять себе, какие предположения о модели не ставятся под

сомнение, а что подлежит проверке по результатам наблюдений.

При графическом анализе (см. рнс. 4) предполагалось, что на-

наблюдения независимы и одинаково распределены, и проверялась

гипотеза о нормальности их общего распределения. Если исход-

исходные предположения нарушены, то и выводы, которые делаются в

отношении проверяемой гипотезы, несостоятельны.

Отметим, кстати, что э. ф. р. не меняется при перестановке на-

наблюдений xi, X2 хп\ иначе говоря, она является функцией по-

порядковых статистик дсA), дсB> Х(Пу В частности, наблюдения

t/i=x(j), ?=1,...,л, имеют ту же э. ф. р., что н дс(, »=1, 2,..., л, н

если не обратить на это внимание, то по результатам анализа

э.ф.р. можно для значений уи i=l,...,n, ошибочно принять тот

же вероятностный закон, что и для дс,-.

§ 5. ЭКСПОНЕНЦИАЛЬНОЕ РАСПРЕДЕЛЕНИЕ И ПУАССОНОВСКИЙ

ПРОЦЕСС

1. Экспоненциальное распределение.

Стандартное экспоненциальное распределение определяется

плотностью

е-", х>0,

О, д:<0,

и имеет ф. p. F(x) = 1 — е~х, х>0. Обычно в распределение A)

вводится масштабный параметр и рассматривается ф. p. F(xja)

или F(kx), k = a~l. Параметр а является средним значением рас-

распределения. Важность распределения A) в теории и приложе-

приложениях связана с его характеристическим свойством, называемым

«отсутствием памяти»: если ел. в. X имеет плотность A), то при

х, у>0

: + у\Х>х)=Р(Х>х+у, Х>х)/Р(Х>х) =

Допустим, что X описывает случайное время до наступления

некоторого события. Тогда знание того, что это событие не про-

произошло до момента х, никак не сказывается на его появлении

после момента х: остающееся время ожидания имеет то же самое

экспоненциальное распределение.

36

Отмеченное свойство распределения A) становится более про-

прозрачным, если обратиться к схеме Бернулли. Допустим, что в

моменты времени, кратные некоторому шагу /i>0, совершаются

испытания Бернулли с вероятностью успеха p = Xh. Пусть vi—

номер испытания, при котором произошел первый успех, иХ{А) =

= /ivx— случайное время до появления первого успеха. Так как

q=l—p,

TO

I, B)

где [а] означает целую часть а. Устремим теперь h к нулю. Оче-

Очевидно, правая часть B) будет иметь предел ег*-х, т. е. в рассмат-

рассматриваемом предельном процессе распределение времени ожидания

первого успеха сходится к экспоненциальному (с масштабным

параметром Аг1).

2. Пуассоновский процесс.

С экспоненциальным распределением тесно связан так назы-

называемый пуассоновский процесс. Обратимся к уже использовав-

шейся схеме испытаний Бернулли. Обозначим через V1 + V2+...

...+Vft номер k-то по порядку успеха, &=1, 2 Нетрудно ви-

видеть, что

^К = «х, v, = «„..., vm = пт) =

>«!. V, > Л Vm > Пт)= П Л

Для величин X^h)=hvi — временных интервалов между после-

последовательными успехами — получаем при х\, хц,...,хт>0

9>(X\*>xltXp>x Х»>>хт)-*П«"ХГ/. А-^°. C)

т. е. совместное предельное распределение ел.в. Xj4-i=l,...,m,

соответствует независимым экспоненциально распределенным

ел. в. с масштабным параметром А,. Допустим, что Х\, Х^,...—

последовательность независимых ел. в. с экспоненциальной плот-

плотностью Хе~1х, х>0. Из C) вытекает, таким образом, что при лю-

любых т, хи...,хтк А-э-0

S> (Х}*> < х, Х?) < хт) -»- ^ (Хх < х, Хт < хт). D)

Сходимость многомерных функций распределения D) влечет

за собой сходимость вероятностей любых событий, связанных с

этими величинами:

37

ГJ, A-M). E)

где Bm — борелевское множество ш-мерного пространства Rm.

В частности, для Вт вида

соотношение E) превращается в следующее

ут) +Р (S, < У! 5,„ < ут), А -*0. F)

где

S(*) = X|*)+...+X)*). S/^X^-...-i-Х,, / --=1.2

Отметим на числовой оси точки

S}*>, S<">, ...,S<"> G)

Говорят, чго последовательность случайных точек G) образует

случайный точечный процесс иа прямой. Аналогично получаем

точечный процесс

S., S2.....SJ (8)

Утверждение F) означает, что точечный процесс G) сходится по

распределению к точечному процессу (8), образованному сум-

суммами Sj = X\+ ... +Xj, /=1, 2,..., независимых экспоненциаль-

экспоненциальных ел. в. с параметром X. Процесс (8) называется пуассонов-

ским.

Обозначим через N^x^ и A^@,xj число точек на временном

интервале @, jej в процессах G) и (8), соответственно:

(9)

W(o,х] = fn <=> Sm •< х, Sn,4-i > x.

Событие {Л^}о1>х]=~т) происходит тогда и только тогда, когда в

последовательности из п= [x/h] испытаний Бернулли происходит

ровно т успехов, а его вероятность равна

Устремляя h к нулю, находим

& (#<*>„ - т) - С;," (Х/г)"' A —Щп-" = (п%'1]'П A —ЯЛ)" X

X A —Ц A —М ... A - JIL^-\ A — M)-m -* (b-)"'/m! • <?-'•*. A0)

Принимая во внимание F) и (9), получаем отсюда

&(N@.xi=m)~-!i??- е-'-". (И)

т.

38

Это хорошо известное распределение Пуассона с параметром

Пуассоаовскии процесс был определен как последовательность

(8) моментов появления сточек», или ссобытин», на осн х. Фор-

Формула (9) определяет случайный процесс W@,X], х>0, т. е. функ-

функцию, сопоставляющую каждому х>0 случайную величину Лг@.х>

Процесс W(o,xh х>0, тоже называется пуассоновскнм. В следую-

следующей лемме отражены важнейшие свойства процесса N{OlX]. Поло-

Положим при х<у

Лемма 1. Пусть xo = O<Xi<х2< ... <хк. Тогда ел. e.N(Xil .*,] .

( = 1,2 k, независимы и

Г(NlXi._vXi] =m)=

Доказательство. Как и при выводе A1), используем предель-

предельный переход от схемы Бернулли. Положим

— ДГ(А) _

Тогда

х

A3)

Устремляя h к нулю, получаем с учетом E), что правая часть

A3) стремится к

Smx+...+mk<xk, S,,ll+...-f,nft+i yxk) = Si(N(x. vx.) —mlt i^ 1, ... k).

A4)

С другой стороны, поскольку величины A'jJ1 x j , как числа ус-

успехов на непересекающихся отрезках испытаний Бернулли, неза-

независимы, то левая часть A3) равна

(-1

Переходя к пределу при Л-»-0, найдем, что левая часть A3) стре-

стремится к

1,

П(Х(Х/-АУ_1))ОТ' с-Х(*,-*,._,) A5)

т,!

Приравнивая A4) и A5), получаем требуемый результат.

39

3. Условное распределение точек пуассоновского процесса.

Следующие утверждения о пуассоновском процессе и о неза-

независимых экспоненциально распределенных ел. в. имеют важное

теоретическое и прикладное значение:»

Лемма 2. Пусть Xt, X2,... — независимые экспоненциально

распределенные с параметром А. ел. в., Sn = Xi+ ... +Хп, л =

= 1. 2. ..., Л'<о,*) — построенный по последовательности Sn nyac-

соновский процесс. Тогда

(I) плотность распределения ел. в. Sn равна

Le-ut .v>0,

0 x<0;

(II) условная совместная плотность ел. в. Si Sn при усло-

условии ел. в. Sn+i равна

fs,.. ,sn\sM(yi У„\Уп+\)=-?—, 0<у1<...<уп<уп+1,

и равна нулю для остальных значений переменных;

(III) совместная плотность ел. в. Z(I)=S//Sn+i, i—1, 2, .... п,

раёна

и равна нулю для остальных значений переменных;

(IV) при условии события Nl0,X]=n совместная плотность рас-

распределения ел. в. St, i—l, 2,...,n, (моментов появления точек в

пуассоновском процессе) равна

^ . . .<У„<Х,

и равна нулю при остальных значениях переменных.

Замечание. Если Uu U2,...,Un — независимые и равно-

равномерно распределенные на [0, 1] ел.в., U{i), t=l,.. .,n, — порядко-

порядковые статистики, то, очевидно, все п! перестановок t//,<f/f,< ... <

<1/,'л являются равновероятными событиями и поэтому

A6)

Выбирая Bt= (ut, щ + 6) при 0<«i<...<«„ и достаточно малом

б>0, получаем, что A6) будет равно п!бп, т. е. совместная плот-

плотность величин ?/«) равна

40

Следовательно, результаты (II) и (IV) означают, что услов-

условные плотности

fa sn\sn*i И fa ^"(О,*]

совпадают с плотностями порядковых статистик из равномерного

распределения на [0, Sn+\] и [0, *] соответственно. ¦

Доказательство. (I) Из формул (9) и A1) и того факта, что

из события 5„+1^х вытекает Sn<*, получаем

т. е.

^e-4 A7)

Последовательно используя A7) при л=1, 2,... и принимая во

внимание, что S\ = XU имеем для ф. р. ел. в. Sn:

A8)

Дифференцируя A8) по х и производя сокращения, находим

плотность распределения ел. в. 5„:

(II) Пусть 0<у1<у2<... <уп+\. Выберем 5>0 таким, что

У\+Ь>у2, Уг+&<Уз yn+b>yn+i. Тогда с учетом леммы 1

получим

F(yi<Sl < у, + S, yt<St <yt + 6 yn+x <Sn+i < yn+x + S) =

П e'^i+i-*!-** = (Лб^+^^е"^*». B0)

Поделив выражение B0) на 5n+1 и устремив 5 к нулю, получим

/s. sn+1 (i/i yn+i) = *.n+le-ky"+i, 0<yt<. ..<yn+l. B1)

Поскольку с вероятностью единица 0<5i<... <5n+i, то для

значений ух уп+и не входящих в B1), совместная плотность

равна нулю. Поделив плотность B1) на выражение для fsM (*л-м),

"виденное в (I), получаем требуемый результат.

(Ш) При 0<^1<х2<... <хп<1 и 5>0 таком, что

i+i, i = l,...,я — 1, имеем

41

V

B2)

где интегрирование ведется по (л+1)-мерному множеству

В» = {{уи ¦ ¦ -,Уп+\) ¦ Xi<yi/yn+i<Xi + 6, i=l л).

Подставляя B1) в B2), легко видеть, что интеграл B2) сводится

к повторному

J

= 5» j

о

- 5"n!. B3)

где мы использовали, что интеграл от плотности /s(l+1 (</)--

Xe~Xyynjn\ равен 1. Из B2) и B3) вытекает, что совместная плот-

плотность S,7S,,+i. /=1, ..., п, на множестве 0<.vi< ... <.v,,<l посто-

постоянна и равна л!. Очевидно, она равна нулю для остальных значе-

значений переменных.

(IV) Это утверждение доказывается аналогично (II).

Из утверждения (III) леммы 2 вытекает следующий критерий

проверки гипотезы об экспоиенциальиости случайной выборки.

Допустим, наблюдаются результаты п независимых испытаний

хи хч,...,хп и имеется предположение, что соответствующие ел.в.

Хи Xi,...,Xn независимы и имеют одну и ту же экспоненциаль-

экспоненциальную плотность Хе~кх, х>0 с неизвестным ?.. Если предположение

верно, то значения

n~L B4)

можно рассматривать, в соответствии с замечанием к лемме 2,

как порядковые статистики для независимой выборки из равно-

равномерного на [0, 1] распределения. Отсюда возникает возможность

применить различные способы проверки согласованности наблю-

наблюдений с заданной (известной) теоретической ф. р.

4. Пример.

Следующие данные представляют собой количество летных

часов между последовательными отказами установки для конди-

кондиционирования воздуха на самолете типа «Боинг-720» [4]:

42

23

246

71

261

21

И

37

12

14

7

20

11

120

5

16

14

12

90

62

120

1

47

11

16

225

52

71

14

95

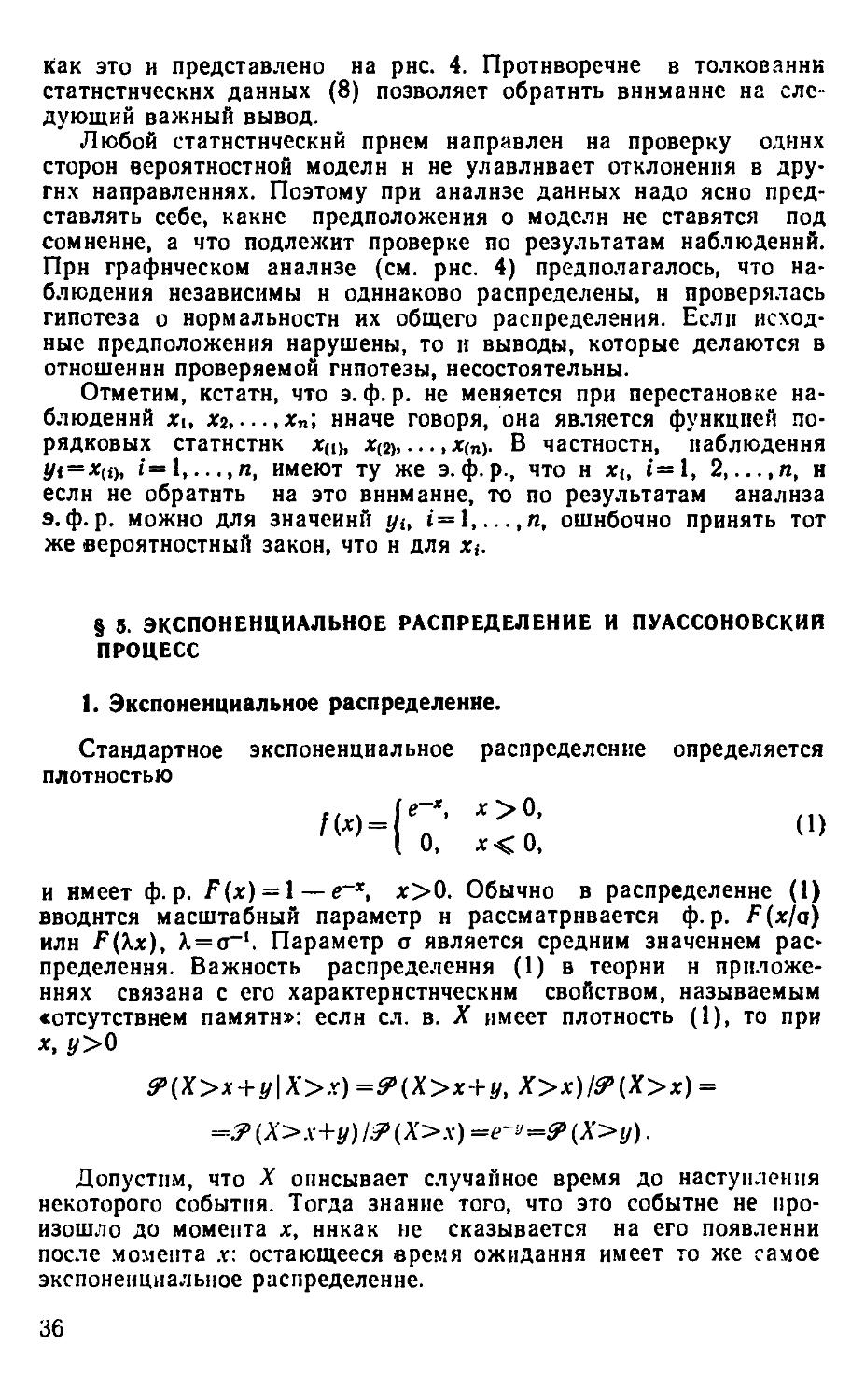

Считая промежутки между отказами независимыми, проверим

предположение об экспоненциальном законе распределения этих

промежутков с помощью графического приема, описанного в

предыдущем параграфе (вероятностная бумага). На рис. 6 от-

отмечены точки (л-,.„ -ln(I-(/-0,5)/n)); i = l, 2, ..., п; /j=30.

as

zss

0,9

а*

ал

0,6

0,"

о,г

1 1 1 1

-

Ш\ ! 1 1

11111 'v:' ¦ ¦-

^т • —

i t I I i I i | | I \~

?C 60 '00 '*0 180 220 210

0.2 0,3 a* 0,5 0,6 0,7 0,8 0,9 1

Pnc. 6. Точкч (лГ(о, —InA —(i—0,5)/ Pile 7. Эмпирическая функция рас-

,«)) и прилегающая прямая для от- предслення для точек s,/Sn, s,=xu)+

кизов установки для кондпшюниро- — ...+хг. А"/ — времена между отка-

иапия воздуха зя.ми установки кондиционирования

воздуха

Прямая х=оу\ о=59,1 проведена на глаз, и согласие с экспо-

экспоненциальным распределением можно считать удовлетворитель-

удовлетворительным. Эмпирическое среднее, равно

x =

1=1

так что графическая оценка о параметра масштаба о близка к

iщенке этого параметра с помощью выборочного среднего. Откло-

Отклонение по вертикали выборочных точек от прямой достигает наи-

наибольшего значения около 0,21 для x,|f) = 23 (см. рис. 6 и учтите

неравномерность масштаба по вертикали).

Хотелось бы использовать статистику Колмогорова:

чтобы оценить значимость наблюдаемого отклонения э. ф. р. от

теоретической ф. р. Однако этому мешает то обстоятельство, что

теоретическая ф.p. F(x/o)=l—e~x° содержит неизвестный п-ара-

метр о. Можно применить критерий Колмогорова к данной зада-

задаче, используя лемму 2. Вычислим значения s, = Vx/. где х, —