Текст

МОСКОВСКИЙ ГОСУДАРСТВЕННЫЙ УНИВЕРСИТЕТ

имени М.В. ЛОМОНОСОВА

Механике- математический факультет

Кафедра вычислительной математики

К.Ю. Богачев

Практикум на ЭВМ.

Методы решения линейных систем и

нахождения собственных значений

Москва 1998 год

СОДЕРЖАНИЕ

2

Содержание

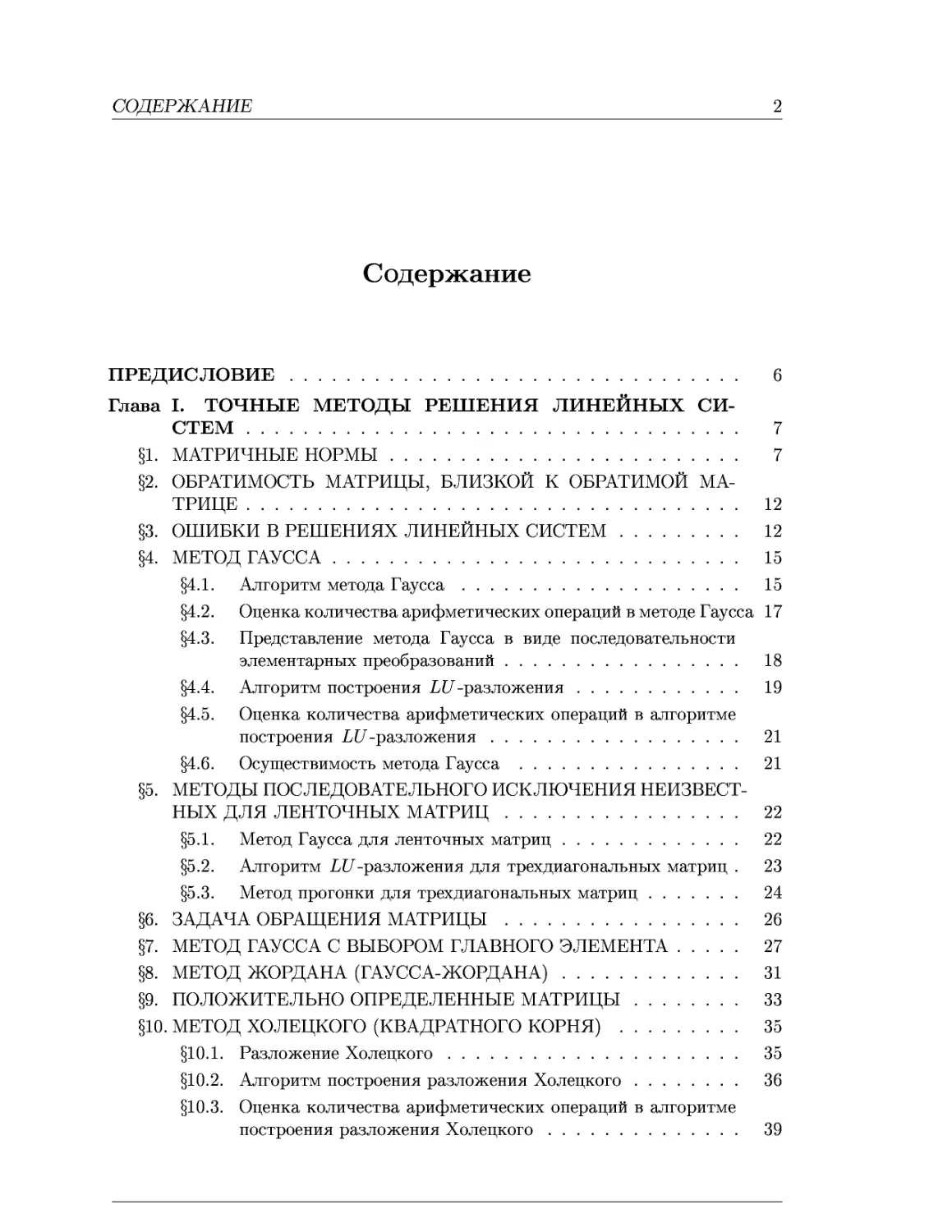

ПРЕДИСЛОВИЕ.............................................. 6

Глава I. ТОЧНЫЕ МЕТОДЫ РЕШЕНИЯ ЛИНЕЙНЫХ СИ-

СТЕМ .............................................. 7

§1 . МАТРИЧНЫЕ НОРМЫ.................................. 7

§2 . ОБРАТИМОСТЬ МАТРИЦЫ, БЛИЗКОЙ К ОБРАТИМОЙ МА-

ТРИЦЕ ............................................ 12

§3 . ОШИБКИ В РЕШЕНИЯХ ЛИНЕЙНЫХ СИСТЕМ............... 12

§4 . МЕТОД ГАУССА.................................... 15

§4.1 . Алгоритм метода Гаусса..................... 15

§4.2 . Оценка количества арифметических операций в методе Гаусса 17

§4.3 . Представление метода Гаусса в виде последовательности

элементарных преобразований..................... 18

§4.4 . Алгоритм построения LU-разложения.......... 19

§4.5 . Оценка количества арифметических операций в алгоритме

построения LU-разложения..................... 21

§4.6 . Осуществимость метода Гаусса .............. 21

§5 . МЕТОДЫ ПОСЛЕДОВАТЕЛЬНОГО ИСКЛЮЧЕНИЯ НЕИЗВЕСТ-

НЫХ ДЛЯ ЛЕНТОЧНЫХ МАТРИЦ........................... 22

§5.1 . Метод Гаусса для ленточных матриц.......... 22

§5.2 . Алгоритм LU-разложения для трехдиагональных матриц . 23

§5.3 . Метод прогонки для трехдиагональных матриц. 24

§6 . ЗАДАЧА ОБРАЩЕНИЯ МАТРИЦЫ ....................... 26

§7 . МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО ЭЛЕМЕНТА...... 27

§8 . МЕТОД ЖОРДАНА (ГАУССА-ЖОРДАНА).................. 31

§9 . ПОЛОЖИТЕЛЬНО ОПРЕДЕЛЕННЫЕ МАТРИЦЫ............... 33

§10 . МЕТОД ХОЛЕЦКОГО (КВАДРАТНОГО КОРНЯ) ........... 35

§10.1 . Разложение Холецкого...................... 35

§10.2 . Алгоритм построения разложения Холецкого.. 36

§10.3 . Оценка количества арифметических операций в алгоритме

построения разложения Холецкого................. 39

СОДЕРЖАНИЕ

3

§11 . МЕТОД ОРТОГОНАЛИЗАЦИИ.............................. 39

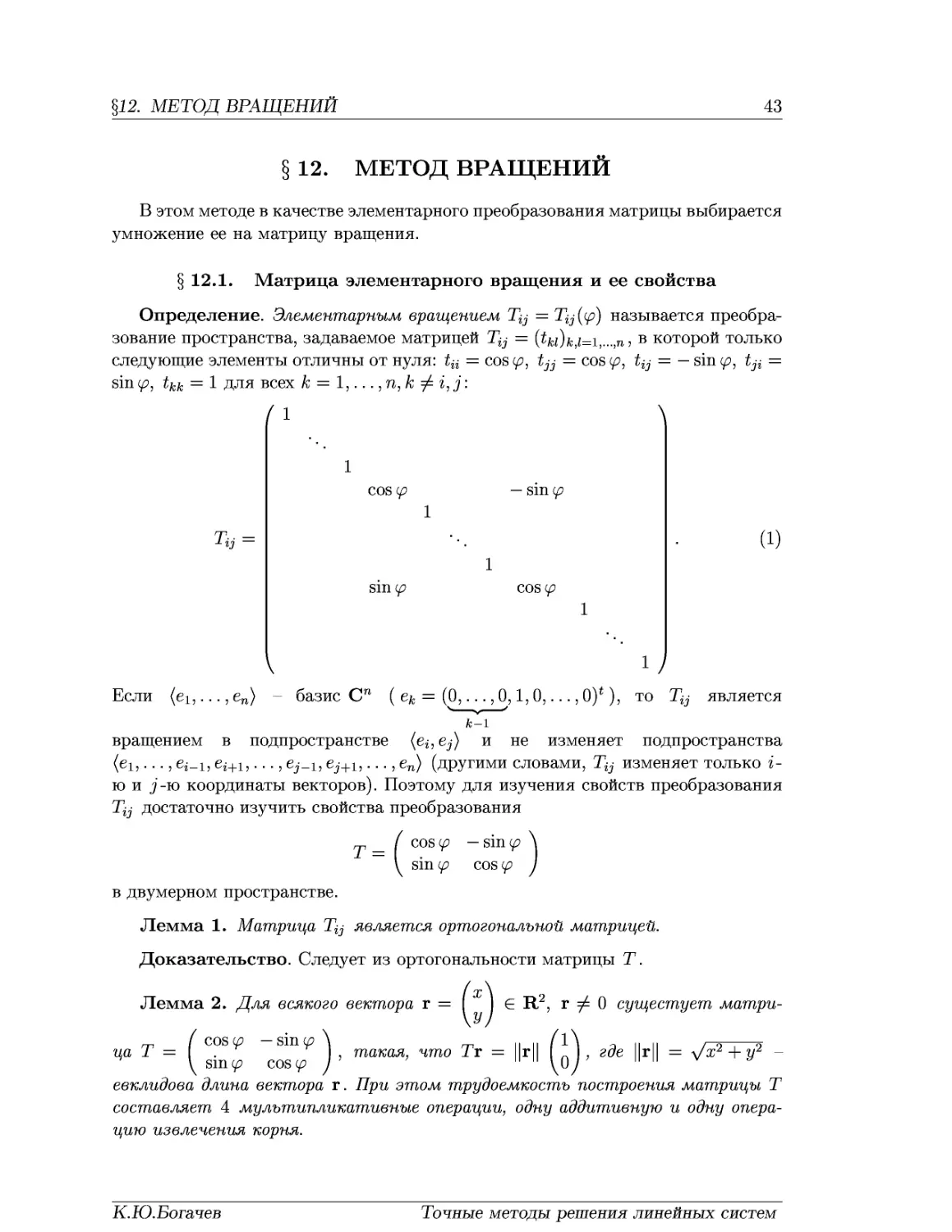

§12 . МЕТОД ВРАЩЕНИЙ..................................... 43

§12.1 . Матрица элементарного вращения и ее свойства . 43

§12.2 . Алгоритм метода вращений ..................... 46

§12.3 . Оценка количества арифметических операций в методе вра-

щений ............................................ 48

§12.4 . Построение <2й-разложения методом вращений.... 50

§12.5 . Оценка количества арифметических операций в алгоритме

построения QR-разложения методом вращений......... 51

§13 . МЕТОД ОТРАЖЕНИЙ.................................... 52

§13.1 . Матрица отражения и ее свойства............... 53

§13.2 . Алгоритм метода отражений..................... 55

§13.3 . Оценка количества арифметических операций в методе от-

ражений .......................................... 58

§13.4 . Построение <2й-разложения методом отражений... 59

§13.5 . Оценка количества арифметических операций в алгоритме

построения QR-разложения методом отражений........ 61

§14 . ПРИВЕДЕНИЕ МАТРИЦЫ К ПОЧТИ ТРЕУГОЛЬНОМУ ВИДУ

УНИТАРНЫМ ПОДОБИЕМ МЕТОДОМ ВРАЩЕНИЙ................... 62

§14.1 . Случай произвольной матрицы .................. 62

§14.2 . Случай симметричной матрицы................... 67

§15 . ПРИВЕДЕНИЕ МАТРИЦЫ К ПОЧТИ ТРЕУГОЛЬНОМУ ВИДУ

УНИТАРНЫМ ПОДОБИЕМ МЕТОДОМ ОТРАЖЕНИЙ.................. 71

§15.1 . Случай произвольной матрицы .................. 71

§15.2 . Случай самосопряженной матрицы................ 75

Глава II. МЕТОДЫ НАХОЖДЕНИЯ СОБСТВЕННЫХ ЗНАЧЕ-

НИЙ .................................................. 79

§1 . ТОЧНЫЕ И ИТЕРАЦИОННЫЕ МЕТОДЫ........................ 79

§2 . ЛОКАЛИЗАЦИЯ СОБСТВЕННЫХ ЗНАЧЕНИЙ.................... 80

§3 . ОШИБКИ ПРИ НАХОЖДЕНИИ СОБСТВЕННЫХ ЗНАЧЕНИЙ . 82

§4 . СТЕПЕННОЙ МЕТОД..................................... 83

§4.1 . Описание алгоритма............................ 83

§4.2 . Оценка количества арифметических операций на один шаг

алгоритма....................................... 85

§5 . МЕТОД ВРАЩЕНИЙ ЯКОБИ................................ 85

§5.1 . Описание алгоритма............................ 85

§5.2 . Выбор угла вращения........................... 87

§5.3 . Стратегии выбора обнуляемого элемента......... 89

СОДЕРЖАНИЕ

4

§5.3.1 . Метод вращений с выбором максимального элемента 90

§5.3.2 . Метод вращений с циклическим выбором обнуляе-

мого элемента....................................... 91

§5.3.3 . Метод вращений с выбором оптимального элемента 92

§6 . МЕТОД БИСЕКЦИИ............................................ 93

§6.1 . Алгоритм вычисления к-го по величине собственного зна-

чения методом бисекции..................................... 94

§6.2 . Алгоритм вычисления всех собственных значений на задан-

ном интервале методом бисекции............................. 94

§6.2.1 . Рекурсивный алгоритм........................ 94

§6.2.2 . Алгоритм последовательного поиска собственных

значений............................................ 95

§6.3 . Алгоритм вычисления всех собственных значений методом

бисекции .................................................. 95

§6.4 . Вычисление числа перемен знака в последовательности

главных миноров............................................ 95

§6.4.1 . Вычисление числа перемен знака в последователь-

ности главных миноров с помощью LU-разложения 96

§6.4.2 . Вычисление числа перемен знака в последователь-

ности главных миноров с помощью реккурентных

формул.............................................. 96

§7 . LR АЛГОРИТМ............................................... 98

§7.1 . LR-разложение, используемое в LR алгоритме.......... 98

§7.1.1 . Алгоритм построения Ай-разложения для произ-

вольной матрицы..................................... 98

§7.1.2 . Алгоритм построения Ай-разложения для почти

треугольной матрицы......................... 100

§7.1.3 . Алгоритм построения Тй-разложения для трех-

диагональной матрицы............................... 101

§7.2 . LR алгоритм нахождения собственных значений.........101

§7.2.1 . LR алгоритм нахождения собственных значений

для почти треугольной матрицы ...............102

§7.2.2 . LR алгоритм нахождения собственных значений

для трехдиагональной матрицы.................103

§7.3 . Ускорение сходимости алгоритма..................... 104

§7.3.1 . Исчерпывание матрицы....................... 105

§7.3.2 . Сдвиги..................................... 106

§7.3.3 . Практическая организация вычислений в LR ал-

горитме ........................................... 106

СОДЕРЖАНИЕ

5

§8 . МЕТОД ХОЛЕЦКОГО...................................... 107

§8.1 . Разложение Холецкого, используемое в методе Холецкого . 107

§8.1.1 . Алгоритм построения разложения Холецкого для

произвольной самосопряженной матрицы............107

§8.1.2 . Алгоритм построения разложения Холецкого для

трехдиагональной матрицы ....................... 109

§8.2 . Метод Холецкого нахождения собственных значений .... ПО

§8.2.1. Метод Холецкого нахождения собственных значе-

ний для трехдиагональной матрицы.................111

§8.3 . Ускорение сходимости алгоритма................. 112

§8.3.1 . Исчерпывание матрицы................... 112

§8.3.2 . Сдвиги................................. 113

§8.3.3 . Практическая организация вычислений в методе

Холецкого ...................................... 113

§9 . QR АЛГОРИТМ.......................................... 114

§9.1 . Q-R-разложение, используемое в QR алгоритме ....114

§9.1.1 . Алгоритм построения QR-разложения для произ-

вольной матрицы.......................... 114

§9.1.2 . Алгоритм построения QR-разложения для почти

треугольной матрицы............................. 114

§9.1.3 . Алгоритм построения QR-разложения для трех-

диагональной матрицы............................ 120

§9.2 . QR алгоритм нахождения собственных значений.....124

§9.2.1 . QR алгоритм нахождения собственных значений

для почти треугольной матрицы ...................125

§9.2.2 . QR алгоритм нахождения собственных значений

для самосопряженной трехдиагональной матрицы 126

§9.3 . Ускорение сходимости алгоритма................. 129

§9.3.1 . Исчерпывание матрицы................... 129

§9.3.2 . Сдвиги................................. 129

§9.3.3 . Практическая организация вычислений в QR ал-

горитме ........................................ 130

§10 . МЕТОД ОБРАТНОЙ ИТЕРАЦИИ НАХОЖДЕНИЯ СОБСТВЕН-

НЫХ ВЕКТОРОВ.............................................. 130

ПРОГРАММА КУРСА.............................................. 133

ЛИТЕРАТУРА................................................... 137

6

ПРЕДИСЛОВИЕ

Настоящее пособие содержит описания алгоритмов, предлагаемых к реализа-

ции на ЭВМ студентам механико-математического факультета МГУ на занятиях

по ” Практикуму на ЭВМ”. Для всех алгоритмов приводится необходимое теоре-

тическое обоснование, соответствующие расчетные соотношения и рекомендации

по их практическому осуществлению на ЭВМ (организация процесса вычисле-

ний, хранения данных и результатов в памяти ЭВМ и т.п.).

Многообразие алгоритмов объясняется, с одной стороны, необходимостью

обеспечить преподавателей достаточным набором задач для проведения заня-

тий, а с другой стороны, желанием продемонстрировать различные подходы к

решению задачи решения линейных систем и нахождения собственных значе-

ний матриц. Алгоритмы требуют разных вычислительных затрат, имеют разную

чувствительность к погрешностям во входных данных, их свойства по-разному

зависят от числа обусловленности матрицы. ’’Самого лучшего” метода решения

поставленной задачи не существует, и выбор алгоритма зависит от конкретной

задачи. Этот выбор будет различным, например, для симметричных и несимме-

тричных матриц, для трехдиагональных и заполненных матриц, и т.д.

Подбор алгоритмов для Практикума диктовался, в основном, возможностью

реализации их студентами при существующих ресурсах времени на ЭВМ, что

привело к отказу от рассмотрения усложненных подходов. Часть описанных ал-

горитмов вытеснена из широкой вычислительной практики более эффективными

(и более сложными) алгоритмами, рассмотреть которые в курсе ’’Практикум на

ЭВМ” не представляется возможным. Тем не менее, эти алгоритмы представля-

ют интерес для решения определенного круга задач и включены в пособие.

Форма отчетности студентов по Практикуму призвана стимулировать как

развитие практических навыков решения математических задач с помощью ком-

пьютера, так и создание определенного кругозора в области существующих ме-

тодов решения поставленной задачи. Поэтому в рамках Практикума студентам

предлагается как разработать программу на ЭВМ, реализующую заданный алго-

ритм, так и письменно ответить хотя бы на половину вопросов из предложенного

варианта, составленного из вопросов, приведенных в конце пособия.

В основе настоящего пособия лежат материалы лекций, читавшихся авто-

ром в течении 4-х лет в рамках факультативного курса ” Практикум на ЭВМ”.

В электронном варианте оно уже более 5-ти лет используется при проведении

занятий со студентами в дисплейном классе.

Предложения, замечания и отмеченные опечатки просьба сообщать автору

на кафедру вычислительной математики.

7

Глава I.

ТОЧНЫЕ МЕТОДЫ РЕШЕНИЯ ЛИНЕЙНЫХ

СИСТЕМ

§ 1. МАТРИЧНЫЕ НОРМЫ

Обозначим через М.п пространство (кольцо) матриц размера п х п над полем

С.

Определение. Нормой на кольце Мп называется неотрицательный функ-

ционал || • || : Мп —> R?j. , удовлетворяющий следующим условиям для всех

А, В е М„ :

1) || А || = 0 & А = О,

2) || ХА || = |А| || А || для всех А е С,

3) || А + В || < || А || + || В ||,

4) || АВ || < || А || || В ||.

Простейшие свойства нормы:

1) || 7 || > 1 (где I означает единичную матрицу).

Действительно, ||1|| = \\1 • 1\\ < ||1|| ||1|| = ||1||2 .

2) И-1!! > рщ и, в частности, ЦА-1)! ||А|| > 1.

Доказательство: ||1|| = ||АА~11| < ||А|| ||А-1|| .

Поскольку М.п можно рассматривать как векторное пространство размер-

ности п , то на нем можно вести векторные нормы, некоторые из которых ока-

зываются матричными. Для таких норм в проверке нуждается только свойство

4) (поскольку первые три свойства составляют определение векторной нормы).

/ \ V2

/ п \

Пример. ||А||е = ||(ay)z,j=i,...,n||E = I Е \aij|2 I является матричной нор-

\м=1 /

мой. Проверим свойство 4):

\\АВ\\2Е = Е IЕ ^^|2 < Е (Е brt ( Е м2>) =

i,j=l к=1 ^^=1 / \m=l /

п п

( Е Ы2)( Е М2) = 1|А|Ы№-

i,k=l j,m=l

К.Ю.Богачев

Точные методы решения линейных систем

§1. МАТРИЧНЫЕ НОРМЫ

8

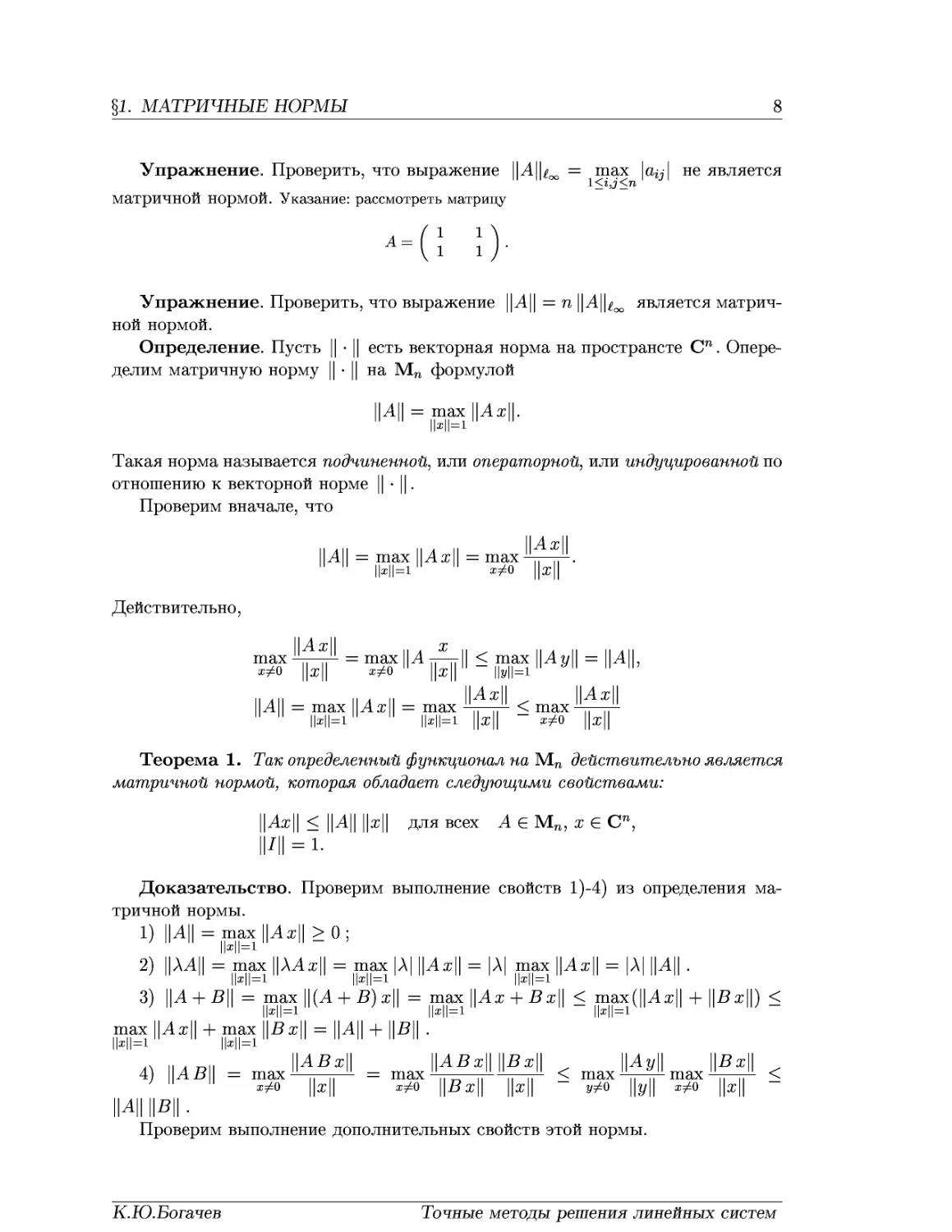

Упражнение. Проверить, что выражение IIAIL = max |cij,l не является

l<Z,J<n

матричной нормой. Указание: рассмотреть матрицу

1 1

1 1

Упражнение. Проверить, что выражение ||А|| = тг, ||АН.^ является матрич-

ной нормой.

Определение. Пусть || • || есть векторная норма на пространств С". Опере-

делим матричную норму || • || на Мп формулой

||А|| = max ||Ах||.

Такая норма называется подчиненной, или операторной, или индуцированной по

отношению к векторной норме 11 • 11.

Проверим вначале, что

max IIAxll = max ,, ,, .

|H|=i" ||х||

Действительно,

max Д = max || А тт^ттЦ < max ||Ау\\ = ||А||,

||х|| 11 ||Д|" - IMhi" ..................

||А|| = max ||Ах|| = max

а#0 ||х||

Теорема 1. Так определенный функционал на Мп действительно является

матричной нормой, которая обладает следующими свойствами:

||Ах|| < ||А|| ||х|| для всех А е Mn, х е С",

1И1 = !

Доказательство. Проверим выполнение свойств 1)-4) из определения ма-

тричной нормы. 2

= max IIAxll > 0 ;

|H|=i" 11 -

2) ||АА|| = max ||ААх|| = max |А| ||Ах|| = |А| max ||Ах|| = |А| ||А|| .

3) И + В\\ = max||(A + B)z|| = max ||Az + В х\\ < max(||Az|| + \\В х\\) <

max ||А Д| + max ||Bz|| = ||A|| + ||B|| .

||ж||=1 ||ж||=1

4) ||AB|| = max

7 " " Ill'll

И1 |R.

max

цвд| ||z||

IIAt/II \\B x

max ,, ,, max ,, ,,

2/^0 \\y\\ x^O ||x||

Проверим выполнение дополнительных свойств этой нормы.

К. Ю. Богачев

Точные методы решения линейных систем

§1. МАТРИЧНЫЕ НОРМЫ

9

IIAII = max —п— . Следовательно, для всех х Е Сп —гг- < МН , т.е.

||Д| ||z|| -

||Ах||<||А|||И.

Illll = max lllxll = max |Ы| = 1 .

IHI=i" IHI=i

Определение. Максимальной столбцовой нормой называется

п

max 52 \aij\.

Лемма 1. Норма ЦЛ.Ц1 подчинена векторной норме ||a?||i = Ё |^г|

i=l

Доказательство. Надо проверить, что max = max IIT^IIi . Запи-

шем матрицу через ее столбцы: А = [ai,..., ап\ , где aj = (aij,..., ап^ . Тогда

||Л||1 = max ||а, ||1 . С другой стороны, для х = (a?i,... ,хп¥ Е Сп

1<7<71

п п п

IH^Ik = II Е < Е Ы ||«J111 < Е ы max ||а*||1 = ||z||i ||A||i.

j=l i=l j=l k=l,...,n

||Ax||i

Следовательно, max ||Tx||i = max n— < ЦЛЦ1 .

Iklli=i" " ||z||i - 11 11

Если максимум max ||aj||i = M||i достигается при i = i0, то, выбрав x

l<i<n

равным ei0 - стандартному координатному орту, получаем

max ||Az||i > ПЛеадПх = ||aio|| = ||A||i.

IHIi=i

п

Отсюда вытекает требуемое равенство max 22 \аа\ = max IIЛх|h .

Определение. Максимальной строчной нормой называется

п

IIЛМ = max 521^-1.

1<1<п . '

— J=1

Лемма 2. Норма МПоо подчинена векторной норме Н^Ноо = max |a?j| .

i=l,...,n

Задача. Доказать самостоятельно.

Доказательство. Имеем для всех х Е Сп :

IH^Iloo = max 152%^! < max 52 |«иI \xj\ < max 52 l«ul Halloo = MHoo 1И|оо-

Ki<n 1<г<п ЕЕ 1<1<пЕЕ

J=1 J=1 J=1

Следовательно, max M^lloo < Mll<x>

|H|oo=l

К.Ю. Богачев

Точные методы решения линейных систем

§1. МАТРИЧНЫЕ НОРМЫ

10

Пусть максимум max 22 l^zy'l = ШНоо достигается при i = i0 : IIАЦ^ =

П

22 |oj0j| . Рассмотрим вектор у = (у±,..., уп)* с компонентами

1=1

aipj

I aipj I

1,

если a,ioj ф 0,

если aioj = 0.

Тогда Цг/Hoo = 1, yjaioj = \aioj\, j = 1,...,п. Поэтому

max ЦАжЦоо > ЦАт/Цоо = max | £ >

||ж||оо=1 1<1<П j=l

I 52 aiojlJj\ = I 52 |аг01 11 = 52 |аг01 I = Halloo,

1=1 1=1 1=1

т.е. max ЦАхЦоо > ЦАЦоо . С учетом доказанного выше это означает требуемое

|И|оо=1

равенство max ЦАхЦоо = ЦАЦоо .

!И|оо = 1

Определение. Спектральной нормой называется

|| А||2 = тах{\/А : А собственное значение матрицы А*А}.

(здесь А* означает матрицу, сопряженную к матрице А : А* = (А)* в комплекс-

ном случае и транспонированную матрицу А* в вещественном случае). Отметим,

что это определение корректно, т.е. указанные квадратные корни всегда суще-

ствуют. Действительно, для всякого собственного значения А матрицы А*А и

соответствующего ему собственного вектора х из равенства А*Ах = Хх выте-

||Ах||2

кает (А*Ах,х) = Х(х,х) , откуда А = —।—п— , и потому А е R, А > 0 (здесь

1И|2

(•, •) означает евклидово скалярное произведение в С" ).

Лемма 3. Норма ||А||2 подчинена евклидовой векторной норме ||х||2 =

(S Ы2)1/2

i=l

Доказательство. Рассмотрим

max ||Ах||2= max (Ах, Ах)1/>2 = max (А* Ах, х )1/12.

|И|2=1" |И|2 = Р |И|2=Р

Обозначим В = А*А. Матрица В самосопряжена (симметрична в вещественном

случае) : В* = (А*А)* = А*(А*)* = А*А = В. Как показывается в курсе ли-

нейной алгебры для матрицы В существует такая унитарная (ортогональная в

вещественном случае) матрица U , что В = U*AU , где А = diag (А1;..., Ап), Xj

- собственные значения матрицы В = А*А. Поэтому

max ||Ах||2 = max ( U*AUx, х W2 = max (AUх, Ux W2.

1И|2 = 1" "2 1И|2 = Р ’ ’ |И|2 = Р ’ ’

К.Ю.Богачев

Точные методы решения линейных систем

§1. МАТРИЧНЫЕ НОРМЫ

11

Поскольку матрица U~l = U* является унитарной (ортогональной в веществен-

ном случае) и не изменяет евклидовой длины векторов : ||[7-1х||2 = ||а?||2 для

всех х, то (заменяя в последнем неравенстве у = U х )

п

max ||Лх||2 = max (Ay,у)1'2 = max(Л у, у)1'2 = тах(^Л7-|?//)1/2.

1И|2=1 |Щ-12/||2=1 ||z/||2 = l ||г/||2=1 ,=г

Пусть А;о - максимальное из Aj . Тогда

С другой стороны, если eJ0 есть jg-й координатный орт, то

п п

max ||Лх||2 = max (jjAj |?//)1/2 > (Е Xj км/)'72 = /Ч = Mlb-

||ж||2=1 ||г/||2=г • , • , v

Из последних двух соотношений вытекает требуемое равенство

max ||Лх||2 = ||Л||2.

|И|2 = 1

Определение. Спектральным радиусом матрицы А называется

р(А) = тах{ |А| : А — собственное значение матрицы А }.

Лемма 4. Для всякой матрицы А Е Мп и всякой матричной нормы на Мп

справедливо неравенство р(А) < ||Л|| .

Доказательство. Пусть А - максимальное по модулю собственное значение

матрицы А , т.е. |А| = р(А) , х - соответствующий собственный вектор, т.е. Ах =

А х . Рассмотрим матрицу X Е Мп , все столбцы которой равны собственному

вектору х . Тогда АХ = XX . Для всякой матричной нормы ||-|| имеем |А| ||Х|| =

||АX|| = ||ЛX|| < ||Л|| ||Х|| , следовательно, |А| = р(Л) < ||Л|| .

Замечание 1. Если Л = Л* , то р(Л) = ||Л||2 . Это следует непосредственно

из определения спектральной нормы и того, что собственные значения матрицы

А* А = Л2 равны квадратам собственных значений матрицы Л .

Определение. Унитарно инвариантной матричной нормой называется ма-

тричная норма ||-|| , удовлетворяющая равенству ||Л|| = ||[7ЛУ|| для всех матриц

Л Е Мп и всех унитарных матриц U, V Е Мп .

Лемма 5. Спектральная норма является унитарно инвариантной.

Доказательство. Пусть Л - произвольная матрица из M.n , U, V - произ-

вольные унитарные матрицы. Собственные значения матрицы

(ИЛУ)* (ИЛУ) = У*Л*П*ПЛУ = V-^U-HJAV = УХЛ*ЛУ

те же, что и у матрицы А*А . Следовательно, спектральные нормы матриц UAV

и Л совпадают.

К. Ю. Богачев

Точные методы решения линейных систем

§2. ОБРАТИМОСТЬ МАТРИЦЫ, БЛИЗКОЙ К ОБРАТИМОЙ МАТРИЦЕ 12

§ 2. ОБРАТИМОСТЬ МАТРИЦЫ, БЛИЗКОЙ К

ОБРАТИМОЙ МАТРИЦЕ

Теорема 1. Пусть || • || - матричная норма на Мп . Если ||А|| < 1 , то

00

матрица I — А обратима, причем (I — А)-1 = £ Ак.

k=Q

оо

Доказательство. Рассмотрим ряд Е Ак. Поскольку для всякого р >

к=0

т+р т+р

О || 22 Afc|| < Е ШН* ~0 при т —> оо , то последовательность частичных

к=т к=т

т

сумм sm = Ак является последовательностью Коши. Так как в силу полноты

к=0

Сп пространство М.п полно по норме || • ||, то определен предел В = lim sm =

т—>оо

оо оо 1

22 Ак , прием в силу непрерывности нормы ||В|| < 22 |Щр = ;-ГГТГГ Име-

fc=o fc=o 1 — ||А||

ем: ВЦ — А) = 22 Ак(1 — А) = 22 Ак — 22 Ак = I . Аналогично проверяем

к=0 к=0 к=1

(I — А)В = I. Следовательно, В = (I — А)-1 .

Теорема 2. Пусть || • || - матричная норма на М.п , А - обратимая матри-

ца. Если В Е Мп, ||В|| < .. .. , то матрица С = А + В обратима, причем

1И ||

С-1 = (А + В)”1 = Е (-Цк (А~х В)к А~б

к=0

Доказательство. Рассмотрим матрицу D = А~ГС = А-ЦА+В) = 1+А~1В .

Так как по условию ||А-1В|| < ||А-1|| ||В|| < 1 , то по предыдущей тео-

оо

реме существует матрица D~Y = Е (~ЦЦА^Вц , обратная к D. Рассмо-

к=0

трим матрицу С = 2?-1А-1 и вычислим С С = 2?-1А-1(А + В) = +

А~1В) = D~YD = I, СС = {A + B)D~lA~l = АА~ЦА + =

A(I + A~1B)D~1A~1 = А А-1 = I. Следовательно, существует С-1 = С =

D~1A~1 = Е (-ЦЦА^В^А-1 .

к=0

§ 3. ОШИБКИ В РЕШЕНИЯХ ЛИНЕЙНЫХ СИСТЕМ

Пусть решается линейная система Ах = b, А Е Mn, b Е Сп . Пусть В- ал-

горитм решения этой системы на идеальной вычислительной системе, так, что

х = 13(А, б) - точное решение системы и потому х = 13(А, 6) - отображение на

классе невырожденных матриц (х = А-1&). Пусть В - тот же алгоритм, реа-

лизованный на реальной вычислительной системе. В результате его проведения

получено приближенное решение х = Й (А, 6) . Определим матрицу А и вектор

Ъ из условия х = В(А,6) (Ь = А-1х), т.е. х является точным решением системы

К. Ю. Богачев

Точные методы решения линейных систем

§3. ОШИБКИ В РЕШЕНИЯХ ЛИНЕЙНЫХ СИСТЕМ

13

Ах = b . Обозначим А = А + Е, b = b + е . Таким образом, точное решение

х удовлетворяет системе А х = b , а приближенное решение х удовлетворяет

системе (Л + Е)х = b + е .

Пусть || • || - произвольная матричная норма, согласованная с векторной нор-

мой || • || . Будем считать, что ошибка, вносимая в матрицу при проведении

алгоритма, не очень велика: ||Е'|| < щ-1ц По теореме 2.2 отсюда следует,

оо

что матрица А + Е обратима и (Л + Б1)-1 = (~1)к (А-1 Е)к А-1 . Вычислим

к=о

погрешность х — х :

х - х = А~1Ь - (Л + Е)~1(Ь + е) = (Л-1 - (Л + Е)~1)Ь - (Л + Е)~1е

= - Е (—1')к(А~1Е')кА~1Ь — Е (-^(А^Е^А^е

к=1 к=0

= - Е (-ly^A^E^x - Е (-ly^A^E^A^e.

к=1 к=0

Следовательно,

II* - *11 < ( Е И-^|р)||х|| + ( Е ||Л-^|р)||Л-1е||,

к=1 к=0

II*-*11 < , 1~ И-М1

11*11 - 1 - ||л-^|| 1 - И-^И 11*11

Так как Ах = b , то ||&|| = ||Лх|| < ||Л|| ||х|| и

1 ИН

7]—7 < -77—7- . ПОЭТОМУ

11*11 " IH

II*" *11

11*11

II*" *11

11*11

Определение. Числом обусловленности матрицы Л по отношению к ма-

тричной норме || • || называется

||Л|| ||Л-11|, если Л невырождена,

оо, если Л вырождена.

к(Л) =

С использованием этого обозначения последнее неравенство можно перепи-

сать в виде

II* - *11 < «(Л) /W ,

11*11 кМ1иНи1 ням'

К. Ю. Богачев

Точные методы решения линейных систем

§3. ОШИБКИ В РЕШЕНИЯХ ЛИНЕЙНЫХ СИСТЕМ

14

Здесь —п—п— называется относительной погрешностью в решении х , 7—77

1Ы| ИН

называется относительной погрешностью в матрице А , 7Ц7 называется от-

IHI

носителъной погрешностью в правой части b .

Часто, чтобы оценить точность полученного приближенного решения х , вы-

числяют вектор невязки г = b — Ах . Оценим относительную погрешность ре-

шения через невязку г.

х — х = А ГЬ — х = А 1(Ь — Ах) = А 1г,

Пример. Рассмотрим линейную систему

л ( 1 -1 \ , ( 1 \

Ах = I. х = о = .. .

1 — е \ 1 /

Ее точное решение

/1 + е-1/2\

( £.-1/2 ) Тогда

/_е-1/2\

I _е-1/2 ) Поэтому

а) относительная

б) относительная

1 \ р <

I . Рассмотрим приближенное решение х

вектор невязки г

величина невязки

величина ошибки

° А ,

ei/2 I > вектор ошибки х — х

-И = O(s^ —> 0 (s —> 0);

= О!--|,2| —> 00 (е —> 0);

х

Атах (А)

Amin (А)

Свойства числа обусловленности

1. к(А) > 1 .

2. «(А) = к(А-1) .

3. к(АВ) < к(А')к,(В') .

Первые три свойства следуют непосредственно из определения числа обусло-

вленности и основных свойств матричных норм.

4. Если А = А*, то по отношению к спектральной норме к (А) =

где Атах (А) и Amjn (А) соответственно максимальное и минимальное по модулю

собственные значения матрицы А.

Доказательство. В силу замечания 1.1 (см. лемму 1.4) для самосопря-

женных матриц ||А||2 = р(А) = |Атах(А)|, ЦА-1^ = /(А-1) = |Атах(А_1)| =

|Ат|„(Л)|. Поэтому к(Л) = ||Л|| ЦА-Ч1 = .

К. Ю. Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

15

Атах (А)

A min (А)

Атах (А)

5. Для всякой матрицы А Е Мп число обусловленности относительно любой

матричной нормы к (А) >

Доказательство вытекает из леммы 1.4: ||А|| > р(А) = |Атах(А)|,

ptA-1) = |Атах(А-1)| = |Amin(A)|; поэтому ДА) = ||А|| ||А-1|| >

6. Для всякой матрицы А Е Мп и любых унитарных (ортогональных^

U, V Е Мп число обусловленности относительно спектральной нормы ДА) =

ДиАУ).

Это свойство непосредственно следует из леммы 1.5.

7. Для всякой невырожденной матрицы А Е М.п

A min (А)

матриц

sup

в Е Мп,

В — вырожденная

Доказательство. Покажем, что для всякой вырожденной матрицы В Е Мп

справедливо неравенство ||А — В\\ > 1/||А-1||. Предположим, что это не так,

т.е. существует вырожденная матрица В, такая, что для матрицы С = А — В

выполнено ||(7|| < 1/||А-1||. Тогда по теореме 2.2 матрица А—С = А—(А—В) =В

обратима, что противоречит вырожденности В. Таким образом, установлено,

что для всякой вырожденной матрицы В ||А-1|| > 1/|| А — В\\. Следовательно,

ДА) = ||А|| ||А-1|| > ЦАЦ/ЦА — В\\ для всякой вырожденной В Е Мп. Поскольку

левая часть этого неравенства не зависит от В, то из него вытекает требуемое

соотношение.

§ 4. МЕТОД ГАУССА

§4.1. Алгоритм метода Гаусса

Пусть требуется решить линейную систему А х = b, А Е Мп :

+ 012^2 + .. + <АтАп — bl

(221^1 + ^22^2 + .. + fyinAn &2 (1)

+ 0/12^2 + .. + ^пп^п Ьп

Метод Гаусса состоит в том, что элементарными преобразованиями над строками

матрицы она приводится к треугольному виду с главной диагональю, состоящей

из единичных элементов (прямой ход метода Гаусса); полученная система с тре-

угольной матрицей решается в явном виде (обратный ход метода Гаусса).

Предположим, что ац ф 0. Поделив первое уравнение системы (1) на ац,

перепишем его в виде

Х1 + С12Х2 + . . . + С1пХп = У!, (2)

К. Ю. Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

16

где cij = aij/ац, j = 2,...,п, у\ = bi/ац. Умножим уравнение (2) на ац и

вычтем его из г-го уравнения системы (1) (г = 2,... , п). В результате система (1)

примет вид

Х1 + С12х2 + . .. + Спхп — У1

(1) а22'х2 + . .. + (1) ^2п хп — Ь? . (з)

(1) аП2х2 + . .. + т иПП~"П = №

где off = ац — cijan, = bi — угац, i,j = 2,...,n. Далее этот процесс

применяется к подматрице = (a^)i;J=2,...,n G Mn_i.

Пусть сделаны к — 1, к = 1,...,п шагов этого процесса, т.е. система (1)

преобразована к виду

Xi 4- с12х2 + .. 4" с1,к-1хк-1 + С,кхк + + Спхп = У1

Х2 + .. 4- С2,к-1Хк-1 + С2,кхк + + ^2пХп = У2

хк — 1 + Ск—1,кхк + + Ск — 1,пХп = Ук-1 (4)

(к-1) ак,к Хк + + (к-1) ак,п Хп — °к

(£-1) °>п,к Хк + + п(к—1) ™ =

Предположим, что а^к ф 0. Поделив к-е уравнение системы (4) на а^кк

перепишем его в виде

Хк 4“ Ск,к+1Тк+1 4“ 4“ Скп^п — Ук? (5)

где

ckj = “fen ’ j = А: + 1,..., п, ук = . (6)

акк акк

Умножим уравнение (5) на а-к и вычтем его из г-го уравнения системы (4)

(i = к + 1,... , п). В результате система (4) примет вид

Xi+c12x2 + ... +с1;к_1хк_1+ с1;кхк + с1;к+1хк+1 +.

Х2 +... +c2,k-iXk-i+ C2jkXk + С2,к+]Хк+\ +.

Хк — 1 4- Ск—1,кХк 4- Ck—l,k+lXk-ll 4“

Xk 4" Ck,k+lXk+l 4"

(fc) ,

ДДк+1хк+1 + .

4- CirAn У1

4" c2nxn = У2

4" Ck—l,nxn — Ук—1

4" Ck,nxn — У к

, (fc) _____ I (fc)

+ ак+1,пХп~ ^k+l

(7)

an,k+ixk+i + + a^nxn =b£>

К.Ю.Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

17

где

aij=aij aik ckj, ЬД = Ь\ -а\к 'ук, г, j = к + 1,... ,п. (8)

Выражения (6), (8) являются формулами перехода от системы (4) к системе (7).

Если обозначить off = ац, = bi, i,j = l,...,n,TO переход от системы (1) к

системе (3) будет осуществляться по тем же формулам при к = 1.

После проведения вычислений по формулам (6), (8) при к = 1,..., п (которые

составляют прямой ход метода Гаусса) система (1) примет вид

х1 + С12х2 + + С1пхп-1 + с1пхп — У1

х2 + . . . + С2пхп-1 + С2пхп = У2

\ \ (9)

хп—1 4“ Сп—1,пхп — Уп—1

хп Уп

Решение системы (9) с треугольной матрицей может быть найдено непо-

средственно (методом последовательного исключения неизвестных в порядке

хп> хп—1> , Xi ).

п

Хп = уп, Xi = yi- СИХА г = п-1,...,1. (10)

j=z+l

Вычисления по формулам (10) составляют обратный ход метода Гаусса.

§4.2. Оценка количества арифметических операций в методе Гаусса

Здесь и далее при оценке количества арифметических операций мы будем

отдельно находить количество аддитивных операций (сложений и вычитаний) и

количество мультипликативных операций (умножений и делений). Для упроще-

ния выкладок мы будем находить только главный член асимптотики количества

операций при п —> оо .

1. На вычисление ckj при j = к + 1,... ,п, к = 1,..., п по формулам (6)

требуется УД=Г (п — к) = 1)/2 = О(п2) (п —> оо) операций деления.

2. На вычисление off при i,j = к + 1,..., п, к = 1,..., п по формулам (8)

требуется УД=Дп — к)2 = 1ДД)1 i2 = (п ~ l)n(2n — 1)/6 = n3/3 + О(п2) (п —> оо)

операций умножения и столько же операций вычитания.

Итак, на вычисление коэффициентов ckj, j = к + 1,..., п, к =

системы (9) требуется О(п2) + п3/3 + О(п2) = п3/3 + О(п2) (п —> оо) мультипли-

кативных операций и столько же аддитивных операций.

3. На вычисление ук при к = 1,..., п по формулам (6) требуется п операций

деления.

4. На вычисление при i = к + 1,... ,п, к = 1,... ,п по формулам (8) тре-

буется УД=Дп — к) = ЕХл)1 = п(п~ 1)/2 = О(п2) (п —> оо) операций умножения

и столько же операций вычитания.

К. Ю. Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

18

Итак, на вычисление правых частей ук, к = 1,...,п системы (9) требу-

ется 0(п2) (п —> оо) мультипликативных операций и столько же аддитивных

операций.

Таким образом, прямой ход метода Гаусса требует п3/3 + О(п2) + О(п2) =

п3/3 + О(п2) (п —> оо) мультипликативных операций и столько же аддитивных

операций.

5. На вычисление решения по формулам (10) (т.е. на проведение обратного

хода метода Гаусса) требуется ^"=/(71—г) = i = n(n—1)/2 = O(n2) (n —> оо)

операций умножения и столько же операций вычитания.

Следовательно, метод Гаусса требует п3/3+О(п2)+О(п2) = п3/3+О(п2) (п —>

оо) мультипликативных операций и столько же аддитивных операций. Всего:

(2/3) п3 + О(п2) (п —> оо) арифметических операций.

§ 4.3. Представление метода Гаусса в виде последовательности

элементарных преобразований

Преобразование системы, задаваемое формулами (6), эквивалентно умноже-

нию матрицы системы слева на матрицу

Dk = diag [ 1,.„,1, , 1,..., 1 ],

к-1

(где diag [ ф,..., dn ] означает диагональную матрицу с элементами ф,..., dn на

главной диагонали).

Преобразование системы, задаваемое формулами (8), эквивалентно умноже-

нию матрицы системы слева на матрицу

/ 1 \

1

(не обозначенные элементы матрицы Lk равны нулю).

Следовательно, прямой ход метода Гаусса эквивалентен умножению матрицы

системы (1) последовательно на матрицы LkDk, к = 1,... ,п :

LnDn •... • LiDi • Ах = LnDn •... • БДД • Ь. (11)

причем матрица U = LnDn •... • БДД • А есть матрица системы (9), т.е. являет-

ся верхней треугольной с единицами на главной диагонали. Обозначим через

LT (п) группу невырожденных верхних треугольных матриц. Тогда для всех

к = 1,..., п Dk, Lk Е LT (п) и потому матрица Б = LnDn ... LiDi Е LT (n).

К. Ю. Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

19

Из (11) получаем: U = LA, откуда А = LU , где L = L~Y Е LT (n), U верх-

няя треугольная с единицами на главной диагонали. Полученное представление

матрицы А называется LU -разложением. Итак, показано, что метод Гаусса

эквивалентен построению LU-разложения.

Знание LU-разложения матрицы А может быть полезно, например, в сле-

дующей ситуации. Пусть требуется решить ряд систем вида Ахт = Ьт, т =

1,... ,М с одной и той же матрицей А и разными правыми частями Ьт. Приме-

няя М раз метод Гаусса это можно сделать за (2/3) М п3 + О(М п2) (п —> оо)

арифметических операций. Предположим, что нам известно LU-разложение ма-

трицы А : А = LU . Тогда решение каждой из систем Ахт = Ьт может быть

сведено к решению двух систем Lym = bm, Uxm = ут с треугольными матрица-

ми. Решение системы с треугольной матрицей осуществляется обратным ходом

метода Гаусса за О(п2) (п —> оо) арифметических операций. Следовательно, если

LU-разложение матрицы А уже построено и на это построение потребовалось

d(n) арифметических операций, то решение М систем с той же матрицей А по-

требует d(n) + О (Мп2) (п —> оо) арифметических операций. Подчеркнем, что

число d(n) не зависит от М. Сейчас мы построим алгоритм для получения LU-

разложения и покажем, что d(n) = (2/3)п3 + О(п2) (п —> оо) (т.е. равно числу

операций, необходимых для проведения метода Гаусса).

§ 4.4. Алгоритм построения LU-разложения

Пусть требуется найти нижнюю треугольную матрицу L = и верхнюю

треугольную матрицу U = (ujj) с единицами на главной диагонали такую, что

А = LU, т.е.

п

) lij Ujk Uik, Ъ, к 1, . . , П. (12)

J=1

Поскольку ly = 0 при i < j, Ujk = 0 при j > к, Ujj = 1, то (12) есть система

из п2 уравнений относительно п(п + 1)/2 неизвестных 1^, i > j и п(п — 1)/2

неизвестных Ujk, j < к, всего п(п + 1)/2 + п(п — 1)/2 = п2 неизвестных. По-

лучим формулы для решения системы (12), которые и составляют алгоритм

нахождения LU-разложения.

В силу lij = 0 при i < j, Ujk = 0 при j > к сумма в (12) имеет вид

min{z,fc}

) lij Ujk — Uik, i, к — 1,..., n,

j=l

ИЛИ

к

52 lij Ujk Uik,

j=l

i

52 lij Ujk — Uik,

. j=L

к < i, i,k = 1,... ,n,

к > i, i,k = 1,... ,n.

К.Ю.Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

20

Выделим в первой из этих сумм отдельно случай к = 1, а во второй - случай

i = 1, и учтем, что икк = 1 для всех к = 1,..., п,

hl —

к-1

52 hj U jk “1“ hk Тк >

L j=1

hi Uik = flit,

i—1

52 hj l^jk “1“ hi 1Ак — Щк >

L L j=l

Перегруппируем эти формулы:

1 < к < i, i,k = 2,... ,n,

к = 2,... ,n,

к > i > 1, i, к = 2,..., n.

1ц -- Иц,

Uik = aik/hi.

к = 2,... ,n,

1 < к <i,

к > i > 1,

(13)

i, к = 2,..., n,

i,k = 2,... ,n.

Процесс вычислений по этим формулам строится следующим образом: вначале

по первой из формул (13) вычисляются неизвестные элементы первого столбца

матрицы L: hi, i = 1,... ,п, затем по второй из формул (13) вычисляются неиз-

вестные элементы первой строки матрицы U: Uik, к = 2,... ,п (напомним, эле-

мент известен, он равен 1). Далее в вычислениях участвуют только третья

и четвертая из формул (13). По третьей формуле (13) вычисляются неизвестные

элементы второго столбца матрицы L: /й, i = 2,... ,п (напомним, /12 = 0, так

как L -нижняя треугольная)

^2 — hl ^12> — 2, . . . ,71.

По четвертой формуле (13) вычисляются неизвестные элементы второй стро-

ки матрицы U: U2k, к = 3,...,п (напомним, 7/21 = 0, так как U -верхняя

треугольная, 7/22 = 1, так как U имеет единичную главную диагональ)

U2k = («22: — hl Ulk)/h,2, к = 3, . . . ,71.

Затем по третьей формуле (13) вычисляются неизвестные элементы третьего

столбца матрицы L: hz, i = 3,... ,п, а по четвертой формуле (13) вычисляются

неизвестные элементы третьей строки матрицы U: 7/3^, к = 4,..., п и так далее.

Замечание 1. Организация хранения матриц L и U в памяти. Форму-

лы (13) таковы, что при вычислении элемента hj или иц используются значения

элемента и вычисленных ранее элементов lkm, т < j и икт, к < i. Это позво-

ляет хранить нижнюю треугольную матрицу L на месте нижнего треугольника

матрицы A: hj = aij, i > j, = вернюю треугольную матрицу U

(без единичной главной диагонали) - на месте верхнего треугольника матрицы

^4. Uij = dij, i <Z j', i, j — 1,..., 71.

К.Ю. Богачев

Точные методы решения линейных систем

§4. МЕТОД ГАУССА

21

§ 4.5. Оценка количества арифметических операций в алгоритме

построения LU-разложения

1. При фиксированном к = 1,...,п вычисление элементов для всех

i = к,... ,п по третьей формуле (13) требует £)"=fc(A; ~ 1) = (п — к + Г)(к — Г)

мультипликативных и столько же аддитивных операций. Следовательно, вычи-

сление всех элементов матрицы L требует УДдДп — к + 1)(к — 1) = пУД=1(к —

СЛсНИс JjCtzA. ^JlclVlcH±Ur> IVIcl-L]Лт1Дг>1 rjJcUj'Cl / -£ \ IL rv “1“ -L J \Jv -L J — IL /

1) - - l)2 = = n2(n - l)/2 - (n - l)n(2n - l)/6 =

/о _ ,„3 /о , _ эт3 M TI

n3/2 — n3/3 + O(n2) = n3/6 + O(n2) (n —> оо) мультипликативных и столько же

аддитивных операций.

2. При фиксированном i = 1,...,п вычисление элементов для всех

к = i + 1,... ,п по четвертой формуле (13) требует ТлД+Д = (п — муль-

типликативных и 22fc=j+i(z — 1) = (п — ?)(? — 1) аддитивных операций. Сле-

довательно, вычисление всех элементов матрицы U требует УД=Дп — i)i =

п2(п + 1)/2 — п(п + 1)(2п + 1)/6 = п3/6 + О(п2) (п —> оо) мультипликатив-

ных и £)"=1(n — W — 1) = п2(п — 1)/2 — п(п + 1)(2п + 1)/6 + п(п + 1)/2 =

п3/6 + О(п2) (п —> оо) аддитивных операций.

Таким образом, алгоритм построения LU-разложения требует для своего

проведения выполнения п3/3 + О(п2) (п —> оо) мультипликативных и столько

же аддитивных операций, а в сумме — (2/3) п3+О(п2) (п —> оо) арифметических

операций.

§4.6. Осуществимость метода Гаусса

Теорема 1. Метод Гаусса осуществим (т.е. возможно LU-разложение)

тогда и только тогда, когда для всех k = 1,... ,п ее главные угловые миноры

det Ак ф 0 , где

-А-к —

< <211

<221

<212

<222

а1к

<Ек

\ <2fcl

<2/с2

<2/с/с /

— главные угловые подматрицы матрицы А.

Доказательство. Можно показать (мы этого делать не будем), что если

det Ак ф 0 для всех к = 1,... ,п, то существует и единственно LU-разложение

матрицы А.

Обозначим через Lk и Uk главные угловые подматрицы матриц L и U. Так

как L - нижняя треугольная, a U - верхняя треугольная матрицы, и А = LU,

то Ак = LkUk. Следовательно, det Ад, = det Lk det Uk. Но матрица U -верхняя

треугольная с 1 на главной диагонали, поэтому det Uk = 1 для всех к = 1,..., п.

Значит, det Ак = det Lk. Матрица Lk -нижняя треугольная, поэтому det Lk =

/и ... 1кк. Следовательно, det Ак — 1ц 1кк

Пусть для всех к = 1,...,п det Ад, 0. Тогда 1ц = det Ах 0, 1кк =

det Ак/det Ак_{ / 0 ив формулах (13) возможно осуществить деление на 1ц, i =

К.Ю.Богачев

Точные методы решения линейных систем

§5. МЕТОДЫ ДЛЯ ЛЕНТОЧНЫХ МАТРИЦ

22

1,..., п. Следовательно, осуществим алгорим построения LU-разложения, а зна-

чит, и метод Гаусса.

Пусть осуществим алгорим построения LU-разложения, т.е. в формулах (13)

возможно осуществить деление на 1ц, i = 1,...,п. Следовательно, для всех

i = 1,..., п 1ц ф 0 и потому det Aj. = 1ц ... Ikk ф 0 для всех к = 1,..., п.

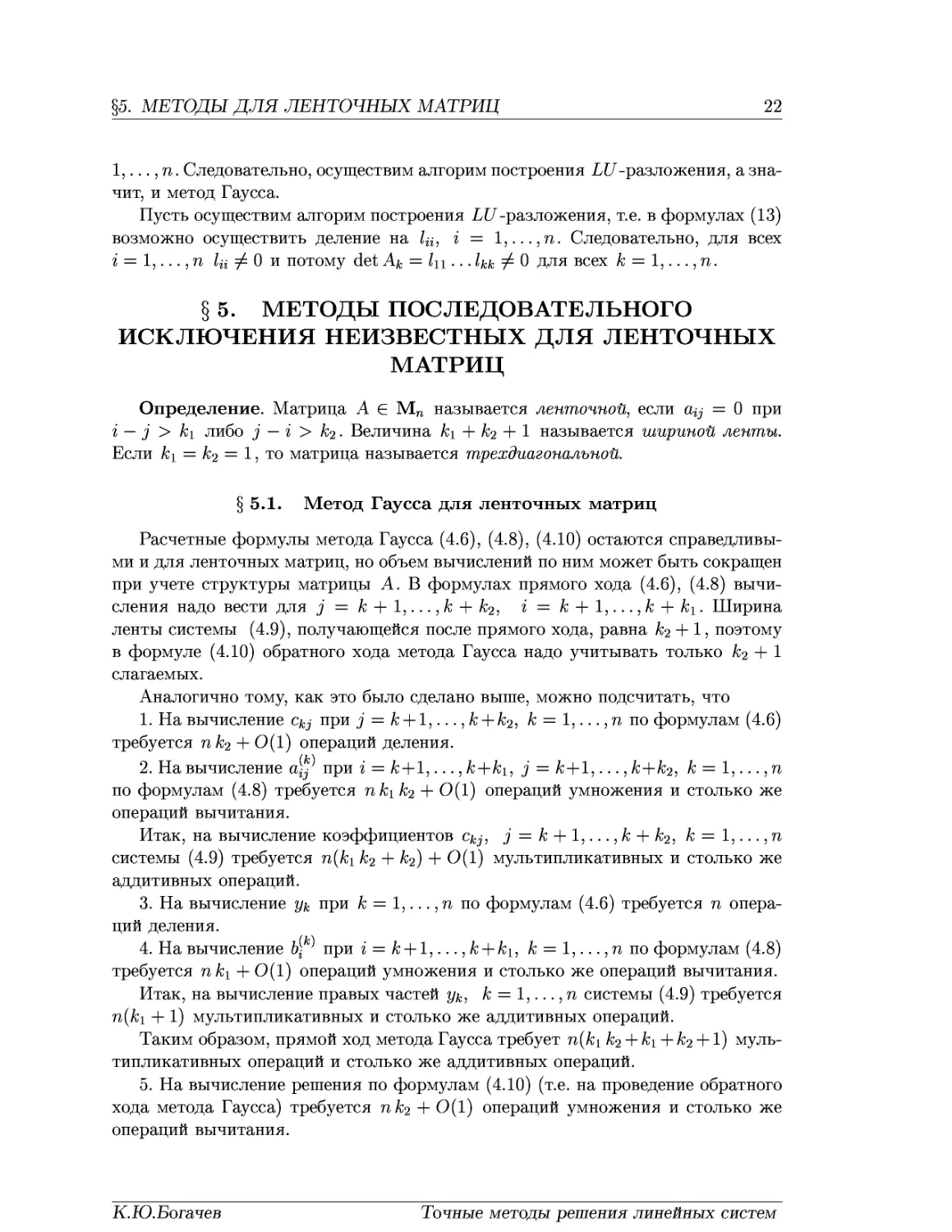

§ 5. МЕТОДЫ ПОСЛЕДОВАТЕЛЬНОГО

ИСКЛЮЧЕНИЯ НЕИЗВЕСТНЫХ ДЛЯ ЛЕНТОЧНЫХ

МАТРИЦ

Определение. Матрица А Е Мп называется ленточной, если = 0 при

i — j > ki либо j — i > k2. Величина ki + к2 + 1 называется шириной ленты.

Если к]_ = к2 = 1, то матрица называется трехдиагональной.

§ 5.1. Метод Гаусса для ленточных матриц

Расчетные формулы метода Гаусса (4.6), (4.8), (4.10) остаются справедливы-

ми и для ленточных матриц, но объем вычислений по ним может быть сокращен

при учете структуры матрицы А. В формулах прямого хода (4.6), (4.8) вычи-

сления надо вести для j = к + 1,..., к + к2, i = к + 1,... ,к + к±. Ширина

ленты системы (4.9), получающейся после прямого хода, равна к2 + 1, поэтому

в формуле (4.10) обратного хода метода Гаусса надо учитывать только к2 + 1

слагаемых.

Аналогично тому, как это было сделано выше, можно подсчитать, что

1. На вычисление с^- при j = к + 1,... ,к + к2, к = 1,... ,п по формулам (4.6)

требуется пк2 + 0(1) операций деления.

2. На вычисление при i = к + 1,..., к+Ц, j = к+1,..., к+к2, к = 1,..., п

по формулам (4.8) требуется nkik2 + 0(1) операций умножения и столько же

операций вычитания.

Итак, на вычисление коэффициентов с^-, j = к + 1,..., к + к2, к = 1,... ,п

системы (4.9) требуется n(ki к2 + к2) + 0(1) мультипликативных и столько же

аддитивных операций.

3. На вычисление ук при к = 1,... ,п по формулам (4.6) требуется п опера-

ций деления.

4. На вычисление при i = к + 1,... ,к + Ц, к = 1,... ,п по формулам (4.8)

требуется пЦ + 0(1) операций умножения и столько же операций вычитания.

Итак, на вычисление правых частей ук, к = 1,... ,п системы (4.9) требуется

n(ki + 1) мультипликативных и столько же аддитивных операций.

Таким образом, прямой ход метода Гаусса требует n(ki к2 + Ц + к2 +1) муль-

типликативных операций и столько же аддитивных операций.

5. На вычисление решения по формулам (4.10) (т.е. на проведение обратного

хода метода Гаусса) требуется пк2 + 0(1) операций умножения и столько же

операций вычитания.

К. Ю. Богачев

Точные методы решения линейных систем

§5. МЕТОДЫ ДЛЯ ЛЕНТОЧНЫХ МАТРИЦ

23

Следовательно, метод Гаусса требует n(ki кд + Ц + 2 /с2 + 1) мультипликатив-

ных операций и столько же аддитивных операций. Всего: 2п(к\ кд + Ц + 2 /с2 + 1)

арифметических операций.

Аналогичное сокращение вычислительной работы может быть произведено

для алгоритма LU-разложения.

§ 5.2. Алгоритм LU-разложения для трехдиагональных матриц

Пусть требуется трехдиагональную матрицу вида

(1)

представить в виде А = LU, где

^п— 1 /

и2

1

W1

1

В этом случае формулы (4.13) алгоритма построения LU-разложения могут

быть получены путем непосредственного перемножения матриц L и U и ре-

шения получающихся уравнений:

Zi — йх, их — Сх//х

Ах = Д, /2 = а2 — AiMi,

Ау — ф,

гг+1 — ^г+1

и2 — С2//2

(3)

Ауг—2 — dn—2,

п—1— ^п—1 Xi—2^n—2i 'U'n—l— Cn—l/l'n—l

Ап—1 dn~i

п — Ayj—iUyj—i

Построение LU-разложения по этим формулам требует п—1 аддитивных и

2(п — 1) мультипликативных операций.

Решение линейной системы Ах = b может быть осуществлено следующим

образом:

1. Вначале строится LH-разложение матрицы А по формулам (3), на это

требуется п — 1 аддитивных и 2(п — 1) мультипликативных операций.

К. Ю. Богачев

Точные методы решения линейных систем

§5. МЕТОДЫ ДЛЯ ЛЕНТОЧНЫХ МАТРИЦ

24

2. Затем находится решение у линейной системы Ly = b путем последова-

тельного исключения неизвестных, начиная с первого уравнения:

yi = b1/h, yi = (bi - Xi-iyi-i)Щ г = 2,...,п. (4)

На этом этапе требуется произвести п — 1 аддитивных и 2(п — 1) + 1 мульти-

пликативных операций.

3. Искомый вектор х находится как решение линейной системы U х = у

путем последовательного исключения неизвестных, начиная с последнего урав-

нения:

Хп = уп, Xi = yi - UiXi+1, г = п — 1,... ,1. (5)

На этом этапе требуется произвести п — 1 аддитивных и п — 1 мультипликатив-

ных операций.

Складывая оценки трудоемкости на каждом шаге, находим, что для осуще-

ствления алгоритма требуется произвести 3(п — 1) аддитивных и 5(п — 1) + 1

мультипликативных операций.

Замечание 1. Хранение в памяти ЭВМ матриц A, L и U. Матрицу

вида (1) в памяти ЭВМ обычно не хранят. Вместо этого запоминают вектора

а = (cii,..., ап)*, с = (ci,..., сп_1)*, d = (d±,..., . Аналогично, вместо ма-

трицы L хранятся вектора I = (Ц,..., /„)*, А = (А1;..., Ara_i)* , а вместо матрицы

U - вектор и = («1,..., Wn-i)* Как и в обычном алгоритме LU-разложения, ма-

трицы L и U можно хранить на месте матрицы А : вектор I - на месте вектора

а , вектор А - на месте d , и - на месте с.

Замечание 2. Вспомогательный вектор у в приведенном выше алгоритме

решения линейной системы может хранится на месте вектора х. Это следует из

формул (4), (5), которые можно записать в виде

= ЬДЦ Xi = (bi-Xi-iXi-J/li, г = 2,...,п, Xi\= Xi~UiXi+1, i = n-1,..., 1.

§5.3. Метод прогонки для трехдиагональных матриц

Пусть требуется трехдиагональную матрицу А вида (1) представить в виде

А = LU, где

К. Ю. Богачев

Точные методы решения линейных систем

§5. МЕТОДЫ ДЛЯ ЛЕНТОЧНЫХ МАТРИЦ

25

В отличие от LU-разложения, это представление не единственно. Перемножая

матрицы L и U, находим уравнения для определения коэффициентов Ц, Vj, щ :

llVi = Ср, liUi = Ci

Vj—1 — ф—i, i -|- IjVj — Ср, IjUi — Cj, i — 2, . . . , 71 1 (6)

^n— 1— dn-1, Un—i -p In^n— ^n-

Число уравнений в этой системе, равное 2 + 3(п — 2) + 2 = Зп — 2, на 1 меньше

числа неизвестных li,Vj,Uj . Перепишем (6) в виде

Vi = di, = tH, liiii= Ci

di, Hi—i "p liVi Цщ C^, 7 2, . . . , 71 1

Uyi—1 H- lnTn= ^n-

Отсюда получаем расчетные формулы:

Vi= di, li =ai/vi, Ui= Ci/li

Vi — di, li — (cp Ui—i)j V^ Ui — Ci I'li) 7 — 2, . . . , 71 1 (7)

InTn— On Un—1-

Из последнего уравнения в (7) мы можем определить только произведение lnvn.

Зафиксировав один из параметров 1п или vn, мы определим второй. Мы бу-

дем считать, что vn = 1 . В этом случае, количество арифметических операций,

необходимое для осуществления разложения по формулам (7) равно количе-

ству арифметических операций, необходимому для осуществления разложения

по формулам (3).

Решение линейной системы Ах = b может быть осуществлено следующим

образом:

1. Вначале строится LH-разложение матрицы А по формулам (7), на это

требуется п — 1 аддитивных и 2(тг — 1) мультипликативных операций.

2. Затем находится решение у линейной системы Ly = b путем последова-

тельного исключения неизвестных, начиная с первого уравнения:

yi = bi/h, yi = {bi-yi-i^/li, г = 2,...,п. (8)

На этом этапе требуется произвести п — 1 аддитивных и (п — 1) + 1 мультипли-

кативных операций.

3. Искомый вектор х находится как решение линейной системы U х = у

путем последовательного исключения неизвестных, начиная с последнего урав-

нения:

хп = Уп/г>п, Xi = {yi - UiXi+i)/vi, i = n - 1,..., 1. (9)

На этом этапе требуется произвести п — 1 аддитивных и 2(тг — 1) мультиплика-

тивных операций (с учетом vn = 1).

Складывая оценки трудоемкости на каждом шаге, находим, что для осуще-

ствления алгоритма требуется произвести 3{п — 1) аддитивных и 5{п — 1) + 1

мультипликативных операций.

К. Ю. Богачев

Точные методы решения линейных систем

§6. ЗАДАЧА ОБРАЩЕНИЯ МАТРИЦЫ

26

Замечание 3. Хранение в памяти ЭВМ матриц A, L и U осуществля-

ется так, как описано в Замечании 1. Вместо матрицы А запоминают вектора

а = (а1;..., ап)*, с = (с1;..., сп_1)*, d = (d±,..., dn-Cf , вместо матрицы L -

вектор I = Д,... ,1пУ , а вместо матрицы U - вектора v = (щ,... ,гпУ,и =

(«1,..., ип-Щ . Аналогично алгоритму LU-разложения, матрицы L и U можно

хранить на месте матрицы А : вектор I - на месте вектора а , вектор v - на

месте d (последняя, не определяемая однозначно компонента vn вектора v не

хранится; ее можно считать равной 1), и - на месте с.

Замечание 4. Вспомогательный вектор у в приведенном выше алгоритме

решения линейной системы может хранится на месте вектора х. Это следует из

формул (8), (9), которые можно записать в виде

= br/h, Xi = (bi-x^/li, г = 2,...,п, Xi'.= (xi-UiXi+^/vi, i = n-1,..., 1.

(здесь считается vn = 1 .)

§ 6. ЗАДАЧА ОБРАЩЕНИЯ МАТРИЦЫ

Рассмотрим задачу нахождения матрицы, обратной к данной.

Случай произвольного алгоритма. Пусть В - некоторый алгоритм реше-

ния линейных систем вида Ах = b , так, что х = В(А, 6). Тогда j-й столбец

Xj матрицы А-1 равен Xj = В(А, е7), где е;- = (0,..., 0,1, 0,..., 0)* есть j-й

j-i

орт стандартного базиса. Если алгоритм В требует для своего проведения d(n)

арифметических операций, то этот способ нахождения обратной матрицы потре-

бует nd(n) арифметических операций. Например, если В - это метод Гаусса, то

потребуется 2/3 п4 + О(п3) арифметических операций.

Случай специального алгоритма. Многие алгоритмы решения линейных

систем (в частности, все алгоритмы, рассматриваемые нами) обладают следу-

ющим свойством: алгоритм (по крайней мере его самая трудоемкая с вычисли-

тельной точки зрения часть) состоит в проведении над системой преобразований,

которые выполняются над матрицей системы и правой частью независимо. Эта

особенность позволяет вместо правой части - вектора b - рассматривать набор

правых частей, т.е. матрицу В. Преобразования алгоритма выполняются над

матрицей системы и набором правых частей. Таким образом, такой алгоритм

решения системы Ах = b может быть преобразован в алгоритм решения ма-

тричного уравнения АХ = В, где X, В - п х п матрицы. Обычно алгоритм

решения системы Ах = b требует О(п3) арифметических операций для про-

ведения преобразований над матрицей и О(п2) арифметических операций для

проведения преобразований над правой частью. Поэтому алгоритм решения ма-

тричной системы АХ = В требует О(п3) + п • О(п2) = О(п3) арифметических

операций.

К. Ю. Богачев

Точные методы решения линейных систем

§7. МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО ЭЛЕМЕНТА

27

Использование LU-разложения для обращения матрицы. Пусть для

матрицы А возможно осуществить LU-разложение. Действительно, если А =

LU, то А-1 = U~lL~l. Матрицы, обратные к L и U, строятся, например, описан-

ным выше способом. Поскольку системы с матрицами L и U решаются методом

последовательного исключения неизвестных за соответственно п(п — 1) + п =

п2 + О(п) и п(п — 1) = п2 + О(п) действий (см. формулы (4.10)), то матрицы £7-1

и L~l могут быть вычислены с затратой п3 + О(п2) арифметических операций.

Следовательно, для вычисления обратной матрицы требуется: 2/3 п3 + О(п2)

арифметических операций для построения LU-разложения, п3 + О(п2) ариф-

метических операций для вычисления U~l и L~l, п3 + О(п2) арифметических

операций для вычисления А-1 = всего: 8/3 п3 + О(п2) арифметических

операций.

§ 7. МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО

ЭЛЕМЕНТА

Теорема 4.1 показывает, что метод Гаусса в изложенном выше виде применим

не ко всем невырожденным матрицам. Например, если в системе (4.1) ап =

0, то нельзя осуществить первый же шаг алгоритма. Модернизируем алгоритм

следующим образом.

Уравнения в системе (4.1) равноправны, мы можем их занумеровать в произ-

вольном порядке. Присвоим номер 1 тому уравнению, в котором коэффициент

при Xi отличен от 0. Если такого уравнения не нашлось, то матрица А имеет

нулевой первый столбец, т.е. вырождена. После этой перенумерации уравнений

мы сделаем первый шаг метода Гаусса, т.е. перейдем от системы (4.1) к систе-

ме (4.3). Далее в подматрице А^ = (a^)j,j=2,...,n £ Mn_! присвоим номер 2 тому

уравнению, в котором коэффициент при х-2 отличен от 0, и сделаем следующий

шаг метода Гаусса. Затем этот процесс применяется к подматрице А^ 6 Мп-2

и так далее.

Если уравнений, в которых коэффициент при х2 отличен от 0, несколько, то с

вычислительной точки зрения не безразлично, какое из этих уравнений получит

номер 1. Пусть погрешность в элементе а^ матрицы А равна , т.е. вместо

точной матрицы А рассматривается матрица А, элементы которой содержат

вычислительные погрешности: йц = . Для простоты будем считать, что

элементы первого столбца известны точно: = 0, i = 1,... ,п. Из формул для

элементов матрицы А^1) (см. (4.8), (4.6)):

~(1) _ ~ л ~ @Tj ~ ~ ~ Яц ___ . / . \

a^j (Lij CijOiiY (Lij ~ ЯЦ (Lij ~ (Lij I I )

du Й11 du

(1) . (1) • о

— I- + ^ij i A — 2, . . . , П,

«II du

где

(1) Яц • о

£ij=£ij-£ij—, г,] = 2,...,п, (1)

«11

К.Ю. Богачев

Точные методы решения линейных систем

§7. МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО ЭЛЕМЕНТА

28

Эти равенства показывают, как преобразуется погрешность после шага алго-

ритма. Из соотношений (1) вытекает, что если отношение очень велико, то

ан

вычислительная погрешность, вносимая на шаге алгоритма, может быть недо-

пустимо большой.

Из (1) следует, что погрешность будет наименьшей, если модуль отношения

наименьший из возможных. Это будет в том случае, если ап - НаибоЛЬ-

^П

ший по модулю элемент в первом столбце. Поэтому описанный выше алгоритм

преобразуем к следующему виду.

Присвоим номер 1 тому уравнению, в котором коэффициент при Xi наиболь-

ший по модулю. Этот коэффициент отличен от нуля, так как противное означало

бы, что матрица А имеет нулевой первый столбец, т.е. вырождена. После этой

перенумерации уравнений мы сделаем первый шаг метода Гаусса, т.е. перейдем

от системы (4.1) к системе (4.3). Далее в подматрице = (a^)j,j=2,...,n £ Mn_i

присвоим номер 2 тому уравнению, в котором коэффициент при х? наиболь-

ший по модулю, и сделаем следующий шаг метода Гаусса. Затем этот процесс

применяется к подматрице Е Мп_2 и так далее. Этот алгоритм называется

методом Гаусса с выбором главного элемента по столбцу.

Можно преобразовать метод Гаусса и по-другому. Неизвестные в системе (4.1)

равноправны, мы можем их занумеровать в произвольном порядке. Присвоим

номер 1 той неизвестной, при которой коэффициент в первой строке отличен

от 0. Если такой неизвестной не нашлось, то матрица А имеет нулевую пер-

вую строку, т.е. вырождена. После этой перенумерации неизвестных мы сделаем

первый шаг метода Гаусса, т.е. перейдем от системы (4.1) к системе (4.3). Далее

в подматрице Л/1) = (a^)i;J=2,...,n G Mn_i присвоим номер 2 той неизвестной,

при которой коэффициент в первой строке матрицы Л/1) (т.е. во второй строке

матрицы Л) отличен от 0, и сделаем следующий шаг метода Гаусса. Затем этот

процесс применяется к подматрице Е Мп_2 и так далее.

Если неизвестных, при которых коэффициент отличен от 0, несколько, то

с вычислительной точки зрения не безразлично, какая из них получит номер

1. Рассуждениями, аналогичными вышеприведенным, можно установить, что

погрешность, вносимая на шаге алгоритма, будет минимальной, если если ац

- наибольший по модулю элемент в первой строке. Поэтому описанный выше

алгоритм преобразуем к следующему виду.

Присвоим номер 1 той неизвестной, при которой коэффициент в первой

строке наибольший по модулю. Этот коэффициент отличен от нуля, так как

противное означало бы, что матрица А имеет нулевую первую строку, т.е. вы-

рождена. После этой перенумерации неизвестных мы сделаем первый шаг ме-

тода Гаусса, т.е. перейдем от системы (4.1) к системе (4.3). Далее в подматрице

= (41})ь2=2,.,п е м„_1 присвоим номер 2 той неизвестной, при которой

коэффициент в первой строке матрицы Л^1) (т.е. во второй строке матрицы Л)

наибольший по модулю, и сделаем следующий шаг метода Гаусса. Затем этот

процесс применяется к подматрице Е Мп_2 и так далее. Этот алгоритм

К. Ю. Богачев

Точные методы решения линейных систем

§7. МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО ЭЛЕМЕНТА

29

называется методом Гаусса с выбором главного элемента по строке.

Для уменьшения вычислительной погрешности используют следующую ком-

бинацию приведенных выше методов. В качестве ац выбирается элемент, имею-

щий наибольший модуль среди всех элементов матрицы. Если этот элемент есть

ац, то меняются номера у 1-й и z-й строк и у 1-го и j-ro столбцов. После этой

перенумерации уравнений и неизвестных делается первый шаг метода Гаусса,

т.е. осуществляется переход от системы (4.1) к системе (4.3). Далее в подматри-

це А^ = (ajp)i;J=2,...,n Е выбирается элемент ац с наибольшим модулем

среди всех элементов матрицы А^1) и меняются номера у 1-й и г-й строк и у 1-го

и j-ro столбцов матрицы А^ (т.е. у 2-й и г-й строк и у 2-го и j-ro столбцов

матрицы А ). Затем этот процесс применяется к подматрице А^ 6 Мп_2 и так

далее. Этот алгоритм называется методом Гаусса с выбором главного элемента

по всей матрице.

Вычислим дополнительные (по сравнению с обычным методом Гаусса) за-

траты вычислительной работы на решение системы по этим алгоритмам. На

к -ом шаге (к = 1,..., п) метода Гаусса с выбором главного элемента по столбцу

или строке требуется п — к операций сравнения элементов матрицы А для нахо-

ждения максимального по модулю элемента. В методе Гаусса с выбором главного

элемента по всей матрице это число равно (п—к)2. Следовательно, в первых двух

методах дополнительно требуется УД=г(п — к) = п(п — 1)/2 = 0(п2) (п —> оо)

операций сравнения, а в последнем методе - УД=\(п — к)2 = (п— 1)п(2п — 1)/6 =

п3/3 + 0(п2) (п —> оо) операций сравнения.

На большинстве ЭВМ операция сравнения двух чисел с плавающей точкой

выполняется за время, по порядку равное времени вычитания этих чисел. (Это

связано с тем, что вместо сравнения двух чисел выполняется операция вычи-

тания одного числа из другого и сравнения результата с нулем. Поскольку сам

результат нигде не запоминается и от него используется лишь его знак, то опе-

рация сравнения обычно осуществляется быстрее операции вычитания, однако

следующая за операцией сравнения команда условного перехода с лихвой ком-

пенсирует эту разницу.) Поэтому в методе Гаусса с выбором главного элемента

по столбцу или строке количество операций асимптотически то же, что в обыч-

ном методе Гаусса: 2/Зп3 + О(п2). В методе Гаусса с выбором главного элемента

по всей матрице количество операций асимптотически в полтора раза больше,

чем в обычном методе Гаусса: п3 + 0(п2). По этой причине этот метод обыч-

но применяется тогда, когда с помощью других методов не удалось получить

приемлемого по точности результата из-за сильного роста вычислительной по-

грешности (такая ситуация возникает, если матрица А имеет большое число

обусловленности).

Теорема 1. Метод Гаусса с выбором главного элемента по столбцу осуще-

ствим тогда и только тогда, когда det А 0.

Доказательство. Шаг метода Гаусса переводит невырожденную матрицу

К. Ю. Богачев

Точные методы решения линейных систем

§7. МЕТОД ГАУССА С ВЫБОРОМ ГЛАВНОГО ЭЛЕМЕНТА

30

в невырожденную. Действительно, после перехода от матрицы (4.4) к матри-

це (4.7) по формулам (4.6), (4.8) определитель матрицы (4.4) равен определителю

матрицы (4.7), умноженному на (множитель возникает при вычислении

по формулам (4.6), при преобразовании матрицы по формулам (4.8) определи-

тель не изменяется, так как они задают элементарные преобразования матрицы).

Согласно правилам вычисления определителей, определитель матрицы (4.4), по-

лучающейся после к — 1 шагов метода Гаусса, равен определителю матрицы

Следовательно, невырожденность матрицы А эквива-

лентна невырожденности матриц для всех к = 1,..., п .

Очередной, к-й шаг метода Гаусса с выбором главного элемента по столбцу

возможен тогда и только тогда, когда первый столбец матрицы ненулевой,

т.е. эта матрица невырождена (см. подробное обоснование этого при построении

метода).

Таким образом, осуществимость всех п шагов метода Гаусса эквивалентна

невырожденности матриц для всех к = 1,..., п , что эквивалентно невыро-

жденности матрицы А.

Теорема 2. Метод Гаусса с выбором главного элемента по строке осуще-

ствим тогда и только тогда, когда det А 0.

Доказательство повторяет доказательство предыдущей теоремы. Измене-

ния только в том, что очередной, &-й шаг метода Гаусса с выбором главного

элемента по строке возможен тогда и только тогда, когда первая строка матри-

цы А^-1^ ненулевая, т.е. эта матрица невырождена (см. подробное обоснование

этого при построении метода).

Теорема 3. Метод Гаусса с выбором главного элемента по всей матрице

осуществим тогда и только тогда, когда det А 0.

Доказательство повторяет доказательство теоремы 1. Изменения только

в том, что очередной, &-й шаг метода Гаусса с выбором главного элемента по

всей матрице возможен тогда и только тогда, матрица А^-1) ненулевая (см.

подробное обоснование этого при построении метода).

Замечание 1. Программная реализация методов Гаусса с выбором

главного элемента. При реализации этих методов можно переставлть не стро-

ки или столбцы матрицы, а их номера. Сделать это можно, например, следую-

щим способом.

Рассмотрим метод Гаусса с выбором главного элемента по всей матрице.

Пусть массив indi длиной п содержит номер строки матрицы А, массив indj

длиной п содержит номер столбца матрицы А. Вначале indi(i)=i, indj (j) =j,

i, j = 1,... ,n. Обращение к элементам матрицы А происходит следующим обра-

зом: элемент есть a(indi (i), indj (j)). Для того, чтобы переставить местами

К. Ю. Богачев

Точные методы решения линейных систем

§S. МЕТОД ЖОРДАНА (ГАУССА-ЖОРДАНА)

31

21-ю и «2-ю строки матрицы А, достаточно переставить местами «i-й и «2-й эле-

менты массива indi; для того, чтобы переставить местами ji-й и Д-й столбцы

матрицы А, достаточно переставить местами Д-й и Д-й элементы массива indj.

Существенным недостатком такого способа реализации перестановок строк и

столбцов является замедление доступа к элементам массива.

Замечание 2. Для матриц А произвольного вида методы Гаусса с выбором

главного элемента практически вытеснили обычный метод Гаусса из вычисли-

тельной практики. Совершенно иная ситуация для случая ленточных матриц А.

Дело здесь в том, что перестановка строк или столбцов в таких матрицах при-

водит к увеличению ширины ленты, что часто недопустимо (поскольку вместо

матрицы хранится только ее лента).

§ 8. МЕТОД ЖОРДАНА (ГАУССА-ЖОРДАНА)

Пусть требуется решить линейную систему Ах = b, А Е М.п вида (4.1). Пер-

вый шаг метода Жордана сопадает с первым шагом метода Гаусса: система (4.1)

преобразуется к виду

Х1 + (1) «12^2 + .. + (1) <Нп ХП —

(Г «22^2 + .. + (1) «2п хп — а(1) °2 (1)

(Г + .. + С'1Хп = гД) п

по тем же формулам

= dij/ciii, =bl/all, j = 2,...,n,

(1) W к kW О

aij = aij - ьд =bi-b[)ail, i,j=2,...,n.

После к — 1, к = 1,... ,п шагов метода Жордана система (4.1) преобразована

к виду

Х2 + + (fc-1) а1,к Хк (fc-1) «2,fc Хк + + + + (fc-1) <Нп Хп {к-1) ®2п хп = =

Хк-1 + {к-1) ак-1,кхк + + {к-1) ак-1,пХп = (2)

{к-1) ак,к хк + + {к-1) ак,п Хп - 1 — °к

{к-1) ап,к Хк + + n{k~l)q. = /Д-Г п

Предположим, что а^к ф 0. Поделив &-е уравнение системы (2) на а>кк

перепишем его в виде

+ 4л+1^+1 + + = №, (3)

К. Ю. Богачев

Точные методы решения линейных систем

§S. МЕТОД ЖОРДАНА (ГАУССА-ЖОРДАНА)

32

где 1) (к) = akj , 1 ,(к) = А /4ч akj (к-1) ’ Л, I 1, ... ,71, 0к (к-1) ’ V4/ акк акк

Умножим уравнение (3) на а-к и вычтем его из г-го уравнения системы (2),

i = 1,..., п. В результате система (2) примет вид

Х1

Х2

хк — 1

+ (к) а1,к+1Хк+1 + . + (fc) ®1п Хп = ь?

+ (fc) а2,к+1Хк+1 + . + (fc) хп = ь?

। W । + ДДк+1хк+1 + .. । Т) + ак-1,пХп — °к-1

хк + (fc) ак,к+1Хк+1 + . .+ (fc) ак,пХп _Ь(к) — °к

(к) 1 ак+1,к+1Хк+1 + 1 (£) + ак+1,пХп _Ь(к) — °к+1

(fc) ап,к+1Хк+1 + . + ^71,71^71 = п

(5)

где

(к) (к-1) (к-1) (к)

°>ij =°>ij ~aik akj’

b(k) = b(k-l) _ a(k-VbW

Itv tv '

i = 1,... ,n, i ф k, j = k + 1,... ,n.

(6)

i = 1,..., n, i Ф k.

Выражения (4), (6) являются формулами перехода от системы (2) к системе (5).

Если обозначить off = а^, = bi, i,j = l,...,n,ro переход от системы (4.1)

к системе (1) будет осуществляться по тем же формулам при к = 1.

После проведения вычислений по формулам (4), (6) при к = 1,..., п матрица

системы (4.1) станет единичной матрицей. Следовательно, правая часть системы

содержит искомое решение: Xi = ог- , % = 1,..., п.

Метод Жордана удобно применять для нахождения обратной матрицы. При

этом вместо правой части b используется набор правых частей, состоящий из

п столбцов единичной матрицы, над которыми одновременно производятся пре-

образования, задаваемые соотношениями (4), (6). После проведения п шагов

метода Жордана этот набор будет состоять из столбцов обратной матрицы А-1.

Поскольку на каждом шаге метода Жордана подматрица А^-1^ =

(aij~1'>)ij=k,...,n - та же, чт0 на соответствующем шаге метода Гаусса, то метод

Жордана осуществим тогда и только тогда, когда осуществим метод Гаусса, т.е.

когда все главные угловые миноры матрицы А отличны от нуля.

Оценка количества арифметических операций в методе Жордана

1. На вычисление при j = к + 1,..., п, к = 1,..., п по формулам (4)

требуется (п ~ к) = п(п — 1)/2 = О(п2) (п —> оо) операций деления.

К. Ю. Богачев

Точные методы решения линейных систем

§9. ПОЛОЖИТЕЛЬНО ОПРЕДЕЛЕННЫЕ МАТРИЦЫ

33

2. На вычисление а!£' при i = 1,... ,п, i к, j = к + 1,... ,п, к = 1,...,п по

формулам (6) требуется ^=i(n —A:)(n—1) = (п — 1)2п/2 = п3/2 + О(п2) (п —> оо)

операций умножения и столько же операций вычитания.

3. На вычисление при к = 1,..., п по формулам (4) требуется п операций

деления.

4. На вычисление при i = 1,... ,п, i к, к = 1,...,п по формулам (6)

требуется '£,k=i(n — 1) = n(n — 1) = О(п2) (п —> оо) операций умножения и

столько же операций вычитания.

Таким образом, метод Жордана требует О(п2) + п3/2 + п + О(п2) = п3/2 +

О(п2) (п —> оо) мультипликативных операций и столько же аддитивных опера-

ций. Всего: п3 + О(п2) (п —> оо) арифметических операций.

По аналогии с методом Гаусса можно строить метод Жордана с выбором

главного элемента. Именно, в подматрице Л^-1) = (aj* ^)ij=k,...,n (совпадаю-

щей с подматрицей из метода Гаусса) той же процедурой, что и в методе Гаусса,

выбирается главный элемент.

§ 9. ПОЛОЖИТЕЛЬНО ОПРЕДЕЛЕННЫЕ МАТРИЦЫ

Определение. Матрица А Е М.п называется положительно определенной

(обозначается Л > 0), если для всех х Е С" выражение (Ах,х) вещественно

и (Ах,х) > 0 для всех х Е С", х ф 0 (здесь (•, •) означает обычное скаляр-

ное произведение в С", (х, у) = у*х, где у* = (yi,... ДД) , черта над символом

обозначает, как обычно, знак комплексного сопряжения). Если рассматривае-

мая матрица Л вещественна, то часто положительно определенной называется

матрица Л, для которой (Ах, х) > 0 для всех х Е Rn, х ф 0.

Замечание 1. Если матрица Л Е М.п - самосопряженная (т.е. Л* = Л), то

выражение (Ах, х) вещественно для всех х Е С".

Действительно, (Ах, х) = (х, А*х) = (х, Ах) = (Ах, х) и потому (Ах, х) веще-

ственно.

Лемма 1. Если матрица А положительно определена, то она невырожде-

на.

Доказательство. Предположим противное, det Л = 0. Тогда линейная си-

стема Ах = 0 имеет решение х Е Сп, х ф 0. Для этого х выражение

(Ах,х) = (0, ж) = 0, что противоречит положительной определенности матрицы

Л.

Лемма 2. Если матрица А положительно определена, то для нее суще-

ствует LU -разложение.

К.Ю.Богачев

Точные методы решения линейных систем

§9. ПОЛОЖИТЕЛЬНО ОПРЕДЕЛЕННЫЕ МАТРИЦЫ

34

Доказательство. В соответствии с теоремой 4.1 нам надо проверить, что

главные угловые миноры положительно определенной матрицы А отличны от

нуля.

Определим отображение пространства Сп —> Ск , к < п действующее по

правилу: для всякого х = (жх,... ,жп)* Е Сп х^) = (х1, ЛкУ € Ск. Это ото-

бражение есть отображение ”на”, т.е. для каждого элемента х = (жх,... ,хк}1 G

Ск найдется элемент х Е С", являющийся прообразом х при этом отображении

(например, х = (ж1;..., хк, 0,..., 0)* Е С").

Поскольку матрица А положительно определена, то для всякого к = 1,..., п

и всякого х Е С", такого, что х^) ф 0 выражение (Ах^х^) вещественно и

положительно. По правилу перемножения матриц (Ах^), х(к)) = (Акх(к),х(к))к,

где

-А-к —

«2|

«12

«22

dlk

<Ик

\ ®к1

«7г2

акк 7

-главный угловая подматрица А , (•,•)* - обычное скалярное произведение в

пространстве Ск, (х, у)к = у*х, х,у Е Ск. Следовательно, выражение (Акх, х}к

вещественно и положительно для всех х Е Ск, т.е. матрицы Ак Е М&, к =

1,... ,п положительно определены. Пользуясь леммой 1, получаем, что матри-

цы Ак, к = 1,... ,п невырождены. Из теоремы 4.1 теперь вытекает требуемый

результат.

Лемма 3. Самосопряженная матрица А Е М.п положительно определе-

на тогда и только тогда, когда все ее собственные значения вещественны и

положительны.

Доказательство. Пусть А Е М.п самосопряженная положительно опреде-

ления матрица, А - ее собственное значение, х ф 0 - соответствующий соб-

ственный вектор: Ах = Хх. Умножим это равенство скалярно на х, получим

/4 Ч Ч / Ч Ч (Аж, Ж) ЧТ /44

(Ах,х) = Х(х,х) и А = —г—гр—. Поскольку (Ах,х) вещественно и положитель-

1И1

но, то А > 0.

Пусть А Е Мп самосопряженная матрица и А, > 0, i = l,2,...,n -

ее собственные значения. В курсе линейной алгебры было доказано, что вся-

кая самосопряженная (симметричная в вещественном случае) матрица диаго-

нализируема в евклидовом базисе, т.е. существует ортонормированный базис

Xi, Х2,.. , хп, (xi,Xj) = бу, состоящий из собственных векторов матрицы А:

Axi = XiXi. Пусть ж 7 0 - произвольный вектор, х = EF=i cixi - ег0 разло-

жение по базису {ж,}, причем ||ж||2 = E"=i |q|2 Ф 0- Рассмотрим выражение

(Аж, ж) = (АЦ=1ед,Ц=1ед) = (EEi «Агжг, EEi «А4) = ЕГ=х Ici12 Следова-

тельно, (Аж, ж) вещественно. Поскольку Aj > 0 и не все Cj равны 0, то (Аж, ж)

положительно. Итак, для всякого вектора ж 7 0 выражение (Аж, ж) вещественно

и положительно, что и означает положительную определенность матрицы А.

К. Ю. Богачев

Точные методы решения линейных систем

§10. МЕТОД ХОЛЕЦКОГО (КВАДРАТНОГО КОРНЯ)

35

§ 10. МЕТОД ХОЛЕЦКОГО (КВАДРАТНОГО КОРНЯ)

Пусть требуется решить линейную систему А х = b с самосопряженной (сим-

метричной в вещественном случае) матрицей А Е Мп, А* = А.

§ 10.1. Разложение Холецкого

Обозначим через RT (п) подгруппу невырожденных верхних треугольных ма-

триц в М.п, а через UT(n) - подгруппу в RT(n) матриц с единицами на главной

диагонали.

Теорема 1. Пусть матрица А - самосопряженная (А* = А) и все ее глав-

ные угловые миноры отличны от нуля. Тогда существуют матрица R = (rij) Е

RT(n) с вещественными положительными элементами на главной диагонали

(гц > 0 для всех i = и диагональная матрица D с вещественны-

ми равными по модулю единице диагональными элементами (дц Е { — 1,1} для

всех i = 1,... ,п) такие, что А = R*DR .

Доказательство. По теореме 4.1 для матрицы А осуществимо LU-

разложение, т.е. существуют L Е LT(n) и U Е UT(n) такие, что А = LU.

Поскольку матрица L = (1^) невырождена, то 1ц ф 0, i = 1,..., п и матрица

£> = diag (1ц,...,1пп) (1)

обратима, = diag (Z^1,. Положим L = LD~Y E LT(n). Тогда no

правилам перемножения матриц 1ц = 1, i = 1,..., п.

Подставим это представление матрицы L = LD в LU-разложение матрицы

А: А = LDU. Так как А = А*, то А = LDU = А* = [/*£>*£*. Поэтому U =

b-lL~4j*b*L*,

ПД*)-1 = b^L-hrb*. (2)

Заметим, что L* Е RT(n), причем главная диагональ этой матрицы состоит из

единиц. Следовательно L* Е UT(n). Поэтому в левой части равенства (2) стоит

матрица Е/Д*)-1 Е UT(n). В право же части равенства (2) стоит произведе-

ние нижних треугольных матриц, которое является опять нижней треугольной

матрицей, т.е. принадлежит LT(n). Поэтому из (2) вытекает

ПД*)-1 е UT(n) ПЬТ(п).

Единственной матрицей, которая принадлежит одновременно подгруппам UT(n)

и LT(n) является I - единичная матрица. Следовательно,

пД*)-1 = b^L-bnb* = I. (з)

Таким образом, U = L* и А = U*DU. Далее, из (3)

I = D~lL~lU*b* = b^L-btyb* = D~l L~l LD* = Ь^Ь*

К.Ю.Богачев

Точные методы решения линейных систем

§10. МЕТОД ХОЛЕЦКОГО (КВАДРАТНОГО КОРНЯ)

36

т.е. D = D*. В силу (1) получаем = Ij-j., т.е. Ikk ~ вещественные для всех

k = 1,... ,п. Представив матрицу D в виде D = \D\1^2D (Z?)1/2, где

D = diag (sign/п,...,sign/nn), |£>|1/2 = diag(^/|^П> > \/М),

получаем А = U*\D\1^2D\D\1^2U. Обозначим R = |Z)|1/,2[7 Е RT(n). Тогда

А = R*DR, причем диагональные элементы гц матрицы R равны > 0.

Следовательно, полученное разложение является требуемым.

Замечание 1. Если матрица А - вещественная, то все участвующие в тео-

реме 1 матрицы вещественные.

Замечание 2. Если в условиях теоремы 1 матрица А положительно опре-

делена, то матрица D в теореме 1 - единичная, т.е. разложение, даваемое этой

теоремой, имеет вид А = R*R.

Действительно, если матрица А положительно определена и для нее спра-

ведливо разложение А = R*DR, то для всякого х Е Сп, х ф 0 выражение

(Ах,х) = (R*DRx,x) = (D Rx,Rx) вещественно и положительно. Для всякого

у Е Сп положим х = R~ry. Тогда выражение (Dy, у) = (Ах,х) вещественно и

положительно для всех у Е Сп, у 0, т.е. матрица D положительно определена.

Поскольку D = diag(dn,... ,dnn), то (Dy,у) = Т^^уД] = E"=i 7/у|2.

По доказанному, эта сумма вещественна и положительна. Выбирая здесь у =

вк, к = 1,... ,п, где вк - орты стандартного базиса, находим, что все dkk, к =

1,... ,п должны быть вещественными и положительными. Поскольку \dkk\ = 1,

то это означает, что dkk = 1, к = 1,... ,п.

Замечание 3. Если матрица А положительно определена, то для нее вы-

полнены условия теоремы 1. Это вытекает из леммы 9.2.

§ 10.2. Алгоритм построения разложения Холецкого

Построим алгоритм нахождения разложения из теоремы 1.

Пусть для самосопряженной матрицы А (А* = А) требуется найти верхнюю

треугольную матрицу R = (гД) с вещественными положительными элементами

на главной диагонали (гц > 0 для всех i = 1,... ,п) и диагональную матрицу

D с равными по модулю единице диагональными элементами (| da | = 1 для всех

i = 1,..., п) такую, что А = R*DR .

п

Элемент (k,j) матрицы DR равен (DR)kj = Е dki'f'ij = dkk’r'kj > так как ма-

i=l

трица D - диагональная; элемент (i, к) матрицы R* равен (R*)ik = гЦ; элемент

(i,j) матрицы R*DR равен (R^DR^ = Е (R*)ik(DR)kj = Е rTidk^kj- Следо-

k=Y к=1

вательно, равенство А = R*DR дает нам уравнения

п

53 kidkkf kj — > Б j — 1, . . . ,П. (4)

fc=l

К.Ю. Богачев

Точные методы решения линейных систем

§10. МЕТОД ХОЛЕЦКОГО (КВАДРАТНОГО КОРНЯ)

37

Поскольку матрицы А и R*DR - самосопряженные, то уравнение с номером

(j, г) получается из уравнения с номером (i,j) путем комплексного сопряжения