Автор: Булинский А.В.

Теги: теория вероятностей и математическая статистика теория вероятностей математическая статистика комбинаторный анализ теория графов математика

ISBN: 978-5-7417-0266-6

Год: 2010

Текст

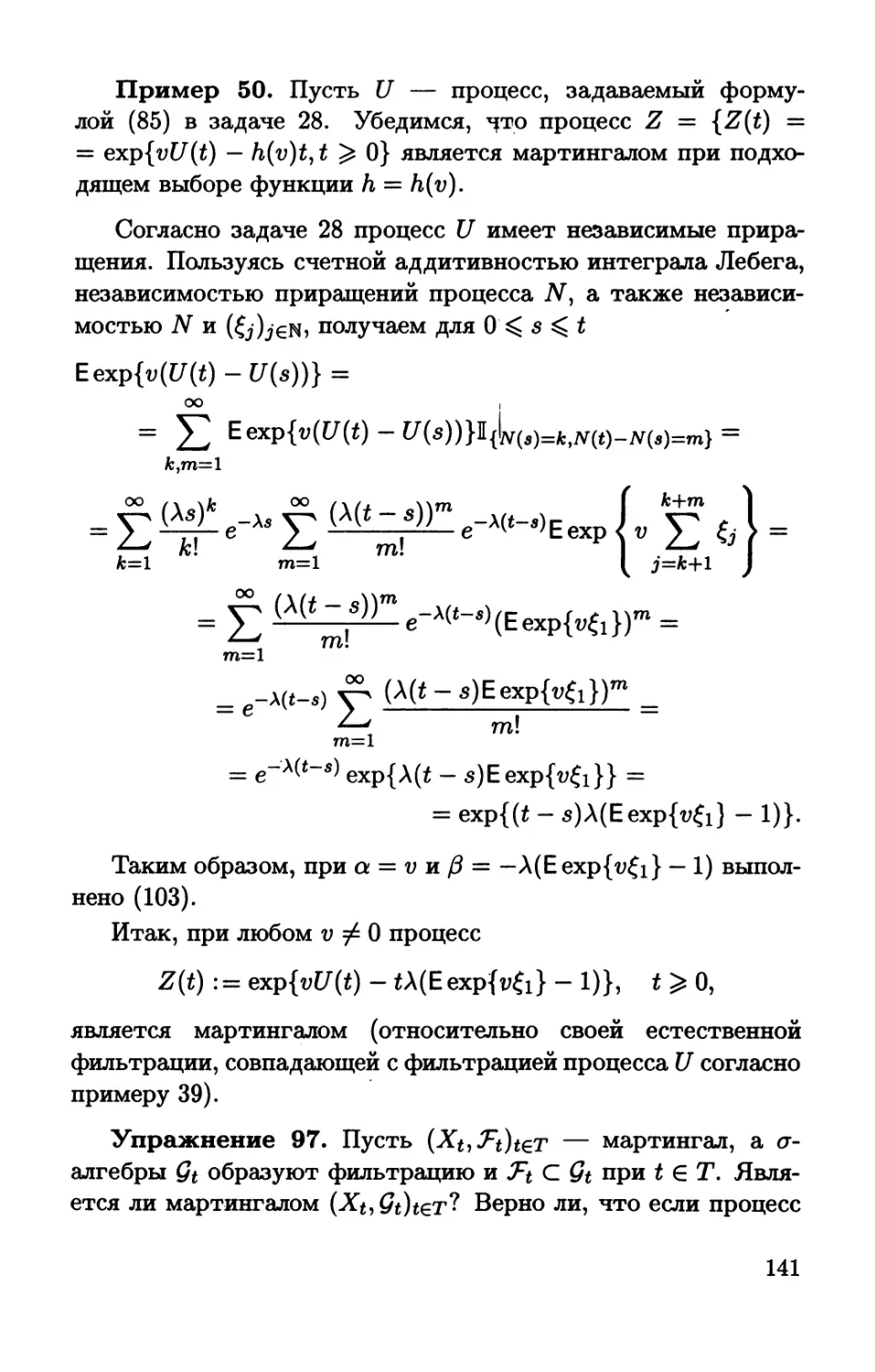

министерство ОБРАЗОВАНИЯ и НАУКИ РОССИЙСКОЙ ФЕДЕРАЦИИ

Московский физико-технический институт

(государственный университет)

А. В. Булинский

СЛУЧАЙНЫЕ ПРОЦЕССЫ.

ПРИМЕРЫ, ЗАДАЧИ И УПРАЖНЕНИЯ

Допущено

У чебно-методическим объединением

высших учебных заведений Российской Федерации

по образованию в области прикладных математики и физики

в качестве учебного пособия для студентов вузов

по направлению «Прикладные математика и физика»

МОСКВА

МФТИ

2010

УДК 519.216.2(075)

ББК 22.171я73

Б90

Рецензенты:

Кафедра теории вероятностей и математической статистики

Российского университета дружбы народов

(зав. каф. доктор физико-математических наук, профессор Ю. С. Хохлов)

Доктор физико-математических наук, профессор Л Г Афанасьева

Булинский А. В.

Б90 Случайные процессы. Примеры, задачи и упражне-

ния: учеб. пособие. — М.: МФТИ, 2010. — 216 с.

1$ВМ 978-5-7417-0266-6

Кратко изложен теоретический материал, включая необходи-

мые сведения по теории вероятностей. Разобраны примеры и за-

дачи по основным разделам курса «Стохастические процессы»,

читаемого автором студентам МФТИ. Также предлагаются уп-

ражнения для самостоятельной работы, приведена программа

курса и два контрольных задания.

Предназначено для студентов, изучающих теорию случайных

процессов.

УДК 519.216.2(075)

ББК 22.171я73

1581‘! 978-5-7417-0266-6 © Булинский А. В., 2010

© ГОУ ВПО «Московский физико-технический институт

(государственный университет)», 2010

Глава

Глава

Глава

ОГЛАВЛЕНИЕ

Предисловие . . . . . . . . . . . . . . . . . . . . . 6

1. основы ТЕОРИИ ввроятноствй . 9

1.1. Системы множеств. Мера.

Вероятностное пространство . . . . . . . . . . . . 9

1.2. Измеримые отображения. Распределение

случайной величины . . . . . . . . . . . . . . . . . . 14

1.3. Интеграл Лебега . . . . . . . . . . . . . . . . . 20

1.4. Случайные векторы . . . . . . . . . . . . . . . 29

1.5. Семейства независимых случайных величин . 32

1.6. Сходимость случайных величин. Предельные

теоремы . . . . . . . . . . . . . . . . . . . . . . . . . 36

2. ПРИМЕРЫ СЛУЧАЙНЫХ ПРОЦЕССОВ 42

2.1. Случайные функции и их свойства . . . . . . 42

2.2. Построение последовательности независимых

случайных величин с заданными распределениями 51

2.3. Случайные блуждания. Задача о разорении

игрока . . . . . . . . . . . . . . . . . . . . . . . . . . 59

2.4. Процессы восстановления . . . . . . . . . . . . 65

2.5. Модель Крамера—Лундберга в теории

страхования . . . . . . . . . . . . . . . . . . . . . . 71

3. ГАУССОВСКИЕ ПРОЦЕССЫ И

ПРОЦЕССЫ С НЕЗАВИСИМЫМИ

ПРИРАЩЕНИЯМИ . . . . . . . . . . . . . . . . 77

3.1. Согласованные вероятностные меры . . . . . 77

3.2. Гауссовские системы . . . . . . . . . . . . . . . 78

3.3. Процессы с независимыми приращениями . . 86

3.4. Пуассоновский процесс и порождаемые

им стохастические модели . . . . . . . . . . . . . . 92

3.5. Процесс Леви . . . . . . . . . . . . . . . . . . . 102

Глава 4. винвговский пгоцвсс . . . . . . . . 105

4.1. Эквивалентные определения винеровского

процесса . . . . . . . . . . . . . . . . . . . . . . . . 105.

4.2. Непрерывная модификация броуновского

движения . . . . . . . . . . . . . . . . . . . . . . . . 108

4.3. Явная конструкция винеровского процесса

на [О‚ 1] . . . . . . . . . . . . . . . . . . . . . . . . . 112

4.4. Свойства винеровского процесса . . . . . . . . 116

4.5. Процесс Орнштейна-Уленбека. Броуновский

мост . . . . . . . . . . . . . . . . . . . . . . . . . . . 123

Глава 5. МАРТИНГАЛЫ . . . . . . . . . . . . . . . . . 126

5.1. Условное математическое ожидание и его

свойства . . . . . . . . . . . . . . . . . . . . . . . . 126

5.2. Фильтрация. Марковские моменты . . . . . . 133

5.3. Примеры мартингалов, субмартингалов,

супермартингалов . . . . . . . . . . . . . . . . . . . 138

5.4. Свойства мартингалов . . . . . . . . . . . . . . 143

Глава 6. МАРКОВСКИЕ ПРОЦЕССЫ . . . . . . . 148

6.1. Определение марковского процесса. Примеры 148

6.2. Марковские цепи . . . . . . . . . . . . . . . . . 153

6.3. Эргодическая теорема . . . . . . . . . . . . . . 159

6.4. Дифференцируемость переходных

вероятностей . . . . . . . . . . . . . . . . . . . . . . 161

6.5. Уравнения Колмогорова . . . . . . . . . . . . . 167

Глава 7. СТАЦИОНАРНЫЕ ПРОЦЕССЫ . . . . . 173

7.1. Ортогональные случайные меры и их свойства 173

7.2. Интеграл по ортогональной случайной мере . 176

7.3. Стационарные в широком смысле процессы,

их спектральное представление . . . . . . . . . . . 179

7.4. Процессы, стационарные в узком смысле . . . 186

Глава 8. СТОХАСТИЧЕСКИЙ АНАЛИЗ . . . . . . 191

„ 8.1. Построение и свойстваинтеграла Ито . . . . 191

8.2. Формула Ито . . . . . . . . . . . . . . . . . . . 196

8.3. Стохастические дифференциальные уравнения 200

8.4. Некоторые задачи стохастической финансовой

математики . . . . . . . . . . . . . . . . . . . . . . 205

Программа курса “Стохастические

процессы” . . . . . . . . . . . . . . . . . . . . . . . 208

Задание 1 . . . . . . . . . . . . . . . . . . . . . . . . 209

Задание 2 . . . . . . . . . . . . . . . . . . . . . . . . 212

Литература . . . . . . . . . . . . . . . . . . . . . . 215

ПРЕДИСЛОВИЕ

Данная книга является учебным пособием по вводному

курсу "Случайные процессы", читаемому автором для сту-

дентов МФТИ. Основное внимание уделяется решению задач,

но в то же время каждыи раздел снабжен кратким изложе-

нием основных теоретических сведении и примерами, их по-

ясняющими. Наряду с детально разобранными примерами и

задачами предлагаются упражнения для самостоятельнои ра-

боты (наиболее трудные отмечены ~). Приводится также про-

грамма лекции и два контрольных задания.

Для успешного изучения теории случайных процессов чи-

татель должен владеть материалом предшествующего курса

теории вероятностей. Поэтому было бы желательно по мере

необходимости обращаться к соответствующим учебникам, и

в этой связи рекомендуктся книги [1], [8] — [12].

Пособие состоит из 8 глав, деление материала на разделы

в основном соответствует учебнику [2]. Первая глава содер-

жит краткие сведения из курса теории вероятностей. Точнее

говоря, напоминаются важнеишие конструкции, связанные с

аксиоматикой Колмогорова, а также основные понятия, отно-

сящиеся к случайным величинам и векторам (независимость,

интегрируемость и другие). Для активизации данных сведе-

нии, с которыми студенты младших курсов обычно недоста-

точно знакомы, предложен ряд упражнении.

В главе 2 вводятся главные объекты теории действитель-

ных случаиных процессов, а также показывается, как многие

интересные для приложении модели задаются с помощью по-

следовательностей независимых случайных величин. Разбира-

ется элементарное построение таких последовательностеи, не

опирающееся на фундаментальную теорему Колмогорова о со-

гласованных распределениях. Среди предложенных примеров

отметим случаиные блуждания и классическую задачу о ра-

зорении игрока, процессы восстановления и модель Крамера—

Лундберга, применяемую в страховании. Затрагивается и су-

щественный вопрос о выборе модификации процесса.

В главе З рассматриваются гауссовские процессы и про-

цессы с независимыми приращениями, в частности, пуассо-

новский процесс, а также процессы Леви. Вначале напоми-

нается теорема Колмогорова о согласованных распределениях

и дается ее эквивалентная формулировка в терминах харак-

теристических функций мер на евклидовых пространствах.

Последняя позволяет легко установить существование важных

классов зависимых случайных величин. Подробно прослежи-

вается явная конструкция пуассоновского процесса по после-

довательности независимых экспоненциальных величин (как

процесса восстановления) и проверяется независимость его

приращений.

Глава 4 посвящена широко используемому в различных

приложениях винеровскому процессу (или процессу броунов-

ского движения). Показано, что этот процесс эквивалентным

образом описывается как гауссовский процесс с нулевым сред-

ним и определенной ковариационной функцией, а также как

процесс с независимыми гауссовскими приращениями опреде-

ленного вида, начинающийся из нуля в нулевой момент вре-

мени. Излагается построение винеровского процесса по функ-

циям Шаудера и последовательности независимых стандарт-

ных нормальных величин, приводящее к процессу с непрерыв-

ными траекториями. Здесь же дается и теорема Колмогорова

о существовании непрерывной модификации процесса. Обсу-

ждаются задачи, связанные с выходом винеровского процесса

на заданный уровень.

В главу 5 отнесено знакомство с мартингалами, являющи-

мися важным примером систем зависимых случайных вели-

чин. В этой связи подробно рассматривается аппарат услов-

ных математических ожиданий. Большое внимание уделяется

фильтрации и марковским моментам (моментам остановки).

формулируется теорема Дуба об остановке и рассматрива-

ются некоторые ее применения. Мартингальными методами

решаются задачи о разорении игрока, а также оценивается ве-

роятность разорения страховой компании в модели Крамера-

Лундберга.

В главе 6 фигурируют марковские процессы как с непре-

рывным, так и дискретным временем. Главным образом ис-

следуются цепи Маркова с конечным или счетным простран-

ством состояний. Эти процессы находят применения в самых

разнообразных областях. Из затронутых тем следует отме-

тить варианты построения марковских цепеи как по переход-

ной матрице и начальному распределению, так и по инфини-

тезимальной матрице (конструкция Дуба), а кроме того, эр-

годическую теорему и дифференциальные уравнения Колмо-

горова.

Глава 7 содержит материал, относящийся к теории стаци-

онарных процессов. Здесь вводится нетривиальное понятие

спектрального представления случаиного процесса в виде ин-

теграла по ортогональной случайной мере. Для этого исполь-

зуются теоремы Карунена, Герглотца и Бохнера — Хинчина.

Изучается и класс процессов, стационарных в узком смысле,

даются примеры таких процессов и отмечается их связь с пре-

образованиями, сохраняющими меру.

Наконец, заключительная глава 8 предлагает начальные

сведения о стохастическом анализе и сильном решении стоха-

стических дифференциальных уравнений. Акцент сделан на

построении интеграла Ито, а также на формуле Ито, явля-

ющеися краеугольным камнем стохастического исчисления.

Анализируется известное уравнение Ланжевена, приводящее

к процессу Орнштейна — Уленбека. Очень сжато дается пред-

ставление о возможных применениях в стохастической финан-

совой математике, например, в рамках модели финансового

рынка Блэка — Шоулса — Мертона.

Автор признателен своим друзьям и коллегам за обсужде-

ние рассматриваемого круга вопросов. Особая благодарность

брату и сестре — Александру и Екатерине Булинским, про-

фессорам кафедры теории вероятностей мехмата МГУ, без

поддержки которых проект книги не был бы осуществлен.

Андрей Булинскии,

доцент кафедры высшей математики МФТИ

Глава 1. ОСНОВЫ ТЕОРИИ ВЕРОЯТНОСТЕЙ

1.1. Системы множеств. Мера.

вероятностное пространство

Напомним ряд важнейших определений. Пусть (5213) —

измеримое пространство, т.е. в (непустом) множестве Б’ вы-

делена некоторая система В его подмножеств, образующих а-

алгебру. Это означает, что И Е В, а если А Е В, то дополнение

Й := 5 \А Е В, и для последовательности А1, А2, . .. Е В имеем

Ш:°=1А„ Е В (тогда автоматически система В будет замкнута

и относительно конечных объединений ее элементов, а также

относительно конечных и счетных пересечений1).

Для произвольной системы М подмножеств 5’ существует

порожденная ею о-алгебра, обозначаемая о{М}. Это наи-

меньшая о-алгебра, которая содержит данную систему (о{М}

есть пересечение всех о-алгебр подмножеств 5, которые со-

держат М). В частности, наименьшая о-алгебра подмножеств

К, содержащая все открытые интервалы (а, Ь), называется

борелевской о-алгеброй подмножеств прямой и обозначается

В Известно, что БЫК) порождается и другими системами,

например, совокупностью всех полупрямых вида (—оо, ш], где

а: Е К. Если 5 — метрическое (или, более общим образом, то-

пологическое) пространство, то о-алгебру, порожденную си-

стемой открытых подмножеств, обозначают В(Б'), а её эле-

менты носят название борелевскиа: подмножеств 5.

Система 1С подмножеств Б’ называется полукольцом, если

выполнены следующие условия: 1) если А, В Е 1С, то АПВ Е 1С;

2) если А,В Е 1С И А С В (всюду пишем С вместо Е), то В\А

можно представить в виде конечного объединения попарно не-

пересекающихся элементов 1С. В главе 7 будут использованы

такие системы. Совокупность полуинтервалов вида (а, Ь], где

—оо < а Е Ь < оо, дает важный пример полукольца подмно-

жеств К

1Замкнутость системы подмножеств пространства 5’, содержащей И,

относительно взятия дополнения и конечных объединений и пересечений

означала бы, что данная система образует алгебру.

Мера Лебега и на (К", В(Е")), где и Е И, задается вначале

на прямоугольниках вида С = (а1,Ь1] х ... х (а„, Ь„], причем

а), < Ь~, Й = 1, ..., и, следующим образом:

П

р(с):= П(6~ — а~).

й=1

Затем она однозначно продолжается (см., напр., [5, с. 317]) на

В(~"). При этом р(~") = оо, но получается о-конечная мера,

т.е. ~" можно разбить на счетное число борелевских множеств

(например, кубов с ребрами единичной длины), имеющих ко-

нечную меру Лебега. Мера Лебега на В(С), где С вЂ” борелев-

ское подмножество Е", является ее сужением с В(~") на В(С)

(см. упр. 3).

Определение 2. Вероятностью называется мера и, для

которой р(Я) = 1.

Тогда по традиции вместо и пишут Р (от английского ртоЬ-

аЬййу). Доказывается, что для конечной меры и (т.е. при

рф) ( оо) счетная аддитивность равносильна одновремен-

ному выполнению двух своиств — конечнои аддитивности и

непрерывности. Последнее означает, что для А1,А2,... Е В

таких, что А„< 1 С А„при всех и Е 1Ч,

Вероятностное пространство (Й,У, Р) вводится как из-

меримое пространство (Й, У), на котором задана вероятность

Р. Здесь Й вЂ” пространство элементарных исходов (некото-

рого случайного эксперимента), элементы которого (исходы)

обозначаются и. Подмножества Й, входящие в У', называются

событиями. Описание случайных экспериментов с помощью

вероятностных пространств было предложено А.Н. Колмого-

ровым. Перечисленные выше требования к событиям и веро-

ятности носят название аксиоматики Колмогорова.

Если Й состоит из конечного или счетного числа эле-

ментарных исходов, а У содержит все подмножества Й, то

11

(Й,Г, Р) называется дискретным вероятностным простран-

ством. При этом, обозначив р), = Р((и),)), имеем

упражнение 4. Убедитесь, что располагая неотрицатель-

ными числами р), (Й = 1,2,...), в сумме дающими единицу,

можно построить дискретное вероятностное пространство с

помощью формулы (2).

В частном случае, когда Й = (и1, ..., иу) и каждому ис-

ходу приписанавероятность ~ (т.е. р~ = ~ для )с = 1,...,Ж),

1 1

имеем Р(А) = — ~~ —, где К(А) — число элементарных исходов,

К(А)

составляющих событие А. Эта формула носит название клас-

сического определения вероятности.

Вероятность обладает рядом простых свойств. Например,

Р(А) < Р(В), если А с В (А и  — события). Сдбаддитив-

ность вероятности означает, что для любого конечного или

счетного набора событий А1,А2,... верно неравенство (убе-

дитесь в качестве упражнения)

При подсчете вероятности некоторого события А часто

используется введение вспомогательного разбиения простран-

ства Й на события В1, В2,..., т.е. Й = 0„В„, причем В;) ') В

= Я при г ~ у, а затем в силу счетной (а значит, и конечной)

аддитивности вероятности применяется равенство

Р(А) = ~ Р(А и В„),

(4)

12

часто мы пишем АВ вместо АПВ, а иногда и Р(А, В, С) вместо

Р(АПВПС).

Вез ограничения общности будем далее предполагать, что

вероятностное пространство пояно, т.е. любое подмножество

события нулевой вероятности входит в о-алгебру Т и, следо-

вательно, также имеет вероятность нуль. При этом говорят,

что вероятностная мера Р полна.

Упражнение 5. Показать, что, добавив в ‚Т все подмно-

жества событий нулевой вероятности, образующие класс А/

нулевыа: множеств, мы получим о-алгебру 7 = ‚77 Ш АТ. Про-

верить, что если положить Р(С') := Р(А) для С = А Ц В, где

А Е Т и В Е М, мы получим корректно заданноег продол-

жение исходной вероятности Р с У: на 7, которое окажется

полной вероятностной мерой.

У словнал вероятность А при условии В определяется фор-

мулой

Р А В

Р(А|В) := Щ, где А,Б Е 7: И Р(Б) 75 О. (5)

Р(В)

Если дано разбиение О на события В1,В2, . . . , имеющие поло-

жительную вероятность, то из (4) и (5) мы сразу же получаем

формулу полной вероятности:

Р(А) = Е) Р‹А|в„)Р‹в„›. (в)

Говорят, что событие А не зависит от события В, если

Р(А|В) = Р(А). Однако более удобное определение независи-

мости А и В (оно симметрично и не предполагает, что веро-

ятности рассматриваемых событий не равны нулю) таково:

Р(А П В): Р(А)Р(В).

Определение 3. Семейство {Адй Е Т} состоит из незави-

симыа: (в совокупности) событий, если для любого конечного

множества индексов „Т С Т имеем

Р (П м) = Прод).

16.1 $61

2т.е. С = 241051 = 242 032, Где А: Е 7 И В; Е М `5 = 1,2), влечет

Р(А1)= Р(А2).

13

Часто независимые события возникают при рассмотрении

произведений вероятностных пространств (см. далее теорему

Фубини в пункте 1.5).

Нам потребуется также

Лемма 1 (Борель-Кантелли).

1. Пусть событпия А1, А2,... таковы, что ~; Р(А„) ( оо.

п=1

Тогда Р(А) = О для

А=П ДА

п=1 т=п

2. Если А1,А2, ... — независимые события и ~ Р(А„) = оо,

п=1

то Р(А) = 1, где А фигурирует в (7).

Если какое-то свойство выполнено для элементарных ис-

ходов, образующих событие вероятности единица, то гово-

рят, что это свойство имеет место почти наверное (п.н.).

Первое утверждение леммы Бореля — Кантелли означает (см.

упр. 1), что бесконечное число событий из последовательно-

сти А1, А2,... происходит с нулевой вероятностью, а второе

— что почти наверное.

1.2. Измеримые отображения. Распределение

случаинои величины

Понятие случайной величины было введено для того, чтобы

количественно описывать результаты случаиных эксперимен-

тов. Простейшие примеры таких величин — это количество

выпавших "гербов" при подбрасывании монеты и раз или раз-

мер выигрыша в лотерею какого-то определенного м участ-

ника. Для развития теории важную роль играет

Определение 4. Случайная величина Х вЂ” это действи-

тельная функция, заданная на Й и обладающая свойством из-

меримости, т.е. прообраз любого борелевского множества

прямой является событием (пишут Х Е У~в(Е)). Другими

словами, для любого В Е 8(Е) его прообраз

Х (В):= (Х е В) = (и: Х(и) е В) е У. (8)

14

Легко видеть, что на дискретном вероятностном про-

странстве любая действительная функция будет случайной ве-

личиной.

Распределением случайной величины Х называется мера

Р х на (К, Б(1К)), определяемая формулой

РХ(В) ;= Р(Х’1(В))‚ в е ваш). (9)

Часто вместо Р Х пишут Ьаш(Х), при этом говорят о законе

распределения величины Х.

Упражнение 6. Проверить, что формула (9) задает веро-

ятность на (К, ВСЮ).

Случайная величина Х называется бернуллиевсной (с па-

раметром р Е (О, 1)), если

Р(Х=1)=р‚ Р(Х=О)=1—р.

Говорят, что У имеет биномиальное распределение с пара-

метрами п Е М и р Е (О, 1) (пишут У ы В(п,р)), если

Ре’ = к) = 0‚’:р"‹1 -р)""°‚ к = о‚...‚п‚

к _ ! .

где 0„ — 7-й“ п"; ‚с ! (как обычно, О! .= 1).

Запись 2 ы Ро1з(>\) означает, что случайная величина 2

имеет распределение Пуассона с параметром А > О, т.е.

Р(2=п)=—е"›‘, п=О,1,....

Упражнение 7 . Доказать, что справедливость (8) для ка-

ждого В Е ВПК) равносильна тому, что Х "1(С') Е Т для лю-

бого С’ из системы М, порождающей В

Последнее упражнение показывает естественность данного

определения иэмеримости. Действительно, на практике мы

сталкиваемся с необходимостью ответить на вопрос, лежит ли

измеряемое значение случайной величины в некотором интер-

вале (а, Ь). Например, можно ли утверждать, что с вероятно-

стью, близкой к 0,99, время исправной работы электрической

лампочки будет больше, чем в часов (в данном случае интере-

сующий нас интервал — это (з, 00))?

15

Отметим также„ что в ряде случаев можно говорить и о

вероятности попадания значений случайной величины в мно-

жества, не входящие в борелевскую а-алгебру. Простейший

пример такого рода представляет (вырожденная) случайная

величина Х = с, где с — некоторая константа. Тогда для

любого В С К, очевидно, Р(Х Е В) есть единица или нуль в

зависимости от того, принадлежит или нет константа с этому

множеству.

Упражнение 8. Постройте пример невырожденных слу-

чайных величин Х и У, определенных на одном и том же ве-

роятностном пространстве и таких, что для некоторого мно-

жества С’ Е ВПК) имеем Х‘1(С') Е Т, но У’1(С') Е 7’.

Пример 1. Пусть 62 — вероятностная мера на (К, ВСЮ).

Покажем, что на некотором вероятностном пространстве най-

дется случайная величина Х, для которой Р х = О.

Выберем О = К, ‚77 = ВПК), Р = 62, а Х = 1 — тождествен-

ное отображение К в себя. Легко видеть, что это — искомая

случайная величина.

Заметим, что сказанное допускает обобщения на случай-

ные векторы.

Случайные величины образуют линейное пространство

(сумма случайных величин и произведение случайной вели-

чины на константу являются случайными величинами).

Функция распределения случайной величины Х определя-

ется формулой

Рх(а:) := Рх((—оо,а:]) = Р(ш : Х(ш) < 2:), а: Е К.

Эта функция обладает следующими свойствами:

1) не убывает на 112;

2) непрерывна справа в каждой точке а: Е К;

3) Нш Рх(:1:)=0;

Ф-ё-ОО

4) 11111 Рх(а:) = 1.

Ф-РОО

Более того, любая функция с такими свойствами может слу-

жить функцией распределения некоторой случайной вели-

16

чины. Заметим,что

Рх((а, Ь]) = Ру(Ь) — Рх(а) для — оо < а < Ь < оо,

поэтому по Рх мера Рх однозначно восстанавливается на

(К,н(К)). Здесь применяется теорема Каратеодори об одно-

значном продолжении вероятностнои меры с полукольца мно-

жеств на порожденную им о-алгебру (см., напр., [1, с. 419]).

Плотность (распределения) случайной величины Х вЂ” это

такая неотрицательная функция р = р~ на К, что при всех

хЕК

гх(х) = р(и) аи.

( — оо, х]

(10)

Разумеется, плотность существует не у каждой случайной ве-

личины. Интеграл в (10) понимается как интеграл по мере

Лебега на (К, 8(К)) от функции рП~ ], где Пн — индикатор

множества В, т.е. Пд(и) = 1 для и Е В и Пд(и) = 0 в против-

ном случае. Чтобы сейчас не отвлекаться на детали, можем

ограничиться рассмотрением кусочно-непрерывных функций

р, для которых интеграл Лебега в (10) совпадает с (несоб-

ственным) интегралом Римана.

Плотность р является неотрицательной интегрируемой

функцией такой,что

(и)

(где по-прежнему берется интеграл по мере Лебега, постро-

ение которого дано в следующем пункте). Обратно, любая

неотрицательная функция со свойством (11) может служить

плогностью распределения некоторои случжнои величины.

Случайная величина Х называется равномерно распреде-

ленной на отрезке [а, Ь] (где а < Ь), если ее плотность дается

формулой

для и Е [а,Ь],

0 для и ф [а, Ь].

Случайная величина У имеет показательное (зкспонен-

ииальное) распределение с параметром А ) 0 (тогда пишут

17

У м Ехр(А)), если

О дляи<О,

рус”) = {Ае”`“ для и 2 0. (13)

Напомним также, что величина 2 называется гауссовской

(или нормальной) с параметрами а и 02, где а Е К и а > О,

если

р2(и) = 0357? ехр{— Шёг-Ё} , и Е К. (14)

Используется обозначение 2 м А/(а, 02). Обычно в семейство

гауссовскиэс включают и величину АТ (а, О), полагая, что в этом

случае (т.е. при 02 = О) имеем 2 = а п.н.

Величина У имеет распределение Коши с параметром а > О

(стандартное при а = 1), если ее плотность

, и Ё К. $

Пишут 5 ы Г(а, А) и говорят, что случайная величина 5

имеет гамма-распределение с параметрами а > О И А > О,

если '

Рт/(и) =

а а—1

11504) = 14:33“ е—’\ип[о,оо)(и)‚ и Е К, (15)

где гамма-функция Эйлера

Х

Г(а) :=] и°`1е"" от.

О

В частности, при а = т‘ (т — натуральное число) и А = ё

получается часто используемое в математической статистике

распределение зги-квадрат с т‘ степенями свободы, т.е. распре-

деление суммы квадратов т‘ независимых нормальных величин

с параметрами О и 1.

Упражнение 9. Проверьте, что функция, задаваемая

формулой (14), удовлетворяет соотношению (11).

Определение 5. Функция 1‘ : К —› К называется борелев-

ской, если для любого В Е ВПК) его прообраз 1‘ ’1(В) Е ВПК).

Это определение переносится на функцию 1‘, отображаю-

щую метрическое пространство 51 в метрическое простран-

18

ство 52 (оба пространства снабжаются а-алгебрами борелев-

ских множеств). А именно, требуется, чтобы прообраз ка-

ждого борелевского множества из 52 был борелевским множе-

ством в 51. В частности, в определении 5 мы рассматривали

в качестве 51 и 52 числовую прямую К с ее борелевскими под-

множествами В(К) (см. также упр. З).

Упражнение 10. Пусть Х — случайная величина со зна-

чениями в борелевском множестве С‘ и 1‘ : С‘ —-› К — борелев-

ская функция. Проверить, что 1‘ (Х) — случайная величина.

Замечание 1. Результат этого упражнения легко обобща-

ется на суперпозиции п измеримых отображений произволь-

ных измеримых пространств. Например, пусть даны измери-

мые пространства (5‚„В;„)‚ где 1: = 1,2,3, а [1 : 51-—› 52 и

12 : 52 +-› 53, причем Д, 12 являются соответственно В1|В2- и

ВДВЗ-измеримыми. Тогда отображение [2 о Д : 51 —› 53 будет

БЦВЗ-игмеримо (т.е. {аз Е 51 : 1201 (13)) Е В} Е 81 для любого

В Ё 83 .

Пример 2. Пусть С Е Б(К) и 1 : С —› К — Неубывающая

функция. Докажем, что она борелевская.

В силу упр. 7 достаточно проверить, что прообраз множе-

ства (—оо‚а:] входит в Б(С') для каждого а: Е К Множество

А = {и Е С‘: [(21) < аз} имеет вид ОП (—оо,а) или ОП (—оо,а],

поскольку функция 1‘ не убывает, здесь а = а(а:) Е К Следо-

вательно, А Е В (С) согласно упр. 3.

Упражнение 11. Пусть 51,52 — метрические простран-

ства и 1‘ : 51 -—› 52 — непрерывное отображение. Проверить,

что 1‘ — борелевская функция.

Упражнение 12. Пусть случайная величина Х равно-

мерно распределена на отрезке [—1, 1]. Найти распределение

случайных величин У = Х 2 И 2 = $111 Х.

Полезно ввести следующее понятие. Расширенной случай-

ной величиной называется функция 2 : О —› [—оо,оо] такая,

что {2 Е В} Е Т для любого В Е В(К), а также {2=—оо} Е ‚77

и {2 = со} Е 7.

19

1.3. Интеграл Лебега

Математическое ожидание случайной величины Х зада-

ется формулой ‘

ЕХ=]ХаР,

о

т.е. представляет собой интеграл Лебега от (измеримой!)

функции Х = Х (ш) по мере Р. Этот интеграл (пишут также

[О Х (ш)Р(с1ш)) определяется в три этапа.

Вначале для простой случайной величины вида

п

Х = Е ‘ИСЛАМ

1с=1

где события А1,. . . ‚Ад образуют разбиение П, а1,.. . ,а„ЕК+‚

„п 6 М, полагаем

‘П

ЕХ = :а‚„Р(А‚„). (17)

1с=1

Далее для любой неотрицательной случайной величины Х

определяем

ЕХ=вир{ЕУ: УЕР, О<У<Х}н<оо,

где ‘Р — класс простых случайных величин. Наконец, знакопе-

ременную величину Х записываем в виде Х = Х + — Х “, где

Х+ := ХДХЗО} и Х“ := —ХП{Х<0}. Теперь вводим

ЕХ := ЕХ+ - ЕХ‘,

если не возникает ситуация оо — оо. В последнем случае го-

ворят, что ЕХ не существует (считается, что оо — с := оо, а

с — оо := —оо для любого числа с 6 К).

Упражнение 13. Объясните, почему определение (17) не

зависит от представления Х в виде линейной комбинации ин-

дикаторов событий, образующих разбиение, т.е. если Х =

= Ё 65113„ где В1,...,В„, —еразбиение О и Ь1,...,Ьт Е Щ, то

3:1

ЕХ = Ё”: ЬдР(В,) совпадает с (17).

5:1

20

упражнение 14. Покажите, что определение (17) будет

деиствовать и для знакопеременнои простои случжнои вели-

чины Х, т.е. когда а1,..., а„Е К.

упражнение 15. Постройте неубывающую последова-

тельность неотрицательных простых величин Х„, сходя-

щихся на Й к данной случайной величине Х > О, т.е.

О < Х„(и) < Х„»1(и) и Х„(и) -+ Х(и) при всех и Е Й (пи-

шем О < Х„,Р Х при такой монотонной сходимости).

Теорема 1. Пусть О < Х1 < Х2 < ... / Х на Й. Тогда

существует

(18)

ЕХ = 11т ЕХ„.

7$~0О

ирако используется и теорема Лебега о мажорируемой

сх имости:

Теорема 2. Пусть случайные величины Х, У и Х„, где

и Е И, таковы, что Մ— ~ Х на Й при и ~ оо, причем

~Х„~ < У и ЕУ < оо. Тогда Х вЂ” интегрируемая величина

и выполнено

Совокупность случайных величин, заданных на одном ве-

роятностном пространстве и для которых конечно математи-

ческое ожидание, обозначается Ь1 = Ь1(Й, У, Р). Величины из

Ь называются интегрируемыми. Точнее говоря, мы не разли-

1

чаем при этом случайные величины Х и У, которые являются

21

упражнение 16. Докажите, что для произвольной после-

довательности простых величин О < Х„,Р Х верно соотноше-

ние ЕХ = 11т ЕХ„.

И-+ ОО

В связи с механической интерпретацией формулы (17) (как

центра тяжести системы материальных точек а1,..., а„, в ко-

торых соответственно сосредоточены веса Р(А1),..., Р(А„))

математическое ожидание называют средним значением слу-

чайной величины, или просто средним.

Полезной является теорема о монотонной сходимости, где

(Х„)„~~ — последовательность случайных величин (необяза-

тельно простых в отличие от упр. 16):

следовательно, ОХ е [О, оо]. Обычно говорят, что диспер-

сия существует, если она конечна. Механическая интерпрета-

ция введенной характеристики такова: дисперсия — это мо-

мент инерции некоторой системы материальных точек (отно-

сительно центра тяжести). Заметим, что ОХ = ЕХ2 — (ЕХ)2.

Пример 3. Найдем дисперсию бернуллиевской величины Х .

Имеем ЕХ = 1 - р + О - (1 — р) = р. Величина Х 2 принимает

соответственно значения 12 = 1 с вероятностью р и 02 = О с

вероятностью 1 — р. Поэтому ОХ = р — р2 = р(1 — р).

Пусть Ь : К —› К является вьшуклой функцией, т.е.

Мая: + (1 — а)у) < а/ъ(:с) + (1 — а)/ъ(у)

для всех 1:, у Е К и а е [О, 1]. Тогда, если ЕХ конетшо, то верно

неравенство Йенсена:

МЕХ) < Е(Н(Х))- (21)

НЗЛОМНИМ еще НОСКОЛЬКО ВЕЪЖНЫХ СВОЙСТВ математического

ожидания:

1) если величина Х интегрируема и Р(С') = О, то

Х Ха!Р ;= ЕХПС = о; (22)

С

2) если Е|Х| = О, то Х = О п.н.;

3) если величины Х и У таковы, что Х интегрируема, а также

У = Х п.н., то У интегрируема и ЕУ = ЕХ;

4) если величины Х и У интегрируемы и Х < У п.н., то

ЕХ < ЕУ;

5) если Х 1, Х2, . .. — неотрицательные случайные величины,

ТО

Е (Е: м) = 2 ЕХ„. (23)

п=1 п=1

При этом допускается случай оо = оо.

Х

Если правая часть (23) конечна, то 2 Хд < оо п.н. Мы поль-

п=1

зуемся тем, что для неотрицательной расширенной случайной

23

величины 2 точно так же можно ввести математическое ожи-

дание (если оно конечно, то 2 < оо п.н.). Как правило, все рас-

сматриваемые далее расширенные случайные величины оказы-

ваются конечными п.н. (иначе говоря, 2 совпадает с некото-

рой действительной случайной величиной Х на событии, име-

ющем вероятность единица).

Для знакопеременных случайных величин соотношение

Х

(23) верно, когда Е Е|Х„| < оо.

п=1

Аналогитшо 131 вводится пространство П’ = ЬРЮД’, Р),

где р > О, состоящее из (классов эквивалентных) случайных

величин таких, что Е|Х|р < оо. Пространство П’ при р 2 1

будет банашовьъм, если ввести (на классах эквивалентности!)

норму ||Х_||‚, := (Е|Х |1’)1/". Пространство 1,2 со скалярным

произведением (Х, У) := ЕХУ является гильбертовым.

Отметим, что из (21) следует неравенство Ляпунова:

ПХНр < НХНа при 1 < р < а-

Если 5 = Х +221’, где Х, У — интегрируемые действитель-

ные случайные величины, а 12 = —1, то полагают

ЕБ‘ ;= ЕХ + игу. (24)

Интеграл по конечной, но необязательно вероятностной,

мере и на (5, В) (О < 1/(5) < оо) задается формулой

/ 1‹ш›и«2а=›==и‹з›/теориям,

$ 5

где Р(В) := 1; Ё , В Е В (или эквивалентным образом все

три этапа построения математического ожидания можно по-

вторить и для и). Разумеется, не каждая измеримая функция

1‘ будет интегрируемой по заданной мере.

Для борелевской4 функции Ь, : К —› К справедлива формула

Ещх) = /1ъ(а:)Рх(с1а:), (25)

К.

4В частности, кусочно-непрерывная функция п — борелевская.

24

где оба интеграла существуют или не существуют одновре-

менно (и если существуют, то равны). Учитывая, что рас-

пределение Р х однозначно связано с функцией распределения

РХ(-) случайной величины Х, вместо интеграла в правой ча-

сти (25) пишут [к /ъ(а:)с117`х

Если у величины Х существует плотность р, то

Ещх) = / носиками. ‹2в›

В

Эта формула — частный случай общей формулы перехода

к интегрированию по новой мере, относительно которой абсо-

лютно непрерывна5 исходная мера. В (26) (и далее в (32)) фи-

гурируют интегралы, берущиеся по мере Лебега. Они опреде-

ляются для о-конечной меры и на (5313) аналогично интегралу

по конечной мере, а именно, рассматривается разбиение про-

странства 5 на счетное число попарно непересекающихся мно-

жеств В1,В2, . .. Е В, для которых и(В;„) < оо при всех А: Е М,

а затем для измеримой 1’ 2 О вводится

А утомит) == г: А хжв, мат),

где 1‘ |в‚„ — сужение функции 1‘ на множество Вд, щ, — суже-

ние меры и на (Вд, В П Вд). Доказывается, что результат не

зависит от выбора разбиения пространства Б’. Для знакопере-

менной функции 1 интеграл вводится по той же схеме, что и

при построении ЕХ, когда Х имеет значения разных знаков.

Упражнение 17. Объясните, почему у дискретной слу-

чайной величины (т.е. принимающей конечное или счетное

число различных значений) не существует плотности.

Упражнение 18. Постройте такую измеримую функцию

1‘ : К —› К, а также меры и и 1/ на пространстве (К, В (ЕЮ), для

которых [к [ст существует, но [в 1” йи не существует.

5Это понятие дается в пункте 5.1.

25

где

РС~„= Р(б) С(о) — Р(а) С(а).

х(1 — Ру (х) ) ах.

соч(Х,У):= Е(Х вЂ” ЕХ)(У вЂ” ЕУ) = ЕХУ вЂ” ЕХЕУ. (29)

Ковариация представляет собой билинейную функцию. Оче-

видно, дисперсия Х задается формулой 0Х: = соч(Х, Х).

Для случайных величин из пространства Ь~ ковариация су-

ществует и, более того,

~ соч(Х, У) ~ < (0Х 0У)

поскольку в силу неравенства Коши — Буняковского — Шварца:

(Х,У) < ))Х~)~~У~~

(норма и скалярное произведение в Ь2 были введены ранее).

Если Х Е Ь~ и константа с Е К, то

0(сХ) = с20Х, 0(Х+ с) = 0Х.

Для величин Х1,..., Х„~ Ь~, полагая

.7 = (а,~ Е (1,..., п), з ф- Д,

можем записать

'й П

о Кх, =Кох„»- К ч~х,х,).

й=1 1=1 ~,~Е .7

(30)

В заключение этого раздела приведем часто используемый

результат.

27

В частности, отсюда можно получить, что для случайной

величины Х аосолютный момент порядка т (т Е Щ

Е~Х~~ = т х~ 1(1 — Р~(х) + Гх( — х))Их.

(О,оо)

Для неотрицательной случайной величины Х имеем

ЕХ = (1 — РА.(х))дх, ЕХ = 2

(О, оо) (О, оо)

Если для случайных величин Х и У существуют ЕХ, ЕУ и

ЕХУ, то ковариаиией Х и У называется число

Теорема 3 (Фубини). Пусть 01 и 02 — вероятностные

меры соответственно на измеримыа: пространстваа: (Б1,Б’1)

и ($2,Б2). Тогда справедливы следующие утверждения:

1) на пространстве (5, В) = (51 х 52,31 ® 82) существует

единственная вероятность Р, обозначаемая 01 ® (22, та-

ная, что

Р(В1 >< 32) = О1(В1)О2(В2)

для любыа: Б1 6 81 и [32 6 232;

2) если 1’ : 5 —› К интегрируема по мере Р (а значит, и В-из-

мерима), то отображения

$1 :—› __1"(:1:1,$2)О2(д:с2) и $2 э—›/ [(ш1,:1:2)О1(д:с1)

52 ' 51

являются соответственно В1- и В2-измеримыми и

А1'($)Р(д$)=[91 ([921°($1›$2)02(д$2)) 0101071) =

=] (А1]°($1‚$2)01(4$1))02(<1932)› $= (5В1‚Ш2)› (31)

$2

причем все интегралы в (31) существуют;

3) если для В-измеримой функции 1‘ : 5’ —› К существует ин-

теграл

191 ( $2 |1°($1‚$2)|02(61$2)) 01011171) < 00

или существует

[92 ( $1 |1'(Ф1‚Ш2)|Ф1(С1$1))0201132) < 00,

то существует (конечный) ]51‘(а:)Р(да:) и выполнено ра-

венство (31).

Таким образом, если существует двойной интеграл по

мере Р, то он может быть сведен к повторному, берущемуся в

произвольном порядке. Если же существует повторный инте-

грал от модуля функции 1‘ , то существует и двойной, который

совпадает с повторными.

28

Упражнение 21. Постройте пример, показывающий, что

если в условиях пункта 3 теоремы Фубини отказаться от взя-

тия модуля функции 1‘ (т.е. рассматривать 1‘ вместо |1"|)‚ то

' утверждение не обязано выполняться.

Заметим, что если отождествить событие В1 с множеством

Ё1 = В1 х $2, а В2 — с множеством Б2 = 51 х 82, то в про-

странстве ($1 х 52, 81 ®Б2› 01,58 О2)Нони будут независимы, т.е.

независимы будут события В1 И В2. Известно, что теорема

Фубини обобщается на произведение п вероятностных про-

странств, а также существуют ее обобщения для а-конечных

мер на измеримых пространствах. В следующих двух гла-

вах мы затронем проблематику независимости бесконечных

семейств событий, а также семейств случайных величин.

1.4. Случайные векторы

Приведенное в пункте 1.2 определение случайной величины

(и ее распределения) легко переносится на отображения в бо-

лее общие измеримые пространства, чем (К, В Для любых

измеримых пространств (У, А) и (5313) отображение Ь : У —› 5

будет АПЗ-измеримо, если /Г1(В) Е А при любом В Е В. Если

(У, А) снабжено вероятностью, то 12 обычно называют случай-

ным элементом. Заметим, что случайный вектор Х : $2 —› К",

т.е. вектор-столбец с компонентами Х 1, . . . , Хп (тем не менее

пишем Х = (Х 1, . . . , Х„)) можно понимать просто как упоря-

доченный набор п, действительных случайных величин.

Упражнение 22. Покажите, что2 —расширенная случай-

ная величина тогдаитолько тогда, когда 2 Е .7:|В([—оо, оо]),где

последняя а-алгебра состоит из множеств вида В, В Ш {—оо},

В Ш {оо}, В Ш {—оо} Ы {оо}, {—оо}, {оо} и {—оо} Ц {оо}, здесь

В Е ВПК). Всюду вместо +00 пишем оо.

Напомним (см. замечание 1), что если Х = (Х1‚ ..., Хд)

— случайный вектор, а 1‘ : К" —› К” — борелевскал функция,

т.е. 1‘ Е В(К")|В(К’°)‚ то ](Х) —— случайный вектор.

Плотность рх(:с) вектора Х = (Х1, ..., Х„) — это такая

неотрицательная интегрируемая по мере Лебега в К" функ-

29

6

ция, что для любого борелевского множества В С К” верно

равенство

Рх(В) = /рх(а:)с1:с‚ где а: =(:с1‚...,:1:„) Е К". (32)

В

Заметим, что р х для вектора также можно определять по

(многомерной) функции распределения, используя аналог (10),

что означает выбор в (32)

В = (—оо,:в] := (—оо‚:с1] х . .. х (—оо,а:„], (ЗЗ)

где а: = ($1, . . . ,ш„) Е К”. Плотность определена однозначно с

точностью до ее изменения на множестве (лебеговской) меры

нуль.

При наличии плотности р х вектора Х = (Х 1, . . . ‚Х„) для

любого подвектора У, состоящего из части компонент век-

тора Х, т.е. У = (Хд1,...‚Хд‚с), тоже существует плотность

ру. Чтобы найти ру, надо проинтегрировать р Х по всем пе-

ременным ид, для которых] Е {1‚...,п} \ {ё1,...‚ё;„}. В част-

ности,

Х

РХКЩ) = Х Р(х1‚х2)(и1›и2)ди2- (34)

—оо

Для случайного вектора Х со значениями в пространстве

К" справедливы аналоги рормул (25) и (26), в которых теперь

а: Е К", а интегрирование по К заменяется на взятие интеграла

по К”.

Упражнение 23. Пусть плотность распределения вектора

(У1,У2) равна

е"ЬЁк`

Р(у1,У2)($›З/) = Т (1 +9($›у))‚

где функция 9(т‚у) = 0 Вне квадрата Кану) = |т| < 1‚ |у| < 1%

а внутри 9(а:‚ у) = шу(ш2 —у2). Найдите распределение величин

1/1 и Ю, а также со\/(У1,У2).

6Из таких множеств состоит а-алгебра ВПК"), порожденная всеми от-

крытыми подмножествами К" (порождающая система не единственна!).

30

На пространстве (К”,В(К")), где п ЕЕ М, существует вза-

имно однозначное соответствие между конечными мерами и

их функциями распределения (функция распределения Р ко-

нечной меры 62 вводится формулой Р(.т) := О((—оо, а:]), здесь

а: Е К" и множество (—оо,а:] определено в (33)). Кроме того,

существует взаимно однозначное соответствие между конеч-

ными мерами и их характеристическими функциями. Для

меры 62 ее агарантеристичеснал функция задается формулой

срыв) == / е“”“”62(с1а=)‚ з е К”,

п (35)

(5,:с) = Ездшд, 722 = —1.

/с=1

Если Х — случайный вектор со значениями в К", то его

характеристическая функция ‹,о вводится как сро(-), где

О = Р х. Пользуясь многомерным аналогом формулы (25), а

также формулой (24), имеем

фх(з) =/ ед(”“’)Рх(с1а:) = Ееддх), 5 Е К", 62 = —1. (36)

Напомним, что матрица С’ порядка п с действительными

элементами ед’, называется неотрицательно определенной

(пишут С’ 2 О), если (С’з,з) 2 О при произвольном векторе

з: (31, ..., 5„) ЕЕ”, где

П

(Св,з) = Е: сддздзт.

1с,т=1

Говорят, что случайный вектор Х со значениями в К"

имеет многомерное нормальное или гауссовсное распределе-

ние с параметрами а и С’, где а Е К”, а симметричная ма-

трица С 2 О, если

. . 1 .

фх(з) = ехр {2(5,а) — ё- (Сз,з)}, з Е К”, 22 = —1. (37)

Используется обозначение Х ш А/ (а, С’).

31

Определение 6. Семейство {Хый Е Т} состоит из неза-

висимьш: случайных величин, если независимы а-алгебры, по-

рожденные этими величинами.

Величина Х, порождает а-алгебру (подалгебру Т)

0'{Х‚;} := {{Х‚; Е В},В Ё 8013)},

состоящую из прообразов всех борелевских множеств при ото-

бражении Х; : О —-› К. Поэтому определение 6 означает с.ле-

дующее: для любого конечного множества 1 С Т и любых

борелевских множеств В; С К, где й Е „Т, верно равенство

Р П{Хъ Ё 3:} = П РНХ: Е ЕЙ)- (39)

$61 $61

Замечание 2. Для проверки независимости {Хдй Е Т}

достаточно проверять (39) не для всех борелевских Вд, т? Е 1,

а лишь для множеств вида В; = (—оо, агд] (или, например, В; =

= [а:д, 00)) при всевозможных значениях а); Е К (т? Е 1

Очевидно, независимость событий из семейства {Ад 1? Е Т}

равносильна независимости их индикаторов, т.е. системы слу-

чайных величин {П ‚М: Е Т}.

Случайные величины, не являющиеся независимыми, назы-

ваются зависимьими. Возможность построения последователь-

ности независимых случайных величин с заданными распре-

делениями доказывается в следующей главе.

Упражнение 27. Пусть Х 1, . . . ‚Хп — дискретные случай-

ные величины (каждая из которых принимает конечное или

счетное чис.ло своих различных значений). Тогда их независи-

мость равносильна выполнению условия

п

Р(Х1 = 171,... ‚Х„ = а.) = П Р(Х‚, = 2,), (40)

/с=1

где аи, — произвольное значение величины Х д, (А: = 1,... ,п).

Объясните, почему для недискретных величин независимость

не сводится к справедливости (40) при произвольном выборе

$1 ‚ о о о ‚$11.

33

Если величины Х 1, ...‚ Х„ независимы и интегрируемы,

то П2=1 Хд Е 111, причем

П П

Е П х, = П ЕХд. (41)

К=1 К=1

В частности, сох/(Х, У) = О для независимых случайных ве-

личин Х,У Е 131. Если Х1,...,Х„ Е 132 и независимы, то в

силу (30) верна формула

‘По П

о 2 Х‚„ = 2 ох,

К=1 К=1

Упражнение 28. Постройте пример, когда случайные ве-

личины интегрируемы, но их произведение неинтегрируемо.

Упражнение 29. Дайте пример зависимых, но некоррели-

рованных величин Х, У Е 132, т.е. таких, что со\/(Х, У) = О.

Величины Х 1 , . . . , Х„ независимы тогда и только тогда, ко-

гда характеристическая функция вектора Х = (Х1,. . . ,Х„)

распадается в произведение характеристических функций

компонент, т.е.

фх(з1,...,з„) = ‹рх1(з1)...‹рх„(з„), з1,...,з„ Е К.

Если у вектора Х = (Х 1, . . . ,Х„) существует плотность

рх(и1,... ,и„), то независимость его компонент равносильна

выполнению почти всюду по мере Лебега в К" условия

рх(и1,...,и„) =рх,(и1)...рх„(ип), (и1,...,и„) Е К",

т.е. точки, для которых данное равенство не выполняется,

образуют множество лебеговской меры нуль. Иначе говоря,

совместная плотность величин Х 1, . . . ,Х„ распадается в про-

изведение их плотностей.

Св врттсой функций распределения Р и С’ называется функ-

ция

(г ч: от) := А яка; - у)сЮ’(у), ас е н. (42)

34

борелевские функции, берущиеся от непересекающихся набо-

ров независимых случайных величин, будут независимы. Так,

например, для независимых величин Х1,Х2,Х3,Х4,Х5 неза-

висимыми являются 1п(1 + |Х1 + Х4|), сов Х2, ехр{Х3 + Х5},

поскольку они соответственно измеримы относительно неза-

висимых а-алгебр 0{Х1,Х4}, а{Х2} и а{Х3,Х5}.

1.6. Сходимость случайных величин. Предельные

теоремы

Напомним определения четырех видов сходимости после-

довательности случайных величин.

Последовательность (Х„)„еы сходится с вероятностью

единица (или почти наверное) к случайной величине Х, если

Р(ш : Х„(ш) —› Х(ш), п —› оо) = 1. (44)

Обычно это записывается Х„ —› Х п.н. (или а.3. от англий-

‘ского а1п1оз1з зиге). Другими словами, имеет место обычная

поточечная сходимость функций Хп к функции Х на событии

С’, вероятность которого равна единице.

Упражнение 33. Покажите, что множество, стоящее под

знаком вероятности в (44), является событием. `

Упражнение 34. Докажите, что (44) равносильно тому,

что при каждом е > О

Р(ш:5ир|Х;,(ш) —Х(ш)| 26) —›О, п—›оо. (45)

1:21:

Упражнение 35. Для несчетного семейства случайных ве-

личин {Хь 1% 2 О} соотношение Х; —› Х п.н. (23 —› оо), анало-

гичное (44), где Х — случайная величина, уже не обязано быть

равносильно следующему аналогу (45): при любом г > О

Р(ш : зир |Хд(ш) — Х(ш)| 2 г) —› О, п —-› оо. (46)

$212.

Дело в том, что под знаком вероятности в (46) не обязательно

фигурирует событие, поскольку верхняя грань берется по не-

счетному множеству. Однако если (46) имеет место, то убе-

дитесь, что тогда Х; —› Х на событии вероятности единица

при 1% —-› оо.

36

Последовательность (Х„)„5ы сходится по вероятности к

случайной величине Х (обозначается Х„ д Х, п -—> оо), если

для любого г > О

Р(ш : |Х„(ш) — Х(ш)| 2 г) -—› О при п —› оо.

Далее нам понадобится и определение стремления по вероят-

ности неотрицательных величин (Х ‚дпеы к бесконечному пре-

делу. Считаем, что Хпдоо, если для любого числа К > О

Р(Х„ <К) —-›О, п—-›оо. (47)

Величины Хп сходятся в среднем квадратичном (или в

пространстве 1762)) к случайной величине Х, если

Е(Х„—Х)2 —›0 при п—›оо.

1,2 . „

Это записывается Хп —› Х или Х = |.|.т.„_,ооХ„ (от англии-

ского Итй ёп теап).

Последовательность (Х„)„еы называется сходящейся по

распределению к случайной величине Х, если

Рхп —› Ёх при п —› оо

в каждой точке непрерывности предельной функции. Часто

а .‚ . . .

пишут Х„ —› Х (от английского дгвйтадийзоп). Имеется следу-

ющее эквивалентное определение:

ЕЛХп) -> ЕЛХ) ПРИ п —> 00 (48)

для любой непрерывной ограниченной функции 1’. Говорят

также, что меры Р д, слабо сходятся к мере Р х при п —› оо.

Теорема 4 (Леви). Пусть агарактеристические функции

‹‚о„(з) случайныа: величин Х„ (п Е М) сшодлтсл длл каждого

з Е К при п ——› оо к непрерывной в нуле функции ‹р(з). Тогда

‹‚о лвллетсл тарактеристической функцией некоторой случай-

_‚ д

нои величины Х и Хд —› Х, п —› оо.

Таким образом, сходимость по распределению последова-

тельности Х„ к Х равносильна сходимости в каждой точке

соответствующих характеристических функций:

‹‚оХ„(з) = Еедзх" -› фх(5) = Ееёзх, з Е К, 122 = —1.

37

Пример 4. Приведем пример последовательности харак-

теристических функций ‹р„(з) (п Е М) таких, что ‹,о„(з) —› ‹р(з)

на всей прямой при п, ——› оо, но ‹р(з) не является характеристи-

ческой функцией.

Пусть случайная величина У имеет стандартное распреде-

ление Коши. Ее характеристическая функция

. 1

щ/(з) = Авт’ да: = бы, 3 Е К. (49)

Этот интеграл легко берется, например, с помощью теории

вычетов, Определим Хп = пУ, тогда срх‚,(з) = е"”|3', з Е К и

п Е М. Следовательно, ‹р„(з) —› ‹р(з) при п —› оо для каждого

5 Е К, где ‹р(0) = 1 и ‹р(з) = 0 при всех в 76 О. Функция ср не

может являться характеристической, так как каждая харак-

теристическая функция (равномерно) непрерывна на К.

Упражнение 36. Докажите, что из сходимости п.н. сле-

дует сходимость по вероятности, влекущая сходимость по рас-

пределению; если же последовательность сходится в среднем

квадратическом, то она сходится и по вероятности. Про-

верьте, что других нетривиальных (тривиальным образом

сходимость п.н. влечет сходимость по распределению) соотно-

шений между этими видами сходимости, вообще говоря, нет.

Кроме того, у последовательности, сходящейся по вероятно-

сти, есть подпоследовательность, сходящаяся п.н., а предел по

вероятности единственен (с точностью до эквивалентности).

Упражнение 37. Пусть случайные величины Хп (п Е Ы)

таковы, что Х„(ш) —› Х (ш) при п —› оо для всех ш Е П. Тогда

Х — случайная величина.

У данного упражнения есть более сложный вариант:

Упражнение 38. Пусть (Х„)„еы — последовательность

случайных величин такая, что с вероятностью единица

Х„(ш) —-› Х (ш) при п —› оо. Доказать, что если простран-

ство (О, Ё, Р) полно, то Х является случайной величиной.

Последнее упражнение показывает полезность пополнения

исходного вероятностного пространства, поскольку в соответ-

38

Упражнение 43. Покажите, что {Хий Е Т} обладает

свойством равномерной интегрируемости, если

3ирЕ|Хд|5 < оо при некотором з > 1.

$ЕТ

Доказывается, что если семейство {Х„, п Е М} равномерно

д и

интегрируемо и Х п —› Х, где Х — случаиная величина, то она

интегрируема И ЕХ = Нш ЕХп. Если даны неотрицательные

719%

с!

интегрируемые величины Хп, п Е М, такие, что Хп —› Х,

где случайная величина Х интегрируема и ЕХ = Нш ЕХп, то

12-400

семейство {Х„, п Е М} равномерно интегрируемо.

Приведенные выше определения сходимости случайных ве-

личин легко переформулировать для случайных векторов. На-

пример, в (48) можно рассматривать случайные векторы Х и

Х„ (п Е М) со значениями в пространстве К” и непрерывные

ограниченные функции 1‘ : К” —› К. Аналогичным образом

сохранится описание их сходимости по распределению в тер-

минах характеристических функций.

Упражнение 44 (прием Крамера-Уолда). Докажите, что

случайные векторы Хп со значениями в пространстве К” схо-

дятся по распределению к случайному вектору Х тогда и

только тогда, когда скалярные произведения

(и, Хп) Её (и,Х) при п —› оо для каждого и Е ШТ‘.

В заключение этого раздела приведем три классических

результата. Первый — усиленный закон больших чисел, вто-

рой — центральная предельная теорема, а третий — закон

повторного логарифма.

Теорема 5 (Колмогоров). Пусть Х1,Х2, . .. — последова-

тельность независимьъш одинаково распредвленньш случайные:

величин. Тогда

П

%:Х;„—›с п.н.длл сЕК <=> ЭЕХ1=сЕ1К

К=1

40

Глава 2. ПРИМЕРЫ СЛУЧАЙНЫХ

пгоцвссов

2.1. Случайные функции и их свойства

Приведем главное для всей развиваемой теории

Определение 8. Случайным, или статистическим, про-

цессом Х = {Хдй Е Т} с параметрическим множеством Т

называется семейство случайных величин (или векторов) Хд,

заданных на одном и том же вероятностном пространстве

62,77, Р) при каждом й 6 Т.

Итак, Х; (или Х — это функция аргументов й и ш,

поэтому правильнее было бы писать Х; (ш) (или Х (й, ш)), для

упрощения записи аргумент ш обычно опускается. При фик-

сированном ш 6 О функция Х (й, ш), где й 6 Т, называется

траекторией, реализацией или выборочной функцией случай-

ного процесса.

Множество Т часто содержится в 112, и тогда переменная й

интерпретируется как время. В частности, если Т = И, Т = М

-или Т = 2.4. = {О} Ц М, то говорят о случайных процессах с

дискретным временем. Если же Т = К, Т = Щ = [О,оо) или

Т = [а,Ь], то речь идет о процессе с непрерывным временем.

При произвольной структуре множества Т часто говорят о

случайной функции Х = {Х,;,й 6 Т}.

Пример 5. Пусть Хд = П вйпй, где й 6 Т- = [О,оо), а слу-

чайная величина П принимает значения -1 и 1 с вероятностью

1/2. Как выглядят траектории процесса Х = {Хд, й ё Т}?

Очевидно, если П(ш) = -1, то Хд(ш) = —$1пй‚ а если

И (ш) = 1, то Хд(ш) = эйпй. Следовательно, все траектории

будут совпадать либо с функцией — 3111 й, либо вйп й.

Определение 9. Пусть Х = {Хд,й 6 Т} — случайный

процесс. Конечномерными распределениями процесса Х на-

зываются меры Рдд, „д, являющиеся распределениями векто-

ров (ХЙ, ...‚ Хдп), где $1, ...‚ Ёд ЕТИПЁМ.

42

Упражнение 46. Пусть Х = (Х(8) = 8Я+ с,8 ) 0), где

случайная величина Я Л/(О, 1), с = сопят. Найти конечно-

мерные распределения (функции распределения) процесса Х.

Упражнение 47. (Сравните с упр. 8). Дать пример про-

цессов Х = (Х(1), 8 ~ Т) и У = (У(8), 8 Е Т), а также множе-

ства С в пространстве траекторий, для которых (Х Е С) ~ Я,

(УбС) фГ.

Упражнение 48'". Пусть Х = (Х(Й), Й Е [О, 1 ) — действи-

тельный случайный процесс, т.е. все Х(1): Й ~ Е. Объяс-

нить, почему, вообще говоря, не является событием множе-

ство (и: яир Х(1,и) < с), где с — константа.

1Е [0,1]

Пример 7. Пусть Х вЂ” процесс, определенный в примере 5.

Найти Р(А), где А = яир Х(8) ) ч

1е[О, т/4]

Пользуясь (4), имеем

Р(А) = Р(АП(У=1))+Р(АП(Г= — 1)) =

=-' — — -'("-) =-

Заметим, что множество В = х( ): яир х(8) ) ч ф нг,

1

ФЕ [О, ~г/4]

но тем не менее А = (Х Е В) Е У. Вообще говоря, вопрос о

том, какие множества входят в Ву, не является простым; по

этому поводу см., напр., [2, с. 32]. В этой связи полезно

Упражнение 49. Пусть процесс Х = (Х(1),1 Е [а,о )

имеет непрерывные траектории. Покажите, что яир Х(1) и

И [а,Ь]

1пГ Х(~) являются случайными величинами.

8Е [а,Ь]

Пример 8. Пусть Х = (Х(1) = К+ 21, ~ ) О), где Г имеет

стандартное распределение Коши. Найдем вероятность того,

что Х(1) = 0 хотя бы для одного 1 б

1 3

45

Все траектории процесса Х непрерывны. Поэтому веро-

ятность того,что процесс имеет хотя бы один корень на от-

резке ч,, равна вероятности того, что одновременно

1 3

1пГ Х(8) < 0 и яир Х(~) > О. Следовательно, инте-

[1(я,~Гз(2] [1~2„дд

ресующая нас вероятность равна

Р У+2 1пГ 1 < О, Г+2 вир ~ > 0

[1!2,~/З!2] [1/2, ~/3/2]

=Р Г+2 — <О,К+ >О = Р( — ~/3< Г < — 1) =

1 2~3

2 ' 2

1 1 т т 1

= — (агсФд ~/3 — агсФд 1) =—

7Г т 3 4 12'

где учтено (см. (15)), что

х

Р(Г < х) = Ии = — агс1дх, х Е К.

т(1+ и2) т

Теперь обсудим, в каком смысле отождествляются случай-

ные процессы.

Определение 10. Случайные процессы Х = ~Х~, 1 Е Т)

и У = Я, 1 ~ Т), заданные на одном и том же вероятностном

пространстве, называются эквивалеитными, если

При выполнении условия (52) говорят также, что процесс У

является модификацией (или версией) процесса Х (тогда и Х

будет модификацией У).

Поскольку мы рассматриваем действительные процессы

(иногда процессы со значениями в ][~"), то

Р(Х~ —— ~~) = Р(Х~ — ~~ —— 0).

Разность двух случайных величин (или векторов в Е") есть

случайная величина (вектор), поэтому множество точек и Е Й,

для которых Х~(и) — ~~(и) принадлежит борелевскому мно-

жеству (0), является событием. Если Т конечно или счетно,

46

т.е. речь идет о процессе с дискретным временем, то из экви-

валентности вытекает неразличимость процессов. Иначе го-

воря, почти все траектории совпадают. Действительно,

Р~Х, = 2; Ч1 е Т)=Р П(м: Х~(и) = 3~(ю)) = 1. (53)

~ЕТ

Последнее равенство является следствием счетной аддитивно-

сти вероятности, а именно, пересечение счетного числа мно-

жеств вероятности единица также имеет вероятность единица

(переходим к дополнениям и применяем (3)).

Если же Т несчетно, например, Т = [О, 1], то П (Х~ —— У~)

~ЕТ

не только не обязано иметь вероятность 1, но может вообще

не быть событием, т.е. не принадлежать г-алгебре Г.

Пример 9. Пусть Й = [0,1], У = В([0,1]). Определим ве-

роятность Р как меру Лебега на ([О, 1],8([0, 1])). Рассмотрим

случайные процессы Х = (Х~, 8 б [О, Ц) и У = Я, Ф Е [0,1]).

Пусть Х~(и) = 0 для всех 1 Е Т = [0,1], и Е Й, а У~(и) = 1

при 1 = и и У~(и) = 0 при 1 ~ и. Покажем, что построенные

процессы эквивалентны, но не являются неразличимыми.

Очевидно, Р(Х~ — — У~) = Р(и: и ~ 8) = 1 при каждом 1,

но у процесса Х все траектории тождественно равны нулю на

отрезке [0,1], следовательно, непрерывны, в то время как у

процесса У каждая траектория имеет разрыв в одной точке.

Заметим также, что яир Х~ — — О, а яир У~ — — 1 для всех и Е Й.

8ЕТ ~ЕТ

Задача 1. Проверить, что если процессы Х = (Х~,~ ~ Т)

и У = Я, 1 ~ Т) эквивалентны, то у них совпадают конечно-

мерные распределения. Показать, что обратное утверждение,

вообще говоря, неверно.

Начнем с одномерных распределений. Пусть В ~ В(К") и

~ Е Т. Пользуясь тем, что Р(С) = Р(СП) + Р(СР) для любых

событий С и П, запишем

Р~,(В) = Р(Х, ~ В) =

= Р((Х~ е В) П (Х~ — — У~)) + Р((Х~ ~ В) П (Х~ ф У~)) =

= Р(Я ~ В) П (Х, = ЪЦ) + Р((Х, е В) П (Х, ~ У)).

47

ление (т.е. Ьаж(Х~) = 1 аж( — Х~)), причем Р(Х~ ф- О) = 1 при

каждом ~ ~ Т. Пусть, например, Х~ принимает значения — 1 и

1 с вероятностью1/2. Введем У=Я, 1 бТ), где У~ — — — Х~,$ЕТ.

Тогда, очевидно, меры Рх, у, и Ру, у совпадают на

классе прямоугольников в ~" при всех 81,..., 1„, и Е 1Ч, по-

скольку

=Ру у (В1Х...ХВ ).

Следовательно, они совпадают на В(~"). Однако по построе-

нию при каждом 1 е Т имеем Р(Х~ — — У~) = Р(Х~ — — О) = О ~ 1.

Таким образом, введенные процессы не являются эквивалент-

ными.

упражнение 50. Пусть величины Х~ независимы и рав-

номерно распределены на отрезке [О, 1, а У = 1 — Х~ для всех

1 Е [О, 1]. Покажите, что процессы имеют одинаковые конеч-

номерные распределения, но не являются эквивалентными.

Рассмотрим внимательнее некоторые свойства траекторий

случаиных процессов.

Определение 11. Говорят, что Х = (Х(1), 1 ~ Т) вы-

борочно непрерывен (или дифференцируем, или интегрируем)

в точке ю, если это верно для соответствующеи траектории,

т.е. функции Х(,и). Процесс выборочно непрерывен на мно-

жестве А Е Г, если траектории непрерывны для всех и Е А.

В том случае, когда Р(А) = 1, говорят, что почти все траек-

тории процесса непрерывны.

Задача 2. Пусть даны процессы Х = (Х(1),1 Е Т) и

У = (У(1),1 Е Т), имеющие (п.н.) непрерывные справа тра-

ектории, где Т вЂ” отрезок или полупрямая, или вся прямая.

Показать, что если У является модификацией Х, то эти про-

цессы неразличимы.

Пусть Я вЂ” множество рациональных чисел. Для каждого

т Е ТЛЯ имеем Р(Х(г) ~ У(т)) = О. Множество ЯПТ не более

49

то говорят, что в — фиксированная тонна разрыва. Точка

разрыва траекторий з = в(ш), не являющаяся фиксированной,

называется переменной тонной разрыва. Например, у пуассо-

новского процесса, вводимого далее в пункте 2.4, отсутствуют

фиксированные точки разрыва, но его траектории не явля-

ются непрерывными функциями.

Таким образом, непрерывность процесса с вероятностью

единица на Т означает отсутствие фиксированных точек раз-

рыва, а почти наверное выборочная непрерывность означает,

что, за исключением множества траекторий нулевой меры, от-

сутствуют и переменные точки разрыва.

2.2. Построение последовательности независимых

случайных величин с заданными

распределениями

Опишем явную конструкцию последовательности незави-

симых действительных случайных величин, имеющих задан-

ные распределения. Идея такова: достаточно научиться стро-

ить одну последовательность независимых бернуллиевских ве-

личин, принимающих значения 1 и О с вероятностью 2. С ее

помощью легко построить независимые величины 111, 112, . . .,

равномерно распределенные на [О,1]. По этим величинам

уже несложно построить такие независимые Х1,Х2, . . ., что

Р(Х„ < св) = Р`„(а:) при а: Е К, где Е, есть заданная функция

распределения, п Е М.

Теперь будем решать задачи, отвечающие каждому этапу

построения.

Пусть число а: Е (О, 1). Тогда а: можно единственным обра-

зом записать с помощью двоичного разложения:

Х

(В

а: = Е: й, (55)

1с=1

где ц принимает значения О или 1. Точнее говоря, если а:

допускает запись с коэффициентами щ = О при А: 2 М или

шк = 1 при К 2 1\/` (М, М — некоторые натуральные числа), то

выбираем запись с нулями (начинающимися с некоторого ме-

51

Совершенно аналогично находим, что при всех Й ) 3

1

Р(х е (О, 1): х),(х) = 0) = Р(х Е (О, 1): х~(х) = 1) = —.

Для произвольного и Е И и любых г1, ..., г„, принимающих

значения 0 или 1, рассмотрим интервал (и, и + 2 "), где и =

= (г1 Л 1)2 1+ (г2 Л 1)2 2 +... + (г„Л 1)2 ", а Л Ь: = т1п(а, б).

Тогда

Р(х е (0,1): х1(х) = г1,...,х„(х) = г„) =

= Р(х б (О, 1) ~ Р: х1(х) = г1,..., х„(х) = г„) =

'Л

= Р(х е (и,и + 2 ") ) В) = 2 " = П Р(х Е (О, 1): хи(х) = ги),

откуда в силу упр. 27 вытекает независимость х1, х2,....

Располагая последовательностью независимых бернуллиев-

ских величин, принимающих значения 0 и 1 с вероятностью

1/2, легко построить случайную величину, равномерно рас-

пределенную на отрезке [О, 1], как показывает

Задача 4. Пусть Х1, Х2,... — независимые величины, за-

данные на некотором вероятностном пространстве (Й,У, Р),

причем Р(Х~ = 0) = Р(Х22 = 1) = ~ при всех Й = 1,2,.... До-

кажите, что

Г(х):=~ и, хай, (56)

й=1

будет случайной величиной, равномерно распределенной на от-

резке [0,1.

Прежде всего заметим, что ряд (56) сходится при ка-

ждом и, поскольку мажорируется рядом ~ 2 ~, причем

1=1

0 < У(и) ( 1 при всех и Е Й. Кроме того, У вЂ” случайная

величина, так как Г является пределом сходящейся при всех и

И

последовательности случайных величин Ц„:= ~ , 'Х222 ", ко-

й=1

гда и ~ оо (конечная сумма случайных величин является слу-

чайной величиной). Мы применили результат упр. 37.

вероятностной меры, убедитесь, что функция Р(П < 2) не-

прерывна слева1 на К, поэтому для любого числа и 6 (О, 1),

выбрав последовательность чисел 2„ ф В, 2„ Т и (при п —› оо),

видим, что

Р(П < и): 11п1 Р(П < 27,) = 11ш 2„ = и.

П-ЧХ „ЭХ

Аналогично для произвольного й Е К имеем

Р(П < г) = 11гпР(П < и).

им

Таким образом,

0, г<0;

Р(П<Ё)= 13, ЁЕ(О,1);

1, 121,

т.е. величина И равномерно распределена на [О, 1].

Упражнение 52. Получите утверждение задачи 4, вычи-

ТП;

слив предел характеристических функций величин 2 Х‚,2”°

ц н 1с=1

при т —-› оо.

Задача 5. Построить последовательность (П„)„Еы незави-

симых величин, равномерно распределенных на [О, 1].

Воспользуемся результатами задач 3 и 4. Запишем коэф-

фициенты 22„ = а:„(а:), где п 6 М, двоичного разложения числа

св Е (О, 1) в виде таблицы (азы), 6,] 6 М. А именно, пусть

171,1 = $17 372,1 = $21 $12 = $37

173,1 = $4, 932,2 = 935, 171,3 = 936, - - ›-

Другими словами, мы рассматриваем последовательно ин-

дексы (ё,_1) такие, что ё +1 = 12:, где 1: = 1,2,3, . . ., и каждый

раз выписываем в направлении с “юго-запада” на “северо-

восток” соответствующие члены исходной последовательно-

сти :1:1,а:2, . . . (см. табл. 1), после чего нумеруем все элементы

с помощью двух индексов.

1Для любой случайной величины У функция Р(У < аз) непрерывна

слева на К.

55

$1 1173 176 517 10

172 $5 179

374 178

137 . . .

Табл. 1.

Пользуясь тем, что непересекающиеся наборы, составлен-

ные из семейства независимых случайных величин, будут неза-

висимы (лемма о группировке, см. пункт 1.5), видим, что рас-

полагаем счетным множеством независимых последовательно-

стей (т.е. строк таблицы), состоящих из независимых бернул-

лиевских величин Х„‚1,Х„‚2, . . . (п Е М), равновероятно прини-

мающих значения О и 1. Положим

ОО

11„ := Яхта-К, п е М.

1с=1

Согласно задаче 4 мы получаем последовательность (П„)„еы

равномерно распределенных на [0,1] случайных величин. Их

независимость можно объяснить, например, следующим обра-

зом. При каждых п Е М и ш Е О имеем

171-400

т

11„ = Нш Ехтдг”.

1с=1

Остается заметить, что любая указанная сумма т слагаемых

измерима относительно а-алгебры Ап, порожденной величи-

нами Х„‚1,Х„‚2, . . ., следовательно, этим свойством будет обла-

дать и предельная величина 11„ (см. упр. 38). Еще раз при-

меняем лемму о группировке, обеспечивающую независимость

А1,А2, . . . и тем самым независимость величин 111, 112, . . ..

Упражнение 53. Объясните независимость 111,112, . . ., не

обращаясь к лемме 2, а пользуясь свойствами характеристи-

ческих функций.

Пусть теперь 171,172, . .. — заданные функции распределе-

ния. Предположим, что они непрерывны и строго монотонны.

Тогда существуют обратные функции ЕЁ : (О, 1) —› К, где

п Е М. Если 111,112, . .. — независимые случайные величины,

56

равномерно распределенные на [О‚ 1], то Х 1, Х 2, . . . , здесь Хп =

= Р‚:1(П„) (п Е М), будут независимы как борелевские (в на-

шем случае непрерывные; см. упр. 11) функции от независи-

мых величин, а для а: Е К

Р(Х„ < гс) = Р(1т‚;1(и„) < аз) = Р(П„ < Ё„(:1:)) = гм).

Единственный нюанс: что делать, если П„(ш) = 1, а мы под-

ставляем П„(ш) в функцию Р; 1, которая определена, вообще

говоря, только на интервале (О, 1)?

Проще всего поступить так: положим Е; 1(О) := —оо, а

17:10) := оо. Тогда легко видеть, что Х1,Х2, . .. определены

корректно, но являются расширенными случайными величи-

нами. Действительно, множество точек ш, для которых Пп(ш)

принимает значения О или 1, имеет вероятность нуль. По-

этому мы всегда можем взять собственную (т.е. со значени-

ями из К) случайную величину, эквивалентную расширенной.

Легко видеть, что тогда получим величину с тем же распре-

делением вероятностей. Кроме того, эти эквивалентные вели-

чины также будут независимы, как показывает элементарное

Упражнение 54. Пусть независимы (расширенные) вели-

чины Х 1, . . . ,Х„ и случайные величины И, = Хд п.н. для всех

19 = 1,... ‚п (если вероятностное пространство полно и Х —

случайная величина, а У = Х п.н., то У автоматически будет

случайной величиной). Докажите, что И, ..., Уп независимы

(при этом Ьаш(Х„) = Ьаи/(Уп) для каждого п Е М).

Чтобы рассмотреть произвольные функции распределения

153,172, . .. (а не только непрерывные и строго монотонные),

нам потребуется новое понятие. Пусть Р‘ — функция распре-

деления некоторой случайной величины, т.е. функция, облада-

ющая известными четырьмя свойствами (приведенными перед

формулой (10)). Обобщенная обратная к функции Р функция

Рт" (от английского таетве) задается формулой

Рта := 1п1`{и е в : Р(и) 2 2:}, ъ е (0,1). (57)

57

Когда Р— непрерывна и строго возрастает, то Р'"~ совпадает

с обычной обратной функцией Р 1. Для удобства полагаем

Р'""(0) = — оо и Р'""(1) = оо

е пражнение 55. Пусть

длях < — 1,

для х Е ( — 1,0),

для х Е [0,2),

для х > 2.

(х) =

~ (х + 1)

1

1

Построить график Р'"~.

нуль.

Для 1 Е (0,1) и 8 Е Е неравенство Р'" (1) < 8 влечет

Р(Р'""(~)) < Р(8), так как Р не убывает. Покажем, что

при этом 1 < Р(Р'""(1)), а тогда 1 < Р(8). Возьмем точки

я„~ Р'""(1) при и -+ оо, это дает Р(г„) > 1 при всех и Е

~ М Учитывая непрерывность функции Р справа, получаем

Р(Р'"~(8)) = 11т Р(я„) > 1. Следовательно, верно неравен-

ство 1 < Р(8).

С другой стороны, если 1 < Р(8) (по-прежнему 1 Е (0,1)

и 8 Е Е), то Р'"~(~) < Р'""(Р(8)). Если Р(8) < 1, то из (57)

вытекает, что Р'"~(Р(8)) < 8 и, следовательно, Р'"~(1) < 8.

Если же Р(8) = 1, то Р(8) > 1, откуда Р'"'(1) < 8. Итак,

Задача 6. Пусть à — случайная величина, равномерно

распределенная на отрезке [О, 1, а Р— функция распределе-

ния. Доказать, что У: = Р'"~(Г) — расширенная случайная

величина, совпадающая п.н. с собственной случайной величи-

ной, имеющей функцию распределения Р.

Прежде всего покажем, что У расширенная случайная

величина. Функция Р'"" не убывает на (О, 1), поэтому является

борелевской в силу примера 2. Возьмем случайную величину

Я = ГП~ц~(о ~д + ~ П~у~~р ц1. Тогда Р'"~(Я) в силу замеча-

ния 1 будет собственной случайной величиной, совпадающей

с Р'""(У) на множестве (Г ~ (0,1)), имеющем вероятность

единица, а значения оо и — оо функция Р'"~(Г) принимает со-

ответственно на событиях (Г = 1) и (У = 0) вероятности

для 23 Е (О‚1) и з Е В неравенства 23 < Р(в) и Р1""(23) Е 3

равносильны. Поэтому

{шГ/(ш) <Г(з), П(ш) Е (О, 1)} = {ш:Р5"" (П(ш)) $5, С/(ш) Е (О, 1)}

и Р(Р5‘“’(П(ш)) Е з) = Р(з), в Е К, так как Р(П < 2:) = а: при

а: Е [О,1].

Замечание 4. Задача 6 показывает, что случайную ве-

личину, имеющую любую наперед заданную функцию распре-

деления Р, всегда можно построить, располагая лишь одной

случайной величиной, равномерно распределенной на [О‚ 1].

Упражнение 56. Найдите отображение, которое случай-

ную величину П, равномерно распределенную на отрезке [О‚ 1],

переводит в случайную величину Х м Ехр(А).

Переходим к заключительному этапу.

Задача 7 . Пусть 171,172, . .. — любая последовательность

функций распределения. Убедиться, что на некотором

(ШТ, Р) найдется последовательность независимых случай-

ных величин Х1,Х2, . . ., для которых Р(Х„ < 1:) = Р„(а:) при

пЕЫишЕК

Согласно задаче 5 построим последовательность 111112,. ..

независимых случайных величин, имеющих равномерное рас-

пределение на [О‚ 1]. После этого, применив задачу б, возьмем

в качестве Х„ либо Р,Ё“’(П„), п Е М, либо эквивалентные им

собственные величины (скажем, как при решении задачи 6).

Они независимы, будучи борелевскими функциями от незави-

симых величин, и, кроме того, обладают заданными функци-

ями распределения (см. упр. 54).

2.3. Случайные блуждания. Задача о разорении

игрока

Пусть Хо, Х 1, . . . — последовательность независимых слу-

чайных величин. Случайным блужданиемназывается процесс

Бп:ЁХО+...+Хп‚ p s

59

Этот процесс можно доопределить на всю полупрямую Щ,

положив, например, 5 (13) := БШ, где H целая часть числа.

Будем предполагать, что Х1,Х2, . . . одинаково распределены.

Случайное блуждание возникает в классической задаче о

разорении игрока.

Задача 8. Пусть игроки А и В в начальный момент т? = О

располагают соответственно капиталами а и Ь, где а,Ь Е М.

Предположим, что А в каждой партии игры выигрывает 1 у

игрока В с вероятностью р Е (О, 1) и проигрывает 1 с вероят-

ностью (1 = 1 — р. Пусть результаты всех партий независимы.

Игра прекращается, когда капитал одного из игроков обраща-

ется в нуль. Требуется доказать, что с вероятностью единица

игра закончится за конечное число партий.

Прежде всего формализуем задачу, определив последова-

тельность независимых одинаково распределенных величин

Х1,Х2,-. . ., принимающих значения 1 и -1 соответственно с

вероятностями р и 1 — р. Тогда выигрыш игрока А в момент

п Е М равен величине 5„ = Х 1 + + Хд (отрицательная ве-

личина 5„ равна его проигрышу после п партий). В нашей

модели Хо = $0 = О.

Докажем, что игра закончится за случайное время т, ко-

торое будет конечно п.н. Величина

т =1пГ{/с е ы да, е {—а} о {щ},

и мы считаем т = оо, если- —а < 5;, < Ь при всех д: Е М. Не-

ограниченное продолжение игры означало бы, что траектория

случайного блуждания ($„)„52+, начавшись в точке (О, О), ни-

когда не выйдет на прямые у = —а или у = Ь. Возьмем т Е М,

выбор которого поясним далее. Тогда

{Т = 00} С {—а‚ < Зтд; < 5,16 Е М} С П{|5т(д+1)—5ть| < а+Ь}.

1с=1

По свойству непрерывности вероятности (см. Н5 имеем

оо

Р П{|5т(д+1) — 5ть| < а + Ь} =

/с=1

60

М

йш Р (П{|5т(;с+1) — 577„“ < а+Ь}) =

1

М —›оо

1с=1

- М

= 11п1 Р(|$т| < а + Ь) = О,

М —›оо

здесь учтено, что (при каждом т) величины |5т(;„+1) — Бты,

где 1: Е М, независимы, а также принято во внимание, что

Р(|5'т| < а + Ь) < 1 для достаточно большого т. Данное нера-

венство легко обосновать с помощью центральной предельной

теоремы (теорема 6). Действительно,

Р(|5'т| <а+Ь) =

(—а—д—т(2р—1)<$т—т(2р—1) а+Ь—т(2р—1))

<

2\/тр(1—р) 2\/тр(1-р) 2 тр(1 -р)

а с учетом упр. 41 последняя вероятность при больших т

будет близка к

1 Ит)

г?’ [$010

—а—Ь—т(2р—1) _а+Ь—т(2р—1)

х/4тр(1 -р) И щт) _ х/‘ТтрП -р)

чем и(т)—+—оо И 'и(т)—›—оо при р> Ё, и(т)—+оо и 1›(т)—+оо

2

_.Ь

е 2 сйсс,

где и(т) = , при-

прир< %‚ а при р=% имеем и(т) -—›О, о(т) —›О (когда т-юо).

Итак‚ Р(т = оо) = О.

Фактически верно более сильное утверждение (не только

для Х„ со значениями -1 или 1) , которое доказать сложнее.

Упражнение 57 "‘. Пусть Х1,Х2‚ . .. — независимые оди-

наково распределенные величины. Тогда для любого отрезка

[щЬ] верно соотношение Р(5„ Е [а,Ь]) —› О при п ——› оо, где

$„=Х1+...+Х„,ПЁМ.

Задача 9. Подсчитать вероятность разорения игрока А.

Для удобства подсчетов рассмотрим сдвинутое случайное

блуждание 2„ = а + Бп, которое будет происходить в полосе

[О‚ а+Ь]‚ причем обе границы полосы являются поглощающими

61

экранами, т.е. при их достижении процессом Я„игра закан-

чивается. При этом, если первым достигается нулевой экран,

то разоряется игрок А. Введем также на множестве целых чи-

сел 0 < х < а + б функцию

Здесь х выступает как параметр нашей стохастической мо-