Автор: Прохоров Ю.В.

Теги: теория вероятностей и математическая статистика теория вероятностей математическая статистика комбинаторный анализ теория графов математика математический анализ энциклопедия серия брэ

ISBN: 5-85270-265-Х

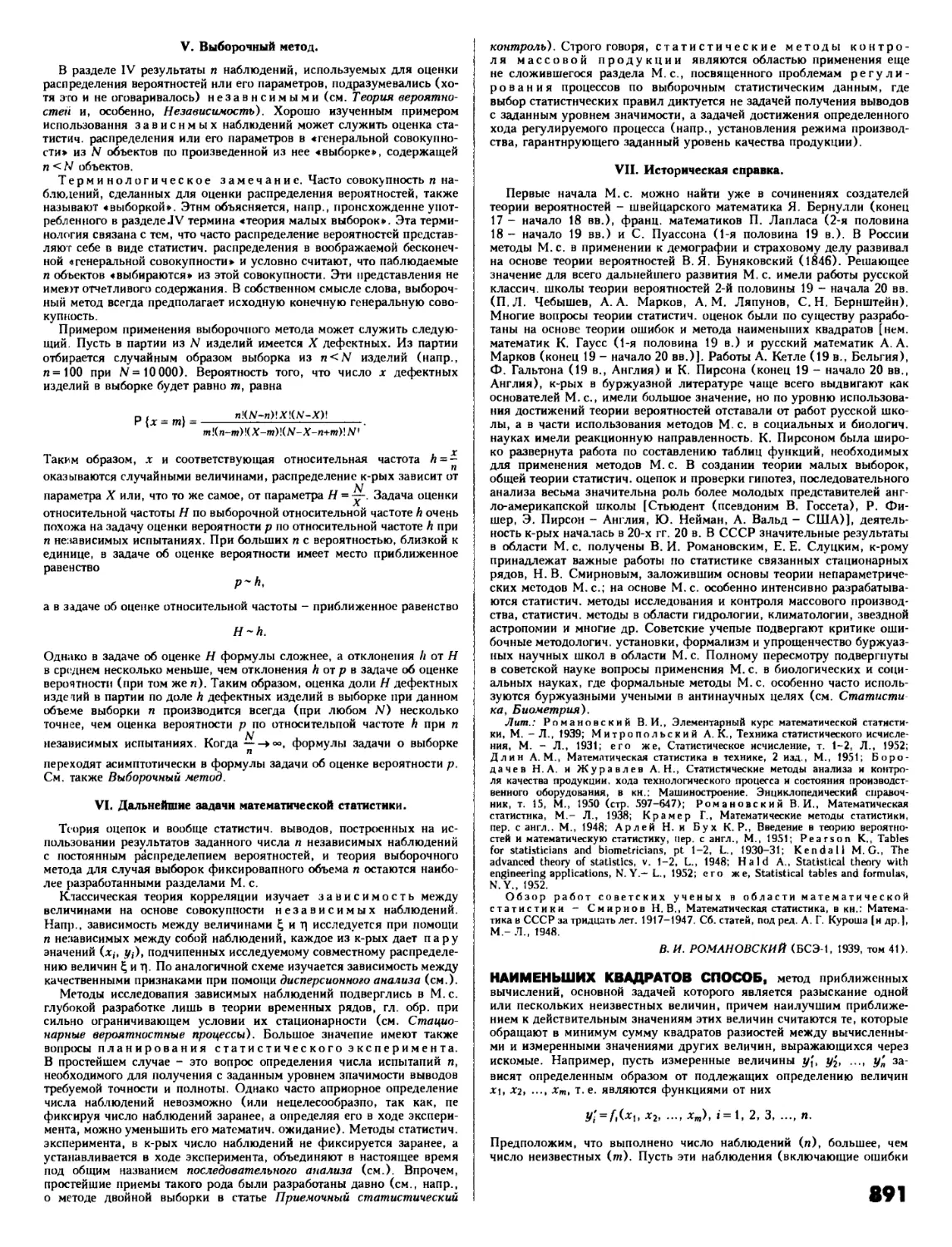

Год: 1999

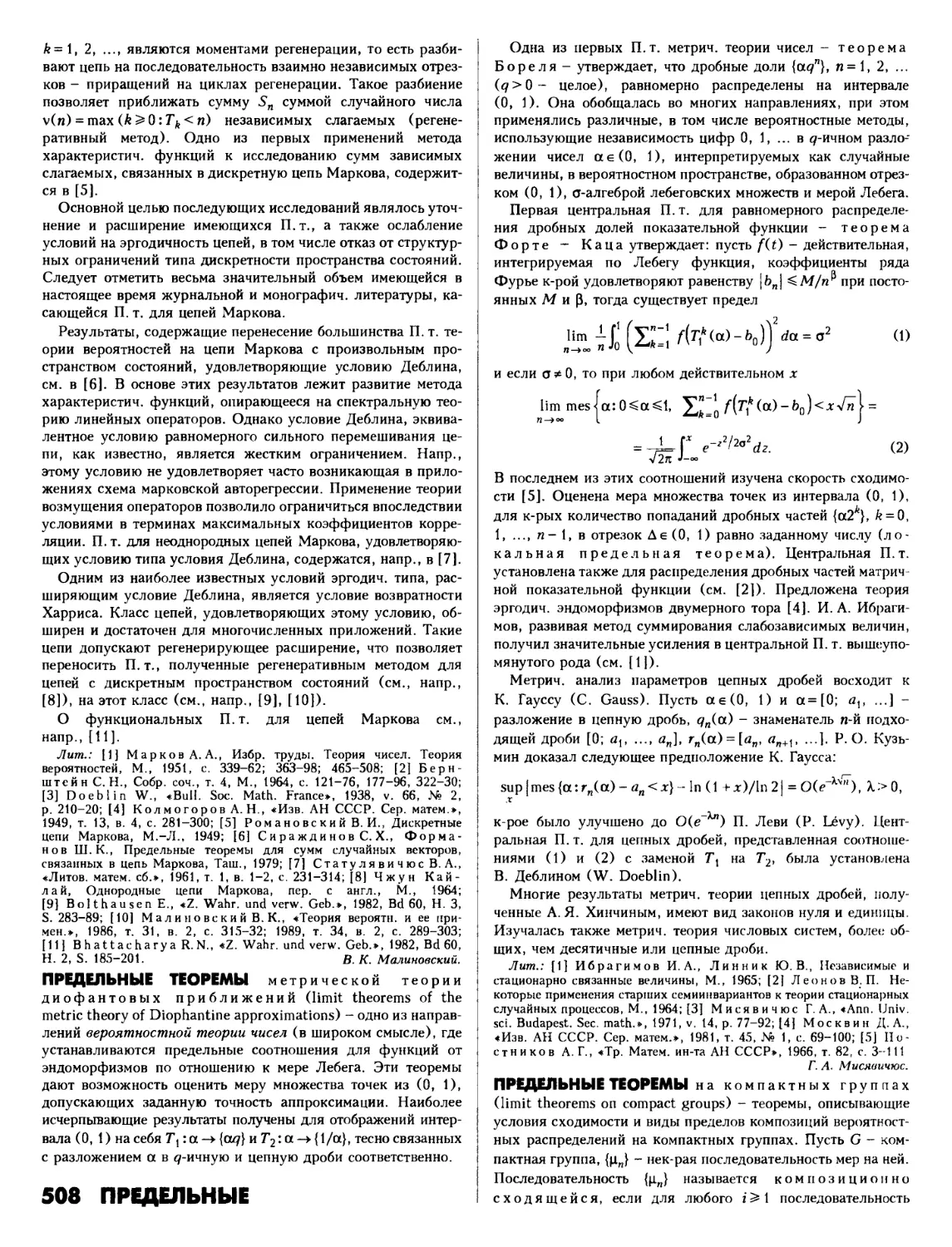

ВЕРОЯТНОСТЬ

И МАТЕМАТИЧЕСКАЯ

СТАТИСТИКА

энциклопедия

ЁЩ

НАУЧНОЕ ИЗДАТЕЛЬСТВО

«БОЛЬШАЯ РОССИЙСКАЯ ЭНЦИКЛОПЕДИЯ»

ИЗДАНИЕ ОСУЩЕСТВЛЕНО ПРИ ПОДДЕРЖКЕ

'#и

РОССИЙСКОГО ФОНДА ФУНДАМЕНТАЛЬНЫХ ИССЛЕДОВАНИЙ

ПО ПРОЕКТУ № 98-01-14067

2000 ГОДУ

ЛЕГ НАУЧНОМУ

ИЗДАТЕЛЬСТВУ

«БОЛЬШАЯ

РОССИЙСКАЯ

ЭНЦИКЛОПЕДИЯ»

МОСКВА

1999

ВЕРОЯТНОСТЬ

И МАТЕМАТИЧЕСКАЯ

СТАТИСТИКА

ЭНЦИКЛОПЕДИЯ

Главный редактор

Ю.В. ПРОХОРОВ

Редакционная коллегия

В. И. БИТЮЦКОВ (заместитель главного редактора),

А. А. БОРОВКОВ, Б. В. ГНЕДЕНКО, И. А. ИБРАГИМОВ,

А.Н. КОЛМОГОРОВ, B.C. ПУГАЧЕВ, Б.А. СЕВАСТЬЯНОВ,

Я. Г. СИНАЙ, А. В. СКОРОХОД, В. А. СТАТУЛЯВИЧУС, А. Н. ШИРЯЕВ

Научно-редакционный совет

С А. АЙВАЗЯН, Р. В. АМБАРЦУМЯН, Ю. К. БЕЛЯЕВ,

К. А. БОРОВКОВ, Н.Н. ВАХАНИЯ, В. Л. ГИРКО,

И. И. ГИХМАН, Б. И. ГРИГЕЛИОНИС, Р. Л. ДОБРУШИН,

И. Г. ЖУРБЕНКО, В.М. ЗОЛОТАРЕВ, И. Н. КОВАЛЕНКО,

B.C. КОРОЛЮК, В.М. КРУГЛОВ, Й.П. КУБИЛЮС,

Н. Н. ЛЯШЕНКО, М. Б. МАЛЮТОВ, А. С МОНИН,

М.С. НИКУЛИН, А.А. НОВИКОВ, A.M. ОБУХОВ,

A. И. ОРЛОВ, М.С. ПИНСКЕР, Н. И. ПОРТЕНКО,

B. В. ПРЕЛОВ, А. В. ПРОХОРОВ, В. В. САЗОНОВ,

В. В. СЕНАТОВ, Р.З. ХАСЬМИНСКИЙ, Э. В. ХМАЛАДЗЕ,

Г. С. ХОВАНСКИЙ, А. С. ХОЛЕВО, В. И. ХОХЛОВ, Ю. С. ХОХЛОВ,

Н. Н. ЧЕНЦОВ, Д.М. ЧИБИСОВ, М. Г. ШУР,

В. В. ЮРИНСКИЙ, А. А. ЮШКЕВИЧ, A.M. ЯГЛОМ,

М. И. ЯДРЕНКО

НАУЧНОЕ ИЗДАТЕЛЬСТВО

«БОЛЬШАЯ РОССИЙСКАЯ ЭНЦИКЛОПЕДИЯ»

УДК 519.2

ББК 22.17

В 31

Председатель

Научно-редакционного совета издательства

«Большая Российская энциклопедия»

лауреат Нобелевской премии

A.M. ПРОХОРОВ

Главный редактор, директор издательства

А.П. ГОРКИН

Первый заместитель директора издательства

Н.С. АРТЕМОВ

РЕДАКЦИЯ МАТЕМАТИКИ:

Зав. редакцией В. И. БИТЮЦКОВ, ведущие научные редакторы

М. И. ВОЙЦЕХОВСКИЙ, А. Б. ИВАНОВ, научные редакторы

О. А. ИВАНОВА, С. А. РУКОВА, Л. Р. СЕМЕНОВА, Е. Г. СОБОЛЕВСКАЯ

В ПОДГОТОВКЕ ИЗДАНИЯ ПРИНИМАЛИ УЧАСТИЕ:

Редакция иллюстраций - гл. художник А. В. АКИМОВ

Техническая редакция - зав. редакцией О. Д. ШАПОШНИКОВА

Издательско-компыотерный отдел - зав. отделом И. Н. КОНОВАЛОВА

Корректорская - зав. корректорской С. Ф. ЛИХАЧЕВА

Производственный отдел - зав. отделом И. А. ВЕТРОВА

Копировально-множительная лаборатория - зав. лабораторией В. И. КЛИМОВА

Гл. экономист - А. И. СОЛОДОВНИКОВА

Гл. бухгалтер - О. И. СМИРНОВА

Федеральная программа книгоиздания России

(Q Научное издательство

ISBN 5-85270-265-Х Большая Российская энциклопедия, 1999.

АБЕЛЕВА ГРУППА (Abelian group), коммутативная

группа,- группа, операция в к-рой обладает свойством

коммутативности (перестановочности). Как носители

распределений вероятностей такие А. г., как числовая прямая или я-мер-

ное евклидово пространство (с обычной операцией сложения

чисел или векторов), являются классич. объектом теории

вероятностей. Необходимость рассматривать случайные

величины в других А. г. возникает совершенно естественно

(см. Вероятностей теория на алгебраических структурах,

Вероятностная мера на группах). Нижеследующий

простейший пример иллюстрирует нек-рые особенности теории

вероятностей на А. г.

Пример (сложение целочисленных случайных величин по

mod 2) (ср. [4]). Задана А. г. G, к-рая состоит из двух

элементов 0 и 1 с правилом сложения

0 + 0 = 0, 0+1 = 1+0=1, 1 + 1=0.

Пусть Xv Х2, ..., Х„, ... - последовательность независимых

случайных величин, принимающая значения 0 и 1, причем

вероятности событий Хп = 0 и Хп - 1 равны соответственно qn

5„ = Х1+Х2 + ...+Х„,

где сумма понимается в смысле указанной групповой операции

(то есть Sn равно остатку от деления на 2 суммы величин Xt,

Х2, ..., Х„ в обычном смысле). Тогда:

а) если при каком-либо я0 величина Хп имеет

«равномерное» распределение на G, то есть рп = qn = 1/2, то при п>п0

все Sn имеют «равномерное» распределение;

б) если

то Sn при и->°о имеет в пределе «равномерное»

распределение;

в) если условие а) не выполнено, то условие б)

оказывается не только достаточным, но и необходимым для

сходимости распределений сумм Sn к «равномерному»

(единственному невырожденному инвариантному распределению на

группе G).

При изучении подобного рода предельных теорем на А. г.

используется аналог обычного метода характеристич.

функций (см. Фурье преобразование распределения вероятностей

на группе).

Лит.: [1) ГренандерУ., Вероятности на алгебраических

структурах, пер. с англ., М., 1965; [2) Сазонов В. В., Тутуба-

лин В. Н., «Теория вероятн. и ее иримен.», 1966, т. 11, в. 1, с. 3-55;

[3] Хейер X., Вероятностные меры на локально компактных

группах, пер. с англ., М., 1981; [4) DvoretzkyA., WolfowitzJ.,

«Duke Math. J>, 1951, v. 18, p. 501-07; [5] Parthasarathy K. R.,

Probability measures on metric spaces, L.- N. Y., 1967.

Ю. В. Прохоров.

АБЕЛЕВА ТИПА ТЕОРЕМЫ (Abel theorems) - см. Абеля

АБЕЛЯ ИНТЕГРАЛЬНОЕ УРАВНЕНИЕ (Abel integral

equation) - интегральное уравнение

д*)=Г4^. *><>, (О

JO Jx-s

где fix) - заданная функция, a (p(s) - искомая функция.

А. и. у. имеет единственное решение в предположении, что

fix) непрерывно дифференцируема (условия на fix) могут

быть значительно ослаблены). При этом, если /Ч0) = 0, то

решение имеет вид

ф(,)=ГГ(£Н£. (2)

JO V5-2

Опуская в этом уравнении условие fiO) - 0, получают

решение А. и. у.

к L Vs «to Js^z J

К решению А. и. у. сводится следующая вероятностная

задача. Пусть X=(Xt, X2) - двумерный случайный вектор,

плотность вероятности рх х ixvx2) к-рого зависит только от

(то есть распределение вектора X обладает

круговой симметрией), и дана плотность вероятности рх ixx)

компоненты Xt; требуется восстановить распределение X

(принципиальная возможность этого следует из Краме-

ра-Волда теоремы, см. также Сферически симметричное

распределение). Пусть R = + Х2 - длина вектора X и

PrM - соответствующая плотность вероятности; тогда

Pxvx2(*vx2> = i2nr)~]pRir).

Распределение |Xt | совпадает с распределением произведения

двух независимых случайных величин; из них первая

распределена как R, а вторая как длина ех проекции на ось абсцисс

двумерного случайного вектора e = ieve2) единичной длины,

все направления к-рого равновероятны (см. [2], гл. 1, § 10).

По формуле полной вероятности при хх > 0

= f'lp (VIA 1 Л.

JO 2^R{ 2 )П J^2

Положив

нетрудно видеть, что fix) и (p(s) связаны соотношением (1).

Соответственно (р выражается через /"формулой (2).

Поставленная выше задача сводится к решению А. и. у. не

только в случае размерности 2, но и в случае любой четной

размерности.

А. и. у. было исторически первым интегральным

уравнением. Оно появилось в 1823 у Н. Абеля (см. [1]) в связи со

теоремы.

АБЕЛЯ 5

следующей любопытной механич. задачей (задачей Абеля).

Материальная точка движется из состояния покоя по гладкой

кривой, лежащей в вертикальной плоскости с системой

координат (и,х). Время ty необходимое для того чтобы эта точка,

двигаясь с высоты х} достигла своего нижнего положения

(0,0), есть заданная функция t(x). Требуется определить

форму кривой. Для этой задачи в А. и. у. (1) f(x) = ^2g t(x),

где а - ускорение силы тяжести, a cp(s) = , где со - угол

sin со

между направлениями касательных к кривой в точке с

ординатой 5 и осью абсцисс. Уравнение кривой имеет вид

и= \ Vф2(s)-1 ds.

Сюда включается и случай fix) = const; ему в задаче Абеля

соответствует случай t (х) = const, в к-ром искомая кривая

является циклоидой (X. Гюйгенс, Ch. Huygens, 1673).

Лит.: [1] Abel N. Н., Oeuvres completes, t. 1, Christiania, 1839,

p. 27-30; [21 Феллер В., Введение в теорию вероятностей и ее

приложения, пер. с англ., т. 2, М., 1984; [31 Привалов И. И.,

Интегральные уравнения, 2 изд., М.-Л., 1937; [41 Курант Р.,

Гильберт Д., Методы математической физики, пер. с нем., т. 1,

3 изд., М., 1951. Ю. В. Прохоров.

АБЕЛЯ ТЕОРЕМЫ (Abel theorems), теоремы абелева

типа,- совокупность утверждений, к-рые могут быть

интерпретированы, как определение асимптотики преобразования

Лапласа какой-либо функции по асимптотике самой этой

функции.

Пример 1. Исходя из равенства

re-sxxa-\dx=ria)_ a>0 s>0

JO s«

можно полагать, что если f(x) такова, что при #->°о

f{x)~xa~\

то

Jo ' 5«

при slO. Если f(x) абсолютно интегрируема на любом

конечном интервале, то это утверждение справедливо и

представляет собой простейший пример теоремы абелева типа.

Пример 2. Пусть числовой ряд

У°° , а„

сходится и имеет сумму А. Для определенной при |z| < 1

функции

имеем при zt 1

f(z)^A

(частный случай теоремы Абеля о степенных рядах).

Аналогия с примером 1 может быть проведена следующим

образом. Пусть г - e~s для 0 < z < 1 и

GCr) = Y ^ ап\

*-*П^ X П

тогда

f(z) = J~ e~sxdG(x) = s £ e~sxG(x)dx.

Так как GCr)->/l при #-><*>, то естественно ожидать, что

при 5->0

f(z)~sj~ e~sxAdx = A.

Теоремы абелева типа применяются при доказательстве

предельных теорем теории вероятностей, в теории случайных

6 АБЕЛЯ

функций и т.д. Они существенно дополняются обратными

к ним глауберовыми теоремами (см. [1], гл. 13).

Лит.: [11 Феллер В., Введение в теорию вероятностей и ее

приложения, пер. с англ., т. 2, М., 1984. Ю. В. Прохоров.

АБСОЛЮТНАЯ НЕПРЕРЫВНОСТЬ МЕР (absolute

continuity of measures) - одно из важнейших понятий общей теории

меры. Пусть Е - основное базисное пространство, S - нек-рое

а-кольцо подмножеств в Е, a |i и X - две произвольные

знакопеременные меры (то есть заряды), определенные на 5.

Говорят, что мера \1 абсолютно непрерывна

относительно А,, если для всякого множества XeS соотношение

\Х\ (Х) = 0 (где \Х\ - полная вариация знакопеременной меры

X) влечет за собой соотношение иХХ) = 0. Наиболее часто

понятие абсолютной непрерывности рассматривается для

обычных мер, а также в тех ситуациях, когда |i -

знакопеременная мера, а X - обычная мера. Для выражения того факта,

что заряд |Х абсолютно непрерывен относительно заряда X,

иногда используется обозначение |i« X. Следующие

соотношения эквивалентны друг другу:

1) ц«А/,

2) \i+ « X и и~ « X,

где (X и р~ - верхняя и нижняя вариации заряда |i;

з) 1ц1«Ы.

Пусть имеет место соотношение \i« X, причем

знакопеременная мера (х является конечной. Тогда, каково бы ни было

число е > 0, всегда найдется такое число 8 > 0, что для любого

множества XeS с |А,|(Х)<8 выполняется неравенство

\\i\ (X)<£. Указанное свойство в определенной степени

объясняет происхождение термина «абсолютная непрерывность

знакопеременных мер». В классе М(Е, S) всех зарядов,

заданных на а-кольце 5, отношение |i« X представляет собой

нек-рое отношение предпорядка (то есть оно рефлексивно и

транзитивно). Два заряда и, и X называются

эквивалентными, если |i« X и Х« [I. Эквивалентность зарядов |i и X

иногда обозначают символом \i = X. Отношение [i = X в самом

деле представляет собой нек-рое отношение эквивалентности

в классе М (Е, S) и, следовательно, оно дает разбиение класса

М(Е, S) на непустые непересекающиеся подклассы. Эти

подклассы часто называют спектральными типами

знакопеременных мер. Отношение предпорядка [i«X

в классе М (Е, S) естественным образом порождает отношение

порядка в множестве всех спектральных типов.

Каково бы ни было счетное семейство (|Х,),е/, состоящее из

знакопеременных а-конечных мер, определенных на а-алгебре

5, обязательно существует обычная а-конечная мера X,

определенная на той же а-алгебре S и обладающая тем свойством,

что все u,j, ге/, являются абсолютно непрерывными

относительно X. Для несчетных семейств (|Х,);е/, состоящих из

знакопеременных а-конечных мер, аналогичное утверждение,

вообще говоря, уже не будет верным.

Пусть (|1|),-е/ - произвольное семейство зарядов, заданных

на а-кольце 5, и X - нек-рый заряд, заданный на том же

а-кольце. Семейство (ц,-),-е/ называется равномерно

абсолютно непрерывным относ и те л ьн о X, если,

каково бы ни было число е > 0, всегда найдется такое число 6 > 0,

что для любого множества X е S с и для любого

индекса iel выполняется неравенство |^| (Х)<е. С

понятием равномерной абсолютной непрерывности семейства зарядов

тесно связана теорема Витали-Хана-Сакса (см. [2],

[3]), из к-рой, в частности, вытекает, что если (|1я)иедг ~ такая

последовательность конечных зарядов на а-алгебре S, что для

каждого множества XeS существует предел

lim ця(Х) = ц(Х),

то функция множеств и. является счетно-аддитивной на S

(другими словами, |1 тоже является зарядом на S).

Одним из наиболее важных фактов, группирующихся

вокруг понятия абсолютной непрерывности знакопеременных

мер, служит Радона--Никодима теорема, к-рая допускает

различного рода обобщения и усиления (см. [3]). Понятие

Л. н. м. \л « X имеет содержательный смысл и в том случае,

когда X есть обычная мера на данной а-алгебре S, a |i есть

векторная (векторнозначная) мера, определенная на этой же

а-алгебре S и принимающая свои значения в нек-ром

топологии, векторном пространстве.

Лит.: [\] Халмош П., Теория меры, пер. с англ., М., 1953;

[2] Неве Ж., Математические основы теории вероятностей, пер. с

франц., М., 1969; [3] ДанфордН., Шварц Дж., Линейные

операторы. Общая теория, пер. с англ., ч. 1, М., 1962.

А. Б. Харазишвили.

АБСОЛЮТНАЯ ЧАСТОТА (absolute frequency) - см.

Гистограмма.

АБСОЛЮТНАЯ ШКАЛА (absolute scale) - см. Измерений

теория.

АБСОЛЮТНО НЕПРЕРЫВНОЕ РАСПРЕДЕЛЕНИЕ

(absolutely continuous distribution) - распределение

вероятностей, имеющее плотность распределения. Пусть Р(Л) -

распределение вероятностей в II?" (вероятностная мера на

а-алгебре борелевских подмножеств IR"). Распределение Р(Л)

называется абсолютно непрерывным (относительно меры

Лебега), если для любого борелевского множества Е с нулевой

мерой Лебега имеет место равенство Р(£) = 0. Абсолютная

непрерывность распределения Р(Л) равносильна

существованию неотрицательной интегрируемой функции f(x^,...,xn)

такой, что

P(A) = j ... fAf(xx,...tx„)dxi...dxn

для любого борелевского множества А. Функция f(x^,...,xn)

называется плотностью вероятности распределения

Р{А). Класс А. н. р. содержит многие важные для теории

вероятностей и приложений распределения - нормальное

распределение, распределение Коши, равномерное распределение

и г. д.

Иногда рассматривают более общее понятие абсолютной

непрерывности: пусть (Q, ./) - измеримое пространство, Р и

v - соответственно распределение вероятностей и а-конечная

мера на Ш, .*/). Распределение Р называется абсолютно

непрерывным относительно меры V, если из равенства

vC4) = 0 следует равенство Р(Л) = 0. А. н. р. имеет плотность

вероятности f относительно меры v (Радона-Никодима

теорема):

P(A)=jAfdv.

С понятием абсолютной непрерывности тесно связано

понятие доминируемое™ семейства распределений: семейство

вероятностных распределений J* на измеримом пространстве

Ш, .«/) называется д о м и н и р о в а н н ы м, если на (Q, .*/)

существует а-конечная мера v такая, что каждое

распределение из ;/абсолютно непрерывно относительно v.

Предположение о доминируемости является существенным в нек-рых

теоремах математич. статистики.

См. также Абсолютная непрерывность мер.

Лит.: [ 11 Прохоров Ю.В., Р о з а ч о в Ю. А., Теория

вероятностей, 3 изд., М., 1987; [2] Феллср В., Введение в теорию

вероятностей и ее приложения, иер. с англ., т. 2, М., 1984. И. Г. Ушаков.

АБСОЛЮТНО СЛУЧАЙНАЯ ПОСЛЕДОВАТЕЛЬНОСТЬ

(absolutely random sequence) - см. Дискретный белый шум.

АБСОЛЮТНОЕ РАСПРЕДЕЛЕНИЕ цепи Маркова

или марковского процесса X (absolute distribution

of a Markov chain or process) - безусловное распределение

\i(t) случайного состояния X(t) при фиксированном t из

области Т изменения временного параметра:

иХШ = Р{Х(ОеГ}, ГеЗЗ,

где (Е, ЗГ) - фазовое пространство процесса X. Для

существования А. р. при t^tQ необходимо задать начальное

распределение [i(t0); тогда

\i(t,r)=jE\i(t0,dx)p(t0,x; t,T), (*)

где p(s,x; t,T) - переходная функция цепи или процесса X.

В однородном случае р (s,х; s + t,T)=p(t,x,T) (здесь

полагают tQ = Q) формула (*) обращается в

\i(tX)=jEli(0,dx)p(t,x,r), t^O, ГеВ.

А. р., не зависящее от t, называется стационарным

распределением. А. А. Юшкевич.

АБСОЛЮТНЫЙ МОМЕНТ (absolute moment) - числовая

характеристика случайной величины, равная моменту ее

модуля. Точнее, абсо л ютн ым моментом порядка/г>0

случайной величины X называется величина

V* = E|X|*.

Если v^ существует при нек-ром k = k0>0, то v^

существует при всех 0 < k < k0 и обладает на отрезке следующими

свойствами: функция In v^ выпукла, а функция v^ монотонно

не убывает. А. м. является важной характеристикой случайной

величины и часто фигурирует в различных оценках и

неравенствах (см., напр., Чебышева неравенство, Берри-Эссеена

неравенство). В.Г.Ушаков.

АБСОЛЮТНЫЙ ПСЕВДОМОМЕНТ (absolute pseudomo-

ment) - см. Псевдомомент.

АБСТРАКТНАЯ ЭРГОДИЧЕСКАЯ ТЕОРЕМА (abstract

ergodic theorem) - см. Эргодические теоремы.

АВТОИНФОРМАТИВНОСТИ МЕРА (autoinformation

measure) - см. Многомерный статистический анализ.

АВТОКОВАРИАЦИИ ЧАСТНОЙ ФУНКЦИЯ (partial

autocovariance function) - то же, что автокорреляции част

ной функция.

АВТОКОВАРИАЦИОННАЯ ФУНКЦИЯ (autocovariance

function) - см. Корреляционная функция.

АВТОКОВАРИАЦИЯ случайного процесса

(autocovariance of random process) Xt - ковариация Xt и Xt+fr Если

EX обозначает математич. ожидание случайной величины X,

то А. равна E(Xt-EXt)(Xt+h-EXf+h). Термин «А.»

употребляют обычно применительно к стационарным случайным

процессам (в широком смысле). Для них А. зависит только от h

и лишь множителем, равным дисперсии Xt> отличается от

автокорреляции. Наряду с А. употребляют термин

«ковариационная функция». А. В. Прохоров.

АВТОКОРРЕЛОГРАММА случайного процесса

(autocorrelogram of random process) - то же, что коррело-

грамма.

АВТОКОРРЕЛЯЦИИ ЧАСТНОЙ ФУНКЦИЯ (partial

autocorrelation function), автоковариации частной

функция, корреляции частной функция, кова-

риации частной функция,- величина, определяемая

для случайного процесса X (t) с дискретным временем

£ = 0, ±1, ... следующим образом:

v(t,k) =

DX(t), k = 0,

Pt,t-v * = *•

Ptt-k. t-k+\,...,t-\

k = 2„

АВТОКОРРЕЛЯЦИИ 7

где

Pi,/ =

_ соу[Л*Щ/)]

jDXG)DX(j)

- корреляции коэффициент между величинами X (i) и Х(/),

Pt,t-k,t-k+\t-\ ~ частный коэффициент корреляции между

величинами X (t) и X (t - k) при фиксированных значениях

X(t-k-\)} ..., X(t-\).

Пусть вектор случайных величин X(t-k)} X(t-k+ \), ...,

X(t), k>\} имеет функцию (k+ 1)-мерного совместного

распределения Е (xQ, xv...,xk), P - корреляционная матрица

этого вектора:

Р =

1

Pt-k+\,t-k

Pt-k,t-k+\" Pt-k,t

1

'Pt-k+U

Pt,t-k pt,t-k+\

и Pjj - алгебраич. дополнение элемента pt;-, i, j = t-k}...}t.

Тогда коэффициент частной корреляции величин X(t-k) и

Х(0 при фиксированных значениях X(t- k + 1), ..., X(t- 1)

определяется формулой

Рм-М-*+1,...,*-1

-Р,

*-*,*

lp*-*,*-*pa/

V2

В частности, если F(#0, ..., xk) - функция (k+ 1)-мерного

нормального распределения, то Pt-\,t-k,t,t-k+\, совпадает с

коэффициентом корреляции маргинального двумерного

нормального распределения пары X(t) и X(t-k) при

фиксированных значениях X(t-k+ \)} ...} X(t- \).

А. ч. ф. используют при статистич. анализе моделей

Бокса-Дженкинса. Если X(t) - стационарный случайный

процесс авторегрессии порядка р} то для него v (t, k)*Q при k = О,

1, ..., р и v(t} k) = 0 при k^p+\. Это свойство позволяет

идентифицировать порядок авторегрессии р в процессе

построения модели Бокса-Дженкинса по реализации случайного

процесса X(t).

Лит.: [ 1 ] Бокс Дж., Дженкинс Г., Анализ временных рядов.

Прогноз и управление, пер. с англ., в. 1, М., 1974; [2] Кен-

далл М. Дж., СтьюартА., Статистические выводы и связи, пер. с

англ., М., 1973; [3] их же, Многомерный статистический анализ и

временные ряды, пер. с англ., М., 1976. Ю. Г. Баласанов.

АВТОКОРРЕЛЯЦИОННАЯ ФУНКЦИЯ (autocorrelation

function) - см. Корреляционная функция.

АВТОКОРРЕЛЯЦИЯ случайного процесса

(autocorrelation of random process) X(t) - корреляция значений X(t)

и X(t + h). Термин «А.» употребляют (наряду с термином

«корреляционная функция») в основном при изучении

стационарных случайных процессов у для к-рых А. зависит лишь от

h (но не от t). А. В. Прохоров.

АВТОМАТ ВЕРОЯТНОСТНЫЙ (probabilistic automaton) -

см. Вероятностный автомат.

АВТОМАТ СЛУЧАЙНЫЙ (stochastic automaton) - см.

Вероятностный автомат.

АВТОМАТИЧЕСКАЯ КЛАССИФИКАЦИЯ (automatical

classification)- построение последовательности .вложенных

разбиений (множеств кластеров или пересекающихся классов)

С0, Cv ..., Ст совокупности из п объектов, в к-рой число

классов монотонно убывает по мере роста индекса. Множество

С0 содержит п кластеров, состоящих из одного объекта;

каждый кластер из Cj представляет собой либо кластер, либо

8 АВТОКОРРЕЛЯЦИОННАЯ

объединение кластеров из C;_t; множество Ст содержит один

кластер из п элементов.

Лит.: [1] ДюранБ., Оделл П., Кластерный анализ, пер. с

англ., М., 1977; [2] Жамбю М., Иерархический кластер-анализ и

соответствия, пер. с франц., М., 1988. К. Ю. Репин.

АВТОМОДЕЛЬНОЕ РАСПРЕДЕЛЕНИЕ СОСТОЯНИЙ

(self-similar probability distribution) - см. Ренормализацион-

ная группа.

АВТОМОДЕЛЬНОСТИ УРАВНЕНИЯ (self similarity equa

tions) - см. Ренормализационная группа.

АВТОМОДЕЛЬНОСТЬ (self-similarity) - см. Колмогоров-

ская автомодельность.

АВТОМОДЕЛЬНЫЙ ПРЕДЕЛ РАСПРЕДЕЛЕНИЯ (sea

ling limit of a probability distribution) - см.

Ренормализационная группа.

АВТОМОДЕЛЬНЫЙ ПРЕДЕЛ СЛУЧАЙНОГО ПОЛЯ (sea

ling limit of a random field) - см. Ренормализационная группа.

АВТОМОДЕЛЬНЫЙ ПРОЦЕСС (automodel/demistable/

scaling process), полуустойчивый процесс, скей-

л инг-процесс,- случайный процесс Xt, t^O, для к-рого

при любом k*Q найдется Ak такое, что совпадают все

конечномерные распределения процесса Xkt = AkXt. С наглядной

точки зрения это означает, что изменение верменной шкалы

(£->&0 приводит к тому же результату, что и изменение

фазовой шкалы (Xt -> AkXk). А. п. имеет стационарные

приращения, Х0 = а. Если EXt <<*>, то EXt = a при любом ^0 и

еслиЛ* = /гя, 0<Н<\, то E(X,-Xs)2 = a2U-s|2//.

Структурная функция процесса зависит, таким образом, от параметра

Н. При 0,5<Я^1 корреляционная функция приращения

Xt-Xs неинтегрируема, а это означает, что А. п. с параметром

Н имеет бесконечную память. Если Я = 0,5, то А. п.- процесс

с независимыми приращениями, а если Н=\, то Xt = a + Xt,

EX = 0, EX = a . Гауссовский А. п.-фрактальное

броуновское движение, Ak = k .

Лит.: [1) Колмогоров А. Н., в кн.: Избранные труды.

Математика и механика, М., 1985, с. 274-77; [21 Mandel brodt В. В.,

Van Ness J. W., «SIAM Rev.», 1968, v. 10, X° 4, p. 422-37;

[3] Taqqu M.S., «Z. Wahr. verv. Geb.», 1979, v. 50, p. 53-89.

И. А. Кожевникова.

АВТОМОРФИЗМ по модулю нуль (automorphism

mod 0) - см. Автоморфизм пространства с мерой.

АВТОМОРФИЗМ пространства с мерой

(automorphism of a measure space) - взаимно однозначное отображение

Т пространства с мерой (Q, .</, Р) на себя, измеримое вместе с

обратным и сохраняющее меру Р, то есть такое, что Т~*АеЛ,

ТАеЛи Р (Т~ХА) = Р (ТА) = Р (Л) для любого А е .4. Таким

образом, А. пространства с мерой - это эндоморфизм

пространства с мерой, обладающий обратным отображением,

к-рое также является эндоморфизмом. Отображение,

превращающееся в автоморфизм после удаления из пространства

подходящего множества нулевой меры, называется

автоморфизмом по модулю нуль (автоморфизмом

mod 0). В тех вопросах эргодич. теории, к-рые касаются

конечных или счетных семейств преобразований, различие

между автоморфизмами и автоморфизмами mod 0 несущественно.

Примером автоморфизма вероятностного пространства может

служить сдвиг в пространстве реализаций двусторонней

стационарной в узком смысле случайной последовательности

хп, -оо < п < <*>. Б.М. Гуревич.

/Г-АВТОМОРФИЗМ (/C-automorphism) - см. К-система.

АВТОРЕГРЕССИИ МОДЕЛЬ (autoregression model) -

модель скалярного комплекснозначного в общем случае

случайного процесса {X(t), teT}} T= {0, ±1, ±2, ...},

удовлетворяющего уравнению

XU) + a^X(t-\)+ ... +apX(t-p)=o2Z(t),

где #!,...,Др - действительные числа, 0<а2<°°, {Z(t),teT} -

стандартная некоррелированная последовательность комплек-

снозначных в общем случае случайных величин, то есть

случайных величин таких, что EZ(O = 0, EZ(s)Z(t) = bst, s,teT,

p - число, называемое порядком А. м.

А. м. вместе со скользящего среднего моделью полностью

исчерпывает класс моделей стационарных скалярных комп-

лекснозначных процессов с дискретным временем и дробнора-

циональными спектральными плотностями. А. м. является

адекватной стохастич. моделью многих встречающихся на

практике процессов.

Лит.: [1] Справочник по теории вероятностей и математической

статистике, 2 изд., М., 1985; [2] Бокс Дж., Дженкинс Г., Анализ

временных рядов. Прогноз и управление, пер. с англ., в. 1, М., 1974;

[3] КендаллМ., СтьюартА., Многомерный статистический

анализ и временные ряды, пер. с англ., М., 1976. Ю. П. Юрачковский.

АВТОРЕГРЕССИИ ПРОЦЕСС (autoregressive process) -

случайный процесс {Х(0}, значения к-рого удовлетворяют

при нек-рых постоянных «t, ..., ар уравнению авторегрессии

X(t) = a^X(t-\) + ... + apX(t-p) + Y(t), (*)

где р - нек-рое положительное число, а величины У (О

обычно предполагаются некоррелированными и одинаково

распределенными со средним 0 и дисперсией а . Если все нули

функции <p(z) = z р - axz Р~* - ... - ар комплексного аргумента z

лежат внутри единичного круга, уравнение (*) имеет решение

где bv связаны с а соотношением

<p-'(2)=V(2)=x:=0vv-

Пусть, напр., {У(0} является процессом белого шума со

спектральной плотностью а /2л; тогда единственным А. п.,

удовлетворяющим уравнению (*), будет стационарный в

широком смысле процесс {X (t)} со спектральной плотностью

f(\) = (G2/2n) |<р(е* )|~2, если у(ег ) не имеет действительных

нулей. Автоковариации процесса rk=EX(t)X(t-k)

удовлетворяют рекуррентному соотношению гЛ = в1г^_1 + ... +<VV„,

k>0, ив терминах bv имеют вид

Параметры ak авторегрессии связаны с коэффициентами

автокорреляции процесса Pk = rk/ro матричным соотношением

А = R~ppp, щеА = (аи ..., ар)} p^=(pt, ..., рр) и Rp - матрица

коэффициентов автокорреляции (Юла-Уокера уравнения).

См. также Линейный фильтр.

Лит.:[\] Grenander V., Rosen b 1 at t M., Statistical analysis of

stationary time series, Stockh., 1956; [2) Хеннан Э., Анализ

временных рядов, пер. с англ., М., 1964. А. В. Прохоров.

АВТОРЕГРЕССИИ ПРОЦЕСС дробного порядка

(fractional autoregressive process) - см. Херста явление.

АВТОРЕГРЕССИИ - ПРОИНТЕГРИРОВАННОГО

СКОЛЬЗЯЩЕГО СРЕДНЕГО ПРОЦЕСС (autoregressive-integrated

moving average process), АРПСС-процесс (ARIMA

process), Бокса-Дженкинса процесс,- нестационарный

случайный процесс X(t) с дискретным временем t = О, ± 1, ...,

такой, что его приращения нек-рого конечного порядка d

представляют собой стационарный смешанный

авторегрессии - скользящего среднего процесс (так что сам А.- п. с. с. п.

является процессом со стационарными приращениями d-ro

порядка). А.- п. с. с. п. X(t) удовлетворяет соотношениям

Y(t)-axY(t-\)- ... -apY(t-p) =

= Z(t)-bxZ(t-\)- ... -bqZU-q), С)

wY(t)=VdX(t)=X(t)-C(jX(t-\) + CJX(t-2)-...+ (-\)dx

x.X(t-d), Z(t), t = 0, ±1, ...,- последовательность

некоррелированных случайных величин с нулевым средним значением

и заданной дисперсией (то есть белый шум с дискретным

временем), р, q и d - фиксированные неотрицательные целые

числа, а ах> ..., apf bv ..., bq - числовые коэффициенты такие,

что уравнение (*) имеет стационарное решение. Целые числа

р, q и d определяют порядок (или тип) рассматриваемого

процесса X(t), и они обычно прежде всего определяются по

имеющимся данным наблюдений (см. Параметрическая

модель; выбор порядка); только после этого те же данные

используют для оценки значения коэффициентов av ..., ару fct,

.... v

Класс А.- п. с. с. п. был введен в рассмотрение и подробно

изучен Дж. Боксом (G. Box) и Г. Дженкинсом (G. Jenkins),

показавшими, что процессы этого класса часто достаточно

хорошо описывают самые разнообразные беспорядочно

флуктуирующие ряды наблюдений и очень удобны для решения

широкого круга статистич. задач, относящихся к таким рядам

(см. [1]).

Лит.: [1] Бокс Дж., Дженкинс Г., Анализ временных рядов.

Прогноз и управление, пер. с англ., в. 1-2, М., 1974. А. М. Яглом.

АВТОРЕГРЕССИОННАЯ СПЕКТРАЛЬНАЯ ОЦЕНКА

(autoregressive spectral estimator) - см. Максимальная

энтропия; спектральная оценка.

АВТОРЕГРЕССИЯ (autoregression) - регрессионная

зависимость значений Хп нек-рой случайной последовательности

{Хп} я = 0, ±1, ...} от предшествующих значений X„_t, X„_2,

..., X„_w. Схема линейной A. w-ro порядка определяется

уравнением линейной регрессии Хп по Xn_k} k=\} ..., w, то есть

*я-РА-1+ ••• +РА_т + е„, С)

где pj, ..., pw - постоянные, случайные величины гп одинаково

распределены с нулевым средним, дисперсией о2 и некоррели-

рованы (иногда независимы). Схема А. служит полезной

стохастич. моделью для описания нек-рых временных рядов.

Схема А. (*) может быть рассмотрена как случайный процесс

особого типа - авторегрессии процесс. А.В. Прохоров.

АДАМАРА МАТРИЦА (Hadamard matrix) в

планировании эксперимента- квадратная матрица HN порядка

N>\, состоящая из +1 и -1, и такая, что

HNHN = NEN>

где EN - единичная матрица. А. м. названы по имени Ж. Ада-

мара, изучавшего экстремальные свойства определителя таких

матриц (см. [1]), хотя соответствующие построения для

случая N = 2 были выполнены еще Дж. Сильвестром (см. [2]).

А. м. называется нормализованной, если ее первая

строка и первый столбец состоят только из +1. Необходимое

условие существования А. м.: N = 0 (mod 4) или N = 2.

Достаточность этого условия пока не доказана и не опровергнута. В

планировании эксперимента к задаче построения А. м.

приходят при оценивании p(p^N) неизвестных параметров

моделей двух типов. Модель I имеет вид полинома первого

порядка, модель II отличается от модели I отсутствием

свободного члена. Использование в качестве матрицы плана

любых р - 1 из N - 1 последних столбцов нормализованной

А. м. для модели I и любых р столбцов А. м. для модели II

приводит к так наз. ортогональному планированию

(то есть к планированию с диагональной информационной

матрицей). А. м. используют также при построении неполно-

блочных планов и других схем планирования.

Лит.: [1] Hadamard J., «Bull. sci. math.», ser. 2, 1893, t. 17,

p. 240-46; [2] Sy 1 vester J. J., «Phil. Mag>, 1867, v. 34, p. 461-72;

[3] Новые идеи в планировании эксперимента, М., 1969;

[4] Hedayat A., WallisW.D., «Ann. Statist.», 1978, v. 6,

p. 1184-238. В. З. Бродский.

АВТОРЕГРЕССИЯ 9

АДАПТАЦИИ АЛГОРИТМ (adaptation algorithm) - способ

построения статистических оценок, основанный на

совмещении оптимальных методов обработки наблюдений с

одновременным восстановлением недостающей или неопределенной

информации. А. а. применяется в тех случаях, когда

оптимальные значения параметров алгоритма зависят от

характеристик (функционалов) неизвестного распределения

наблюдений. Параметры алгоритма выбираются на основе оценок этих

характеристик. А. а. являются, как правило, эффективными в

асимптотич. смысле (предельно оптимальными).

Лит.: [1] Фомин В. Н., Рекуррентное оценивание и адаптивная

фильтрация, М., 1984; [2) Bickel P.J., «Ann. Statist.», 1982, v. 10,

N° 3, p. 647-71. А. П. Коростелев.

АДАПТИВНАЯ ОЦЕНКА (adaptive estimator) -

статистическая оценка, предназначенная для нахождения

неизвестного параметра в схеме наблюдений с конечномерным или

бесконечномерным мешающим параметром и обладающая

асимптотически теми же свойствами, что и наилучшая в том

или ином вероятностном смысле оценка при известном

значении мешающего параметра. Используются и другие

интерпретации понятия А. о. (см.[1]).

Лит.: [11 Bickel P.J., «Ann. Statist.», 1982, v. 10, № 3,

p. 647-71. М.Б. Невельсон.

АДАПТИВНАЯ ПРОЦЕДУРА (adaptive procedure) - см

Стохастическая аппроксимация.

АДАПТИВНЫЙ УПРАВЛЯЕМЫЙ СЛУЧАЙНЫЙ

ПРОЦЕСС с дискретным временем (adaptive controlled

random process in discrete time) - см. Управляемый случайный

процесс с дискретным временем.

F- АДАПТИРОВАННАЯ ФУНКЦИЯ (F-adapted

function) - см. Неупреждающая функция.

АДАПТИРОВАННЫЙ СЛУЧАЙНЫЙ ПРОЦЕСС

(adapted random process) - см. Согласованный случайный процесс.

а-АДДИТИВНАЯ МЕРА (а-additive measure) - см.

Вполне аддитивная функция множеств.

АДДИТИВНАЯ МОДЕЛЬ (additive model) блочного

плана - см. Блочный план.

АДДИТИВНАЯ ФУНКЦИЯ (additive function) - см.

Арифметическое моделирование случайных процессов,

Вероятностная теория чисел.

АДДИТИВНАЯ ФУНКЦИЯ МНОЖЕСТВ (additive set

function) - функция, определенная на нек-ром классе

множеств и обладающая свойством аддитивности (для двух

слагаемых). Точнее, пусть заданы нек-рый класс множеств К и

коммутативная группа G, групповая операция к-рой

обозначена символом + (то есть G берется в аддитивной записи).

Функция \i: K^>G называется аддитивной, если, каковы

бы ни были множества ХеК и Ye К, для к-рых XUYe/C и

ХПУ = 0, обязательно выполняется равенство

ц(ХиУ)=цШ + ц(У).

Если 0еК, то |i(0) = 0, где 0 - нулевой элемент группы G.

На практике в качестве группы G часто фигурируют:

действительная прямая II? , поле комплексных чисел С, евклидово

я-мерное пространство IRW, различные коммутативные тополо-

гич. группы, бесконечномерные векторные пространства и

т. п. С другой стороны, весьма часто исходный класс К с

самого начала предполагается аддитивным, то есть, каковы бы

ни были множества ХеК и Ye К, справедливо соотношение

XUY еК (это означает, что класс К представляет собой

верхнюю полурешетку относительно операции U). Для

аддитивных классов всякая А. ф. м. является одновременно и

конечно-аддитивной функцией множеств. Другими словами, если

10 АДАПТИВНАЯ

К - произвольный аддитивный класс, |1 - произвольная

аддитивная функция на К, то

ц(Х,и... иХш) = ц(Х,)+ ... +ц(Хт)

для всякого конечного дизъюнктного семейства (Х^)^,.^

элементов из К.

Если класс К представляет собой решетку относительно

операций U и П, то условие аддитивности функции \i: K^>G

часто задают в виде равенства

U<XUY) + u<XnY) = u<X) + um,

где X и У - любые элементы из класса К.

В математич. анализе, евклидовой геометрии, теории

вероятностей и теории меры особенно важную роль играют

числовые аддитивные функции, определенные на различных

алгебрах или кольцах множеств и обладающие нек-рыми

дополнительными свойствами.

Лит.: [11 Халмош П., Теория меры, пер. с англ., М., 1953.

А. Б. Харазишвили.

АДДИТИВНЫЕ ЗАДАЧИ теории чисел (additive

problems of number theory) (с растущим числом слагаемых) -

задачи о разбиении целых чисел на слагаемые заданного вида.

Простейшая постановка такой задачи заключается в

следующем. Пусть fix) - целозначная функция натурального

аргумента, р - фиксированное или растущее натуральное число.

Требуется отыскать асимптотич. формулу для числа

представлений I (N, п) натурального N в виде

N = f(x^) + f(x2) + ... +/■(*„),

где O^JTj, х2, ..., хп^р-\ и п - растущий к бесконечности

параметр.

Эту задачу можно сформулировать и на языке теории

вероятностей. Пусть Xt, X2, ..., Хп- последовательность

I одинаково распределенных случайных величин с общим

распределением

P{Xi=f(k)} = \/p, k = 0, 1, ...,р-\,

и пусть Q = EXV DXt=a >0. Рассматривается случайная

величина Yn = Хх + Х2 + ... +Х„. Вероятность равенства

Yn = N равна

P{Yn = М = { e~2KiaN I1 Z£i e2niafU) J da- (*>

Очевидно,

P{Yn = N}=p-nI(N,n).

Выделение главной части интеграла (*), то есть нахождение

асимптотич. формулы для I (N, п), возможно в трех случаях:

1) п фиксировано, р растущее, 2) п растущее, р фиксировано,

3) п и р=р(п) одновременно растущие натуральные числа.

Первый случай характерен для теории чисел и асимптотич.

формула находится с помощью методов аналитич. теории

чисел. Во втором случае локальная предельная теорема

позволяет получить асимптотику для I (N, п). В третьем случае

нахождение асимптотич. формулы для I(N, n) равносильно

локальной предельной теореме для последовательностей серий

независимых в каждой серии случайных величин. Здесь

сложность заключается в получении равномерной оценки

остаточного члена относительно исходных распределений, а это

требует оценки тригонометрич. суммы

I S(f,a) = ±Yp~\e2*iafM

р *-*х=0

во всем интервале изменения а при р -> °°. Так как не

существует общих теорем об оценках S(f, a), то выделяют классы

! задач, в пределах к-рых будут установлены равномерные

локальные теоремы. Наиболее изучены случаи, когда fix) -

I степенная функция или многочлен.

Л. з. с растущим числом слагаемых впервые рассмотрел Г.

Кастельнуово (G. Castelnuovo, 1933), к-рый в случае fix) = х,

применяя вероятностные соображения, получил главный член

асимптотики для I(N, п). Систематич. исследование таких

задач началось с работы А. Г. Постникова (1956, см. [1]). Он

в случаях f(x)=x и f(x)-x строго доказал асимптотич.

формулы для I (N, п) с равномерной оценкой остаточного

члена. Существует много различных обобщений А. з.:

переменные пробегают простые числа или все множество

натуральных чисел, рассмотрены многомерные случаи (см. [3]) и т.д.

А. з. теории чисел с растущим числом слагаемых находят

применения в математич. статистике, в частности они

существенным образом появляются при исследовании асимптотич.

свойств ранговых статистик [4].

Лит.: |1] Постни ков А. Г., Введение в аналитическую теорию

чисел, М., 1971; [2] Сиражди нов С. X., Аз л аров Т. А., Зу

паров Т. М., Аддитивные задачи с растущим числом слагаемых, Таш.,

1975; [3] Исраилов М. И., «Записки науч. семин. ЛОМИ.

Исследования по теории чисел, 8», 1983, т. 121, с. 62-82; [4]

Королю к B.C., Борове к и х Ю. В., Асимптотический анализ

распределений статистик, К., 1984. М. И. Исраилов.

АДДИТИВНЫЙ ФУНКЦИОНАЛ интегрального

типа (additive functional of integral type) - семейство

случайных величин

aj = ft f(u,X(u))du, 0^t<s,

где X - случайный процесс с независимыми приращениями,

f: [О +oo)xlR ->IR - борелевская функция, для к-рой

определен интеграл в правой части равенства.

Лит.: [1] Скороход А. В., Случайные процессы с независимыми

приращениями, 2 изд., М., 1986; 12] С короход А. В., Слободе-

н юк Н. П., Предельные теоремы для случайных блужданий, К., 1970.

В. И. Колчинский.

АДДИТИВНЫЙ ФУНКЦИОНАЛ от винеровского

процесса (additive functional of the Wiener process) -

непрерывное по совокупности аргументов семейство случайных

величин ast, Q^t<s, удовлетворяющее условиям аддитивности

(ast = a" + (Xy, t<u<s) и согласованности с винеровским

процессом w(t), t^O (ast измерима относительно а-алгебры Fst,

порожденной значениями процесса w(u), ue\t, s ], t<s).

Лит.: [1] Скороход А. В., Случайные процессы с независимыми

приращениями, 2 изд., М., 1986; [2] С короход А. В., Слободе-

н юк Н. П., Предельные теоремы для случайных блужданий, К., 1970.

В. И. Колчинский.

АДДИТИВНЫЙ ФУНКЦИОНАЛ от марковского

процесса (additive functional of a Markov process) -

см. Марковский процесс, аддитивный функционал.

АКАИКЕ ИНФОРМАЦИОННЫЙ КРИТЕРИЙ (Akaike

information criterion, AIC) - см. Наилучшего подмножества

предикторов выбор.

АКАИКЕ КРИТЕРИЙ (Akaike criterion)

окончательной ошибки прогноза-см. Параметрическая модель;

выбор порядка.

АКСИОМАТИЧЕСКАЯ КВАНТОВАЯ ТЕОРИЯ ПОЛЯ

(axiomatic quantum field theory) - раздел квантовой теории

поля, в к-ром формулируются общие постулаты, абстрактно

описывающие объект «квантовое поле», и выводятся

многочисленные следствия из них.

Наиболее употребительная система аксиом принадлежит

Л. Гордингу и А. Уайтману (см. [2]). Напр., в простейшем

случае скалярного нейтрального бозонного поля в

пространстве Минковского М это поле задается семейством {<р(/*),

feS(M )}, d^2, симметрич. операторов, действующих в

нек-ром гильбертовом пространстве Н и помеченных

гладкими, быстро убывающими функциями feS(M ) из

пространства Шварца; при этом соответствие ^-><р(/*) линейно по /*, а

операторы <р(/^) и ф(/^) коммутируют, если носители fx и f2

пространственноподобны относительно друг друга.

Предполагается далее, что: а) в пространстве Н задано нек-рое

унитарное представление g -> Ug группы Пуанкаре (группы

движений Md) так, что для всех g nfeS(М ) Ugy(f)U~x = <p(tgf),

(igf)(x)=f(g~ x), xgM ; б) совместный спектр

порождающих операторов {Рц, |i=l, ..., d} подгруппы Uq,

соответствующей трансляциям М , лежит в верхней полосе светового

конуса в М : в) существует единственный (с точностью до

множителя) вектор QeH, инвариантный относительно

представления g -> U' и циклический относительно семейства

{<р(/*), feS(Md)}. Имеются различные модификации этой

системы аксиом, а также их переформулировки в терминах так

наз. Уайтмана функций: wn(fu ..., fn) = (y(fi)...<p(fn)Q, Q)H

(см. [1]). Наиболее глубокие следствия этой аксиоматики

связаны с изучением аналитич. свойств функций Уайтмана и

построением формальной теории рассеяния (см. [1], [2]).

Лит.: [1] Йост Р., Общая теория квантованных полей, пер. с

англ., М., 1967; [2] WightmanA., Garding L., «Ark. Phys.»,

1964, v. 28, p. 129-84; [3] Боголюбов Н. Н. [и др.], Общие

принципы квантовой теории поля, М., 1987. Р. А. Минлос.

АКТИВНАЯ ПЕРЕМЕННАЯ (active variable) - см. Много

мерных данных модель структуры.

АКТИВНЫЙ ЭКСПЕРИМЕНТ (active experiment) -

совокупность измерений, организованная в соответствии с принципами

регрессионных экспериментов планирования. М. Б. Малютов.

*-АЛГЕБРА (*-algebra) - см. Алгебра наблюдаемых.

АЛГЕБРА КВАЗИЛОКАЛЬНЫХ НАБЛЮДАЕМЫХ

(algebra of quasi-local observables) - см. Некоммутативная

теория вероятностей.

АЛГЕБРА МНОЖЕСТВ (algebra of sets) - непустая

совокупность подмножеств нек-рого множества Q, замкнутая

относительно теоретико-множественных операций (объединения,

пересечения, образования дополнения), производимых в

конечном числе. Для того чтобы нек-рый класс подмножеств

множества Q. был А. м., достаточно (и необходимо), чтобы он

был замкнут относительно образования объединений и

дополнений. A.m., замкнутая относительно образования счетных

объединений, называется о-алгеброй множеств. Всякая

а-алгебра множеств замкнута относительно

теоретико-множественных операций, производимых в счетном числе.

Примеры. 1) Совокупность конечных подмножеств

произвольного множества £1 и дополнений к ним есть A.m.;

совокупность не более чем счетных подмножеств О. и

дополнений к ним есть а-алгебра множеств.

2) Совокупность конечных объединений интервалов вида

{.г eIRitf ^х<Ь}, -оо^д^б^+оо, образует А. м.

3) Q - тонологич. пространство; а-алгебра множеств di,

порожденная открытыми подмножествами £1 (иными словами,

наименьшая а-алгебра множеств, содержащая все открытые

подмножества Ш, называется борелевской а-а л г е б р о й

подмножеств £1, а множества, принадлежащие Зв, называются

борелевскими множествами.

4) Q = B? , где Т- произвольное множество (то есть £1-

множество всех действительных функций на Т)\ класс М

множеств вида {coeQ: (со(^), ..., со(^)) е£}, где Е - борелев-

ское подмножество II? , образует А. м. (так наз. алгебру

цилиндрических множеств)', в теории случайных процессов

вероятностная мера часто задается первоначально лишь для

множеств из алгебры этого типа и затем доопределяется на более

широком классе множеств (на а-алгебре, порожденной .</).

5) Совокупность измеримых по Лебегу подмножеств II?

образует а-алгебру множеств. Алгебры (соответственно а-алгебры)

АЛГЕБРА 11

являются естественной областью определения

конечно-аддитивных (соответственно а-аддитивных) мер. По теореме о

продолжении меры всякая а-конечная а-аддитивная мера, заданная

на алгебре **/, может быть однозначно продолжена до а-адди-

тивной меры, определенной на а-алгебре, порожденной л/.

Лит.: [1] ДанфордН., ШварцДж., Линейные операторы.

Общая теория, пер. с англ., М., 1962; [2] Халмош П., Теория меры,

пер. с англ., М., 1953; [3] Неве Ж., Математические основы теории

вероятностей, пер. с франц., М., 1969. В. В. Сазонов.

G -АЛГЕБРА МНОЖЕСТВ (a-algebra of sets), а-а л г е б р а,-

алгебра множеству обладающая тем свойством, что

объединение любого (не более чем) счетного семейства элементов этой

алгебры также является ее элементом. Из определения

непосредственно вытекает, что пересечение любого счетного

семейства элементов а-А. м. также служит ее элементом. Если

(Х;);е/ - произвольная система частей основного базисного

пространства X, то а-алгеброй, порожденной этой

системой, называется наименьшая по включению а-А. м. в

X, содержащая в качестве элементов все множества Xf, iel.

Счетнопорожденной а-А. м. называется всякая а-А. м.,

порожденная какой-нибудь счетной системой частей основного

базисного пространства X (такие а-А. м. иногда называются

а-алгебрами счетного типа, или сепарабельны-

м и а-а лгебрами). В приложениях наиболее часто

встречаются именно а-А. м. счетного типа.

Пусть основное базисное пространство X наделено нек-рой

топологич. структурой; другими словами, X - топологич.

пространство. Тогда борелевской а-а лгебройвХ

называется а-А. м., порожденная семейством всех открытых частей

этого пространства (или, что эквивалентно, порожденная

семейством всех замкнутых подмножеств этого пространства).

Если исходная топология в X удовлетворяет второй аксиоме

счетности (то есть обладает счетной базой), то борелевская

а-А. м. в X является счетнопорожденной.

Борелевские а-А. м. (а также различные их подалгебры)

играют важную роль во многих вопросах функционального

анализа, общей топологии и теории вероятностей.

В теории вероятностей основным примером а-А. м. служит

а-А. м. событий данного вероятностного пространства. В клас-

сич. теории функций действительного переменного

фундаментальную роль играют а-А. м. всех измеримых по Лебегу

подмножеств конечномерного евклидова пространства и а-А. м.

всех тех подмножеств евклидова пространства, к-рые

обладают свойством Бэра.

С понятием а-А. м. тесно связано более общее понятие

о-кольца множеств (см. Мфб).

Лит.: [1] Прохоров Ю. В., Розанов Ю. А., Теория

вероятностей. Основные понятия. Предельные теоремы. Случайные процессы,

3 изд., М., 1987; [2] Неве Ж., Математические основы теории

вероятностей, пер. с франц., М., 1969; [3] Халмош П., Теория меры,

пер. с англ., М., 1953; [4] ГихманИ. И., Скороход А. В.,

Введение в теорию случайных процессов, 2 изд., М., 1977.

А. Б. Харазишвили.

АЛГЕБРА НАБЛЮДАЕМЫХ (algebra of observables) -

одно из базисных понятий некоммутативной теории

вероятностей. Множество элементов X, У, ..., в к-ром определены

операции сложения, умножения на комплексное число,

произведения, удовлетворяющие аксиомам ассоциативной алгебры,

и операция инволюции Х->Х*, удовлетворяющая аксиомам

(Х*)* = Х, (X+Y)* = X*_+Y*,

(XY)* = Y*X*, (XX)* = XX*,

где Х- произвольное комплексное число, называется

•-алгеброй. Напр., совокупность комплексных случайных вели-

12 АЛГЕБРА

чин на данном вероятностном пространстве образует

коммутативную *-алгебру. В некоммутативной теории вероятностей

рассматриваются общие модели физич. систем, для к-рых

совокупность наблюдаемых образует, вообще говоря,

произвольную *-алгебру. Некоммутативность наблюдаемых X, У

является отражением реального феномена дополнительности,

имеющего место, напр., для квантовомеханич. систем (см.

Неопределенностей соотношение). Следует иметь в виду, что

(действительными) наблюдаемыми в собственном смысле

слова являются лишь самосопряженные элементы

•-алгебры, то есть такие элементы X, что Х* = Х.

С математич. точки зрения удобно иметь дело с алгебрами

ограниченных наблюдаемых, в к-рых можно ввести понятие

нормы. Банахова "-алгебра tt, в к-рой |х*х| = ||х|| ,

называется С*-алгеброй. Самосопряженный элемент Xett

называется положительным, Х^О, если X=Y*Y, где У ett.

Полагая X^Z, если X-Z^O, во множестве

самосопряженных элементов tt вводят структуру действительного, частично

упорядоченного векторного пространства.

Состоянием на С*-алгебре с единицей / называется

положительный линейный функционал <р на tt, <p(X)^0, если

Х^О, такой, что ф(/)=1. Множество всех состояний ®

является выпуклым слабо *-компактным подмножеством

сопряженного пространства tt*.

Примеры. 1) Совокупность ограниченных комплексных

случайных величин X (со) на данном измеримом пространстве

Q с обычными алгебраич. операциями, комплексным

сопряжением в качестве инволюции и равномерной нормой образует

коммутативную С*-алгебру. Всякое распределение

вероятностей Р(б/со) на Q порождает состояние по формуле

<p(X) = Jn X(co)P(rfco).

2) Совокупность Lq (Q}\i) классов эквивалентности

ограниченных комплексных случайных величин на пространстве с

мерой (Q, \i) с нормой ||х|| =ess sup |x(co)| образует

коммутативную С*-алгебру. Если /?(со) - интегрируемая случайная

величина такая, что /? (со) ^ с (mod \i) и

jQ /?(g))uWco),

то соотношение

ф(Х) = |п Х(со)р(со)ц<<Ы

задает состояние на Lq (Q, \i).

3) Совокупность ЯЗ(Я) всех ограниченных операторов в

комплексном гильбертовом пространстве Я с операторной

нормой образует некоммутативную С*-алгебру. Соотношение

ф(Х) = trSX, где S - оператор плотности, a tr - след

оператора в Я, задает состояние на ЯЗ(Я).

Любая абстрактная С*-алгебра изоморфна алгебре

ограниченных операторов в нек-ром гильбертовом пространстве Я.

При этом коммутативные С*-алгебры реализуются как

алгебры операторов умножения на функции. Операторная

С*-алгебра, замкнутая в слабой операторной топологии, называется

Н^-алгеброй [примеры 2) и 3)]. Состояние фна W^-алгеб-

реtt называется нормальным, если для любого

ограниченного направленного множества эрмитовых элементов {Ха} cz tt

выполняется sup ф(Ха) = ф(зир Ха). В примерах 2) и 3)

а а

дается общий вид нормальных состояний на соответствующих

W* -алгебрах.

Лит.: [1] ДиксмьеЖ., С*-алге6ры и их представления, пер. с

франц., М., 1974; [2] БраттелиУ., Робинсон Д., Операторные

алгебры и квантовая статистическая механика, пер. с англ., М., 1982.

А. С. Холево.

АЛГЕБРА СОБЫТИИ (algebra of events) - алгебра

подмножеств Л нек-рого множества Q, элементы к-рого называются

элементарными событиями. Как и всякая алгебра

множеств, А. с. замкнута относительно

теоретико-множественных операций - объединения, пересечения, образования

дополнения, производимых в конечном числе. А. с, замкнутая

относительно образования счетных объединений, называется

а-алгеброй событий. Всякая а-алгебра событий

замкнута относительно теоретико-множественных операций,

производимых в счетном числе.

В теории вероятностей часто рассматриваются следующие

А. с. и а-алгебры событий: 1) Алгебра конечных подмножеств

множества Q и дополнений к ним; а-алгебра счетных

подмножеств множества Q и дополнений к ним. 2) Алгебра

подмножеств 1Р\ образованная конечными объединениями интервалов

вида {x=(xv ..., xk) е И? : а{ ^ х{ < bif i = 1, ..., k, -°° ^ а{ < bi ^

^+<*>}.'3) а-алгебра борелевских подмножеств топологич.

пространства Q, то есть наименьшая а-алгебра, содержащая все

открытые подмножества Q. 4) Алгебра цилиндров в

пространстве функций (траекторий) и а-алгебра, ими порожденная.

Алгебры и а-алгебры событий являются областью

определения вероятности Р. Если Р(£) = 0, то £ называется

невозможным событием, а если Р(£) = 1, то £ -

достоверное событие. Всякая а-аддитивная вероятность на алгебре

Л однозначно продолжается до а-аддитивной вероятности,

определенной на а-алгебре, порожденной Л (то есть

наименьшей а-алгебре, содержащей Л).

Лит.: [1] КолмогоровА. Н., Основные понятия теории

вероятностей, 2 изд., М., 1974; [2] Неве Ж., Математические основы

теории вероятностей, пер. с франц., М., 1969. В. В. Сазонов.

а-АЛГЕБРА СОБЫТИЙ (а-algebra of events) - см.

Алгебра событий, Борелевское поле событий.

АЛГЕБРА ЦИЛИНДРИЧЕСКИХ МНОЖЕСТВ (algebra of

cylinders) - алгебра Л цилиндров с конечномерными

измеримыми основаниями в произведении пространств О. - ГТ fy,

где Г - произвольное множество и Clt - множество с

выделенной в нем алгеброй подмножеств Av teT. Элементами

алгебры Л являются так наз. цилиндры - множества вида

{со={со„ teT}:TsG>eEeHteSAt}, (»)

где S - конечное подмножество в Г, Г5со = {со,, teS}-

проекция элемента со на ТТ Qt и |7 At - произведение алгебр

At, teS} то есть совокупность конечных объединений

подмножеств FT Clt вида {{со,, t e S}: со, е Et e At, t e S}.

Множество Е называется основанием цилиндра (*). Если At -

а-алгебры, то множества (*) с фиксированным S тоже

образуют а-алгебру, но само ^/, вообще говоря, алгеброй не является.

См. также Цилиндрическая о-алгебра.

Лит.: [ 1) Неве Ж., Математические основы теории вероятностей,

пер. с франц., М., 1969; [2] Лоэв М., Теория вероятностей, пер. с

англ., М., 1962. В. В. Сазонов.

АЛГЕБРАИЧЕСКОЕ ДЕКОДИРОВАНИЕ (algebraic

decoding) - декодирование, использующее алгебраическую

структуру кода. Напр., для qr-ичного кода БЧХ длины n-qm- 1 и

с конструктивным расстоянием 2t + 1, задаваемого системой

линейных уравнений

X":; с,а" = 0, /-1, 2, .... 2t,

где а - примитивный элемент поля F» из qm элементов, его

А. д. состоит в решении системы алгебраич. уравнений

X!.. И*/-5;. 1-1.2 2t,

относительно неизвестных у{, xi e Fqm. Соответствующий

алгоритм Берлекэмпа имеет полиномиальную сложность

(см. Сложность кодирования и декодирования) и позволяет

правильно восстановить сообщение (кодовое слово), если

произошло не более t ошибок. К настоящему времени для

большинства классов кодов неизвестны А.д., минимизирующие

ошибочного декодирования вероятность.

Лит.: [1] Берлекэмп Э., Алгебраическая теория кодирования,

пер. с англ., М., 1971. Г. А. Кабатянский.

АЛГЕБРАИЧЕСКОЕ СЛУЧАЙНОЕ УРАВНЕНИЕ

(algebraic random equation) - уравнение вида

/•(0 = ^ + Х1^"Ч ... +ХП = 0, С)

у к-рого коэффициенты Xi} i- 1, ..., я, являются случайными

величинами. Корни V;, i— 1, ..., я, уравнения (*) представимы

в виде Vj^j+Hij, v2 = X1-qil, ..., v2/M=X* + Hifc, v2k = h~

-Щк>Ъы=*и ->vn = x„-2k> Ы> ... ^|уя|,гдеЯ,„ц/,/=1,

..., k, Xy, 7 = 1, .., n-2k,- действительные случайные

величины, индекс k является случайной величиной, принимающей

целые значения от 0 до [я/2].

Если существует совместная плотность распределения р (xv

..., хп) коэффициентов Xif i=l, ..., я, то с вероятностью

1 корни уравнения (*) различны. Если коэффициенты Х{

уравнения (*) комплексные, а мнимые и действительные части

случайных коэффициентов Х{ имеют совместную плотность

распределения p(Rezi} lmzi} i- 1, ..., я), где z{ -

комплексные переменные, то плотность распределения корней V;, г- 1,

..., я, argvt> ... >argv„, равна

^(КеА,1тА,1=1,...,я)Пи=1 Uti>J\'i''jl

arg2t>...>arg2„,

где A,-, i=l, ..., я,- симметрич. функции комплексных

переменных ziy i=l, ..., я. Справедлива формула: число корней

я (я, Ь) уравнения (*) на интервале (я, Ъ ) действительной оси

равно

п(ауЪ)=(2%Тх £ dy \ba cos[yf(t)]\f'(t)\dt}

причем кратный корень считается один раз; если корень

совпадает с а или Ь, то я (я, Ь) уменьшается на 1/2. Если

коэффициенты Xiy i- 1, ..., я, независимы и распределены по

нормальному закону N (0, 1), то

Ея(я, Ь) = тГ1 £ [1 - h\ (tj\ (1 -t2 Г1 dt,

hn(t) = ntn-H\-t2)(\-t2nr\

Лит.: [1] Кац М., Вероятность и смежные вопросы в физике, пер.

с англ., М., 1965. В. Л. Гирко.

АЛГОРИТМИЧЕСКАЯ ЭНТРОПИЯ (Kolmogorov

complexity entropy), энтропия конечных объектов,

сложность конечных объектов,- введенная А. Н.

Колмогоровым [1] мера информации количества, необходимого для

описания данного объекта.

Способом описания называют вычислимое (нек-рым

алгоритмом) частичное отображение (вообще говоря, не всюду

определенное) множества двоичных слов (конечных

последовательностей нулей и единиц) в себя. Сложностью

KG(x) слова х относительно способа описания G

называется длина самого короткого из тех слов р} для к-рых

G(p)=x. Существует оптимальный способ описания F, при

к-ром KF (x) ^ KG (х) + О (1) для любого способа описания G

(см. [1]). Сложность слова относительно оптимального

способа описания (определенная с точностью до ограниченного

слагаемого) называется алгоритмической энтропией

этого слова и обозначается К (х).

А. э.- невычислимая функция; не существует способа

эффективно указывать слова с А. э., к-рая больше заданной. А. э.

слова не превосходит его длины (+О(0); для большинства

слов данной длины это неравенство близко к равенству (такие

АЛГЕБРА 13

слова естественно считать «случайными»). Вычислимые

отображения увеличивают А. э. не более чем на константу

(см. [2]).

Существуют и другие варианты А. э., отличные от

приведенной простой колмогоровской А. э. (см. [2]-[4]). Среди них -

условная А. э. К(х\у), измеряющая количество

информации, к-рое необходимо для описания х при известном у;

разность 1(у: х) = К (х) - К (х\у) называется количеством

информации в у об х. Функция / почти симметрична:

I(x:y)-I(y:x) = 0(\og(l(x) + l(y))),

где / (z ) - длина слова z. Еще один вариант А. э.-

монотонная А. э. КМ (х), определение к-рой (см. [3]-[5]) учитывает

имеющееся на двоичных словах отношение «быть началом».

Она может быть использована для определения понятия

случайности: последовательность нулей и единиц представляет

собой двоичную запись случайного числа на отрезке [0, 1]

(см. Случайные и псевдослучайные числа) тогда и только

тогда, когда монотонная А. э. ее начального отрезка длины п

равна я + ОО) (см. [3], [5]). Префиксная энтропия

слова х определяется как -\og2M(x), где М (х) - так наз.

априорная вероятность. По определению, априорная

вероятность является максимальной с точностью до

мультипликативной константы функцией М, отображающей множество

двоичных слов в множество неотрицательных действительных чисел

и обладающей такими двумя свойствами: (1)^М (х)< +<»;

(2) множество пар (г, х)} где г - рациональное число, меньшее

М(х), может быть перечислено нек-рым алгоритмом.

Префиксная энтропия отличается от простой колмогоровской А. э.

не более чем на логарифм длины слова, умноженный на

константу, не зависящую от слова (см. [3]).

Связь понятия А. э. с определением энтропии, данным

К. Шенноном (С. Shannon), устанавливается такими двумя

утверждениями.

1) Пусть х - двоичное слово, р и q - частоты нулей и

единиц в слове х, Н = -(р log2 р + q log2 q) - шенноновская

энтропия случайной величины, принимающей значения 0 и 1

с вероятностями р и q соответственно. Тогда К (x)/l (х) ^

^# + 0(1) при 1(х)—>оо. Это неравенство показывает, что

А. э. учитывает (в числе других) и частотные закономерности.

Хотя левая часть неравенства может быть существенно меньше

правой, если х имеет закономерности не частотного характера,

для «случайных» х этого не бывает, как показывает

следующее утверждение.

2) Для почти всех (по мере Бернулли с вероятностями

появления нулей и единиц, равными р и q соответственно)

последовательностей а предел отношения А. э. начального

отрезка длины п последовательности а к я при я-><» равен

-(p\og2p + q\og2q).

При исследовании сложности вычислений находят

применение алгоритмич. варианты понятия энтропии, учитывающие

время работы алгоритма, реализующего способ описания (см.,

напр., [6]).

Лит.: [1] Колмогоров А. Н., «Проблемы передачи

информации», 1965, т. 1, в. 1, с. 3-11 (см. также - Кол м о го ров А. Н.,

Теория информации и теория алгоритмов, М., 1987, с. 213-23);

[2] Звонкий А. К., Левин Л. А., «Успехи матем. наук», 1970,

т. 25, в. 6, с. 85-127; [3] Вьюгин В. В., «Семиотика и

информатика», М., 1981, в. 16 (второй выпуск за 1980 г.), с. 14-43;

[4] ШеньА. X., «Докл. АН СССР», 1984, т. 276, № 3, с. 563-66;

[5] Левин Л. А., «Докл. АН СССР», 1973, т. 212, № 3, с. 548-50;

[6) Hart man i s J., «Bull. European Ass. Theor. Сотр. Sci.», 1984,

№ 24 (Oct.), p. 73-78; [7] Витаньи П., Л. и М., «Успехи матем.

наук», 1988, т. 43, в. 6, с. 129-66. А. X. Шень.

14 АЛГОРИТМИЧЕСКАЯ

АЛДОУСА-РЕБОЛЛЕДО УСЛОВИЕ (Aldous-Rebolledo

condition) - см. Предельные теоремы для случайных

процессов; мартингальные методы.

АЛЕКСАНДРОВА ПРОСТРАНСТВО (Alexandres space) -

см. о-измеримая функция.

АЛЕКСАНДРОВА ТЕОРЕМА (Alexandrov theorem) -

условие слабой сходимости мер в терминах сходимости значений

мер на классах множеств. Пусть Ж - пространство мер,

заданных на нормальном топологич. пространстве (ЗГ, ®), и Ре.И.

Множество В иза-алгебры а(®) имеет Р-нулевую

границу, если существуют открытые множества Gj, G2e® такие,

что Gt с бс SC\G2 и Р (Gj) = P(3T\G2).

Для того чтобы сеть мер (Ре) из Л слабо сходилась к мере

Ре.й, необходимо и достаточно, чтобы выполнялось одно из

следующих условий:

1) для любого множества В из борелевской а-алгебры а(®)

с Р-нулевой границей выполняется равенство

HmPe(tf) = P(tf);

е

2) для любого открытого множества Ge® имеет место

lim inf Pe(G) ^ P(G) и lim Pe(#) = Р(#);

е е

3) для любого замкнутого множества F имеет место

lim sup Pe(F) ^ P(F) и lim Pe(tf) = РЫ.

e e

Все сказанное выше справедливо также и для а-топологич.

пространств. См. также Мера.

Теорема установлена А. Д. Александровым [1].

Лит.: [1] Александров А. Д., «Матем. сб.», 1940, т. 8,

с. 307-48; 1941, т. 9, с. 563-628; 1943, т. 13, с. 169-238; [2)

Боровков А. А., «Успехи матем. наук», 1976, т. 31, в. 2, с. 3-68.

Е. А. Печерский.

АЛЛЕ ПАРАДОКС (Allais paradox) - пример отношения

предпочтения в пространстве вероятностных распределений,

к-рое нельзя описать аффинным индикатором. Точнее,

рассматривается пример отношения предпочтения у в

пространстве {F} вероятностных распределений на числовой прямой,

для к-рого нельзя указать функционал U, определенный на

{F} и обладающий следующими свойствами:

FyG**U(F)>U(G), (1)

U(aF+(\-a)G) = aU(F) + (\-a)U(G) (2)

для любого ае [0, 1] (см. также Полезностей теория).

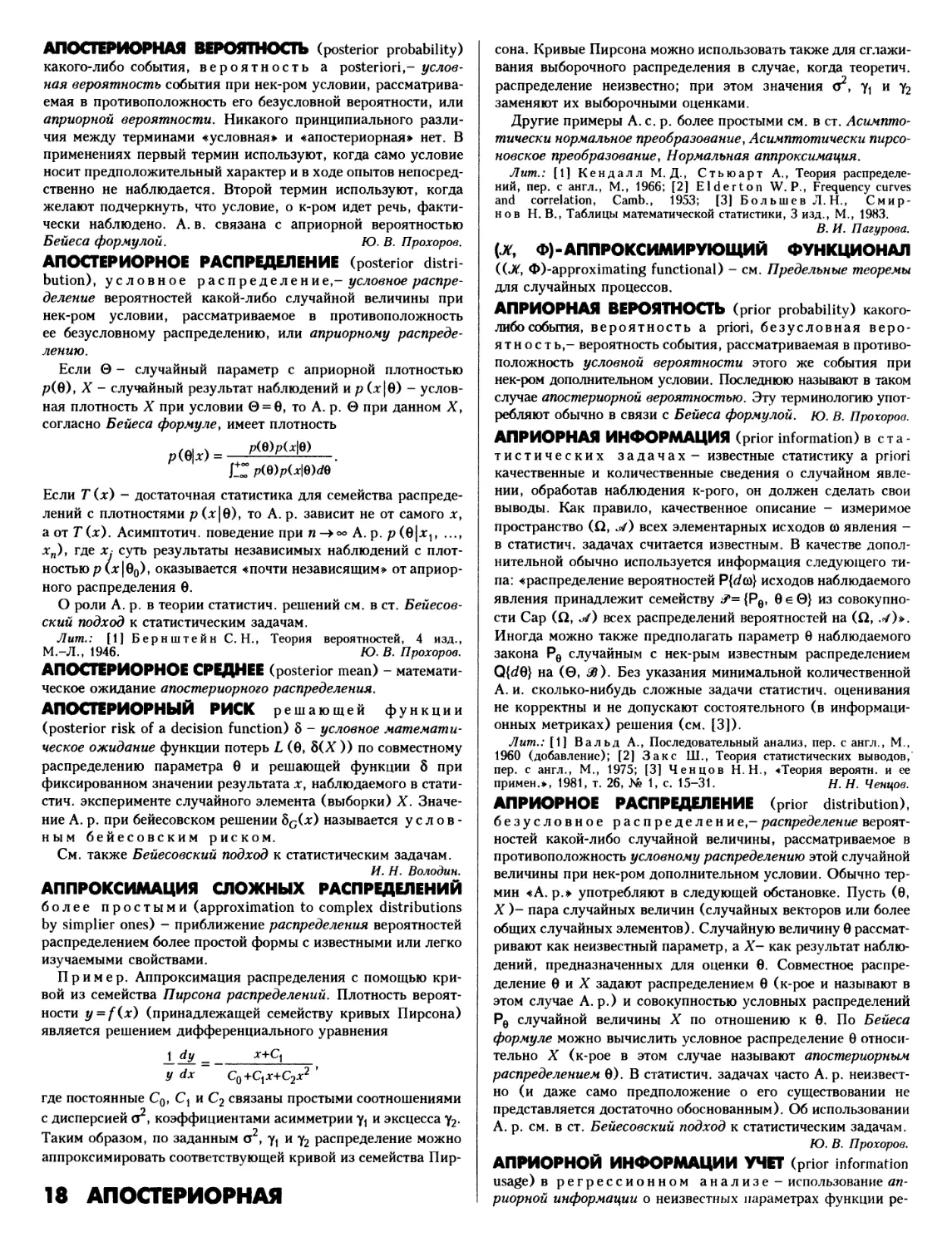

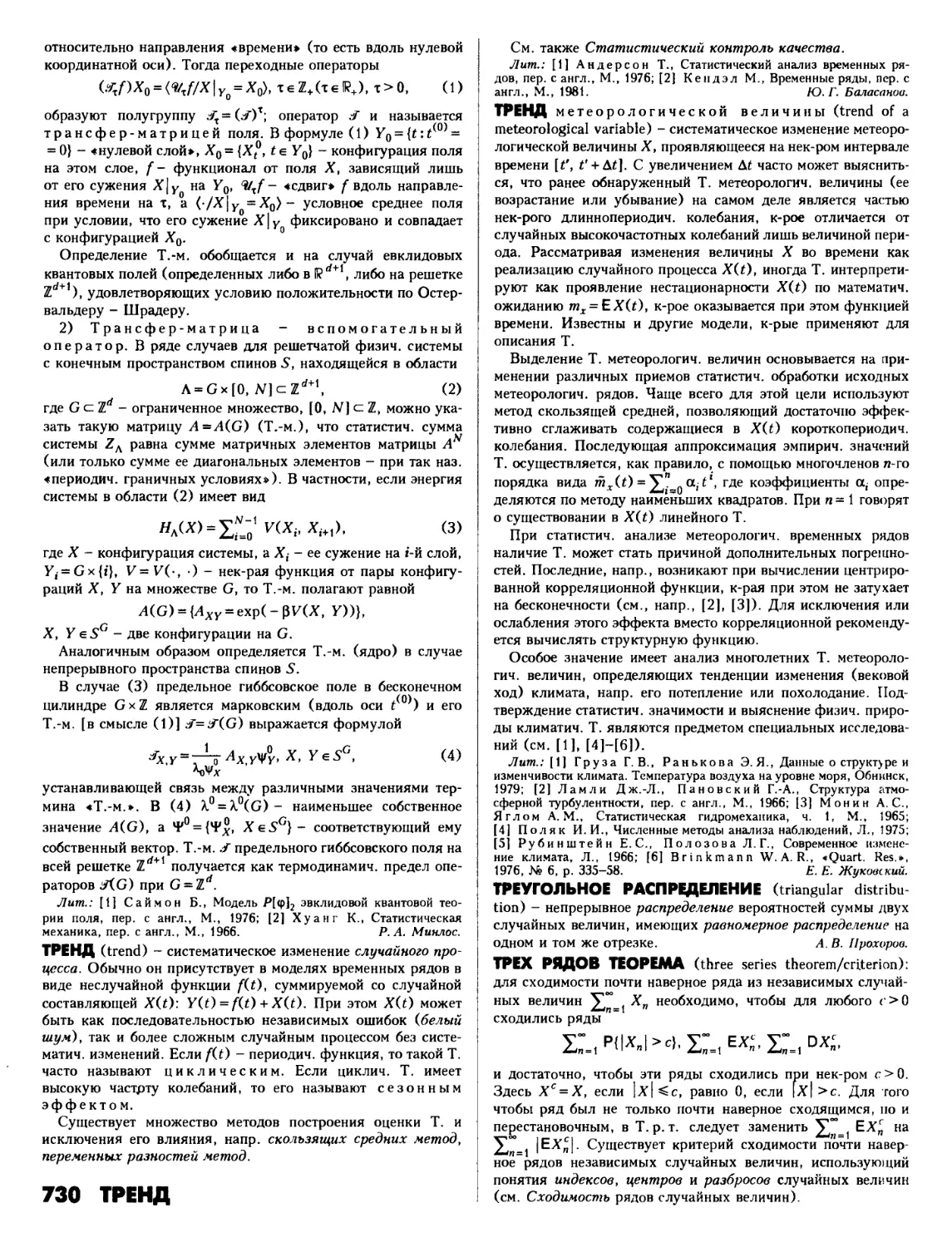

М. Алле [1] рассмотрел распределения Fv ..., F4 будущего

случайного дохода, сосредоточенные на множестве {0 долл.,

5 млн. долл., 25 млн. долл.}. Значения вероятностей даны в

следующей таблице.

/ч

F2

F3

Fa

0 долл.

0

0,01

0,9

0,89

5 млн. долл.

1

0,89

0

0,11

25 млн. долл.

0

0,1

0,1

0

«Стандартный индивидуум» предпочтет первый вариант

второму, считая, что лучше получить заведомо сумму в 5 млн.,

к-рая для него столь же «немыслима», как и сумма в 25 млн.,

чем - пусть и с малой вероятностью - рисковать не получить

ничего. Тем более, что в последнем случае к нулевому доходу

прибавится сильная неудовлетворенность от потери

стопроцентной возможности резко увеличить состояние.

Третий вариант предпочтительнее четвертого, так как здесь

вероятности не получить ничего «не малы и мало

отличаются», и лучше выбрать вариант, где сумма выигрыша больше,

так как шансы в обоих вариантах почти равны. Таким

образом, если отношение предпочтения у отражает указанные

представления, то Fx >-F2 и F3>-F4. Если существует

функционал (/, удовлетворяющий (1)-(2), то

(F1+F3)/l/2^(F2+F4)/l/2,

в то время как на самом деле

(F1+F3)/l/2 = (F2+F4)/l/2.

Рассмотренное отношение предпочтения может быть

описано квадратичным индикатором предпочтения или в терминах

сравнительной полезности (см. Полезностей теория).

Функция сравнительной полезности в последнем случае является

супераддитивной [см. [2]).

Лит.: [1] Allais M., «Econometrica», 1953, v. 21, p. 503-46;

[2] КирутаА.Я., Рубинов A.M., Яновская Е. Б.,

Оптимальный выбор распределений в сложных социально-экономических

задачах, Л., 1980. В. И. Ротарь.

АЛЬТЕРНАТИВА (alternative), альтернативная

гипотеза,- одна из двух статистических гипотез в задаче

проверки статистических гипотез, противопоставляемая

нулевой гипотезе. Обычно нулевая гипотеза выражает некое

основное предположение о распределении, подлежащее

проверке, а А.- класс возможных отклонений от него. Иногда под А.

понимают отдельное распределение, входящее в

альтернативную гипотезу, к-рая в этом случае представляет определенный

класс А. Д. М. Чибисов.

АЛЬТЕРНАТИВНАЯ ГИПОТЕЗА (alternative hypothesis) -

см. Альтернатива.

АЛЬТЕРНАТИВНЫЙ МЕТЕОРОЛОГИЧЕСКИЙ

ПРОГНОЗ (forecast of meteorological binary variables or events/

alternating meteorological forecast) - прогноз погоды, при

к-ром указывается, осуществится или не осуществится одно из

двух только и рассматриваемых противоположных состояний

погоды (напр., прогнозы «ожидаются заморозки» или

«заморозков не будет», «погода будет летной» или «нелетной»).

А.м. и. имеет большое практич. значение особенно при

прогнозировании опасных явлений погоды. Любой прогноз одной

из конечного числа фаз погоды (а также любой

количественный прогноз, где возможная область значений предиктанта

Y всегда может быть разбита на конечное число областей, в

пределах к-рых значения У уже практически неразличимы)

можно свести к А. м. п., так что А. м. п. можно считать основой

практически любого прогноза погоды. Для случая А. м. п.

наиболее подробно изучены оценки качества прогнозов

(см. Прогноз погоды; оценка качества) и методы метеороло-

гич. информации оптимального использования.

Лит.: [1] ОмшанскийМ.А., «Тр. Главн. геофиз. обсерв>, 1937,

в. 14, с. 49-57; [2J Обухов A.M., «Изв. АН СССР. Сер. геофиз.»,

1955, № 4, с. 339-49; [31 Жуковский Е. Е., Метеорологическая

информация и экономические решения, Л., 1981. Г. В. Груза.

АЛЬФА-ПОТЕНЦИАЛ (alpha-potential) - см. Потенциала

теория для марковского процесса.

АЛЬФА-ФАКТОРНЫЙ АНАЛИЗ (alpha factor analysis) -

см. Факторного анализа схемы.

АЛЬФАгЭКСЦЕССИВНАЯ ФУНКЦИЯ (alpha excessive

function) - см. Потенциала теория для марковского процесса.

АЛЬФА-ЯДРО ПОТЕНЦИАЛОВ (potential

alpha-kernel) - см. Потенциала теория для марковского процесса.

АМПЛИТУДНАЯ МОДУЛЯЦИЯ (amplitude modulation)

стационарного случайного процесса Х(0,

-оо < t<°о, ЕХ (О = 0, DX (0 = 1,- преобразование вида

Z(0 = c(l+mY(0)X(0,

где с- коэффициент усиления; У (О, -оо<£<оо, ЕУ(0 = 0,

DY(0=1,- моделирующий стационарный случайный

процесс; величина т} 0<т<1, характеризует степень

воздействия и называется глубиной модуляции. Если X(t) и

У (О - независимые процессы с ковариационными

функциями Вх(х) и J5y(x), то Z (t) также стационарный процесс с

ковариационной функцией

Яг(т) = с2Ях(т)(-1+т2Яу(т)).

Если спектральные функции процессов X (t) и У (О

абсолютно непрерывны, то спектральные плотности fx(X), fY(X) и

fz(X) связаны соотношением

fza)=c4fxa) + m2fYck)*fxa))t

где * означает свертку. В случае, когда X (t) и У (О имеют

узкополосные спектры, сосредоточенные в частотах Хх и Х2

соответственно, 0<Х2«Хх, fz(X) имеет пик в частотах ±XV

к-рые называются несущими, а также пики в частотах

±(At-A2), к-рые называются боковыми, или

спутниками. Значения fz(X) в этих точках, а также для Х=Х2

определяются следующими приближенными выражениями:

fzax)^c2ifxa^+m2(fY(o)fxa^+fya2)fxa^x2))i

fz(Xx-X2)*c2[fx(Xx-X2) + m2fY(X2)fx(Xx)l

fza2)^c2ifx(x2)^m4fYa2)fx(o)+fY(xx-x2)fx(xx))].

Функция |Z(0l является огибающей процесса Z(0, к-рая

в случае узкополосных процессов X (t) и У (О имеет

естественную физич. интерпретацию и поэтому широко

применяется, напр., в радиотехнике. Для широкополосных процессов

наглядное с физич. точки зрения определение огибающей

несколько затруднено.

Лит.: [11 Крамер Г., Лидбеттер М., Стационарные

случайные процессы. Выборочные траектории и их приложения, пер. с англ.,

М., 1969; [21 Свешн и ков А. А., Прикладные методы теории

случайных функций, 2 изд., М., 1968; [3] X ар к ев и ч А. А., Спектры и

анализ, 4 изд., М., 1962; [4] Хеннан Э., Многомерные временные

ряды, пер. с англ., М., 1974. И. А. Кожевникова.

АМПЛИТУДНАЯ ЧАСТОТНАЯ ХАРАКТЕРИСТИКА

(amplitude frequency response) - см. Передаточная функция.

АМПЛИТУДНО-МОДУЛИРОВАННОЕ

ГАРМОНИЧЕСКОЕ КОЛЕБАНИЕ (amplitude-modulated harmonic

oscillation) - колебание вида

X(0 = X0(0cos(V + G),

где Xq - фиксированная круговая частота, амплитуда Х0(О

представляет собой стационарный случайный процесс, а фаза

в может быть как случайной величиной, так и фиксированным

числом. Если фаза в - случайная величина, равномерно

распределенная на интервале [0, 2л], а распределение мощности

процесса Х0(О [задаваемое его спектральной плотностью

f0(X)] сосредоточено в области частот то А.-м. г. к.

Х(0 - стационарный случайный процесс, спектральная

плотность к-рого имеет острый пик в точках X = Xq и X = -Xq. Если

же фаза в фиксирована, то X(t) - периодически

коррелированный случайный процесс, двумерная спектральная мера

F(dX, dX') к-рого сосредоточена на прямых Х = Х\Х = Х' + 2Xq

и X = X' - 2Xq. A. M. Яглом.

АМПЛИТУДНО-МОДУЛИРОВАННЫЙ

ИМПУЛЬСНЫЙ ПРОЦЕСС (amplitude-modulated impulse process) -

импульсный случайный процесс вида

где Г(0 - заданная неслучайная функция (определяющая

форму импульсов), tn, я = 0, ±1, ...,- совокупность точек на

оси времени, к-рая может быть либо случайной, либо

детерминированной, а последовательность амплитуд Х„, я = 0, ± 1, ...,

представляет собой стационарную случайную последователь-

АМПЛИТУДНАЯ 15

ность. Важный частный случай - процесс вида (*), где {tn} -

пуассоновская система точек (со средним числом точек на

единицу времени, равным Х)} а {Хп} - последовательность

одинаково распределенных независимых случайных величин

таких, что ЕХп = т, ЕХ^-а2. В этом случае X(t) -

стационарный случайный процесс со средним значением

EX(t) = Xm j^rMdu

и корреляционной функцией

EX(t + x)X(t) = Ха2 £ Г(м + x)T(u)du +

+ Jt2m2[J"eer(n)dfi] •

Если же tn - пГ0, где Г0 - фиксированный период, или же

£я = яГ0 + е„, где {еп} - независимая от {Хп} стационарная

случайная последовательность, то тогда Х(0 - периодически

коррелированный случайный процесс периода Г0.

Лит.: [1] Коновалов Г. В., Тарасенко Е. М., Импульсные

случайные процессы в электросвязи, М., 1973; [2] РытовС. М.,

Введение в статистическую радиофизику, ч. 1, М., 1976; [3]

Левин Б. Р., Теоретические основы статистической радиотехники, 2 изд.,

кн. 1, М., 1974; [4] МиддлтонД., Введение в статистическую

теорию связи, пер. с англ., т. 1-2, М., 1961-62; [5] Френке Л., Теория

сигналов, пер. с англ., М., 1974. A.M. Яглом.

АМПЛИТУДНО-МОДУЛИРОВАННЫЙ СЛУЧАЙНЫЙ

ПРОЦЕСС (amplitude-modulated random process) -

случайный процесс вида

Х(О = Х0(ОР(О,

где Х0(О - стационарный случайный процесс, a Pit) -

заданная неслучайная функция. Частным случаем А.-м. с. п.

является амплитудно-модулированное гармоническое колебание.

Если функция P(t) периодическая, то А.-м. с. п. X(t) является

периодически коррелированным случайным процессом; если

р(0= £/*°<Шю),

где |б//С(со)| имеет абсолютный максимум при со = 0, то Х(0

принадлежит к классу процессов, допускающих

эволюционирующее спектральное разложение. а. М. Яглом.

АНАЛИТИЧЕСКАЯ ХАРАКТЕРИСТИЧЕСКАЯ

ФУНКЦИЯ (analytic characteristic function) - характеристическая

функция вероятностного распределения Р действительной

случайной величины Х} допускающая аналитическое

продолжение в нек-рую окрестность точки z - О, z - t + is.

Аналитическая в круге \z\ <r характеристич. функция /"аналитична и в

полосе | Im z \ < г и допускает там представление

f(z)= \~JzxP(dx).

Характеристич. функция /"аналитична в том и только в том

случае, если

Р{|Х| >Л} = О(бГм), Л-»~,

для нек-рого г > 0. Если

a = sup{t>0:Eetx <<»>}, fc = sup{£>0:E6f'x<oo},

то -ш, гЪ суть особые точки функции /* и {z: -a<lmz<b} -

максимальная полоса аналитичности для f. A. x. ф. играют

важную роль в теоремах о вероятностях больших уклонений,

в задачах устойчивости разложений распределений на

компоненты и др.

Лит.: [\] ЛинникЮ. В., Островский И. В., Разложения

случайных величин и векторов, М., 1972; [21 Лукач Е.,

Характеристические функции, пер. с англ., М., 1979. И. А. Ибрагимов.

АНАЛОГОВ МЕТОД (analogous method) в

метеорологии — метод прогноза погоды, основанный на принципе ана-

16 АНАЛОГОВ МЕТОД

логичности, при к-ром из архива данных метеорологических

наблюдений за прошлые годы выбирается ситуация,

максимально похожая на текущую, а затем прогнозируется

изменение погоды, наблюдавшееся после этой ситуации. Для

атмосферы, состояния к-рой можно представлять как точки в

многомерном (фазовом) пространстве, перемещающиеся с

течением времени по нек-рым траекториям, А. м. предполагает,

что в случае близких «начальных точек» траектории в течение

нек-рого времени остаются близкими друг к другу. Так как

атмосфера подчиняется законам динамики, применение А. м.

фактически означает, что точное решение уравнений

динамики, описывающее реально осуществляющуюся эволюцию

атмосферы, используется при похожих, но не совпадающих

начальных данных (несовпадение всегда имеет место из-за