Автор: Карлин С.

Теги: математика физика математическая физика переводная литература издательство мир

Год: 1971

Текст

С. КА РАИН

ОСНОВЫ

ТЕОРИИ

СЛУЧАЙНЫХ

ПРОЦЕССОВ

A FIRST COURSE

IN STOCHASTIC

PROCESSES

Samuel Karlin

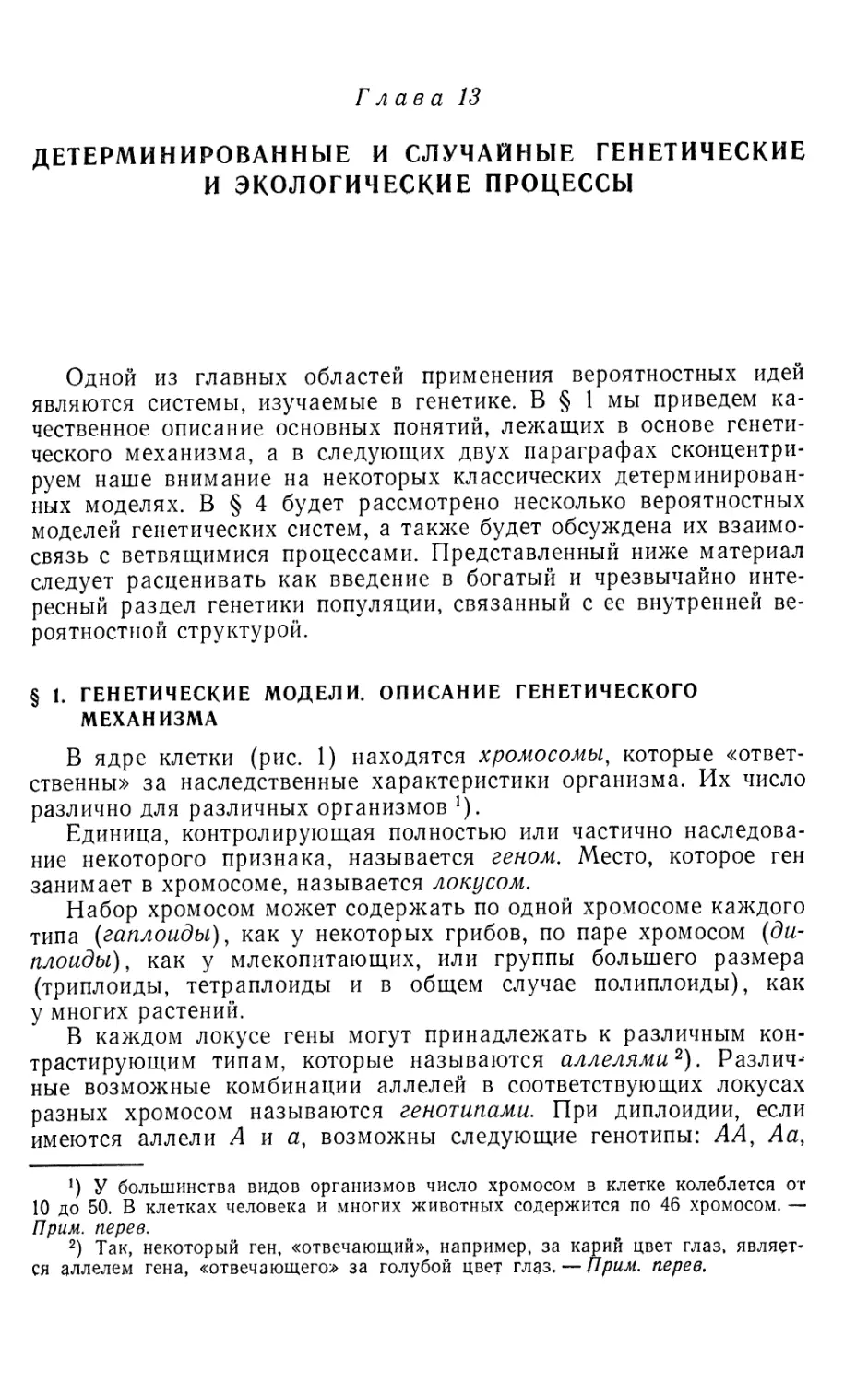

Department of Mathematics

Stanford University

Stanford, California

ACADEMIC PRESS

New York and London

1968

С. «АРЛИН

ОСНОВЫ ТЕОРИИ

СЛУЧАЙНЫХ ПРОЦЕССОВ

Перевод с английского

В. В. КАЛАШНИКОВА

Под редакцией

И. Н. КОВАЛЕНКО

ИЗДАТЕЛЬСТВО «МИР»

Москва ? 1971

УДК 51Я2

Книга С. Карлина является связующим звеном между элемен-

тарным курсом теории вероятностей и специальными курсами теории

случайных процессов, которые используют сложный аппарат совре-

менной математики. Для чтения книги практически достаточно зна-

ния математики в объеме стандартного курса высших учебных за-

ведений. Наряду с изложением математического аппарата книга

содержит прекрасный набор приложений к биологии, задачам мас-

сового обслуживания и др. вопросам.

Книга представляет интерес как для математиков, интересую-

щихся приложениями, так и для биологов, инженеров и специали-

стов других областей науки, в которых математика находит свое

применение.

Редакция литературы, по математическим наукам

Инд. 2-2-3

27-71

С. Карлин

ОСНОВЫ ТЕОРИИ СЛУЧАЙНЫХ ПРОЦЕССОВ

Редакторы В. Ф. Пахомов и Л. Б. Штейнпресс Художник Г. И. Мануйлов

Художественный редактор В. И. Шаповалов Технический редактор Г. Б. Алюлина

Корректор Г. И, Секачева

Сдано в набор 13/1 1971 г. Подписано к печати 9/VIII 1971 г. Бумага № 1 60Х90716=

= 16,75 бум. л.; печ. л. 33,5; уч.-и%д. л. 31,61. Изд. № 1/5825- Цена 2 р. 52 к. Зак. 939.

ИЗДАТЕЛЬСТВО «МИР> Москва, 1-й Рижский пер., 2

Ордена Трудового Красного Знамени Ленинградская типография №2 им. Евгении Соколовой

Главполиграфпрома Комитета по печати при Совете Министров СССР,

Измайловский проспект, 29,

ПРЕДИСЛОВИЕ РЕДАКТОРА ПЕРЕВОДА

Теория случайных процессов, возникшая в результате построе-

ния математических моделей реальных физических процессов, в на-

стоящее время представляет собой наиболее содержательную и бо-

лее всего используемую в приложениях часть теории вероятностей.

Классическим разделом теории случайных процессов является тео-

рия стационарных (в широком смысле) процессов, которая дает

основу решения многих прикладных задач. Задачи современной

науки и техники выдвинули на первый план проблемы, связанные

с исследованием случайных процессов, порождаемых последова-

тельностями независимых случайных величин. Это цепи Маркова,

марковские процессы со счетным множеством состояний, процессы

восстановления, полумарковские процессы. Их роль объясняется

в значительной степени тем, что реальные процессы, изучаемые

с помощью вероятностных методов, по самой своей природе свя-

заны с чередованием событий случайной продолжительности (на-

пример, процесс функционирования резервированной системы

с заменой отказавших элементов). Интересно отметить, что и те

физические процессы, которые ранее изучались в терминах мате-

матического ожидания и корреляционной функции, например флук-

туационные процессы в радиотехнических устройствах, теперь

в соответствии с новыми задачами рассматриваются с точки зре-

ния случайных последовательностей, отражающих определенные

изменения состояний процесса. Из такого рода задач возникает

теория потоков однородных событий, порождаемых случайными

процессами.

Книга известного ученого С. Карлина, предлагаемая вниманию

читателя, посвящена основам теории марковских процессов и про-

цессов, связанных со случайными блужданиями, а также примене-

ниям этих процессов к задачам генетики, экологии и массового об-

служивания. Наиболее ценное в книге — изложение основных ана-

литических методов исследования соответствующих процессов. Чи-

татель, стремящийся изучить теорию случайных процессов, найдет

здесь аппарат, повседневно применяемый специалистами, а не

только собрание готовых результатов. Вместе с тем следует отме-

тить, что рассматриваемые автором классы процессов все же яв-

ляются достаточно частными: не только в теоретических, но и

6

Предисловие редактора перевода

в прикладных работах исследуются более общие классы (напри-

мер, классы процессов, описывающих функционирование систем

массового обслуживания). Однако это не является недостатком

книги: методы, действие которых продемонстрировано на простых

примерах, могут служить читателю и в более сложной ситуации;

большую же часть интересующих сейчас прикладников математи-

ческих задач можно решать и в пределах тех моделей, которые

даются в книге.

В конце каждой главы автор поместил задачи; читателю, есте-

ственно, следует их решать.

Книга С. Карлина может быть рекомендована математикам,

физикам, специалистам по исследованию операций, биологам и

вообще всем, желающим войти в проблематику теории случайных

процессов и овладеть методами этой теории. При переводе и ре-

дактировании устранены некоторые погрешности оригинального из-

дания.

И. Н. Коваленко

ПРЕДИСЛОВИЕ

Теория случайных процессов изучает последовательности собы-

тий, управляемых вероятностными законами. Она находит много-

численные приложения в физике, технике, биологии, медицине,

психологии и других дисциплинах, а также в различных разделах

математики. Назначение этой книги — дать введение многочислен-

ным специальным руководствам по случайным процессам. При ее

написании я преследовал три цели: во-первых, дать систематиче-

ское вводное изложение некоторых основных разделов теории слу-

чайных процессов, во-вторых, привлечь внимание тех, кто зани-

мается чистой математикой, к богатому многообразию приложе-

ний теории случайных процессов и, в-третьих, для читателя, инте-

ресующегося приложениями, подчеркнуть важность «математиче-

ских тонкостей», показать, что они зачастую связаны с самой при-

родой вероятностных процессов.

Примеры в этой книге в основном заимствованы из биологии

и техники; вместе с тем везде делается акцент на тех вероятност-

ных аспектах, которые важны или представляют математический

интерес для более чем одной дисциплины. В книге обсуждается и

иллюстрируется ряд понятий и проблем, привлекающих в настоя-

щее время внимание исследователей.

Поскольку в элементарной книге невозможно охватить все

основные разделы теории случайных процессов, нам пришлось опу-

стить некоторые важные темы и среди них такие, как стационар-

ные случайные процессы и мартингалы. Не предполагалось, что

эта книга будет служить исчерпывающим руководством по вопро-

сам, затронутым в ней. Напротив, она должна рассматриваться

прежде всего как промежуточное звено между элементарными кур-

сами теории вероятностей и многими превосходными работами по

случайным процессам, высокий математический уровень которых

делает их недоступными для читателей, знакомых лишь с осно-

вами теории вероятностей.

У читателей предполагается знакомство с началами теории ве-

роятностей в объеме первого тома ставшей уже классической

книги Феллера «Введение в теорию вероятностей и ее приложения».

В § 1 гл. 1 мы даем сводку основных свойств случайных величин

и функций распределения, а также вводим важнейшие термины.

8

Предисловие

Материал, набранный мелким шрифтом, при первом чтении моЖнО

опустить. В конце каждой главы приводятся задачи, цель кото-

рых — разъяснить, а во многих случаях и развить изложенную

теорию.

Книгу можно использовать для полугодового или годового

курса в зависимости от потребностей. Логическая взаимозависи-

мость глав отражена на схеме, приведенной ниже.

При написании книги я пользовался обширной литературой по

случайным процессам. Каждая глава завершается списком работ,

в которых читатель найдет дальнейшую информацию и библиогра-

фию.

Я благодарен коллегам: профессору Чжун Кай-лаю и профес-

сору Дж. Мак-Грегору (Станфордский университет) за советы и

полезные комментарии, профессору Дж. Ламперти (Дартмусский

университет), профессору Дж. Киферу (Корнеллский университет)

и профессору П. Нею (Висконсинский университет) за конструк-

тивную критику, доктору А. Файнстейну за тщательную проверку

значительной части рукописи, а также моим студентам П. Милчу,

Б. Сигеру, М. Фелдману и Б. Кришнамурти за их полезные советы

и помощь при выборе и составлении задач.

Сэмюэл Карлин

Станфорд, Калифорния

ЛОГИЧЕСКАЯ ЗАВИСИМОСТЬ ГЛАВ

§ 1 гл. 1 можно читать, не вдаваясь в детали. Глава 12 почти

не зависит от гл. 11. Первая половина гл. 6 не зависит от гл. 5.

Для понимания глав 4—14 не являются необходимыми § 5 и § 6

гл. 3.

/

Для полугодового курса рекомендуется следующий вариант:

§ 2 и § 3 гл. 1с предшествующим кратким изложением материала

§ 1; гл. 2 полностью; гл. 3, исключая § 5 и, быть может, § 6; гл. 7

без § 3 и, возможно, § 7. Содержание последней части курса со-

ставляется по усмотрению лектора, при этом можно использовать

гл. 9—12, полностью или частично.

Глава 1

ЭЛЕМЕНТЫ ТЕОРИИ СЛУЧАЙНЫХ ПРОЦЕССОВ

§ 1. СВОДКА ОСНОВНЫХ ТЕРМИНОВ И СВОЙСТВ СЛУЧАЙНЫХ

ВЕЛИЧИН И ФУНКЦИЙ РАСПРЕДЕЛЕНИЯ

В этом параграфе приводятся основные термины и элементар-

ные понятия теории вероятностей. В последующих главах мы бу-

дем пользоваться ими без каких-либо дальнейших ссылок на ли-

тературу. Читателю настоятельно рекомендуется обратиться к уп-

ражнениям, помещенным в конце главы; эти упражнения помогут

ему вспомнить и закрепить предварительный материал. Детальное

изложение этих вопросов можно найти в книгах Феллера, Гнеденко

и Парзена (см. литературу в конце этой главы).

Предполагается, что читатель знаком со следующими поня-

тиями:

(1) действительная случайная величина Х\

(2) функция распределения F случайной величины X (определяе-

мая как F(X) = Р {X X}) и ее элементарные свойства1);

(3) события, связанные со значениями случайной величины X, и их

вероятности;

(4) математическое ожидание М{Л} случайной величины X и мо-

менты высших порядков М{ХП};

(5) формула полной вероятности и формула Байеса.

Вместо слов «действительная случайная величина» мы будем

часто пользоваться сокращением «д. с. в.» 2).

Д. с. в. X называется дискретной, если существует конечное или

счетное множество различных чисел Xi, Хг, ..., такое, что =

= Р {X = XJ > 0, Z=l,2,... и S at = 1. Если Р {X = X} = 0 для

i

любого значения X, д. с. в. X называется непрерывно распределен-

ной. Если существует неотрицательная функция p(t), определенная

на всей оси — оо < t < оо и такая, что функцию распределения F

*) В отечественной литературе функция распределения, как правило, пони-

мается в смысле Р{Х < X}. Очевидно Р {X Л}« lim Р {X < X + е}, Р {X < X} =

е4<0

= lim Р {X Л — е}, так что между обоими определениями существует простое

е^О

соответствие. — Прим. ред.

2) Иногда будет использоваться сокращение «с, в.» —- «случайная величи-

на». — Прим, перев,

12 Гл. 1. Элементы teopuu случайных процессов

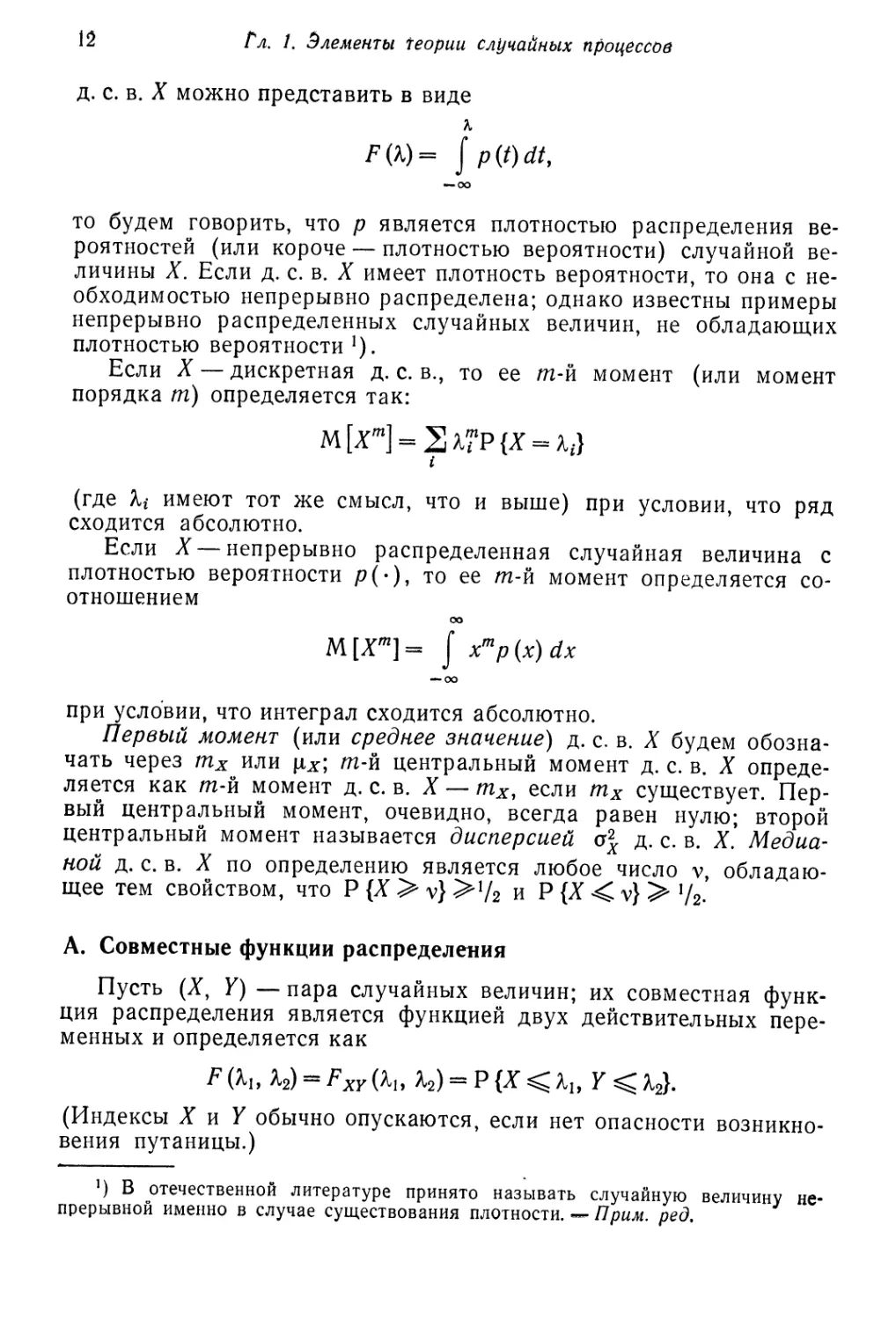

д. с. в. X можно представить в виде

к

F(A)= J p(f)dt,

— оо

то будем говорить, что р является плотностью распределения ве-

роятностей (или короче — плотностью вероятности) случайной ве-

личины X. Если д. с. в. X имеет плотность вероятности, то она с не-

обходимостью непрерывно распределена; однако известны примеры

непрерывно распределенных случайных величин, не обладающих

плотностью вероятности *)•

Если X — дискретная д. с. в., то ее m-й момент (или момент

порядка ш) определяется так:

м [xm] = 5 %Тр {х = л j

i

(где kj имеют тот же смысл, что и выше) при условии, что ряд

сходится абсолютно.

Если X — непрерывно распределенная случайная величина с

плотностью вероятности р(-), то ее m-й момент определяется со-

отношением

М[Г"]= J xmp(x)dx

— оо

при условии, что интеграл сходится абсолютно.

Первый момент (или среднее значение) д. с. в. X будем обозна-

чать через шх или m-й центральный момент д. с. в. X опреде-

ляется как m-й момент д. с. в. X — mXl если тх существует. Пер-

вый центральный момент, очевидно, всегда равен нулю; второй

центральный момент называется дисперсией в2х А- с- в- Медиа-

ной д. с. в. X по определению является любое число v, обладаю-

щее тем свойством, что Р {X > v} >7г и Р {X v} > 7г-

А. Совместные функции распределения

Пусть (X, У) — пара случайных величин; их совместная функ-

ция распределения является функцией двух действительных пере-

менных и определяется как

F (Ль Л2) = Fxy (Ль Л2) - Р {X < Ль У < Л2).

(Индексы X и У обычно опускаются, если нет опасности возникно-

вения путаницы.)

’) В отечественной литературе принято называть случайную величину не-

прерывной именно в случае существования плотности. — Прим, ред.

§ 1. Сводка основных терминов

13

Функция F(K{, + оо) = lim F(Ab А2) является функцией

Л,2 “> °О

распределения и ее называют частной (или маргинальной) функ-

цией распределения д. с. в. X. Аналогично функция F(+ оо, А2) на-

зывается частным распределением д. с. в. У. Если случится так, что

Г(АЬ + оо)-5(+ оо, А2) = Е(АЬ А2) для любой пары значений па-

раметров Ai и А2, то случайные величины X и У называются неза-

висимыми. Говорят, что совместная функция распределения FXy

имеет (совместную) плотность вероятности, если существует функ-

ция Pxy^s, t) двух действительных переменных, такая, что

Х2 М

Лхк(^ь ^2) ~ j J Pxr(5> t) ds dt

—00 —00

для всех X], Если X и У — независимые д. с. в., то Pxy(s, t)

с необходимостью представима произведением px(s)pY(t), где рх

и ру — плотности вероятности частных распределений д. с. в. X и

У соответственно.

Совместная функция распределения любого конечного набора

Хь ..., Хп д. с. в. определяется как

^(Аь • kn) = Fxv ..., хп (Aq, ..An) == Р Ри < Ab ...»

Функция распределения

1 Л/ X.->oo, i^ivik

называется частной функцией распределения случайных величин

Xh, .... xlk.

Если F(Ab An) = /?(Ai)/?(A2) ... F(Kn) для всех значений

Ai, А2, ..., Ап, то д. с. в. Хь ..., Хп называются независимыми.

Говорят, что совместная функция распределения F(Ab Ап)

имеет плотность вероятности, если существует неотрицательная

функция p(t\y ..., tn) от п переменных, такая, что

^1

F(M, ..., Л„)= J ... J р(/ь .... tn)dtx ...dtn

— 00 —00

для всех действительных Аь ..., Ап.

Б. Условные распределения и плотности

Пусть X и У — д. с. в., принимающие счетные множества значе-

ний, скажем 1,2, ... . Условная вероятность Р{Х = i| У = /} опре-

деляется соотношением

14 Гл. 1. Элементы теории случайных процессов

Здесь предполагается, что Р {У = /} > 0; в противном случае зна-

чение Р{А = г| У = /} произвольно (скажем, равно нулю).

Условные вероятности могут быть определены и для случайных

величин других типов. Мы рассмотрим только случай, когда X и

У имеют совместную плотность вероятности Pxy(s, t). Тогда услов-

ное распределение

Р{Х<а\У - Ь}

определяется формулой

а

P{X<xi\Y = b} = (ру (Ь) Г1 J рХУ (s, b) ds,

— оо

если Ру(^)>0, и произвольно в противном случае. Из определе-

ния pY (b) следует, что

lim Р {X < а | Y - b} = 1

а->оо

для всех 6, таких, что ру(Ь) >0. Таким образом, F{r=^(a) =

= Р {X а | У = Ь} представляет собой функцию распределения

в случае ру(&) > 0. Легко видеть, что эта функция распределения

имеет плотность, а именно таковой является функция

Pxr(fl, Ь)1ру(Ь), Последняя называется условной плотностью ве-

роятности случайной величины X при условии, что У = Ь, и часто

обозначается рх|Г(а; Ь).

Условное математическое ожидание д. с. в. X при условии, что

У = у, определяется формулой

оо

М [X IУ = у] = J хрх! у (х, у) dx

— оо

для всех у, таких, что Ру(у)> 0. Аналогичное определение услов-

ного математического ожидания можно дать и для дискретного

случая. Нетрудно видеть, что М (X | У) является случайной вели-

чиной.

Следующее соотношение является очень важным свойством

условного математического ожидания:

М[М[X | У] ] = М [А].

В. Бесконечные семейства случайных величин

При рассмотрении бесконечных семейств случайных величин не-

посредственное обобщение предыдущих определений сопряжено

с существенными трудностями. Поэтому мы воспользуемся не-

сколько другим подходом.

Рассмотрим счетное семейство Х2, ... случайных величин.

Будем считать их статистические свойства заданными, если для

§ 1. Сводка основных терминов

15

каждого целого числа п>1и любого набора и, in из п раз-

личных положительных целых чисел задана совместная функция

распределения случайных величин Xi{, Xin. Разу-

меется, при этом на бесконечное семейство [Fx,,.... х. ) должны

быть наложены условия согласованности, состоящие в том, что

%.....•••> Л/-ь Л/+1’ •••’ =

= lim Fx ... г. (Ль Лу-ь Л/, Л/+1, Ага),

Ху->оо '1 ‘п

и в требовании инвариантности функции

Тх,, х,...х{ (Ль Л2, •••, Л„)

Ч 1'2 1п

относительно перестановки любой пары индексов iv и и соответ-

ствующих им Xv и Последнее просто означает, что способ ну-

мерации д. с. в. Хь Х2, ... не имеет значения.

Совместные распределения х.) называются конечно-

'• ч in)

мерными распределениями семейства случайных величин {ХД'Д.

В принципе все важные вероятностные свойства этих величин мо-

гут быть выражены через конечномерные распределения.

Г. Характеристические функции

С каждой функцией распределения F связана важная функ-

ция ср(О> где —оо, оо), называемая характеристической. По

определению имеем1)

<₽(/) = | e^dFp), /2=-1. (1.1)

— оо

Пока читатель может интерпретировать запись интеграла в пра-

вой части как символическую. Если F имеет плотность вероят-

ности р, то характеристическая функция представима в виде

(£(0= J ешр(Л)я!Л.

— оо

Если F — распределение д. с. в. X со счетным множеством воз-

можных значений и Р{X = kk} == ak (& = 0, 1,...), то

!) Интеграл в правой части (1.1) является интегралом Лебега — Стильтьеса.

У читателей не предполагается знания интегралов этого типа.

16

Гл. 1 Элементы теории случайных, процессов

правая часть (1.1) сводится к ряду

оо

fe=0

Весьма полезным фактом является следующее легко доказы-

ваемое утверждение: если {Xi, Хп} — семейство независимых

д. с. в., то характеристическая функция их суммы представляет со-

бой произведение характеристических функций этих д. с. в.

Соответствие между функциями распределения и характеристическими функ-

циями—взаимно однозначное. Представление функции распределения через ее

характеристическую функцию известно как формула обращения Леви. Поскольку

она нам в дальнейшем не понадобится, мы рекомендуем интересующемуся чита-

телю обратиться к литературе, где эти вопросы рассматриваются подробно.

Взаимно однозначное соответствие между функциями распределения и ха-

рактеристическими функциями сохраняется и при различных предельных перехо-

дах. В частности, если F, Fb F2, ... — функции распределения, такие, что

lim Fn (%) == F (Л) для всех X, где F непрерывна, и срп (/)—характеристиче-

П-»оо

ские функции членов последовательности {Fn}, то

оо оо

<Р«(0= J eitKdFn(V-+<f(t)= ^eltKdF(X)

— ОО —оо

равномерно по t в каждом конечном интервале. Обратно, если (pi, ср2, ... — ха-

рактеристические функции членов некоторой последовательности A, F2, ... функ-

ций распределения и lim срп (t) = ср (/) для любого /, а ф(/) непрерывна в

П->оо

точке t — 0, то (р(/) является характеристической функцией функции распреде-

ления F и -lim Fn (Л) — F (Л) для любого X, где F непрерывна. Этот результат

П->оо

известен под названием критерия сходимости Леви.

Д. Производящие функции

Для случайных величин, которые могут принимать только неот-

рицательные целочисленные значения, вместо характеристической

функции используется функция

оо

g («) = 5 PkSk, Pk = p {X = k},

л=о

называемая производящей. Так как по предположению и

оо

функция g(s) определена по крайней мере для s, та-

&=о

ких, что |s| 1 (s— комплексная переменная), и бесконечно диф-

ференцируема при | s | < 1.

Отметим следующие элементарные свойства производящих

функций.

(а) Если У = Ху + Х2, где д. с. в. Х\ и Х2 независимы и могут

принимать лишь неотрицательные целочисленные значения, то про-

§ 1. Сводка основных терминов

17

изводящая функция д. с. в. У1) является произведением произво-

дящих функций слагаемых.

(б) Пусть Azi, Х2, ... — независимые и одинаково распределен-

ные неотрицательные целочисленные случайные величины, и пусть

N — неотрицательная целочисленная д. с. в., не зависящая от Х^

Мы хотим найти производящую функцию д. с. в. R = Х{ + ... + XN

(суммы случайного числа слагаемых, каждое из которых является

д. с. в.). Пусть g\v(s)—производящая функция д. с. в. N, a g(s) —

производящая функция, общая для всех Xi. Тогда

gR («) = gN (g (») )•

Имеет место следующее обобщение предыдущего результата.

Пусть Xi, Х2, ... — произвольные независимые одинаково распре-

деленные случайные величины (необязательно целочисленные),

а д. с. в. N, как и ранее, неотрицательная целочисленная и не за-

висящая от Xi. Тогда

<Рд (0 = gN (<Р (0 ),

где фд и gN — характеристическая и производящая функции д. с. в.

R = Xi + ... + XN и д. с. в. N соответственно, а ср — общая харак-

теристическая функция Д. С. в. Xi.

Рассматривая неотрицательные д. с. в., полезно заменить харак-

теристические функции преобразованиями Лапласа функций рас-

пределения. Если распределение Fx имеет плотность р, преобразо-

вание Лапласа определяется формулой

оо

Фх ($) = [ e~sxp (х) dx.

о

Интеграл в правой части существует для значений комплексной

переменной s = о + *7, таких, что о > 0. Для s чисто мнимых фх(^)

сводится к характеристической функции фх(—/)• Для дискретных

неотрицательных д. с. в. преобразование Лапласа определяется по

формуле

оо

Фх («) = 2 e~sKnan.

п — 0

Как и для характеристических функций, если Хи Х2, ..., Хп —

неотрицательные независимые д. с. в., то

'Фх,+ ... +Xrt(s)= П Фх (в).

1 п fc=l

*) В дальнейшем для краткости мы будем пользоваться термином «произво-

дящая функция случайной величины», хотя более правильно было бы говорить

«производящая функция распределения д. с. в.». В оригинале часто используется

термин «probability generation function», т. е. «вероятностная производящая

функция». — Прим, перев.

18

Гл. 1. Элементы теории случайных процессов

В случае общих функций распределения для преобразования

Лапласа имеем формулу

оо

Фх (*)=.[ e~*dFx®.

О

Как и характеристическая функция, преобразование Лапласа

однозначно определяет функцию распределения.

Е. Примеры функций распределения

Мы предполагаем известными элементарные свойства функций

распределения, которые приведены в таблицах I и II.

Следующие два многомерных распределения имеют принципи-

альное значение.

(а) Многомерное нормальное распределение

Пусть llaijll, /= 1,2 — симметрическая положительно опреде-

ленная матрица порядка 2 X 2 (т. е. а12 = а21 и аи>0, ана22 —

— ^2>0) и mi, mz — любые действительные постоянные. Тогда

/4*1» х2) =^-ехр

2

-у 2 bukXi-m^Xj-tnj)

где ll&fjl — матрица, обратная к ||агД и В = det является

плотностью распределения, называемого невырожденным двумер-

ным нормальным распределением. Если Xit Х2— д. с. в., совмест-

ная функция распределения которых равна

Аг Xi

F(%i, Л2)= J J f (xb х2) dx\ dx2,

то М(Х,) = o2(X,-) = ац при i = 1, 2 и М(Х1Х2) — гпхт2 — а12,

Переход к случаю n-мерного нормального распределения оче-

виден.

(б) Полиномиальное распределение

Совместное дискретное распределение г величин, принимаю-

щих только неотрицательные целочисленные значения 0, ..., п,

называется полиномиальным. Оно определяется выражением

P(^ = ^, ..., Xr = kr) =

n! k, kr , , , ,

= . Pr’ если ^+---+^ = n,

О в противном случае,

г

где р/>0, i=l, ..., г и 2 Pi = 1.

i=i

Таблица I

Непрерывная функция распределения Плотность Допустимые значения параметров Характеристическая функция Среднее Дисперсия

Нормальное распределе- ние с пара- метрами т и о2 1 Г (х — т)21 - — ехр — — у 2л о L 2о2 J ДЛЯ — ОО < X < ОО m — любое действительное число сг> 0 Г °2/2 . • л ехр г imt m О2

Гамма-распре- деление 9 с парамет- рами а, X I 1 для х > 0, ( 0 для х < 0 Л>0 а> 0 Ла (Л - И)а а т а Л2

Бета-распре- деление с параметра- ми р, q 2) ( г (p+_£Lxp-i (1 | Г (р) Г (?) * 11 х) для 0 < х < 1, 0 в противном случае о о Л Л Си 1 г(р + р) f еч*хр~' X Г (р) Г (?) .1 0 X (1 р p-rQ др (р + р)2 (р + <7 + 1)

’) Гамма-распределение при а== 1 называется экспоненциальным; параметр X называется масштабным.

2) Бета-распределение с параметрами р = д = 1 обычно называется равномерным распределением в (0,1).

20

Гл. 1. Элементы теории случайных процессов

Таблица II

Дискретная функция распределения Возможные значения случайных величин Вероятность состояния Производящая функция Среднее Дис- Персия

Пуассоновское распределение с параметром Z>0 п = 0, 1, 2, ... е~кКп п\ g—k-Vks X X

Биномиальное распределение с параметра- ми и р (N — целое по- ложительное, <7 = 1 -Р я = 0, 1 е 1 Sr е Ci. st (1 -р +ps)N Np Npq

Отрицательное биномиальное распределение (Паскаля) 9 с параметра- ми а>0, 0<р< 1 п = 0, 1, 2, ... ( а + п —1 \ а И ( п )pq a со т ' — aq Р aq р2

’) Геометрическое распределение является важным частным случаем распределения

Паскаля, получающимся при а=Н.

ж. Предельные теоремы

Многие из основных результатов теории вероятностей имеют

вид предельных теорем. (Мы не будем формулировать эти резуль-

таты при наиболее слабых предположениях.) Из них упомянем

следующие.

Закон больших чисел (слабый). Пусть Хь Х2, ... — независимые

одинаково распределенные случайные величины со средним m и

конечной дисперсией. Тогда для любого е > О

1. ул f I X J -f- . . . -1- Хц I 1

lim P < —----------- — m < e > = 1.

,4-11 n I i

Усиленный закон больших чисел. Пусть случайные величины

Xi, Х2, ... те же, что и выше, и пусть Sn = (Xi + ... + Хп)1п\ тогда

для любых е, б > 0 существует целое число N(е, б), такое, что

Р {| Sn — ш | 8 для всех п N (е, б)} < б х).

*) Оба последних утверждения остаются в силе и при отсутствии конечной

дисперсии у случайных величин Хп. — Прим. ред.

§ 2. Два простых примера случайных процессов

21

Центральная предельная теорема. Пусть случайные величины

Xi, Х2, ... те же, что и выше; тогда

lim Р< а

П->оо I

X1 + ... + Хп — ш

оУп

/ exp (- у-) dx,

а

где о2 — общая дисперсия величин

Лемма Бореля — Кантелли. Пусть Ль А2,... — бесконечная по-

следовательность независимых событий. Тогда событие Лоо, кото-

рое означает осуществление бесконечного числа событий из Ль

Л2, ..., имеет вид

оо оо

Ао=П и л

/г=1 i = k

Лемма Бореля — Кантелли устанавливает, что вероятность собы-

оо

тия Аоо равна нулю или единице, если соответственно S Р (А/)< оо

оо i = l

или S Р (Лг) = оо.

i = 1

§ 2. ДВА ПРОСТЫХ ПРИМЕРА СЛУЧАЙНЫХ ПРОЦЕССОВ

Данная книга может служить введением в различные направле-

ния случайных процессов. Теория случайных процессов имеет дело

с исследованием структуры семейств случайных величин Xt, где

t — параметр, принадлежащий соответствующему множеству Т.

Иногда, когда это не приводит к недоразумениям, мы будем пи-

сать X(t) вместо X/.

Реализацией, или выборочной функцией, случайного процесса

{Xt, t е Т} является функция, ставящая в соответствие каждому

t е Т одно из возможных значений Xt. Множество параметров Т

может быть дискретным, т. е. Т = {0, 1,2,3,...}, а {X/} может при

этом представлять исходы последовательных испытаний, таких, как

результаты бросаний монеты, последовательные реакции объекта

на изучающий эксперимент или последовательные наблюдения не-

которой характеристики популяции и т. д.

Величина Xt может быть одномерной, двумерной, ^-мерной или

иметь более общую природу. В случае, когда Хп является исходом

п-го бросания кости, возможные ее значения образуют множество

{1, 2, 3, 4, 5, 6}, а одной из типичных реализаций процесса является

последовательность 5, 1, 3, 2, 2, 4, 1, 6, 3, 6, ... . Она показана на

рис. 1, где ординатой при t = п является значение Хп. В этом при-

мере случайные величины Хп взаимно независимы, но в общем

случае величины Хп являются зависимыми.

Случайные процессы, у которых Т = [О, оо), особенно важны

в приложениях. В этом случае t обычно интерпретируется как

время,

22

Гл. 1. Элементы теории случайных процессов

Здесь мы ограничимся весьма кратким обсуждением некоторых

понятий, относящихся к случайным процессам, и двумя примерами.

Рис. 1,

В конце главы дана сводка различных типов случайных процессов.

Некоторые из них будут подробно изучаться в последующих гла-

вах.

Пример 1. Весьма важным примером является известный

процесс броуновского движения. Этот процесс характеризуется сле-

дующими свойствами:

(а) Пусть < /1 < ... < tn. Тогда приращения Xtx — Х/о, ...

Xtn — Xtn_x — независимые в совокупности д. с. в. Го-

ворят, что процесс, обладающий таким свойством, являет-

ся процессом с независимыми приращениями, выражая

тем самым тот факт, что изменения Xt на неперекрываю-

щихся интервалах времени являются независимыми д. с. в.

(б) Вероятностное распределение величин — если

/2>/ь зависит только от t2—ti (и не зависит, например,

от 6).

х

(в) J

В — положительная постоянная.

Пусть XQ = 0. Заметим, что M(XZ) = 0, o2(Xt) = Bt, где В —

фиксированное положительное число. Можно доказать, что если

0 < t\ < t2 < ... <tn < t, то условное вероятностное распределе-

ние величины Xt при известных значениях Xtn равно

(см. гл. 10)

Р pG х I Хц = • • • > Xtn “ Хп] в

х~хп

= [2лВ (t - tn}\~'12 j exp [ - 2д (< _ tn) ] du.

§ 2. Два простых примера случайных процессов 23

История возникновения этого случайного процесса началась с на-

блюдений Р. Броуна в 1827 г., заметившего, что маленькие ча-

стицы, помещенные в жидкость, совершают непрерывное беспоря-

дочное движение. В 1905 г. А. Эйнштейн объяснил это явление тем,

что наблюдаемые частицы подвержены непрерывным соударениям

с молекулами окружающей среды. Выведенные Эйнштейном ана-

литические результаты были позднее проверены экспериментально

и обобщены другими физиками и математиками.

Пусть Xt — расстояние броуновской частицы от начальной точки

в момент t. Смещение Xt — Х8 за интервал времени (s, t) можно

рассматривать как сумму большого числа малых смещений. В этой

ситуации применима центральная предельная теорема, поэтому

естественно ожидать, что Xt — Xs имеет нормальное распределение.

Аналогично естественно предположить, что распределения величин

Xt — Xs и Xt+h — Xs+h совпадают при любом h > 0, если среда на-

ходится в равновесии. Наконец, интуитивно ясно, что смещение

Xt — Xs должно зависеть только от Z— s, а не от момента начала

наблюдения.

Процесс броуновского движения (называемый также винеров-

ским процессом) играет фундаментальную роль при изучении мно-

жества случайных процессов других типов. Одномерный процесс

броуновского движения будет более полно изучен в гл. 10.

Пример 2. Другим важным примером случайного процесса,

непрерывного по времени (Т = [0, оо)), является пуассоновский

процесс. Его выборочная функция Xt представляет собой число ре-

гистрации наступления некоторого события за период от 0 до теку-

щего момента времени t. Очевидно, всякая возможная реализа-

ция Xt есть неубывающая ступенчатая функция.

Реализация, изображенная на рис. 2, соответствует первому на-

ступлению события в момент Zi, второму — в момент Z2, третьему —

в момент Z3 и т. д. Общее число наступлений события возрастает

только единичными скачками, а Хо — 0. Конкретными примерами

наблюдаемых величин, образующих подобного рода процессы, яв-

ляются: число фотонов, испускаемых веществом при радиоактив-

ном распаде, число телефонных вызовов из данного района, число

происшествий на данном перекрестке, число ошибок на странице

машинописного текста, число выходов из строя некоторого меха-

низма и число поступивших заявок на обслуживание.

Рассмотрение этих процессов как пуассоновских основывается

на законе редких событий. Представим себе большое число испы-

таний Бернулли с малой вероятностью успеха (наступления собы-

тия) и постоянным средним числом успехов. При этих условиях

известная теорема утверждает, что число наступлений события

подчиняется закону Пуассона. В случае радиоактивного распада

пуассоновское приближение дает превосходное согласие с экспери-

Гл. 1. Элементы теории случайных процессов

ментом, если время наблюдения много меньше периода полурас-

пада радиоактивного вещества.

Мы постулируем, что число наступлений события в некотором

интервале не зависит от числа наступлений этого события в любом

Рис. 2.

другом не пересекающемся с ним интервале (см. свойство (а) пре-

дыдущего примера). Предположим также, что с. в. XtQ+t — Xto за-

висит только от t и не зависит от i0 или от значения Сформу-

лируем дальнейшие постулаты, согласующиеся с интуитивным опи-

санием, данным выше:

I. Вероятность того, что за период времени продолжительно-

сти h произойдет по меньшей мере одно событие, есть

р (Л) = ah + о (й), й->0, а>0

[£•(/) = о (t) при t —* 0 означает, что lim g(t)Ц = 0].

II. Вероятность того, что за время h произойдет два или более

события, есть o(h).

Постулат II равнозначен исключению возможности более чем

однократного одновременного наступления события. В приведен-

ных нами физических процессах это условие обычно выполняется.

Пусть Pm(t) обозначает вероятность того, что за время t про-

изойдет ровно m событий, т. е.

Pm(/) = P{^ = 4 m-0, 1, 2, ...

Условие II можно записать в виде

2Р„(Л) = 0(Л),

m=2

и, очевидно,

P(h)=pl(h)+P2(h)+....

§ 2. Два простых примера случайных процессов

25

В силу предположения о независимости имеем

Ро (t + h) = Ро (/) Ро (й) = Рй (/) (1 - Р (й))

и поэтому

Ро (/ + h) - Ро (/) _ р p(h)

h ~ ™ ~Г *

Из постулата I следует, что p(h)/h—* а. Поэтому вероятность Ро(О

того, что событие не наступит в интервале (0, /), удовлетворяет

дифференциальному уравнению

Ро(/)=-аРо(С,

общее решение которого имеет вид Ро(О = ce~at. Константа с опре-

деляется из начального условия Ро(О) = К из которого следует, что

с = 1. Итак, Ро(О = e~ai-

Найдем теперь Рт(/) для любого т. Легко видеть, что

Рт (t + h) = Рт (/) Ро (й) + Рт-х (t) Р, (й) + 2 Pm-i (0 Pi (Й). (2.1)

1 = 2

По определению Р0(Л)= 1—p(h). Из постулата I следует, что

Р1(й) = р(Л) + о(Л),

т т (2 2)

2 Pm-i (О Pi (Л) < 2 Pt (й) = о (й),

1=2 1=2

поскольку, очевидно, Р&(0^1- С помощью (2.2) мы можем пере-

писать (2. 1) в виде

рт (t + h)- рт (о - рт (t) [Ро (й) - 1 ] + Рт.х (/) Р} (й) +

+ 2 Pm-i (0 Pi (й) = - Рт (/) р (Й) + рт_, (/) р( (й) +

i=2

+ 1 Pm-i (/) Pi (Й) = - аРт (О й + аРт_. (/) й + 0(h).

Отсюда следует, что

рт (t + h)- Рт (0„ _ аРт (/) + аРт_} (/) при Л_>0

или, формально,

Р'т (/) = - аРт (/) + аРт-! (О, /и = 1, 2, ..., (2.3)

при начальных условиях

Рт(0) = 0, /п=1, 2........

26

Гл. 1. Элементы теории случайных процессов

Для решения уравнений (2.3) введем функции

Qm^ = Pm^eat, m = 0, 1, 2.......

Подставляя Qm(t) в (2.3), получаем

Qm(0 = «Qm-l(0, m=l, 2, (2.4)

где Qo(/)== 1; начальные условия остаются теми же: Qm (0) = 0,

m = 1, 2, ... . Последовательно решая уравнения (2.4), получаем

Q'i (/) = а, или Qi (/) = at + с, так что (/) = at;

Q2(0 = -^- + c, так что Q2(0 = -^p;

Q

Следовательно, имеем

Другими словами, при каждом t с. в. Xt подчиняется распределе-

нию Пуассона с параметром at. В частности, среднее число на-

ступлений события за время t равно at.

Часто пуассоновский процесс возникает в форме, где временной

параметр заменяется соответствующим пространственным пара-

метром. Следующий формальный пример иллюстрирует эту ситуа-

цию. Рассмотрим систему точек, распределенных в пространстве Е

(Е обозначает евклидово пространство размерности d 1). Пусть

Nr обозначает число точек, содержащихся в области R простран-

ства Е. Предположим, что NR является случайной величиной. Со-

вокупность случайных величин {NR}, где область изменения ин-

декса R состоит из всех возможных подмножеств пространства Е,

представляет собой однородный пуассоновский процесс, если удо-

влетворяются следующие условия:

(i) количества точек в неперекрывающихся областях являются

независимыми с. в.;

(ii) для любой области R конечного объема с. в. NR подчи-

няется распределению Пуассона со средним AV(E), где V(R) —

объем области R. Параметр Л фиксирован и в некотором смысле

служит мерой интенсивности распределения, не зависящей от раз-

мера и формы.

Пространственные пуассоновские процессы возникают при рас-

смотрении распределений звезд или галактик, распределений рас-

тений и животных, бактерий на предметном стекле и т. д. Мы вер-

немся к этим вопросам в гл. 12 для более глубокого их изучения.

§ 3. Классификация общих случайных процессов

27

§3. КЛАССИФИКАЦИЯ ОБЩИХ СЛУЧАЙНЫХ ПРОЦЕССОВ

Основные признаки, по которым различаются случайные про-

цессы, касаются природы пространства состояний S, временного

параметра Т и отношений зависимости между случайными величи-

нами Xt.

Пространство состояний S

Это пространство, которому принадлежат все возможные зна-

чения, принимаемые всеми с. в. Xt. В случае, если S=(0, 1,2, ...),

мы относим процесс к классу целочисленных процессов, или про-

цессов с дискретным пространством состояний. Если S совпадает

со всей действительной осью (—оо, оо), то мы называем процесс

действительным случайным процессом. Если S — евклидово

6-мерное пространство, то говорят, что процесс {XJ является 6-мер-

ным.

Как и в случае отдельной с. в., выбор пространства состояний

не определяется однозначно описываемым физическим процессом,

хотя во многих случаях выбор наиболее подходящего пространства

состояний очевиден.

Временной параметр Т

Если Г = (0, 1,...), то мы будем говорить, что {Xz} является

случайным процессом с дискретным временем. В этом случае мы

будем часто писать Хп вместо Xt. Если Т = [0, оо), то случайный

процесс {Xf} будем называть процессом с непрерывным временем.

Мы уже приводили примеры временного параметра Т более

чем одного измерения (пространственные пуассоновские процессы).

Другим примером могут служить волны в океане. Географические

долготу и широту можно рассматривать как /, а высоту волны

в данном месте — как Xt.

Отношения зависимости

Важной чертой случайного процесса {А\} является зависимость

между случайными величинами Xti t Т.

Характер этой зависимости определяется заданием совместных

функций распределения для каждого конечного семейства Xtli...

...,XZn с. в. процесса. Как мы увидим из примеров (а) и (б), при-

водимых ниже, совместные функции распределения часто могут

быть выражены через другие распределения, связанные с процес-

сом.

Для целей настоящей книги случайный процесс можно считать

полностью заданным, если определены его пространство состоя-

28

Гл. 1. Элементы теории случайных процессов

ний, временной параметр и семейство конечномерных распределе-

ний. Однако при рассмотрении случайных процессов с непрерыв-

ным параметром возникают некоторые трудности, которые мы ил-

люстрируем на следующем примере.

Пусть U — с. в., равномерно распределенная на [0, 1]; опреде-

лим Xt и Yt следующим образом:

( 1 при U = t,

Xt = _ Г,а=0 (*>0).

I 0 в противном случае;

Непосредственным вычислением легко убедиться, что {Х(} и {У;}

имеют одинаковые конечномерные распределения. Вместе с тем

Р | Xt у при всех 0 t 1 j = 0,

а

при всех 0 11= 1

— положение вещей просто обескураживающее. Чтобы объяснить,

чем вызваны эти затруднения, рассмотрим следующий пример.

Предположим, что {Х(, 0 t оо} является случайным процес-

сом с непрерывным временем. Наша задача — найти Р{Х( >0,

0 С t < 1}.

Рассмотрим последовательность сужающихся событий:

Л„={^>0, ti = il<2n, Z = 0, 1, ..., 2"}, n= 1, 2, ....

Вероятность каждого события Ап можно выразить через совмест-

ную функцию распределения соответствующих с. в. Xt{, i — 0, ...

..., 2". На первый взгляд кажется естественным положить Р {Xt

^0, 1}равным значению предела lim Р{Л„}.Однако не все,

П->оо

что кажется естественным, свободно от противоречий. В такой же

степени естественно считать, что Pft>0, 0</<1}= lim Р{л'},

где А'п = {Xti 0, tt = 113", / = 0, 1, ...» 3”}, но отнюдь не оче-

видно, что пределы НтР{Л„}и НтР{Л„} равны между собой.

П->оо П->оо

Более того, без дополнительных ограничений, касающихся глад-

кости выборочных функций процесса, эти пределы, вообще го-

воря, могут иметь различные числовые значения. Известны различ-

ные достаточные условия их равенства; одно из этих условий со-

стоит в том, что lim Р{| Xt — Хх |>е} = 0 для всех е>0 и всех t.

В этом случае можно показать, что никаких противоречий не возни-

кает, если определить Р{Хг>-0, 0^/<С1) как общее значение

указанных пределов. Более того, если /j, /2, ... — любое множе-

§ 3. Классификация общих случайных процессов 29

ство точек, всюду плотное в интервале (0, 1), то Р {Xt О,

- lim Р [АД>0, z=l, 2, п].

П->оо 1 1

Суть дела состоит в следующем: в то время как формула пол-

ной вероятности позволяет вычислять вероятности событий, вклю-

чающих последовательности с. в., через вероятности событий, свя-

занных с любым конечным, а следовательно, и счетным подмноже-

ством этой последовательности, событие {А^ > О, О t 1} зави-

сит от несчетного числа с. в. Мы не можем подробно исследовать

этот вопрос в нашей книге и рекомендуем читателю обратиться

к монографии Дж. Дуба [4]. Некоторые вопросы, касающиеся осно-

ваний теории случайных процессов, мы затронем в гл. 8.

Опишем теперь некоторые классические типы случайных про-

цессов, характеризующиеся различными видами зависимости ме-

жду Xt- В этих примерах мы будем считать, если не оговаривается

противное, что Т = [О, оо). Для простоты изложения мы предпо-

лагаем, что с. в. Xt — действительные.

(а) Процесс с независимыми приращениями

Если с. в.

Xt -Xt, Xt -Xt , Xt -Xt

l2 *1’ *3 П-1

независимы для всех Л, ..., tn, таких, что

/1 ^2 < ^3 < • • • <

то мы будем говорить, что {АД является процессом с независимыми

приращениями. Если множество индексов содержит наименьший

индекс /о, то предполагается также, что

^0- ^-^0- •••> Ч-Ч-,

независимы. Если Т = (0, 1, ...), то процесс с независимыми при-

ращениями сводится к последовательности независимых с. в.

Zo = Ао, Z2 = Xi — (z = 1, 2, 3, ...) в том смысле, что, зная

распределения с. в. Zo, Zb ..., мы можем определить (и это должно

быть ясно читателю) совместное распределение любого конечного

множества с. в. Х^ В самом деле,

X} — Zq-h Xi ... + Zz, z = 0, 1, 2, ....

(б) Мартингалы

Пусть {АД — действительный случайный процесс с дискретным

или непрерывным пространством индексов. Мы назовем {AJ мар-

тингалом, если для любых t\ < /2 < • • • < ^n+i математическое

ожидание М(А^+11 АД = ..., АД = равно ап для всех допу-

стимых значений ..., ап. Мартингалы можно рассматривать как

модели безобидных игр. В самом деле, если Xt описывает состоя-

ние капитала игрока в момент t, то по определению мартингала

30

Гл. I, Элементы теории случайных процессов

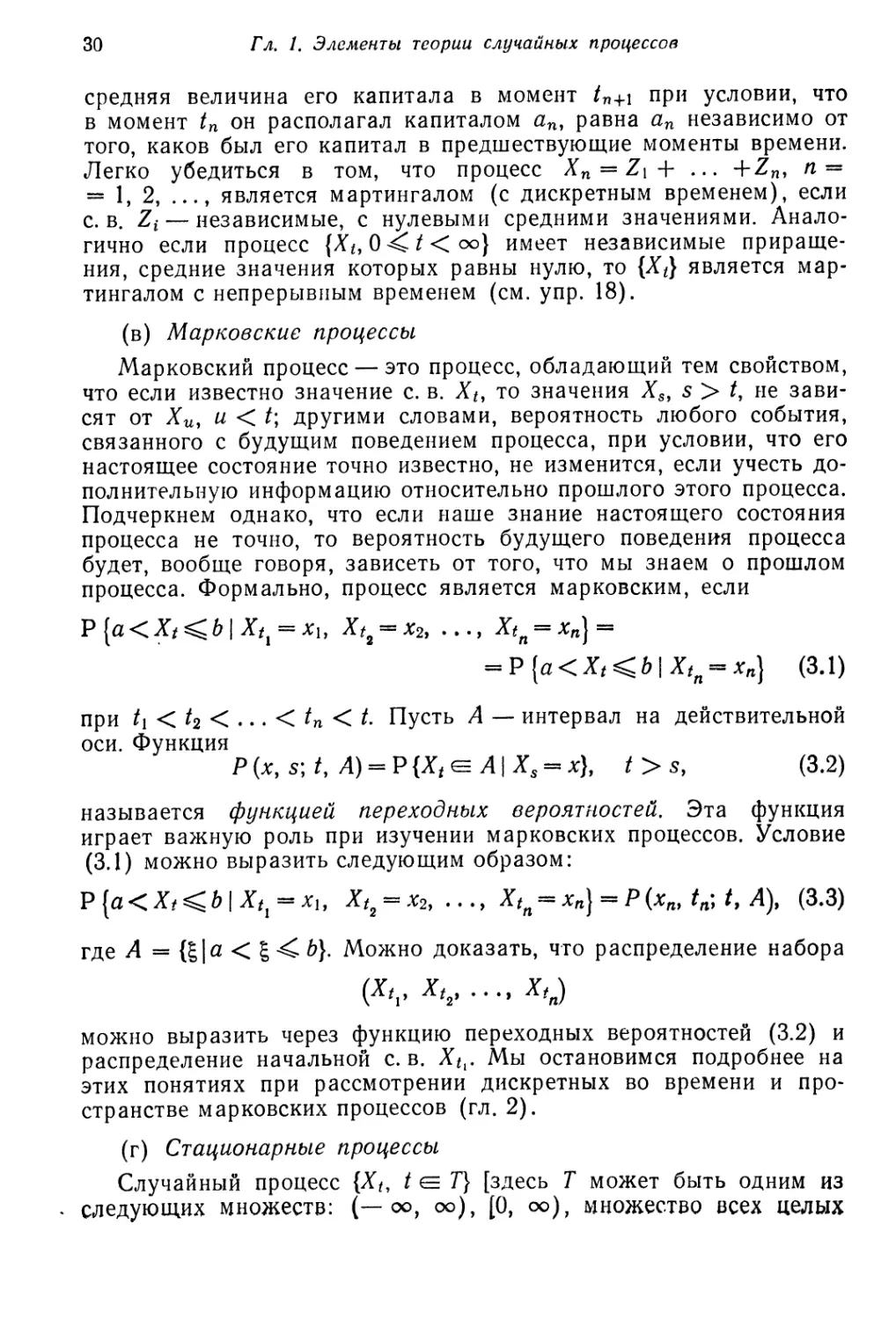

средняя величина его капитала в момент fn+i при условии, что

в момент tn он располагал капиталом ап, равна ап независимо от

того, каков был его капитал в предшествующие моменты времени.

Легко убедиться в том, что процесс Хп = Z\ + ... +Zn, n =

= 1,2,..., является мартингалом (с дискретным временем), если

с. в. Zi — независимые, с нулевыми средними значениями. Анало-

гично если процесс {Xt, 0^/<оо} имеет независимые прираще-

ния, средние значения которых равны нулю, то {Xt] является мар-

тингалом с непрерывным временем (см. упр. 18).

(в) Марковские процессы

Марковский процесс — это процесс, обладающий тем свойством,

что если известно значение с. в. Xt, то значения Xs, s > t, не зави-

сят от Хи, и <t\ другими словами, вероятность любого события,

связанного с будущим поведением процесса, при условии, что его

настоящее состояние точно известно, не изменится, если учесть до-

полнительную информацию относительно прошлого этого процесса.

Подчеркнем однако, что если наше знание настоящего состояния

процесса не точно, то вероятность будущего поведения процесса

будет, вообще говоря, зависеть от того, что мы знаем о прошлом

процесса. Формально, процесс является марковским, если

Р [а < Xt < b | Xtx = Xi, Xt2 = х2, ..., Xtn = =

= P{a<Xt^b\Xtn~xn} (3.1)

при t[ < t2 < ... < tn < t- Пусть A — интервал на действительной

оси. Функция

P(x,s;/, A) = P{XteiA\Xs~x}, t > s, (3.2)

называется функцией переходных вероятностей. Эта функция

играет важную роль при изучении марковских процессов. Условие

(3.1) можно выразить следующим образом:

Р {а < Xt < b | Xt{ = xi, Xt2 == х2, ..., Xtn = хп}~Р (xn, tn\ /, Д), (3.3)

где А = < g Ь}. Можно доказать, что распределение набора

х‘.....х'.)

можно выразить через функцию переходных вероятностей (3.2) и

распределение начальной с. в. Xtl. Мы остановимся подробнее на

этих понятиях при рассмотрении дискретных во времени и про-

странстве марковских процессов (гл. 2).

(г) Стационарные процессы

Случайный процесс {Xt, t <= Г} [здесь Т может быть одним из

следующих множеств: (— оо, оо), [0, оо), множество всех целых

Задачи

31

чисел, множество положительных чисел] называется стационарным

в узком смысле, если совместные распределения семейств с. в.

(X.tx+h, Xt2+h, Xtn+h) И (Xte Xt2, Xtn)

одинаковы при всех h > 0 и всех t\, , tn из Т. Это условие

означает, по существу, что процесс находится в вероятностном рав-

новесии и момент начала нашего наблюдения не имеет значения.

В частности, распределение с. в. Xt одно и то же при всех t.

Случайный процесс {Xt, t Т} называется стационарным в ши-

роком смысле, или ковариационно стационарным, если он обладает

конечными вторыми моментами и cov(Xf, Xt+h) — N[(XtXt+h)—

— М(Х/)М(Х/+/г) зависит только от h при всех t^.T.

Стационарные процессы служат для описания многих явлений

в теории связи, астрономии, биологии, а иногда и экономики.

Говорят, что марковский процесс имеет стационарные переход-

ные вероятности, если P(s, х; t, А), определенная формулой (3.2),

является функцией лишь разности t — s1). Вспомним, что

P(s, х; t, Л) есть условная вероятность — настоящее состояние

процесса считается известным. Поэтому нет никаких оснований

ожидать, что марковский процесс со стационарными переходными

вероятностями является стационарным процессом, что и соответ-

ствует действительному положению вещей.

ЗАДАЧИ

1. Пусть а, b и с — независимые с. в., равномерно распределенные в (0,1).

Какова вероятность того, что уравнение ах2 + Ьх + с = 0 имеет действительные

корни?

Ответ: (5 + 3 In 4)/36.

2. Пусть при каждом фиксированном X > 0 с. в. X имеет пуассоновское рас-

пределение с параметром к. Предположим, что сам параметр Л является с. в.,

подчиняющейся гамма-распределению (т. е. имеющей плотность распределения

0, Л < 0,

где п — фиксированная положительная константа). Показать, что

n r(fe + n) ь-п 1

РЦ-*} г (п) Г (6 + 1) \2/ ’ k °’ ......

Когда п —целое, эта формула есть не что иное, как отрицательное биномиальное

распределение с р « 1/2.

3. Пусть при каждом заданном р с. в. X имеет биномиальное распределение

с параметрами р и N. Предположим, что параметр N сам подчиняется бино-

миальному распределению с параметрами q и М, причем М N.

*) Такой процесс называется также однородным марковским процессом, —

Прим, ред.

32

Гл. 1. Элементы теории случайных процессов

(а) Показать аналитически, что X имеет биномиальное распределение с па-

раметрами pq и М.

(б) Дать вероятностное обоснование этому результату.

4. Пусть с. в. X при каждом заданном р имеет биномиальное распределение

с параметрами р и N. Предположим, что р само подчиняется бета-распределению

с параметрами г и $. Найти результирующее распределение с. в. X. Когда это

распределение является равномерным на множестве {0, 1, ..., N}?

Ответ:

р Г V = м = ( N \ Г (г + s) Г (fe + г) Г (n — fe + s) .

1 ** \k) Г (г) Г (s) Г (У + г + s)

Р {I = Ч = 1 /(N + 1), когда г = s — 1.

5. Проводится следующий эксперимент. Наблюдается с. в. X, подчиняющаяся

пуассоновскому распределению с параметром X. Затем проводится X испытаний

Бернулли с вероятностью успеха р. Какойо распределение числа успехов о?

Ответ: пуассоновское с параметром Кр.

6. (а) Предположим, что с. в. X подчиняется пуассоновскому распределению

с параметром X Параметр X сам является с. в. с экспоненциальным распределе-

нием и средним, равным 1/с. Найти распределение с. в. X.

(б) То же для случая, когда X подчиняется гамма-распределению порядка а

с масштабным параметром с, т. е. плотность распределения с. в. X равна

Л+1 Л

Г(а+1)

при X > 0 и равна 0 при X 0.

Ответ: (а) Р (X = k} = ^*+1 <

<“> р’*-61’тгНтг(|

*+“+> са+1

7. Число происшествий за неделю на некотором производстве является с. в.

со средним ц и дисперсией х2. Количества травм, полученных в результате раз-

личных происшествий, представляют собой независимые с. в. с одинаковыми

средними v и дисперсиями т2. Найти среднее и дисперсию числа травм за

неделю.

Указание: Выразить производящую функцию распределения числа травм за

неделю через производящие функции распределений числа происшествий за не-

делю и числа травм за одно происшествие.

Ответ: среднее число травм за неделю равно p/v; дисперсия числа травм за

неделю равна v2x2 + рт2.

8. Предположим, что имеется N фишек, помеченных числами 1, 2, ..., N

соответственно. Выберем без возвращений и случайным образом 2n + 1 фишек.

Пусть Y — медиана полученной случайной выборки. Показать, что Y имеет рас-

пределение

р- 1 \ -&\

P{F ==&}=*------———~------- при & = п+1, п + 2, .N — n.

\ 2п + 1 )

Проверить, что

&

(ЛГ —2ft—1) (У+1)

8п + 12

& Ю =

Задачи

33

9. Предположим, что имеется N фишек, занумерованных числами 1, 2, N.

Извлекается без возвращений случайная выборка объема п. Пусть X — наиболь-

ший номер в случайной выборке. Показать, что X имеет распределение

Р{Х = £} =

ik - 1 \

\ п — 1 )

(«)

при k — n, п+ 1, ..N

и что

10. Предположим, что в урне находится п фишек, занумерованных числами

1, 2, ..., п. Производится последовательное извлечение фишек до тех пор, пока

одна и та же фишка не появится дважды подряд. Пусть X — число извлечений

до наступления этого события. Найти распределение вероятностей с. в. X.

Ответ: р (k) = (k — 1)! ( П \

\ k - 1 / п*

при k = 2, 3, ..п 4-1.

11 (продолжение). Показать, что среднее значение с. в. X есть

М(Х) = 2+(1--) + (1--)(1-—)+ ... + (1-Д (1-—) ... (1-^=4V.

v \ а) \ п) \ п / \ п / \ п / \ /г /

12. Пусть Xi и Х2— независимые с. в., равномерно распределенные на от-

резке [0—1/2, 0+1/2]. Показать, что разность Xi — Х2 имеет распределение,

не зависящее от 0, и найти ее плотность вероятности.

Ответ:

fx^X2 “

1+^,

1 ~~ У>

0,

-1 < У <0,

0 < у < 1,

Ы>1.

* 13. С. в. X и Y обладают следующими свойствами: X положительна, т. е.

Р{Х>0}== 1, и имеет непрерывную плотность вероятности /(х); У при фиксиро-

ванном X имеет равномерное распределение в (0, X). Доказать, что если У и

X — У независимы, то

f (х) = а2хе~ах, х>0, а>0.

* 14. Пусть с. в. U подчиняется гамма-распределению порядка р, и пуст#

с. в. V подчиняется бета-распределению с параметрами q и р--q (fi<q<p).

Предположим, что U и V независимы. Показать, что UV имеет гамма-распреде-

ление с параметром q.

Указание.

Р|г/г

0'0 /

Перейти в этом соотношении к преобразованию Лапласа, изменить порядок ин*

тегрирования и разложить найденное выражение в ряд вида

&=о

2 Зак. 939

34

Гл. 1. Элементы теории случайных процессов

* 15. Пусть X и У — независимые одинаково распределенные положительные

с. в. с непрерывной плотностью распределения f(x). Предположим, далее, что

U = X — Y и V = min(X, У) являются независимыми с. в. Показать, что

f(x)=!Xe~Kx п₽и*>0'

[О в противном случае,

при некотором X > 0.

Указание. Показать сначала, что совместная плотность вероятности с. в. U

и V имеет вид

fu. V^U’ v) = f f (v + I “ I )•

Затехм показать, что частные распределения с. в. U и V равны соответственно

оо

М“) = J hv(v) = 2[\-F(v)]f(v),

max (0, и)

v

где F (и) « J f (g) d%. Приравнивая произведение частных распределений сов-

о

местному распределению, получить .соотношение

f (» + 1 и I) = f (| и I) [1 — F (»)]

и с его помощью вывести требуемый результат.

16. С. в. Хп принимает значения k/n, k = 1, 2, ..., п, каждое с вероятностью

1/и. Найти ее характеристическую функцию и предел последней при п->оо.

Каков вид с. в., которой соответствует предельная характеристическая функция?

Ответ: (а) ср„ (f) = (1 — elt) -7—г—гд—г,

4 'п ехр (— in~[t) — 1

(б) равномерно распределенная на (0, 1).

17. Применив центральную предельную теорему к соответствующим пуассо-

новским с. в., показать, что

18. Показать, что суммы Sn == Xi + . • • + Хп независимых с. в. с нулевыми

средними образуют мартингал.

19. Показать, что всякий случайный процесс с независимыми приращениями

является марковским процессом.

20. Пусть Ao, Ai, ..., Аг — исходы некоторого эксперимента. Пусть рг- —

вероятность исхода Аг (i = 0, 1, 2, ..., г). Предположим, что эксперимент по-

вторяется до тех пор, пока исход До не будет отмечен k раз. Пусть Xt— число

Задачи

35

появлений исхода А;. Показать, что

21. Показать, что производящая функция отрицательного полиномиального

распределения (I) с параметрами ро, р\, рг) имеет вид

<P(Z1......'rWoH ~ 2 hPi

\ i * I t

22. Рассмотрим векторную случайную величину {Хо, Х\, ..., Хг), подчиняю-

щуюся полиномиальному распределению с параметрами (ц; ро, р\, ..., рг), и

предположим, что п является случайной величиной с отрицательным биномиаль-

ным распределением с параметрами (k; р). Показать, что распределение вектора

{Xi, Х2, ..., Хг} при условии Хо = k является отрицательным полиномиальным

распределением с параметрами (k\ р0(1 —р), Pi(l —р)> •••> Рг(1 — р))

(О < р < 1).

23. Предположим, что некоторая совокупность состоит из т, п{, ..., пг

предметов, принадлежащих нулевому, первому, ..., r-му классам соответственно.

Предметы извлекаются один за другим без возвращения до тех пор, пока не бу-

дет извлечено k предметов нулевого класса. Показать, что совместное распреде-

ление частот Х}, ..., Хг первого, ..., r-го классов имеет вид

где

m — (k — 1)

tn + n-(k + y— 1) ’

^xi и ft= 2 ni-

z = ! /-=!

24 (продолжение). Показать, что если m-+oo и п->оо таким образом, что

т/(т + ц)->Ро и п,/(т + п)-> i = 1, 2, ..., г, то это распределение стре-

мится к отрицательному полиномиальному.

ЗАМЕЧАНИЯ

Колоритное и богатое разнообразным материалом введение

в теорию вероятностей и ее приложения читатель найдет в книге

Феллера [1]. В этой книге автор ограничивается изложением диск-

ретных распределений ]).

*) Распределениям общего вида посвящен второй том «Введения в теорию

вероятностей и ее приложения» В. Феллера, переведенный на русский язык. —

Прим. ред.

2*

36 Гл. 1. Элементы теории случайных процессов

Прекрасным введением может служить учебник Гнеденко [2].

Другим полезным элементарным учебником является книга

Парзена [3].

Классической монографией, посвященной теории случайных

процессов, является книга Дуба [4]. Ее можно считать обязатель-

ной для всех, занимающихся случайными процессами.

Другой выдающейся монографией по теории случайных процес-

сов является книга Дынкина [5].

ЛИТЕРАТУРА

1. Феллер В., Введение в теорию вероятностей и ее приложения, т. 1, «Мир»,

М, 1964.

2. Гнеденко Б. В., Курс теории вероятностей, Физматгиз, М., 1961.

3. Р а г z е п Е., Modern Probability Theory and Its Applications, Wiley, New York,

1960.

4. Д у б Дж. Л., Вероятностные процессы, ИЛ, М., 1956.

5. Дынкин Е. Б., Марковские процессы, Физматгиз, М., 1963.

Глава 2

МАРКОВСКИЕ ЦЕПИ

§ 1. ОПРЕДЕЛЕНИЯ

Дискретная марковская цепь {Хп} представляет собой марков-

ский случайный процесс, пространство состояний которого счетно

или конечно, а множество индексов Т = (0, 1, 2,...). Мы можем го-

ворить об Хп как об исходе n-го испытания.

Часто пространство состояний процесса удобно отождествить

с множеством неотрицательных целых чисел (0,1,2,...) и гово-

рить, что Хп находится в состоянии Z, если Хп = i.

Вероятность с. в. Хп+1 попасть в состояние /, если известно,

что Хп находится в состоянии i (называемая одношаговой переход-

ной вероятностью), обозначается Рпцп+\ т. е.

P?/n+1 = P{Xrt+1=/| (1.1)

В таком обозначении подчеркивается, что в общем случае пере-

ходные вероятности зависят не только от начального и конечного

состояний, но и от момента осуществления перехода. Когда одно-

шаговые переходные вероятности не зависят от временной пере-

менной (т. е. от значения п), мы говорим, что марковский про-

цесс обладает стационарными переходными вероятностями (см.

§ 3 гл. 1). Именно на этом классе марковских цепей мы и сосре-

доточим свое внимание.

Итак, отметим, что Рц rt+1 == Рц не зависит от п и есть ве-

роятность перехода из состояния i в состояние / за одно испыта-

ние. Обычно вероятности Рц объединяют в матрицу

Pqq рт Р 02 Р 03

Р10 Рц Р12 Р13

Р 20 Р21 Р‘22 Р 23

р = PiO Рц Р12 Pi3

которую называют марковской матрицей, или матрицей переход-

ных вероятностей марковской цепи,

38

Гл. 2. Марковские цепи

В матрице Р (i + 1)-я строка представляет собой распределе-

ние вероятностей с. в. Xn+i при условии, что Хп = i. Если число

состояний конечно, то Р — конечная квадратная матрица, порядок

которой (число строк) равен числу состояний. Очевидно, вероят-

ности Рц удовлетворяют следующим двум, условиям:

Pf/>0, Z, / = 0, 1, 2, ..., (1.2)

2 ро=1, 1 = о, 1,2,.... (1.3)

/=0

Условие (1.3) отражает тот факт, что каждое испытание вызывает

некоторый переход из состояний в состояние. (Для удобства мы

говорим о переходе и в том случае, когда состояние остается не-

изменным.)

Процесс полностью определен, коль скоро заданы вероятности

(1.1) и состояние (или, более общо, распределение вероятностей)

с. в. XQ. Докажем это утверждение.

Пусть Р{Ло = i} = pi. Достаточно показать, как вычисляются

вероятности

Р{Хо == *о> = Х2 ” hi •••» Xn = in] (1-4)

для любого конечного п, так как по формуле полной вероятности

любые другие вероятности, касающиеся с. в. Xjt, ... , Xjk,

ji < /2 < • • • < Л, могут быть получены суммированием членов ви-

да (1.4).

По определению условной вероятности имеем

Р {Хо Zg, Х\ = Zi, Х2 = Z2, • • •, Хп — in}

— Р {Хп = in\ Xq~ hi Xy — i^ ..., Xn-.i=Z„_i}X

X P {Xo — Zo, Xj = Zi, ..., Xn-i ~ Z„-i}. (1.5)

Но по определению марковского процесса имеем

Р I Xq Zq, X] Zj, . •., Xп— । h— 1}

= P {Xn itl I Xn-x == Zn_J = Pin_v in, (1.6)

Подстановка (1.6) в (1.5) дает

P {Xo = Zo, = i], ..., Xn = in} —

= Pin_v /nP{%0 = Z0, XI==Zb X^Z^J. (1.7)

Продолжая по индукции, получаем

P{Xo = i0, JV| = it, xn = in} = Pin_v inPin_2, 1п^ • • • Pia, tlPi0. (1.8)

§ 2. ПРИМЕРЫ МАРКОВСКИХ ЦЕПЕЙ

Большое число физических, биологических и экономических яв-

лений описываются марковскими цепями. Ниже приводится не-

сколько примеров.

$ 2. Примеры марковских цепей

39

А. Пространственно однородные марковские цепи

Пусть дискретная с. в. g принимает неотрицательные целочис-

оо

ленные значения, причем P{g = /} = ^, и 2#z==l- Пусть

i = l

gb ?2, • • ., ?п, • • • представляют результаты независимых наблю-

дений с. в. g.

Мы опишем две различные.марковские цепи, связанные с после-

довательностью {gj. В обоих случаях пространство состояний сов-

падает с множеством неотрицательных целых чисел.

(I) Определим процесс {Хп, п = 0, 1,2, ..положив Хп = gn

(начальное значение Хо = go задано). Матрица переходных веро-

ятностей этого процесса имеет вид

а0 «1 а3 ...

^0 #1 #2 • • •

Р = а0 ai а2 а3 ...

Тот факт, что у матрицы Р все строки одинаковы, означает, что

с. в. Xn+i не зависит от с. в. Хп-

(II) Другой важный класс марковских цепей возникает при

рассмотрении последовательных частичных сумм т]п с. в. gf, т. е.

% = + Ь+ • • • + п== 1, 2, ... .

Считаем по определению, что цо = 0. Процесс {Хп = Цп}, как не-

трудно видеть, является марковским. Легко найти его матрицу пе-

реходных вероятностей; именно:

P{xrt+i = /|Xn = o = P{?i+ ... +gn+1 = /|g1+ ... +g„ = 0 =

P {£n + l 1 l} I 0> < L

Здесь мы, очевидно, воспользовались независимостью g2-. В дан-

ном случае матрица Р имеет вид

ад а{ а2 а3 а4 ...

0 Цд @2 @3 * • •

Р = 0 0 а0 а, а2 ... • (2.1)

Если с. в. g может принимать как положительные, так и отри-

цательные целочисленные значения, то возможные значения для

каждого п содержатся в множестве всех целых чисел. В данном

40

Гл. 2. Марковские цепи

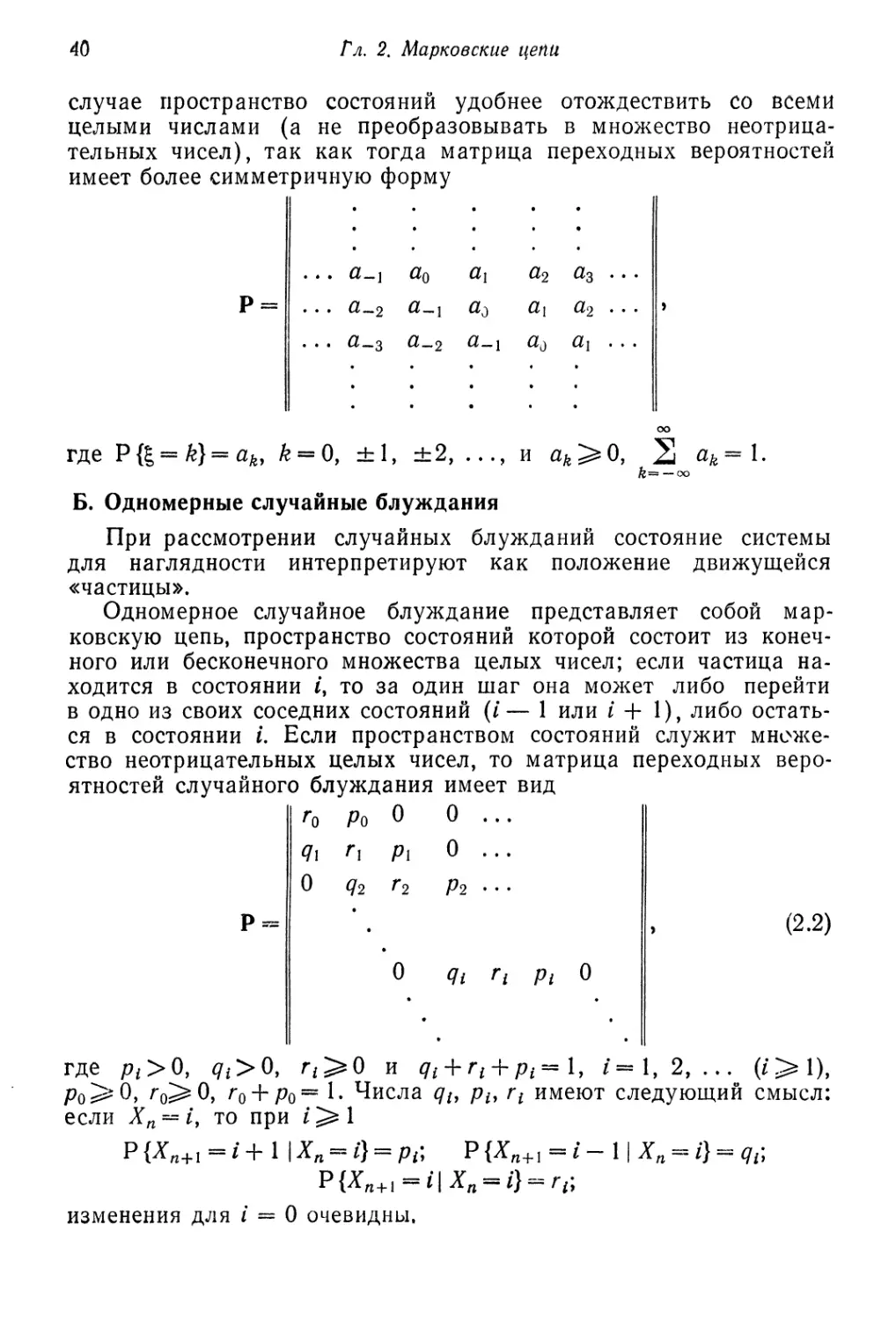

случае пространство состояний удобнее отождествить со всеми

целыми числами (а не преобразовывать в множество неотрица-

тельных чисел), так как тогда матрица переходных вероятностей

имеет более симметричную форму

... а-! а0 6Z1 а2 ^3

р = . . . $—2 «1 а2

... а-з 0-2 ах

• • • •

оо

где Р {£ = k} — ak, k = Q, ±1, ±2, ..и ak 0, 3 а* = 1-

k~ “ОО

Б. Одномерные случайные блуждания

При рассмотрении случайных блужданий состояние системы

для наглядности интерпретируют как положение движущейся

«частицы».

Одномерное случайное блуждание представляет собой мар-

ковскую цепь, пространство состояний которой состоит из конеч-

ного или бесконечного множества целых чисел; если частица на-

ходится в состоянии /, то за один шаг она может либо перейти

в одно из своих соседних состояний (/— 1 или i + 1), либо остать-

ся в состоянии i. Если пространством состояний служит множе-

ство неотрицательных целых чисел, то матрица переходных веро-

ятностей случайного блуждания имеет вид

Го Ро о 0 ...

q\ pt о ...

О <72 Г 2 р2 ...

Р = , (2.2)

о <7/ r{ Pi О

где Pi>0, qi>0, и QtX-г= 7=1,2,... (7> 1),

Ро^гО, ro^O, ro + Po~ 1- Числа qh ph rt имеют следующий смысл:

если Хп — 7, то при i 1

Р {%n+i — i + 1 I Хп = 0 — Рь Р {Хя+1 = 7 — 11 Хп = 7} = <7г;

Р {^п+1 ~ Л Хп — I} — г

изменения для 7 = 0 очевидны.

§ 2, Примеры марковских цепей

41

В пользу названия «случайное блуждание» для процесса та-

кого типа говорит тот факт, что его реализация описывает путь

«абсолютно пьяного» человека, делающего случайным образом

шаг вперед или шаг назад.

Капитал игрока, участвующего в серии партий азартной игры,

часто описывают процессом случайного блуждания. Предположим,

что игрок А, имеющий капитал k, играет с бесконечно богатым

партнером, при этом вероятность того, что он выиграет партию

и увеличит свой капитал на единицу, равна pht а вероятность того,

что он проиграет и тем самым уменьшит свой капитал на единицу,

равна qh = 1—pk(k^l). Зависимость вероятностей выигрыша и

проигрыша от k отражает возможную зависимость условий игры

от капитала. Так, можно условиться, что, оказавшись в состоянии О

(соответствующем разорению игрока А), процесс остается в этом со-

стоянии, т. е. /'о = 1. Процесс {Хп}, где Хп — размер капитала игро-

ка А после п партий, является процессом случайного блуждания.

Этот процесс известен под названием «задачи о разорении игрока».

Случайное блуждание с pk = Р, qk = 1 — р = q (k 1) и г0 = 1

соответствует одинаковым повторяющимся партиям; если р> q,

то в каждой партии шансы игрока А явно предпочтительнее.

В гл. 3 мы покажем, что в этом случае с вероятностью (qp)x\

где %о — его начальный капитал, игрок А разоряется (теряет свой

капитал) и с вероятностью 1 — (q!p)x* его капитал будет беспре-

дельно возрастать. Если же р < q, то игра явно выгодна хозяевам

игорного заведения, и почти наверное (с вероятностью 1) игрок А

разорится, если будет играть достаточно долго. Игрок А обречен

на разорение (с вероятностью 1) и в том случае, когда игра без-

обидна, т. е. когда ph = qk = Vs-

Если партнер, игрок Б, тоже начинает игру, располагая огра-

ниченным капиталом у, то капитал игрока А снова описывается

марковской цепью {Хп}. Однако эта цепь имеет конечное множе-

ство состояний 0, 1, ..., а, где а = х + у, хну — начальные со-

стояния игроков А и Б соответственно. Разность а — Хп интерпре-

тируется как капитал игрока Б после п партий. Если среди исхо-

дов каждой партии допускается ничья, то матрица переходных ве-

роятностей цепи {Хп} имеет вид

1 0 0 0 ............

q\ р{ о ............................

о q2 г2 р2 .........................

Уа — \ га~\ Ра-\

0 .............0 0 1

(2.3)

42

Гл. 2. Марковские цепи

Как и ранее, рг(рг), i = 1, 2, а—1, есть вероятность того,

что игрок А, имея капитал /, увеличит (уменьшит) его на единицу

в следующей партии. Отметим, что в соответствии с матрицей пе-

реходных вероятностей (2.3) капитал игрока А (состояние процес-

са), достигнув величины а или обратившись в 0, остается в этих

состояниях навсегда. Мы говорим, что игрок А разорен, если про-

цесс достиг состояния 0; если же процесс попадает в состояние а,

то мы говорим, что разорен игрок Б.

Случайные блуждания оказываются полезными не только для

описания игровых ситуаций, но и служат неплохими моделями фи-

зических процессов, в частности диффузии частиц. Если частица

претерпевает случайные столкновения, то ее положение подверже-

но случайным флуктуациям, хотя описываемая ею траектория не-

прерывна. Если будущее положение (точнее, его распределение ве-

роятностей) частицы зависит только от ее настоящего положения,

то процесс {XJ, где Xt — положение частицы в момент t, являет-

ся марковским. Дискретная аппроксимация такого непрерывного

движения соответствует случайному блужданию. Симметричное

случайное блуждание представляет собой классический дискретный

аналог броуновского движения (см. § 2 гл. 1). Под симметричным

случайным блужданием на множестве всех целых чисел подразу-

мевается марковская цепь с пространством состояний, являющимся

множеством всех целых чисел, с элементами матрицы переходных

вероятностей вида

р, если j = i + 1,

р, если j = i— 1,

Рц= I . .

1 г, если j = i,

0 во всех остальных случаях,

где р > 0, г > 0, 2р + г = 1 и /, / = 0, ±1, ±2, ... . Обычно сим-

метричным случайным блужданием называют марковскую цепь

с г = 0 и р = V2.

Исследование некоторых физических моделей приводит нас

к рассмотрению случайных блужданий на множестве неотрица-

тельных целых чисел. Можно дать классификацию таких процес-

сов на основе свойств нулевого состояния. Пусть случайное блуж-

дание описывается матрицей (2.2). Если р0 = 1 (а значит, и

го = 0), то нулевое состояние обладает свойствами отражающего

экрана. Всякий раз, когда частица достигает нулевого состояния,

в результате следующего перехода она оказывается в состоянии 1.

Это соответствует ситуации, когда в нуле находится упругая

стенка и частица отскакивает от нее без каких-либо остаточных

явлений.

Если ро = 0 и Го = 1, то нулевое состояние ведет себя как по-

глощающий экран. Попав в нулевое состояние, частица остается

§ 2. Примеры марковских цепей

43

в нем навсегда. Если ро > 0 и г0 > О, то нулевое состояние яв-

ляется частично отражающим экраном.

Если случайное блуждание ограничено конечным числом со-

стояний, скажем 0, 1, 2, ..., а, оба крайних состояния 0 и а не-

зависимо и в любой комбинации могут быть отражающими, погло-

щающими или частично отражающими экранами. Мы уже имели

дело со случаем, когда состояния 0 и а были поглощающими

[см. (2.3)].

Классическую модель диффузии через мембрану представляет

собой модель Эренфестов. Модель описывается как процесс слу-

чайного блуждания с конечным числом состояний (/ = —а,

—а + 1, ..., —1, 0, 1, ...,«), причем крайние состояния — а и а

являются отражающими экранами. Матрица переходных вероят-

ностей задается следующим образом:

а — i

2а

а + i

2а

О

если / = / + 1,

если j = i~ 1,

в остальных случаях.

Физическая интерпретация этой модели такова. Имеется две

урны А и Б, содержащие вместе 2 а шаров. Предположим, что

урна А содержит k шаров. При каждом испытании случайным об-

разом выбирается один шар и перекладывается в другую урну; при

этом каждый из шаров имеет равную со всеми остальными вероят-

ность быть переложенным независимо от того, в какой урне он

находится. Каждое испытание приводит к изменению состояния *)

системы. Характерным для перемещения шаров будет преимуще-

ственное направление от урны с большей концентрацией к урне

с меньшей концентрацией. Модель Эренфестов в некоторых слу-

чаях можно использовать для исследования физических систем,

находящихся под действием восстанавливающих сил, величина

которых пропорциональна расстоянию от положения равновесия.

Классическое симметричное n-мерное случайное блуждание

определяется следующим образом. ПространствОхМ состояний про-

цесса является целочисленная решетка в Еп (n-мерном евклидо-

вом пространстве), точки которой суть наборы из п целых чисел

вида к = (^1, k2,..., kn). Переходные вероятности определяются

следующим образом:

п

Pki= 2Л> если

О в противном случае.

’) Состоянием здесь является величина разности между числом шаров в

урне А и урне Б с учетом знака. — Прим, персе.

44

Гл. 2. Марковские цепи

Аналогично одномерному случаю n-мерное симметричное случай-

ное блуждание представляет собой дискретный аналог п-мерного

броуновского движения.

В. Дискретная марковская цепь, описывающая очередь

Заявки поступают к месту обслуживания и становятся в оче-

редь. Допустим, что обслуживание одной заявки занимает фикси-

рованное время (период), продолжительность которого принимает-

ся за единицу. Если к моменту окончания обслуживания заявки

очередь отсутствует, в следующий период обслуживания не про-

исходит. (Можно представить себе, например, стоянку такси, на

которую через одинаковые промежутки времени прибывают маши-

ны одна за другой. Если в очереди нет пассажиров, машина сразу

же уезжает.) Во время обслуживания некоторой заявки могут по-

ступить новые заявки. Предположим, что число заявок gn, посту-

пающих в течение n-го периода, является случайной величиной,

функция распределения которой не зависит от номера периода и

имеет вид

Р{за один период поступило k заявок} = P{£n = k} = ak, (2.4)

оо

fe = 0, 1,..., ak>0, 5^=1.

k=o

Мы предположим также, что с. в. независимы. Состояние си-

стемы в n-й момент времени определяется как число заявок, жду-

щих обслуживания к началу n-го периода. Если система находит-

ся в состоянии Z, то по прошествии одного периода она перейдет

в состояние

[ Z— 1 + L если /^1,

| I, если 1 = 0, (2-5)

где % — число поступивших за этот период заявок. В терминах

значений случайного процесса мы можем выразить (2.5) так:

X„+1 = (X„-1)+ + U (2.6)

где У+ = max (У, 0). В силу (2.4) И (2.5) матрица переходных ве-

роятностеи имеет вид

а0 «1 а2 «3 а4 ...

aQ «1 п2 «3 «4 •••

0 а0 а. а2 «з •••

1НМ = 0 0 а0 ai а2 ... (2.7)

0 0 0 а0 а, ...

£ 2, Примеры марковских цепей

45

Интуитивно ясно, что если среднее число новых заявок S kakt

k—Q

прибывающих за период, превышает единицу, то со временем оче-

редь будет беспредельно увеличиваться.

С другой стороны, если l^kak<l, то, как мы увидим, распре-

деление длины очереди приближается к некоторому равновесному

(стационарному) распределению. Если то возникает

существенно неустойчивая ситуация. Все эти утверждения будут

строго доказаны после того, как будет изложена теория рекуррент-

ных событий (см. § 5 гл. 3).

Г. Модель из теории запасов

Рассмотрим систему, в которой запасается некоторый товар

с целью удовлетворения постоянного спроса. Предположим, что

восполнение запаса осуществляется в моменты времени /2, .. .,

а суммарный спрос на товар в интервале tn) представ-

ляет собой случайную величину с распределением

P£n = k} = ak, £-0, 1, 2, (2.8)

одинаковым для всех интервалов, причем как обычно, 0 и

оо

2 а. = 1. Уровень запаса фиксируется в начале каждого периода.

Стратегия запасания такова: если имеющееся количество товара

не превышает некоторого критического уровня s, то производится

немедленное пополнение запаса до уровня S > s. Если же имею-

щееся количество товара больше $, то пополнения не производит-

ся. Пусть Хп обозначает уровень наличного запаса непосредствен-

но перед моментом tn. Пространство состояний процесса {Хп}

складывается из возможных значений уровня запаса

S, S — 1, ..., +1, 0, - 1, —2, ...,

где отрицательные значения интерпретируются как неудовлетво-

ренный спрос (эти заказы подлежат немедленному исполнению

при пополнении запаса). Согласно описанной стратегии, уровни

запаса двух последовательных периодов связаны соотношением

f если s<Xn^S,

Х„+1 = q / у (2-9)

lS-Un> если Xn<s, 7

где In — суммарный спрос за n-й период с распределением вероят-

ностей (2.8). Если предположить, что с. в. gn независимы, то уровни

запаса XQ, Х2, ... образуют марковскую цепь, матрицу пе-

реходных вероятностей которой можно вычислить, отправляясь

от соотношения (2.9).

46

Г л. 2. Марковские цепи

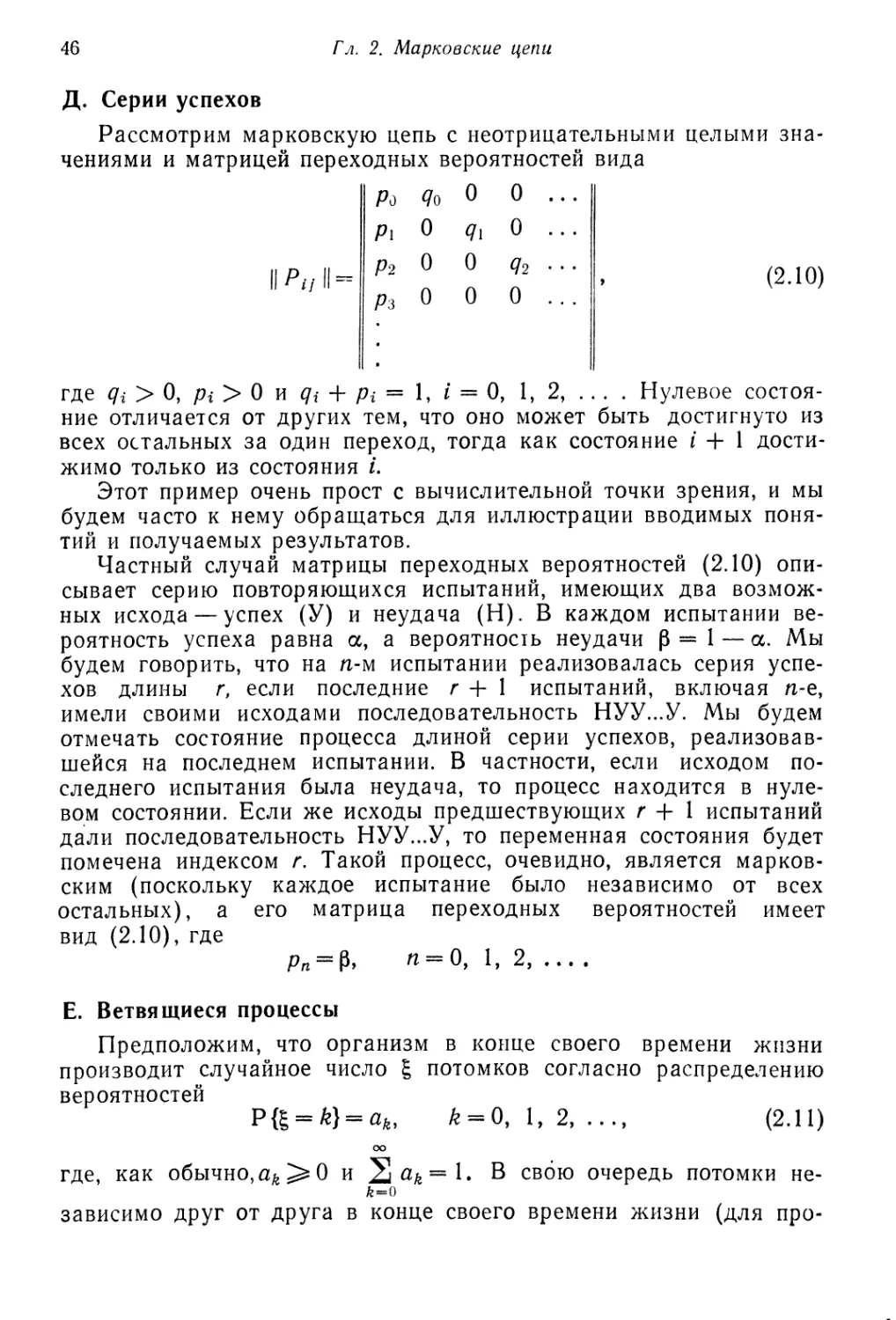

Д. Серии успехов