Автор: Бородовский М. Екишева С.

Теги: биологические науки в целом деятельность и организация общая теория связи и управления (кибернетика) общая биофизика биология задачи по биологии

ISBN: 978-5-93972-644-3

Год: 2008

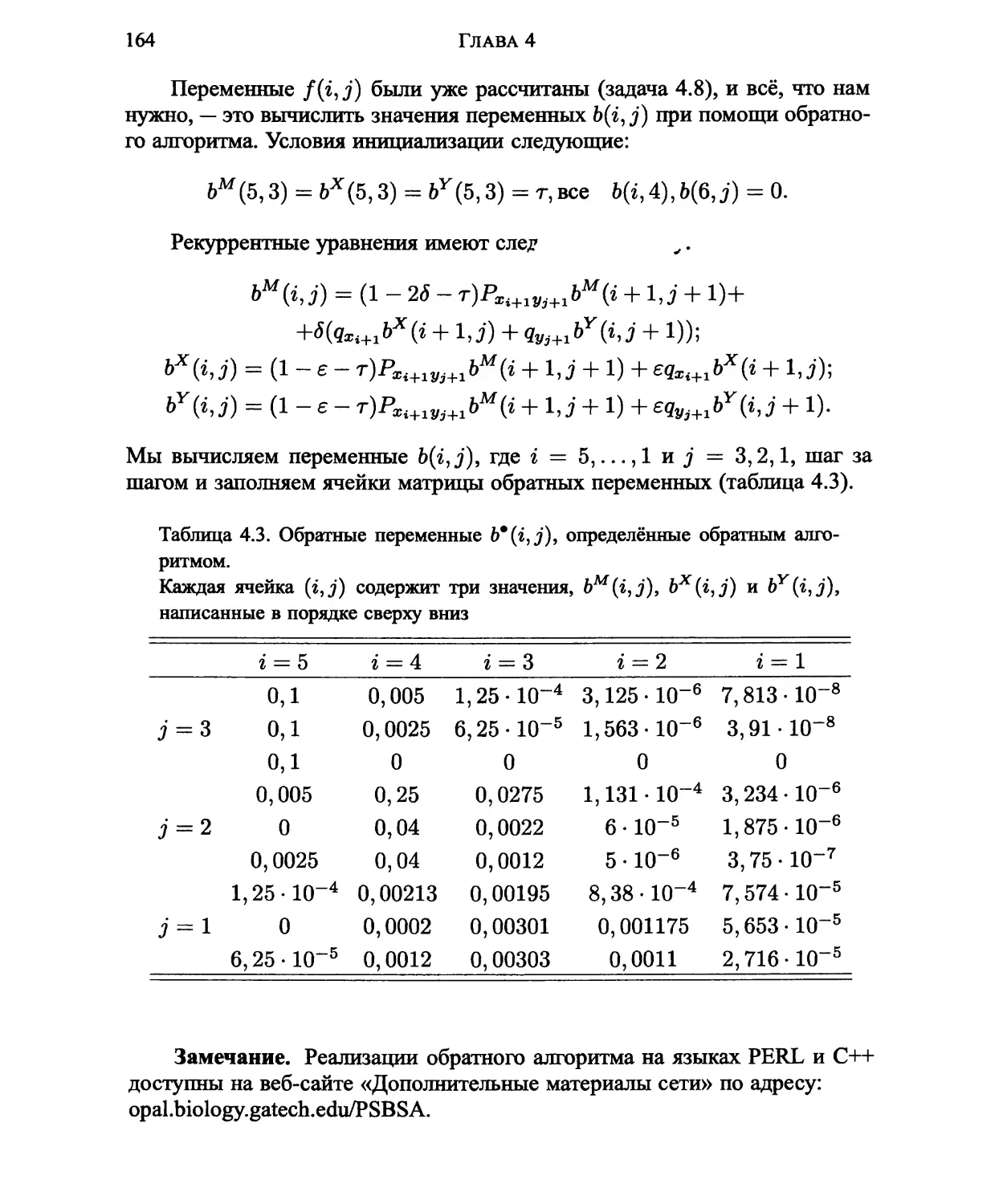

Текст

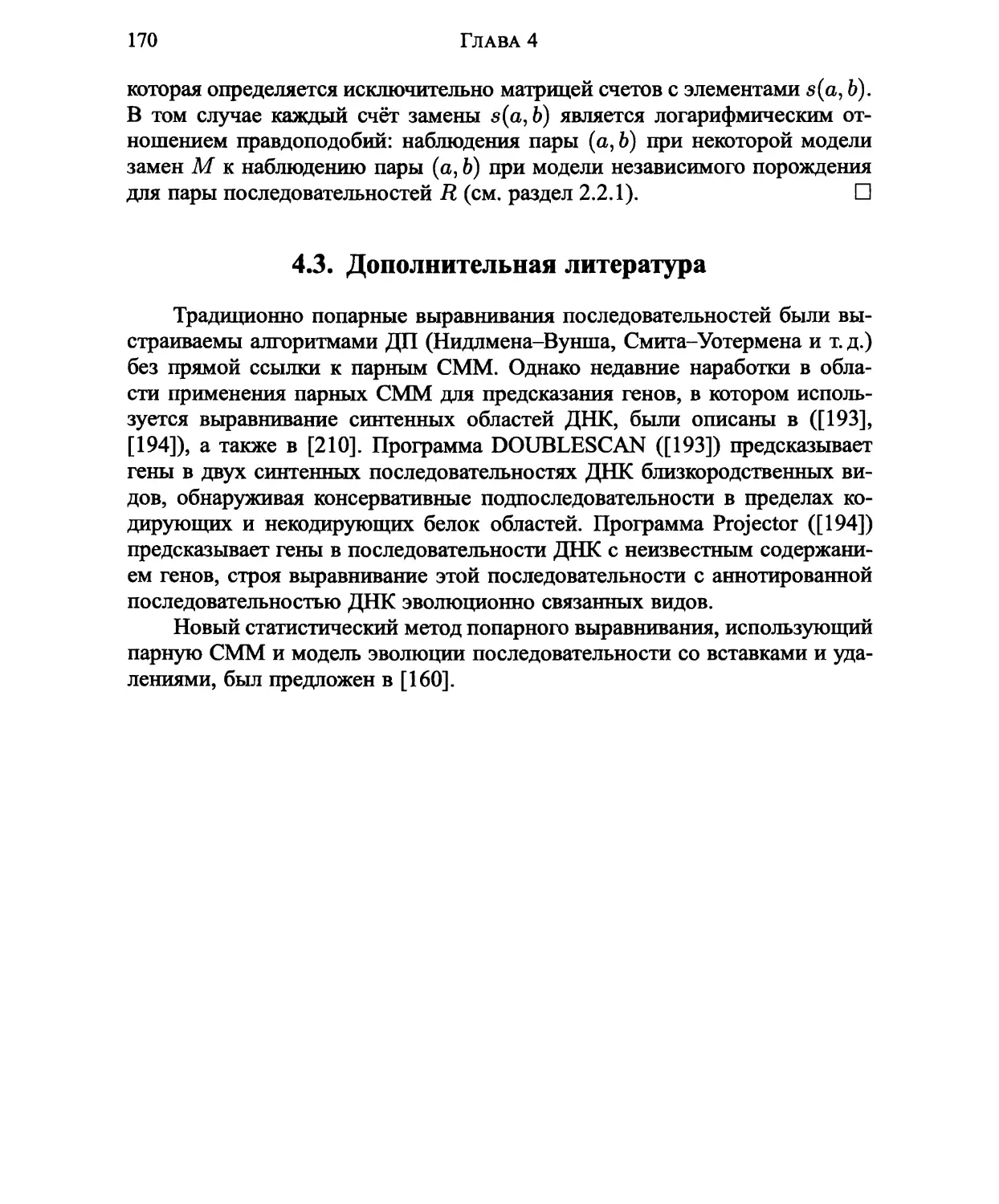

БИОИНФОРМАТИКА

И МОЛЕКУЛЯРНАЯ БИОЛОГИЯ

I ! -■'.„. f

I ! М. Бородовский, С. Екишев. ^ ^*,

! . '-, ^У

J | ЗАДАЧИ И РЕШЕНИЯ^1Г"

\ ПО АНАЛИЗУ .-?>>^%

1 ! БИОЛОГИЧЕСКй'хСК

ПОСЛЕДЬг * •Б^НО'сТ.ЕЙ

i > A'VV у **

R&C

T><fHA*dC4

PROBLEMS AND SOLUTIONS IN

BIOLOGICAL SEQUENCE ANALYSIS

MARK BORODOVSKY AND SVETLANA EKISHEVA

CAMBRIDGE

UNIVERSITY PRESS

МАРК БОРОДОВСКИЙ

СВЕТЛАНА ЕКИШЕВА

ЗАДАЧИ И РЕШЕНИЯ

ПО АНАЛИЗУ БИОЛОГИЧЕСКИХ

ПОСЛЕДОВАТЕЛЬНОСТЕЙ

Перевод с английского А. А. Чумичкина

Под редакцией д. б. н., проф. А. А. Миронова

Москва ♦ Ижевск

2008

УДК 57:007

ББК 28.071.3

Б 833

Издание выполнено при частичной финансовой поддержке

Научно-исследовательского института физико-химической биологии им.

А.Н.Белозерского.

Бородовский М., Екишева С.

Задачи и решения по анализу биологических последовательностей. —

М.Ижевск: НИЦ «Регулярная и хаотическая динамика», Институт

компьютерных исследований, 2008. — 440 с.

Данное издание является первым и единственным в своем роде задачником по

биоинформатике, в котором богатая подборка задач сопровождается подробными

решениями. Следуя структуре книги «Анализ биологических последовательностей»

Дурбина Р., Эдди III., Крог А., Митчисон Г. (НИЦ «РХД», 2006), авторы значительно

расширяют набор поддающихся решению задач. Таким образом, обе эти книги

представляют собой полноценный учебный комплект, который был опробован и одобрен

в зарубежных университетах, и может успешно использоваться в российских вузах

на соответствующих специальностях. Предлагаемый задачник способствует более

глубокому пониманию теоретического материала, изложенного в книге Р.

Дурбина и др., а также позволяет освоить практические навыки рационального решения

биологических задач, что является залогом успешных исследований в таких

стремительно развивающихся областях науки, как биоинформатика и системная биология.

ISBN 978-5-93972-644-3 ББК 28.071.3

© М. Бородовский, С. Екишева, 2006

© Перевод на русский язык:

НИЦ «Регулярная и хаотическая динамика», 2008

This publication is in copyright. Subject to statutory exception and to the provisions of relevant

collective licensing agreements, no reproduction of any part may take place without the written

permission of Cambridge University Press.

Все права на данное издание защищены, за исключением случаев, установленных

законом и условий, предусмотренных соответствующими лицензионными соглашениями,

заключенными на коллективной основе. Никакая его часть не может быть воспроизведена, если на

то нет письменного разрешения издательства Cambridge University Press.

http ://shop.rcd.ru

http://ics.org.ru

Посвящается:

М.Б.:

Ричарду и Джуди Линкофф

С. Е.:

Сергею и Наташе

Оглавление

Предисловие 10

Введение 12

Глава 1. ЗНАКОМСТВО С ПРЕДМЕТОМ 17

1.1. Оригинальные задачи 18

1.2. Дополнительные задачи 22

1.3. Дополнительная литература 45

ГЛАВА 2. ПОПАРНОЕ ВЫРАВНИВАНИЕ 46

2.1. Оригинальные задачи 47

2.2. Дополнительные задачи и теория 69

2.2.1. Получение матриц замен аминокислот (ряд ПТМ) . . . 73

2.2.2. Распределения счетов подобия 86

2.2.2.1. Теоретическое введение в задачи 2.19 и 2.20 . 86

2.2.3. Распределение длины длиннейшего общего слова для

нескольких несвязанных последовательностей 93

2.3. Дополнительная литература 97

Глава 3. МАРКОВСКИЕ ЦЕПИ И СКРЫТЫЕ МАРКОВСКИЕ

МОДЕЛИ 99

3.1. Оригинальные задачи 100

3.2. Дополнительные задачи и теория 112

3.2.1. Вероятностные модели последовательностей

символов: выбор модели и оценка параметров 122

3.2.2. Байесов подход к анализу состава

последовательностей: модель сегментации Лю и Лоренса 133

3.3. Дополнительная литература 141

Глава 4. ПОПАРНОЕ ВЫРАВНИВАНИЕ С ПОМОЩЬЮ СММ 143

4.1. Оригинальные задачи 144

4.2. Дополнительные задачи 156

4.3. Дополнительная литература 170

8 Оглавление

Глава 5. ПРОФИЛЬНЫЕ СММ ДЛЯ СЕМЕЙСТВ

ПОСЛЕДОВАТЕЛЬНОСТЕЙ 171

5.1. Оригинальные задачи 173

5.2. Дополнительные задачи и теория 184

5.2.1. Различающая функция и максимальные

различительные веса 200

5.2.1.1. Теоретическое введение в задачу 5.11 .... 200

5.3. Дополнительная литература 214

Глава 6. МЕТОДЫ МНОЖЕСТВЕННОГО ВЫРАВНИВАНИЯ

ПОСЛЕДОВАТЕЛЬНОСТЕЙ 215

6.1. Оригинальная задача 216

6.2. Дополнительные задачи и теория 217

6.2.1. Алгоритм множественного выравнивания Каррилло-

Липмена 217

6.2.2. Прогрессивные выравнивания: алгоритм Фэна-Ду-

литтла 227

6.2.3. Алгоритм выборки Гиббса для локального

множественного выравнивания 235

6.3. Дополнительная литература 237

Глава 7. ПОСТРОЕНИЕ ФИЛОГЕНЕТИЧЕСКИХ ДЕРЕВЬЕВ 240

7.1. Оригинальные задачи 241

7.2. Дополнительные задачи 273

7.3. Дополнительная литература 279

Глава 8. ВЕРОЯТНОСТНЫЕ ПОДХОДЫ К ФИЛОГЕНИИ .281

8.1. Оригинальные задачи 282

8.1.1. Байесов подход к отысканию оптимального дерева и

алгоритм Мау-Ньютона-Ларге 301

8.2. Дополнительные задачи и теория 330

8.2.1. Связь между моделями эволюции

последовательностей, описываемыми марковским и пуассоновским

процессами 337

8.2.2. Модель эволюции последовательностей Торна-Кисино-

Фельзенштейна с заменами, вставками и удалениями . 345

8.2.3. Дополнительные сведения об интенсивностях замен . 350

8.3. Дополнительная литература 351

Оглавление 9

Глава 9. ТРАНСФОРМАЦИОННЫЕ ГРАММАТИКИ 354

9.1. Оригинальные задачи 355

9.2. Дополнительная литература 367

ГЛАВА 10. АНАЛИЗ СТРУКТУРЫ РНК 368

10.1. Оригинальные задачи 369

10.2. Дополнительная литература 389

Глава 11. ДОПОЛНИТЕЛЬНЫЕ СВЕДЕНИЯ ИЗ ТЕОРИИ

ВЕРОЯТНОСТЕЙ 392

11.1. Оригинальные задачи 392

11.2. Дополнительная задача 412

11.3. Дополнительная литература 413

Литература 414

Предметный указатель 433

Предисловие

ЗАДАЧИ И РЕШЕНИЯ ПО АНАЛИЗУ БИОЛОГИЧЕСКИХ

ПОСЛЕДОВАТЕЛЬНОСТЕЙ

Эта книга первая из разряда задачников по биоинформатике, в которой

довольно обширный подбор задач сопровождается решениями.

Примечательно, что представленный в ней набор задач включает в себя все задачи,

предлагаемые в книге «Анализ биологических последовательностей» [67],

принятой многими ведущими университетами мира в качестве

рекомендуемого источника материала для чтения курсов биоинформатики. Хотя

многие из задач, приведённых в «АБП» в качестве упражнений, неоднократно

использовались для домашних и контрольных работ, подробные решения

к этим задачам отсутствовали. В связи с этим преподаватели

биоинформатики часто выражали желание иметь полностью проработанные решения

и располагать более широком набором задач для своих курсов.

Данная книга даёт именно это: следуя структуре, принятой в «АБП»,

и значительно расширяя набор поддающихся решению задач, она облегчит

более глубокое понимание содержания глав «АБП» и поможет её

читателям развить навыки решения задач, чрезвычайно важные для проведения

успешных исследований в расширяющемся поле биоинформатики. Весь

материал книги был опробован её авторами на учебных занятиях в

Технологическом институте Джорджии, где была проведена самая первая программа

подготовки выпускников со степенью магистра наук по биоинформатике.

Марк Бородовский — регент-профессор1 биологии и

биомедицинских технологий, а также Директор Центра биоинформатики и

вычислительной биологии в Технологическом институте Джорджии в Атланте. Он

является основателем программ подготовки и выпуска специалистов по

биоинформатике со степенью магистра наук и доктора философии в

Технологическом институте Джорджии. Направления его исследований

пролегают в областях биоинформатики и системной биологии. Он преподаёт курсы

биоинформатики с 1994 года.

Регент — член правления в некоторых американских университетах. — Прим. перев.

Предисловие

11

Светлана Екишева — учёный-исследователь «Школы биологии»

при Технологическом институте Джорджии в Атланте. Её

исследовательские интересы направлены на решение вопросов биоинформатики,

прикладной статистики и стохастических процессов. В сферу её компетенции

входит преподавание теории вероятностей и математической статистики

в университетах России и США.

Введение

Биоинформатика, будучи неотъемлемой частью постгеномной

биологии, закладывает принципы и рождает идеи, применяемые в области

вычислительного анализа биологических последовательностей. Эти идеи

облегчают преобразование волны данных секвенирования последовательностей,

порождённой недавним информационным всплеском в биологии, в

непрерывный поток открытий. Не удивительно, что новая биология двадцать

первого века привлекла интерес многих талантливых выпускников

университетов различного профиля. Преподавание биоинформатики столь разноликой

аудитории представляет собой известный вызов педагогическому

мастерству учёных. Во многих университетах, в том числе и в Технологическом

институте Джорджии в Атланте, США, принят подход, согласно которому

студентам надлежит сначала усовершенствовать свои знания в области

программирования на компьютере и математической статистики и лишь затем

приступать к изучению всестороннего основного курса биоинформатики.

В 1998 году, в начале осуществления разработанной нами программы

выпуска магистрантов и докторантов, мы выбрали на то время недавно

выпущенную книгу Ричарда Дурбина, Андерса Крога, СейнаР. Эдди и Грэми

Митчисона «Анализ биологических последовательностей» («АБП») в

качестве учебного пособия для основного курса биоинформатики. С

течением времени «АБП», в которой идеи главных алгоритмов биоинформатики

описаны в замечательно краткой и последовательной манере, стала

популярным источником материала для преподавания курсов биоинформатики

в ведущих университетах по всему Земному шару. Многие задачи,

включенные в «АБП» в качестве упражнений, неоднократно использовались для

домашних и контрольных работ. Однако подробных решений этих задач не

имелось. Проблема отсутствия подобного познавательного ресурса

неоднократно отмечалась как студентами, так и преподавателями.

Цель этой книги, «Задачи и решения по анализу биологических

последовательностей», состоит в том, чтобы восполнить этот пробел, расширить

набор поддающихся решению задач и помочь читателям развить навыки их

решения, весьма важные для проведения удачных изысканий на

расширяющейся ниве биоинформатики. Мы надеемся, что эта книга облегчит

понимание содержания глав «АБП» и, кроме того, предоставит дополнительную

Введение

13

точку опоры (необходимую читателям, у которых не было возможности

изучить базовый курс биоинформатики) для углублённого чтения «АБП».

Мы расширили набор оригинальных задач «АБП», добавив много новых

задач, прежде всего тех, которые предлагались магистрантам и докторантам

Технологического института Джорджии.

В исследовательском аппарате биоинформатики часто применяется

вероятностное моделирование и статистический анализ. Основные

алгоритмы биоинформатики, предназначенные для попарного и множественного

выравнивания последовательностей, поиска генов, обнаружения ортологов

и построения филогенетических деревьев, не могли бы работать без

рационального выбора модели, без оценки параметров, без должным образом

обоснованных систем очков и без оценки статистической значимости. Эти

и многие другие элементы эффективных инструментов биоинформатики

требуют, чтобы специалист принимал во внимание случайный

(вероятностный) характер последовательностей белка и ДНК.

Как было показано авторами «АБП», вероятностное моделирование

заложило основу для развития мощных методов и алгоритмов интерпретации

биологических последовательностей и открытия их функционального

значения и эволюционных связей. Примечательно, что вероятностное

моделирование представляет собой обобщение строго детерминированного

моделирования, которое имеет поразительно глубокую традицию в

естествознании. Эту традицию можно проследить в объяснении астрономических

наблюдений движения планет Солнечной системы Исааком Ньютоном,

который предложил краткую компактную модель, сочетающую в себе недавно

открытый им закон всемирного тяготения с законами динамики.

Принцип наибольшего правдоподобия, известный в математической

статистике, вопреки моде его традиционного применения также уходит

своими корнями в «детерминированную» науку, согласно которой выбранная

структура и параметры теоретической модели обеспечивают наилучшее

соответствие между предсказаниями и экспериментальными наблюдениями.

Например, метод наибольшего правдоподобия можно узнать в принятии

Фрэнсисом Криком и Джеймсом Уотсоном модели двойной спирали ДНК,

выбранной из комбинаторного числа биохимически жизнеспособных

альтернатив как дающую наилучшее соответствие с данными рентгенострук-

«урного анализа трёхмерной структуры ДНК, а также с другими

экспериментальными данными, имевшимися в их распоряжении.

В изучении процессов наследования и молекулярной эволюции, где

случайные факторы играют важные роли, на сцену выходят совсем уже

оперившиеся вероятностные модели. Классический цикл, в который

входит проведение экспериментов, анализ данных и моделирование с поиском

14

Введение

наилучшего соответствия моделей данным, был разработан и осуществлён

Грегором Менделем. Его замечательная многолетняя исследовательская

деятельность обеспечила доказательство существования дискретных единиц

наследственности — генов.

Когда мы имеем дело с данными, исходящими из менее

управляемой среды, например, с данными о естественной биологической эволюции,

охватьгоающими периоды времени, измеряемые миллионами лет, задача

построения моделей требует ещё большего напряжения. И всё же ситуация не

совсем безнадёжна. Модели молекулярной эволюции, предложенные

Маргарет Дейхофф с сотрудниками, Джуксом и Кантором, а также Кимурой,

являются классическими примерами фундаментальных достижений в

моделировании сложных процессов эволюции ДНК и белка. Эти модели

главным образом сосредоточиваются лишь на отдельно взятом участке

молекулярной последовательности и требуют дальнейшего упрощающего

допущения о том, что отдельные участки последовательности эволюционируют

независимо друг от друга. Тем не менее такие модели представляют собой

полезные отправные точки для понимания функций и эволюции

биологических последовательностей, а также для разработки алгоритмов,

проливающих свет на такого рода функциональные и эволюционные связи.

Например, счета замен аминокислот являются критически

важными параметрами алгоритмов оптимального глобального (Нидлмена-Вунша)

и локального (Смита-Уотермена) выравнивания последовательностей.

Получение счетов замен, имеющих биологический смысл, невозможно без

построения моделей эволюции белка.

В середине 1990-х гг. понятие скрытой марковской модели (СММ),

имевшей широкое практическое применение в распознавании речи, было

введено в поле биоинформатики и быстро вошло в основную колею

методов моделирования, используемых в анализе биологических

последовательностей.

Достижения теории за период с середины 1990-х гг. и до наших дней

показали, что задача выравнивания последовательностей имеет

естественную вероятностную интерпретацию на основе скрытых марковских

моделей. В частности, алгоритм динамического программирования (ДП) для

попарного и множественного выравнивания последовательностей имеет

эквивалент, основанный на СММ, — алгоритм Витерби. Если тип вероятностной

модели для биологической последовательности выбран, то параметры

модели могут быть выведены статистическими методами (обучающейся

машины). Может быть проведено сравнение двух конкурирующих моделей, с

тем чтобы определить в их числе ту модель, которая даёт наилучшее

соответствие.

Введение

15

События и отборочные силы, имевшие место в далёком прошлом и

двигавшие эволюцию биологических видов вперёд, приходится

восстанавливать по текущим данным расшифровки биологических

последовательностей, содержащим существенные помехи, обусловленные всеми

изменениями, произошедшими за всё время жизни исчезнувших поколений. Эту

трудность можно преодолеть до некоторой степени при помощи общей

концепции самосогласованных моделей, где параметры многократно

корректируются, с тем чтобы соответствовать растущему собранию данных секвени-

рования последовательностей. Вследствие этого, для осуществления такой

концепции необходимы алгоритмы с максимизацией математического

ожидания, способные оценивать параметры модели одновременно с

перегруппировкой данных и в результате производить структуру данных (такую как

множественное выравнивание), которая в большей степени соответствует

модели. В «АБП» описано несколько алгоритмов с максимизацией

математического ожидания, в том числе самообучающийся алгоритм для

профильной СММ и самообучающийся алгоритм для филогенетической СММ.

Учитывая, что практика работы со многими алгоритмами, описанными в

«АБП», требует программирования на компьютере в большом объёме,

можно ожидать, что описание решений могло бы ввести нас в сложные

компьютерные программы и таким образом увести далеко от начальных концепций

и идей. Однако большая часть приведённых в «АБП» упражнений имеет

аналитические решения. В некоторых случаях мы иллюстрировали

реализацию алгоритмов упрощёнными «модельными» примерами.

Компьютерные программы для таких примеров, написанные на языках C++ и Perl,

имеются на веб-сайте opal.biology.gatech.edu/PSBSA. Обратите внимание,

что в разделах «Дополнительная литература» мы упоминаем главным

образом те источники, которые были изданы после 1998 г. — года публикации

«АБП». Наконец, мы должны упомянуть, что встречающиеся в тексте

данной книги ссылки на страницы в «АБП» относятся к изданию 2006 года.

Благодарности

Мы благодарим Сергея Латкина, мужа Светланы, за замечательную

помощь в подготовке рисунков и таблиц для вёрстки в пакете Latex. Мы

крайне признательны Александру Ломсадзе, Райану Миллсу, Юаню Тяню,

Ьуржу Бакир, Джиттиме Пирияпонгсе, Вардгесу Тер-Хованисяну, Вэньха-

и к) Чжу, Джеффри Юнсу и Мэтью Бергински за неоценимую техническую

помощь в подготовке материалов книги; Сооцзиню И и Галине Глазко за

ссылки на полезные источники по молекулярной эволюции; Михаилу Ройт-

16

Введение

бергу за продуктивные беседы на предмет трансформационных грамматик

и конечных автоматов. Мы сердечно благодарим нашего редактора Катри-

ну Холлидей за огромное терпение и неустанную поддержку, без которой

эта книга никогда не вышла бы в свет. В особенности хочется

поблагодарить Ричарда Дурбина, Андерса Крога, СейнаР.Эдди и Грэми Митчи-

сона за поддержку, действенную критику и дельные предложения. Далее,

с удовольствием выражаем нашу признательность за сильную поддержку

«Школе биологии» при Технологическом институте Джорджии и

Факультету биомедицинских технологий имени Уоллеса X. Каултера в

Технологическом институте Джорджии и Университете Эмори. Наконец, мы желаем

вьфазить нашу индивидуальную, особую благодарность своим семействам

за большое терпение и неизменное участие.

М.Б. иС.Е.

Глава 1

ЗНАКОМСТВО С ПРЕДМЕТОМ

Читатель быстро обнаружит, что организация этой книги была выбрана

аналогичной организации книги «Анализ биологических

последовательностей» [67]. Первая глава «АБП» знакомит читателя с фундаментальными

понятиями анализа биологических последовательностей: подобием

последовательностей, гомологией, выравниванием последовательностей, а также

с основными концепциями вероятностного моделирования.

Тот факт, что столь разные концепции описаны в книге бок о бок, на

первый взгляд кажется удивительным. Однако давайте вспомним

несколько важных вопросов биоинформатики. Как следует строить попарное

выравнивание последовательностей? Как необходимо строить множественное

выравнивание последовательностей? Каким образом можно восстановить

филогенетическое дерево нескольких биологических последовательностей?

Как мы можем предсказать вторичную структуру РНК? Ни к одному из этих

вопросов нельзя обратиться надлежащим образом без применения

вероятностных методов. Математическая сложность этих методов колеблется от

основных теорем и формул до сложной архитектуры скрытых марковских

моделей и стохастических грамматик, способных уловить едва различимые

особенности состава эмпирических биологических последовательностей.

Подобный взрыву, неудержимый рост количества данных

расшифровки биологических последовательностей создал превосходную возможность

для имеющего практический смысл применения дискретных

вероятностных моделей. Возможно, не будет большого преувеличения, если мы

скажем, что значение, результаты, последствия этого нового подхода можно

сравнить со значением революционного для восемнадцатого века

применения исчисления и дифференциальных уравнений для решения задач

классической механики.

Рассматриваемые в этой вводной главе задачи связаны с

фундаментальными концепциями, которые играют важную роль в анализе

биологических последовательностей: наибольшее правдоподобие и максимальная

апостериорная (Байесова) оценка параметров модели. Эти концепции

являются важнейшими для понимания статистического вывода из эксперимен-

18

Глава 1

тальных данных и не могут быть введены без понятий условной и

безусловной вероятности, а также вероятности совместного наступления событий.

Часто возникающая задача параметризации модели по природе своей

трудна, если под рукой имеется лишь короткая обучающая

последовательность. Можно по-прежнему пытаться использовать методы, подходящие

для больших обучающих последовательностей. Но этот шаг может

привести к чрезмерной подгонке и порождению смещённых оценок параметров.

К счастью, такое смещение может быть до некоторой степени устранено;

модель может обобщаться по мере того, как обучающая последовательность

приращается искусственно вводимыми наблюдениями, или

псевдоотсчётами.

Включённые в эту главу задачи предназначены для того, чтобы

предоставить читателю практику применения понятий безусловной и условной

вероятностей, теоремы Байеса, наибольшего правдоподобия и Байесовой

оценки параметров. Необходимые определения этих понятий и концепций,

часто встречающихся в «АБП», могут быть найдены в учебниках по теории

вероятностей и математической статистике для студентов (например, [195],

[175], [120], [44] и [121]).

1.1. Оригинальные задачи

Задача 1.1. Рассмотрите принцип работы эпизодически нечестного

казино, в котором используют два вида игральных костей. Из всех

костей 99 % правильные, но 1 % смещён так, чтобы в 50 % бросаний

выпадала шестёрка. Мы берём игральную кость со стола наугад.

Чему равны Р(шестёрка | Дмещ.) и Р(шестёрка \Ощт)1 Каковы вероятности

Р(шестёрка, Дмещ.) и Р(шестёрка, Д^ав.)? Какова вероятность выпадения

шестёрки на взятой нами наугад кости?

Решение. Все возможные исходы бросания правильной игральной кости

равновероятны, то есть Р(шестёрка lA^an.) = 1/6. С другой стороны,

вероятность выпадения шестёрки на смещённой кости, Р(шестёрка |Дмещ.),

равна 1/2. Для того чтобы вычислить вероятность совместного наступления

событий (шестёрка, Дмещ.) — выпадения шестёрки и выбора смещённой

кости, — мы воспользуемся определением условной вероятности:

Р(шестёрка, £>смещ.) = Р(Лсмещ.)Р(шестёрка | £>смещ.). (1.1)

1.1. Оригинальные задачи 19

Поскольку вероятность выбора смещённой кости равна 1/100, равен-

i'tho (1.1) даёт:

Р(шесгёрка,Ясмещ.) = i5o • | = абб-

Исходя из подобных рассуждений, имеем

/'(шестерка, Дфав.) = Р(шестёрка|ЛПрав.)Р(Лправ.) = - • — = —.

I вероятность выпадения шестёрки на взятой наугад игральной кости вычис-

имстся как полная вероятность события «шестёрка», произошедшего

совместно либо с событием Dcuem., либо с событием Дправ.:

/'(шестёрка) = Р(шестёрка, £>смещ.) + ^(шестёрка, Дфав.) = tjqq = щ)"

П

Задача 1.2. Сколько шестёрок подряд должно выпасть в игре по условию

in дачи 1.1, прежде чем станет более вероятным то, что мы выбрали (и

бросаем) именно смещённую кость?

Решение. Для того чтобы определить условную вероятность выбора

смещённой кости при условии, что подряд выпало п шестёрок —

^(Ошещ]п шестёрок), — достаточно воспользоваться теоремой Байеса:

ryfrk , .. v Р(П ШеСТёрОК |Дшещ.)^(А>мещ.)

P(Dcuan.\n шестерок) = — - =

Р(п шестерок)

_ Р(п ШеСТёрОК | Д;мещ.)^(А;мещ.)

Р(п ШеСТёрОК |^смещ.)^(^смещ.) + Р(пшеСТёрОК |AipaB.)^(AipaB.)

Ьросания как правильных, так и смещённых костей независимы, поэтому

(1/100)•(1/2)п

P(DCUGBl]n шестёрок) =

(99/100)•(1/6)п +(1/100)•(1/2)п

1

11 • (1/3)п~2 + 1

' )гот результат заказывает на то, что вероятность Р (ДшещJ n шестёрок)

приближается к единице по мере того, как п (длина наблюдаемой

последовательности шестёрок) возрастает. Неравенство

Р{Р>с^щ\п шестёрок) > 1/2

20 Глава 1

показывает, что более вероятно то, что нами была выбрана именно

смещённая кость. Это неравенство верно, когда

п-2

п ^ 5.

/ \ TI — Z

Поэтому появление пяти и более шестёрок подряд указывает на то, что

более вероятным является выбор смещённой кости. □

Задача 1.3. С помощью определения условной вероятности докажите

следующую теорему Байеса:

P{X)P{Y\X)

P{X\Y)

P(Y)

Решение. Для любых двух событий X и У, таких что P(Y) > 0, условная

вероятность наступления события X при наступлении события Y

определяется выражением вида

Р(Х П Y)

P(X\Y) =

P(Y)

Применяя это определение еще раз, чтобы подставить P(X)P(Y\X) на

место Р(Х П У), мы получаем уравнение

которое эквивалентно теореме Байеса. □

Задача 1.4. Обнаружена редкая генетическая болезнь. Хотя известно, что

её носителем является лишь один человек из миллиона, вы раздумываете о

том, стоит ли пройти проверку. Вам сказали, что генетический анализ

чрезвычайно надёжен: он обладает 100 %-й чувствительностью (всегда верен,

если вы больны) и 99,99 %-й специфичностью (даёт ложный

положительный результат только в 0,01 % случаев). С помощью теоремы Байеса

объясните причину, по которой вы можете отказаться от такого исследования.

Решение. До прохождения проверки вероятность P(D) того, что вы

являетесь носителем этой генетической болезни, равна 10_6, а вероятность Р(Н)

того, что вы здоровы, составляет 1 — 10~6. Насколько такая проверка

изменит сию неопределённость? Рассмотрим два возможных исхода.

1.1. Оригинальные задачи

21

Если проверка дала положительный результат, то Баиесовы

апостериорные вероятности наличия и отсутствия болезни, соответственно,

следующие:

P(non.\D)P(D)

Р(£>|пол.)

Р(пол.)

P{non.\D)P{D)

P(uoji.\D)P(D) + Р(пол.|Я)Р(Я)

10"6

10-6 + 0,999999-10-4

= 0,0099,

Р(Я|пол.) = Р<^;'Н>^Я> =0,9901.

v ' ' Р(пол.)

Если же результат проверки отрицательный, то Баиесовы апостериорные

вероятности принимают значения

P{oTp.\D)P{D)

Р(Б\отр.) =

Р(отр.)

Р(отр.|£>)Р(£>)

P(<yrp.\D)P(D) + Р(отр.|Я)Р(Я)

= 0 = 0

0 + 0,9999-(1-Ю-6)

Таким образом, значения априорных вероятностей P(D) и Р(Н) измени-

иись весьма незначительно:

\P(D) - P(D\non.)\ = 0,0099, \P(D) - P(D\vrp.)\ = Ю"6,

\Р(Н) - Р(#|пол.)| = 0,0099, \Р(Н) - Р(#|отр.)| = 10"6.

Мы видим, что даже при положительном результате исследования

вероятность наличия болезни изменяется с 10_6 до Ю-2. Таким образом,

проходить эту проверку не стоит ввиду её нецелесообразности. □

1идача 1.5. Нам нужно проверить игральную кость, которая, предположи-

к'ш.ио, смещена некоторым образом. Мы бросаем эту кость десять раз

подряд и наблюдаем исходы: 1, 3, 4, 2, 4, 6, 2, 1, 2 и 2. Какова полученная

22

Глава 1

нами методом наибольшего правдоподобия оценка вероятности выпадения

двух очков р2? Какова будет Байесова оценка, если мы добавим по

одному псевдоотсчёту на категорию? Что изменится, если мы добавим по пять

псевдоотсчётов на категорию?

Решение. Полученная методом наибольшего правдоподобия оценка

вероятности р2 есть (относительная) частота исхода «два», таким образом, р2 =

= 4/10 = 2/5. Если добавлено по одному псевдоотсчёту на категорию, то

Байесова оценка равна р2 = 5/16. Если мы добавляем по пять

псевдоотсчётов на категорию, то р2 = 9/40. В последнем случае Байесова

оценка р2 лучше приближается к вероятности события «два» после бросания

правильной игральной кости — р2 = 1/6.1

В любом случае обоснованность этих альтернативных подходов трудно

оценить без дополнительной информации. Наилучший способ улучшить

оценку — собрать больше данных. □

1.2. Дополнительные задачи

Следующие задачи, написанию которых послужила причиной

необходимость разобрать некоторые вопросы, возникающие при анализе

биологических последовательностей, требуют умения применять формулы из

комбинаторики (задачи 1.6, 1.7, 1.9 и 1.10), элементарного вычисления

вероятностей (задачи 1.8 и 1.16), а также знания свойств случайных величин

(задачи 1.13 и 1.18). Наша цель здесь состоит в том, чтобы помочь

читателю распознавать вероятностный характер этих (и подобных им) задач с

биологическими последовательностями.

В этом разделе для описания свойств последовательностей ДНК

применяются основные распределения вероятностей: геометрическое

распределение — для описания распределения длин фрагментов рестрикции

(задача 1.12) и открытых рамок считывания (задача 1.14); распределение

Пуассона — как хорошее приближение для числа появлений олигонуклеотидов

в последовательностях ДНК (задачи 1.11, 1.17, 1.19 и 1.22). Мы будем

использовать понятие «модели независимого порождения», представляющей

собой последовательность независимых одинаково распределённых (н. о. р)

случайных величин со значениями, взятыми из такого конечного

алфавита Л (то есть, алфавита нуклеотидов или аминокислот), что вероятность

Нетрудно догадаться, [что] если мы добавим по 1000 псевдоотсчетов, то получим значение

совсем близкое к 1/6. Надо (важно!) понимать, что добавляя равномерные псевдоотсчеты, мы

используем наше априорное представление о правильности кости. Добавив очень большое

количество псевдоотсчетов, мы тем самым игнорируем результаты опыта. — Прим. ред.

1.2. Дополнительные задачи

23

появления символа а в любом участке последовательности равна qa и при

этом J2 Qa = 1. Таким образом, фрагмент последовательности ДНК или

а€А

белка, #1,..., #п, порождённый моделью независимого порождения, имеет

п

вероятность Yl Qxi- Следует иметь в виду, что в тексте «АБП» [67] та же

г=1

модель названа моделью случайной последовательности. Модель

независимого порождения используется для описания последовательностей ДНК

в задачах 1.12, 1.14, 1.16 и 1.17.2

Вводный уровень главы 1 всё же позволяет нам оперировать с

понятием проверки гипотез. В задаче 1.20 такая проверка помогает опознать

CpG-островки в последовательности ДНК, тогда как в задаче 1.21 мы

рассматриваем критерий для проведения различия между областями

последовательности ДНК с более и менее высоким содержанием G + C.

Наконец, в задачах 1.16, 1.18 и 1.19 рассматриваются вопросы

сравнения вероятностных моделей.

Задача 1.6. В геноме вируса герпеса нуклеотиды С, G, А и Т встречаются

с частотами, соответственно, 35/100, 35/100, 15/100 и 15/100. При

допущении о модели независимого порождения для этого генома определите, чему

равна вероятность того, что случайно выбранный фрагмент ДНК длины 15

и. н. содержит восемь нуклеотидов С или G и семь нуклеотидов А или Т?

Решение. При заданных частотах появления нуклеотидов из группы С и G

и АиТ, равных, соответственно, 0,7 и 0,3, вероятность того, что во

фрагменте длины 15 п. н. находится восемь нуклеотидов С или G и семь

нуклеотидов А или Т, равна 0,78 • 0,37 = 0,0000126. Это число должно быть

умножено на (х85) = 15!/8!7! — число возможных взаимных расположений

представителей этих групп нуклеотидов среди пятнадцати нуклеотидных

позиций. Таким образом, мы получаем вероятность, равную 0,08. □

1идача 1.7. Затравка ДНК, используемая в полимеразной цепной реакции,

представляет собой фрагмент однонитевой ДНК, предназначенный для

связывания (гибридизации) с одной из нитей молекулы целевой ДНК. Бы-

||о замечено, что затравки могут гибридизироваться не только со своими

; Такие случайные последовательности называются в математической литературе

последом"» ельностями независимых одинаково распределенных случайных величин. Бернуллиевы

последовательности — это их частный случай (когда каждая случайная величина принима-

II ронно два значения). Очевидно, Бернуллиева последовательность не может быть моделью

пиоиогических последовательностей, изучаемых в этой книге, поскольку число значений слу-

•И1Й111.1Х величин равно либо 4, либо 20. — Прим. ред.

24

Глава 1

абсолютными комплементами, но также и с фрагментами ДНК такой же

длины, имеющими один или два нуклеотида, не дающих совпадение. Если

геномная ДНК будет «достаточно длинной», то сколько различных

последовательностей ДНК могут связаться с затравкой длины восемь нуклеотидов?

Понятие «достаточной длины» подразумевает, что в целевой геномной ДНК

присутствуют все возможные олигонуклеотиды длины 8 н.

Решение. Мы рассматриваем более общую ситуацию, где длина

затравки равна п. Есть три возможных случая гибридизации между затравкой

и ДНК: без несовпадения, с одним несовпадением и с двумя

несовпадениями. Очевидно, что в первом случае опознаётся только одна

последовательность ДНК, в точности комплементарная затравке. Второй случай

(одно несовпадение) со свободой выбора одного из трёх типов

несовпадающих нуклеотидов в одной позиции комплементарной

последовательности даёт Зп возможных последовательностей. Наконец, число сочетаний

двух позиций, содержащих несовпадающие с затравкой нуклеотиды,

равно п(п — 1)/2. Каждое сочетание этих двух позиций даёт девять

возможностей выбора двух нуклеотидов, не дающих совпадения. Таким образом,

общее число возможных последовательностей с двумя несовпадениями

составляет 9п(п — 1)/2. Следовательно, при п = 8 существует

1 + 3 • 8 + ^|^ = 277

различных последовательностей, способных гибридизироваться с данной

затравкой. □

Задача 1.8. Реакция секвенирования ДНК выполнена с коэффициентом

ошибок 10 %; таким образом, вероятность неправильного опознавания

данного нуклеотида равна 0,1. Для того чтобы минимизировать частоту

появления ошибок, ДНК секвенируют п = 3 независимыми реакциями, затем

расшифрованные фрагменты выравнивают, после чего нуклеотиды

опознают в соответствии со следующим правилом большинства. Тип нуклеотида

в конкретной позиции опознаётся как а, где a G {Т, С, A, G}, если в этой

позиции выровнено больше нуклеотидов типа а, чем всех остальных типов

вместе взятых. Если в позиции выравнивания никакой тип нуклеотида не

появляется более п/2 раз, то тип нуклеотида не опознаётся (тип N).

Каков ожидаемый процент а) правильно и б) неправильно опознанных

нуклеотидов? в) Какова вероятность того, что в конкретном участке

опознание невозможно? г) Как изменится результат а при п = 5 и при п = 7?

1.2. Дополнительные задачи

25

Сделайте допущение о том, что присутствуют только ошибки типа

замены (нет вставок или удалений) и все замены равновероятны (нет смещения

к какому-либо определённому типу нуклеотида).

Решение, а) В каждой выбранной позиции мы рассматриваем результаты

трёх реакций секвенирования как исходы трех Бернуллиевых испытаний,

где «успех» имеет место в том случае, если нуклеотид опознан правильно

(с вероятностью р = О,9), а «неудача» — в противном случае (с

вероятностью q = О,1). Тогда вероятности следующих событий описываются

биномиальным распределением и могут быть определены непосредственно:

Р3 = Р(«Успех» набл. три раза) = р3 = 0,93 = 0,729 (72,9 %),

Рг = Р(«успех» набл. дважды) = ( )p2q =

= 3-0,92- 0,1 = 0,243 (24,3%).

Согласно правилу большинства, ожидаемый процент Е правильно

опознанных нуклеотидов определяется как

Е£=3 = Р(«успех» набл. по кр. мере дважды) • 100 % =

= (Рз + Р2)' Ю0% = 97,2%.

б) Для того чтобы определить вероятность неправильного

опознания нуклеотида на данном участке, мы должны уметь классифицировать

«неудачи»; таким образом, мы должны обобщить биномиальное

распределение к мультиномиальному. А именно — в каждом независимом

испытании (выполненном на данном участке последовательности) мы можем

иметь «удачу» (с вероятностью р = 0,9) и три других исхода: «неудача 1»,

«неудача 2» и «неудача 3» (с равными вероятностями qi = q2 = Яз = 1/30).

Опознать нуклеотид неправильно означало бы наблюдать по крайней мере

дне «неудачи г», где г = 1,2,3, среди п = 3 испытаний. Поэтому:

Рз = («неудача г» набл. трижды) =

= q* = (1/30)3 = 0,000037 (0,0037 %),

Р£ = Р(«неудача г» набл. дважды) =

= 6 • (1/30)3 + 3 • (1/30)2 • 0,9 = 0,00356 (0,356 %).

26

Глава 1

Наконец, ожидаемый процент неправильно опознанных нуклеотидов

находим из

Е-=3=( ]Г (^ + ^))-100% =

\г=1,2,3 /

= 3(Р^ + Р2')-Ю0% = 1,1%.

в) На всяком отдельно взятом участке обращение к основаниям

дает в результате три взаимно исключающих события: «правильное

опознание», «неправильное опознание» или «опознание невозможно». Тогда

вероятность последнего исхода определяется как

Р (ГбТопознГ) - 1 - (рз + Рг) - т + Н) = 0,0172 (1,72 %).

г) Для того чтобы вычислить ожидаемый процент Е£ правильно

опознанных нуклеотидов при п = 5 и п = 7, мы применяем те же самые

соображения, что и в пункте а, разве только вместо трёх мы рассматриваем,

соответственно, пять и семь Бернуллиевых испытаний. Мы находим:

Е£=5 = Р(по кр. мере 3 «успехов» среди пяти исп.) • 100 % =

= рь + 5 • 0,94 ■ 0,1 + 10 • 0,93 - 0,12 = 99,14 %.

Точно так же

Е£=7 = Р(по кр. мере 4 «успеха» среди семи исп.) • 100 % =

= 99,73 %.

Как и следовало ожидать, увеличение числа независимых реакций

улучшает качество секвенирования. □

Задача 1.9. В силу избыточности генетического кода, последовательность

аминокислот может быть кодируема несколькими последовательностями

ДНК. Каковы нижний и верхний пределы числа возможных

последовательностей ДНК, которые могли бы содержать код для заданного белкового

фрагмента длины десять аминокислот?

Решение. Если все десять аминокислот были бы представлены метиони-

ном или триптофаном (аминокислотами, кодируемыми единственными ко-

донами), то мог бы быть достигнут нижний предел, равный единице. В этом

1.2. Дополнительные задачи

27

случае последовательность аминокислот уникально определяет

кодирующую её последовательность нуклеотидов. Верхний предел был бы

достигнут, если последовательность аминокислот состояла бы из лейцина,

аргинина или серина — аминокислот, кодируемых шестью колонами каждая.

11оследовательность длины десять аминокислот, состоящая из Ьещ Ser или

Arg (в любом взаимном расположении) может быть закодирована б10 =

60 466176 различными последовательностями нуклеотидов. □

Задача 1.10. Было обнаружено, что формы жизни с планеты XYZ имеют

и основе своей ДНК и белки, причём белки состоят из двадцати

аминокислот. В ходе анализа состава белка было определено, что средние частоты

появления всех аминокислот, исключая Met и Тгр, равны 1/19, тогда как

частоты Met и Тгр равны 1/38. Принимая во внимание высокую темпера-

iypy на поверхности планеты XYZ, было высказано предположение, что

ДНК имеет чрезвычайно высокое содержание G + С. Каково наиболее

высокое возможное среднее содержание G + С в кодирующих белок областях

(при соответствии указанному выше среднему аминокислотному составу),

если для кодирования белков форм жизни с планеты XYZ используется

стандартный (такой же, что и на планете Земля) генетический код?

Таблица 1.1. Максимальное число 1а нуклеотидов С и G, которые

появляются (присутствуют) в одном из синонимичных кодонов, кодирующих

аминокислоту а

1а

1

2

3

Asn,

Asp, Cys, Gin,

Аминокислота а

lie, Lys, Met, Phe,

Glu, His, Leu, Ser,

Ala, Arg, Gly, Pro

Tyr

Thr, TYp,

Val

Решение. Для того чтобы обеспечить возможно большее содержание

нуклеотидов G + Св кодирующей белок области, которое удовлетворяло бы

ограничениям на аминокислотный состав, во всех случаях должны быть

использованы синонимичные кодоны с самым высоким содержанием G + C.

Согласное со стандартным генетическим кодом распределение кодонов с

имсоким содержанием G + С приведено в таблице 1.1 (где 1а обозначает

28

Глава 1

наибольшее число нуклеотидов С и G в кодоне, кодирующем

аминокислоту а).

Поэтому среднее арифметическое содержания G -\- С в кодирующей

белок области определяется как

(G

Здесь /а — частота появления аминокислоты а.

Замечание. Исходя из подобных соображений можно получить

оценки верхнего и нижнего пределов содержания G + С в геномах прокариотов

(планета Земля), где кодирующие белок области, как правило, занимают

приблизительно 90 % от всей длины ДНК. □

Задача 1.11. Фермент рестрикции разрезает ДНК на палиндромном3

участке длины 6 п. н. Определите вероятность того, что кольцевая хромосома —

двунитевая молекула ДНК длины L = 84 000 п. н. — будет разрезана

ферментом рестрикции ровно на двадцать фрагментов. Сделайте допущение

о том, что последовательность ДНК описывается моделью независимого

порождения с равными вероятностями появления нуклеотидов Т, С, А и G.

Подсказка: используйте распределение Пуассона.

Решение. Вероятность того, что участок рестрикции начинается в той

или иной выбранной позиции последовательности ДНК, составляет р =

= (1/4)6 = 0,0002441. Если мы не принимаем во внимание взаимную

зависимость появлений участков рестрикции в позициях г и j, где \i — j\ ^ 6,

то число X участков рестрикции в последовательности ДНК можно

рассматривать как число успехов (с вероятностью р) в последовательности L

Бернуллиевых испытаний; поэтому число X имеет биномиальное

распределение с параметрами р и L. Поскольку L велико, а р мало, мы можем

использовать распределение Пуассона с параметром А = pL = 20,5 в

качестве приближения биномиального распределения. Тогда

Р(Х = 20) = е"А^ = 0,088.

Примечательно, что вероятность разрезания этой же последовательности

ДНК на любое другое заданное число фрагментов будет ниже, чем Р(Х =

= 20). Действительно, отношение Rk вероятностей двух последовательных

3Палиндромом в ДНК называется самокоплиментарная последовательность, например

GAGCTC. - Прим. ред.

1.2. Дополнительные задачи 29

значений величины X,

Р(Х = к + 1) х

Rk =

Р(Х = к) к + 1'

показывает, что Р(Х = к) возрастает по мере того, как к растёт от 0 до Л,

и убывает по мере того, как к растёт от Л до L, и, таким образом, достигает

своего максимального значения в точке к = А. Другими словами, если А

не целое число, то наиболее вероятное значение случайной переменной с

распределением Пуассона равно [А], где [А] обозначает наибольшее целое

число, не превышающее А. В противном случае наиболее вероятные

значения равны А — 1 и А. □

Задача 1.12. Определите среднюю длину фрагментов рестрикции,

получаемых при действии 6-рестриктазы Smal с участком рестрикции CCCGGG.

Рассмотрите а) геном с содержанием G + С, равным 70 %, и 6) геном с

содержанием G + С 30 %. Сделано допущение, что геномная

последовательность может быть представлена моделью независимого порождения со

следующими вероятностями нуклеотидов: qc = qc и qA = Qt- Учтите, что

фермент Smal разрезает двойную нить ДНК в середине участка CCCGGG.

Решение. Обозначим вероятность того, что участок рестрикции

начинается в конкретной позиции последовательности буквой Р, а длину фрагмента

рестрикции — буквой £. Если в некоторой позиции последовательности

начинается участок рестрикции, мы соотносим с ней число 1, в противном

случае — число 0. Тогда в полученной последовательности единиц и нулей

длины отрезков из нулей (равные длинам фрагментов рестрикции) можно

рассматривать как значения случайной переменной L. Если мы не

принимаем во внимание взаимную зависимость появлений участков рестрикции

в позициях г и j, где \г — j\ ^ 6, то случайная переменная L имеет

геометрическое распределение: P(L = п) = (1 — Р)п~1Р. Ожидаемое значение L

определяется как

71=1 П=1

30 Глава 1

d(J:(i-p)n)

dP Р2 р'

Для случая а мы имеем

Ра = P{CCCGGG) = (0,35)6 = 1,8- НГ3,

и средняя длина фрагмента рестрикции составляет ELa = 1/Pa = 544 п. н.

Точно так же, в случае б

Рь = P(CCCGGG) = (0,15)6 = 1,14 • 1СГ5,

и средняя длина фрагмента рестрикции составляет EL& = 87788 п. н. В

случае б вполне могла ожидаться большая средняя длина фрагментов

рестрикции, поскольку богатый G + С участок рестрикции CCCGGG появлялся

бы менее часто в богатой А + Т геномной ДНК. □

Задача 1.13. Рассмотрите последовательность ДНК длины п,

описываемую моделью независимого порождения с равными вероятностями

появления нуклеотидов. Пусть X — число появлений динуклеотида АА, &Y —

число появлений динуклеотида AT в этой последовательности. Каковы

значения математического ожидания и дисперсии случайных переменных X и

У? Для простоты рассмотрите кольцевую ДНК длины п.

Решение. Определим случайные переменные Xiuyi, где г = 1,..., п,

следующим образом:

_ J , если динуклеотид АА нач-ся в г-й позиции посл-ти,

иначе;

С:

-и

если динуклеотид AT нач-ся в г-й позиции посл-ти,

иначе.

п п

Очевидно, что X = ^ жь а ^ = *52Уг- Согласно однородной моде-

г=1 г=1

ли независимого порождения, математические ожидания Xi и у*, где г =

= 1,..., п, определяются как

EXi = Ejfc = P(Xi = 1) = Р(Уг = 1)

W 16-

1.2. Дополнительные задачи 31

Таким образом, среднее арифметическое величин X и Y равно ЕХ =

= ЕУ = п/16. Точно так же мы можем утверждать, что ожидаемое число

появлений любого другого динуклеотида в последовательности также

равно п/16.

Мы обозначаем кратчайшее расстояние между позициями г и j в

кольцевой ДНК через r(i,j) и находим второй момент величины X:

ex2 = e(J>J =

п

= 5^ Ear? + $3 E*iSj+ $3 Ея*^- О-2)

г=1 i,j:r(i,j)^2 itj:r(i,j)=l

п

Поскольку х\ — хи постольку первая сумма в уравнении (1.2) равна ^2 =

i=i

= Еж? = nExi = п/16.

Если расстояние r(i,j) ^ 2, то случайные переменные Xi и а^

независимы и

53 Ея*с,-= 53 ^^^ = П 256

Если г (г, j) = 1, то позиции г и j смежные и, для определённости, мы

делаем допущение о том, что позиция г предшествует позиции j. Тогда

произведение x%Xj принимает следующие значения:

X<lXj —

1, если триплет AAA начинается в позиции г,

О, иначе

и "ExiXj = P(x{Xj = 1) = (1/4)3 = 1/64. Поэтому второй момент

величины X принимает вид

FY2 = !L + n(n ~ 3) . 2n n(n +21)

16 + 256 ^ 64 256 '

и дисперсия величины X определяется из

32

Глава 1

Точно так же второй момент величины Y мы находим из:

ЕУ2 = Е(£>) =Х>уг2+ £ Eyiyj+ £ Еад. (1.3)

\г=1 / г=1 i,j:r(i,j)^2 ij'-r(i,j)=l

Первые две суммы в уравнении (1.3) те же, что и в уравнении (1.2).

Однако, если г (г, j) — 1, то произведение yiyj всегда равно нулю, потому что

динуклеотид AT не может начинаться в двух смежных позициях г и j этой

последовательности. Поэтому

т^2 П , П(П-З) П(П+ 13)

16 ' 256 256

^у-ЕГ.-даТ-!^-^.

13п

256

Мы видим, что дисперсия числа появлений всякого динуклеотида зависит

от его структуры: если он состоит из разных букв (и, таким образом, не

может перекрываться с соседом того же самого вида), то дисперсия равна

13п/256; если же динуклеотид состоит из одинаковых букв (и, значит,

может перекрываться с соседом того же самого вида), то дисперсия возрастает

до 21п/256.

Замечание. Более подробное рассмотрение первого и второго

моментов частот слов в биологических последовательностях может быть найдено

в [216]. □

Задача 1.14. Кодирующий белок ген прокариота обычно состоит из

непрерывной последовательности нуклеотидных триплетов, или кодонов. Такая

последовательность начинается с определённого старт-кодона (чаще всего,

ATG) и заканчивается одним из трёх стоп-кодонов: ТАЛ, TAG или TGA.

Последовательность с такой структурой называют «открытой рамкой

считывания» (ОРС). Однако не каждая ОРС, встречающаяся в геномной ДНК

прокариотов, является функциональным геном. При допущении о том, что

триплет ATG является единственным возможным старт-кодоном,

определите, каково распределение длин случайно наблюдаемых ОРС?

Рассмотрите модель независимого порождения с равными вероятностями появления

нуклеотидов четырёх типов.

1.2. Дополнительные задачи 33

Решение. Существует 43 = 64 триплета (кодона), которые появляются в

последовательности с равными вероятностями. Три из этих шестидесяти

четырех суть стоп-кодоны. Поэтому вероятность встретить стоп-кодон при

просмотре последовательности триплет за триплетом равна 3/64 = 0,047.

Вероятность появления ОРС длины L (в кодонах) определяется из

Р(ОРС длины L начинается в данной позиции) =

= P(ATG) • Р(не CTon-KOflOH)L~2 • Р(стоп-кодон) =

= J_ Л aV"2 3 = 3 /61

64 V 64 у 64 4096 V64

Чтобы вывести функцию распределения длин ОРС, мы используем

определение условной вероятности:

Р(длина ОРС равна L) =

_ Р(ОРС длины L начинается в данной позиции) _

Р(любая ОРС начинается в данной позиции)

Р(ОРС длины L начинается в данной позиции)

~~ +оо ""

Y^, Р(ОРС длины L начинается в данной позиции)

L=2

= (3/4096)(61/64)L-2 = _3_ /61

1/64 64 \64

Таким образом, мы получили геометрическое распределение длин

случайных ОРС наряду с параметрами этого распределения. □

Задача 1.15. При допущении о том, что некодирующая ДНК описана

моделью независимого порождения с вероятностями нуклеотидов, равными 1/4,

покажите, что в 75 % случаев можно ожидать, что начало гена (допуская,

что единственный старт-кодон представлен кодоном ATG) совпадёт с

началом «длиннейшей ОРС».

Решение. Примем допущение о том, что определённый кодон ATG есть

действительное начало гена, не перекрываемое смежным геном. Тогда

последовательность ДНК, расположенная выше данного кодона ATG,

представляет собой некодирующую ДНК, описываемую моделью независимого

\ LJ — A

34

Глава 1

порождения. Каждый возможный триплет появляется в описываемой этой

моделью последовательности с вероятностью 1/64. Для того чтобы

найти вероятность того, что данный кодон ATG, расположенный в

действительном начале гена, является ближайшим к 5'-концу ATG в ОРС, мы

рассмотрим дополняющее событие, состоящее в том, что выше

действительного начала существует ещё один кодон ATG, в котором начиналась

бы ещё более длинная ОРС. Путём изучения неперекрывающихся

триплетов, расположенных выше от данного кодона ATG, по одному за раз, и

начиная с непосредственно примыкающего к ATG, мы наблюдаем один из

следующих возможных исходов. 1) Выбранный триплет — один из

шестидесяти кодонов, в число которых не входят триплеты ATG, TAA, TGA и

TAG. В этом случае мы продолжаем процесс изучения триплетов. 2) Этот

триплет — один из трёх стоп-кодонов (ТАА, TGA и TAG). Мы

останавливаемся и делаем вывод, что первоначально рассмотренный кодон ATG

является крайним левым триплетом ATG в ОРС. 3) Изучаемый триплет —

ATG. Мы останавливаемся и заключаем, что первоначально

рассматриваемое действительное начало гена не является крайним левым триплетом

ATG в ОРС. Вполне очевидно, что завершение процедуры просмотра при

достижении одного из стоп-кодонов будет происходить в три раза чаще,

чем завершение по достижении кодона ATG. Поэтому в 75 % случаев

начало действительного гена в кодоне ATG совпадает с крайним левым ATG

в ОРС, что указывает на длиннейшую ОРС при заданном стоп-кодоне на

3'-конце. □

Задача 1.16. Предположим, что мы рассматриваем две модели

независимого порождения, описывающие последовательности нуклеотидов. Первая

модель, М\, имеет те же самые вероятности появления нуклеотидов, что

и в задаче 1.6. Вторая модель, Мч, приписывает каждому типу нуклеоти-

да вероятность появления в любой позиции, равную 1/4. При наблюдении

последовательности х = ACTGACGACTGAC сравните правдоподобия

этих моделей.

Решение. Правдоподобие некоторой модели определяется как условная

вероятность данных (последовательность х) для заданной модели ([67],

стр. 6). Таким образом, мы должны сравнить вероятности

последовательности х в каждой модели. Правдоподобие модели М\ определяется как

1.2. Дополнительные задачи

35

Точно так же правдоподобие модели М% описывается выражением

Р{х\М<2) = (1/4)13. Отношение правдоподобия определяется как

Р(х\М2) _ 2013 2 озээ, !

Р{х\М,) -413-36-77" '

11оэтому для наблюдаемой последовательности х модель М^ имеет

большее правдоподобие, чем модель М\. □

Задача 1.17. Кольцевая двунитевая ДНК длины L = 3400 п. н. была разре-

чана ферментом рестрикции. Последующее разделение посредством гель-

электрофореза указало на присутствие пяти фрагментов ДНК. Оказалось,

что рассеянный исследователь не мог вспомнить точный тип фермента

рестрикции, который был использован. Однако он знал, что химикат был взят

из коробки, содержащей равное число 4-рестриктаз 6-рестриктаз

(ферменты рестрикции, которые узнают (и разрезают в них), соответственно,

определённые участки длины 4 п.н. и определённые участки длины 6 п.н.).

Какова апостериорная вероятность того, то была использована именно 4-

рестриктаза, если последовательность ДНК может быть представлена

моделью независимого порождения с равными вероятностями появления нук-

леотидов Т,С, А и G.

Решение. Вероятность появления участка рестрикции в некоторой

рассматриваемой позиции последовательности ДНК равна р\ = (1/4)4 =

= 0,003906 для 4-рестриктазы и р2 = (1/4)6 = 0,000244 для

6-рестриктазы.

Мы делаем допущение о том, что в обоих случаях число X участков

рестрикции в последовательности может быть приближено распределением

Пуассона с параметром Ai = piL = 13,28 для 4-рестриктазы и А2 = P2L =

= 0,83 для 6-рестриктазы (см. решение задачи 1.11). Тогда мы получаем

(Хл)5

Р(Х = 5|4-рестриктазы) = e"Al^- = 0,00588,

5!

Р(Х = 516-рестриктазы) = е-*2^—f- = 0,00143.

о!

Для вычисления апостериорной вероятности того, что фрагменты

рестрикции были получены 4-рестриктазой, мы используем теорему Байеса:

Р(4-рестриктазы|Л' = 5) =

36

Глава 1

Р(Х = 5|4-рестриктазы)Р(4-рестриктазы)

Р(Х = 5|4-рест-зы)Р(4-рест-зы) + Р(Х = 5|6-рест-зы)Р(6-рест-зы)

0,00588-0,5

0,00588-0,5 4-0,00143-0,5

0,804.

Поскольку шанс того, что была использована 4-рестриктаза, составляет

80,4 %, первоначальная неопределённость, кажется, устранена. □

Задача 1.18. Приверженцы одной теории заявляют, что последний общий

предок птиц и крокодилов жил 120 миллионов лет назад (млнл.н.), тогда

как последователи другой теории полагают, что это время вдвое больше.

Сравнение гомологичных генов х1 и х2 двух видов, нильского крокодила и

средиземноморской чайки, показало в среднем 365 различий во фрагменте

длины 1000 п. н. Принято допущение о том, что мутации на различных

участках ДНК происходят независимо и в каждом участке число мутаций,

закрепившихся в ходе эволюции, приближается пуассоновским процессом.

Частота р закрепления мутаций на нуклеотидный участок в год равна Ю-9.

Для заданного наблюдаемого числа различий а) сравните правдоподобия

этих двух теорий и б) методом наибольшего правдоподобия определите

оценку времени расхождения. Для простоты сделайте допущение о том,

что за всю последовательность поколений на любом данном нуклеотидном

участке могло произойти не более одной мутации.

Ai(0)=JVi(0)=0

W)

N2(t)

Рис. 1.1. Простейшее филогенетическое дерево Т с парой гомологичных

генов х1 их2 в качестве его листьев (см. задачу 1.18)

1.2. Дополнительные задачи

37

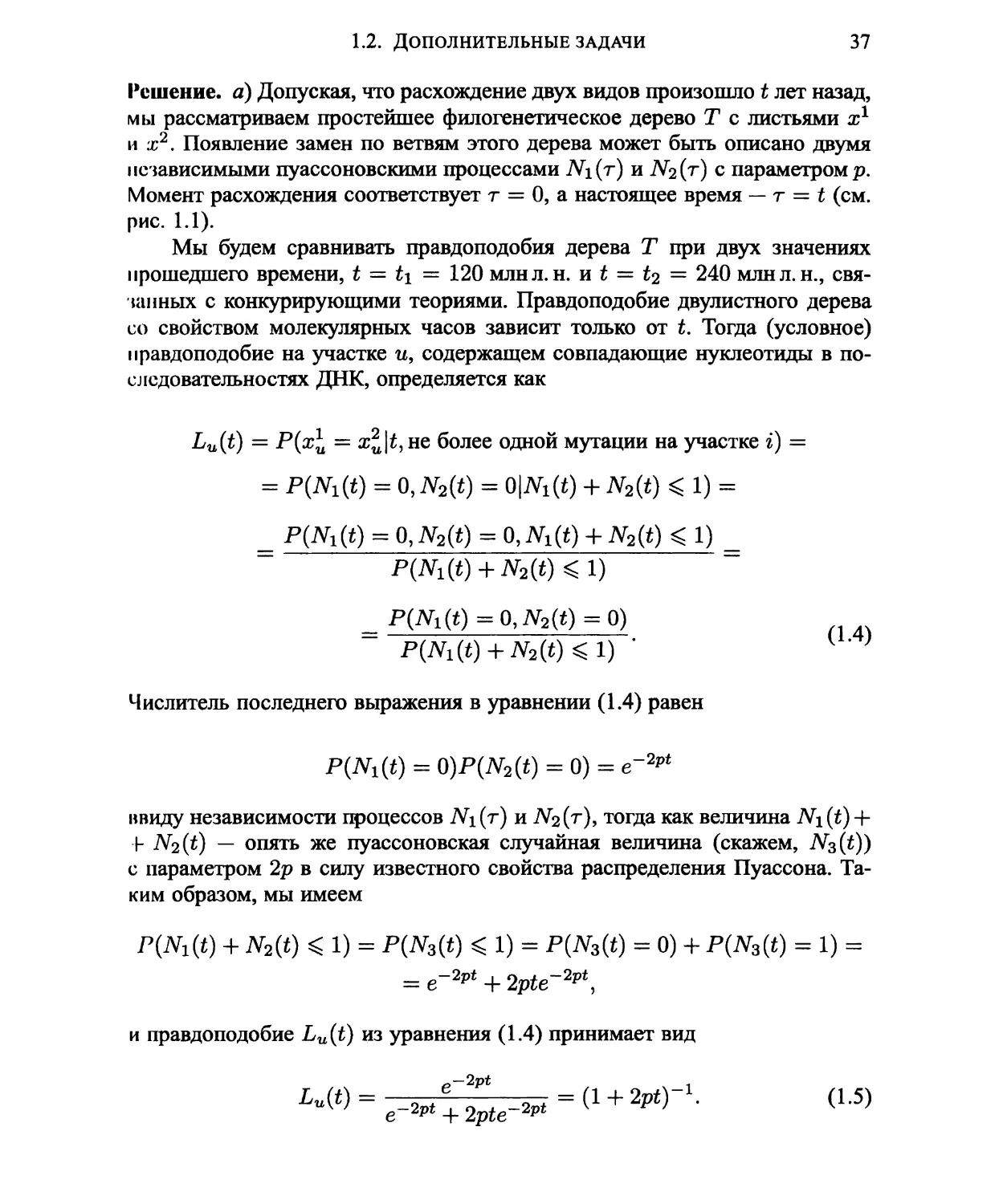

Решение, а) Допуская, что расхождение двух видов произошло t лет назад,

мы рассматриваем простейшее филогенетическое дерево Т с листьями х1

и х2. Появление замен по ветвям этого дерева может быть описано двумя

независимыми пуассоновскими процессами Ni(r) и N2(7-) с параметром р.

Момент расхождения соответствует т = 0, а настоящее время — т = t (см.

рис. 1.1).

Мы будем сравнивать правдоподобия дерева Т при двух значениях

прошедшего времени, t = t\ = 120 млнл.н. и t = t2 = 240 млнл.н.,

связанных с конкурирующими теориями. Правдоподобие двулистного дерева

со свойством молекулярных часов зависит только от t. Тогда (условное)

правдоподобие на участке и, содержащем совпадающие нуклеотиды в

последовательностях ДНК, определяется как

Lu(t) = Р{х„ = х\|£, не более одной мутации на участке г) =

= P(N!(t) = 0,N2(t) = 0|ВД + N2(t) < 1) =

= Р(Мг(1) = 0,N2(t) = 0,iVi(*) + N2(t) < 1) =

P(tfi(t) + l\r2(t)<l)

= P(N1(t)=0,N2(t) = 0)

P(N1(t) + N2(t)^l) '

Числитель последнего выражения в уравнении (1.4) равен

P(iVi(t) = 0)P(N2(t) = 0) = e"2pt

«виду независимости процессов N±(г) и N2(r), тогда как величина JVi(£) +

Ь ЛГгС*) — опять же пуассоновская случайная величина (скажем, iV3(£))

с параметром 2р в силу известного свойства распределения Пуассона.

Таким образом, мы имеем

P(N!(t) + N2(t) < 1) = P(tf3(t) О) = P(N3(t) = 0) + P(W3(t) = 1) =

= e"2pt + 2^e-2pt,

и правдоподобие Lu(£) из уравнения (1.4) принимает вид

(1.4)

38 ГЛАВА 1

Точно так же на участке и с несовпадающими нуклеотидами правдоподобие

определяется как

Lu(t) = Р(х\ ф x^\t, не более одной мутации на участке г) =

= Р(ЗД) = О, N2(t) = l|iVi(t) + N2(t) ^ 1)+

+P(tfi(t) = hN2(t) = 0\N!(t) + N2(t) < 1) =

= 2P(Ni(t)=0)P(N2(t) = l) =

P(^i(*) + JV2(t)<l)

- 2е"Р^е"Р* - 2pt(l + 2P*)-1. (1.6)

-2p* i Oritp-lpt

e-?pt + 2p£e

Из уравнений (1.5) и (1.6) мы выводим правдоподобие дерева Т с двумя

листьями, которые представляют геномные последовательности длины N,

выровненные между собой с М несовпадениями:

N

L(t) = Д Lu{t) = (1 + 2pt)-N(2pt)M. (1.7)

Для проверки этих двух теорий мы вычисляем логарифмическое отношение

шансов при t\ = 120 млн л. н. и t2 = 240 млн л. н.:

In ^р( = Nln(l + 2P*2) - iVln(l + 2ph) + Mln(2p*i) - Af ln(2p*2) =

L(t2)

= -252,99<0.

Поэтому имеющиеся данные поддерживают теорию, что птицы и

крокодилы разошлись 240 млнл.н., так как эта теория имеет большее (условное)

правдоподобие, чем конкурирующая с ней.

6) Мы определяем методом наибольшего правдоподобия оценку t*

времени расхождения этих двух видов как точку максимума логарифма

правдоподобия L(t), формула (1.7):

dlnLjt) _ 2Np 2pM

It ~ ~l + 2pt* + 2^*~ ~ '

** = „ ,^ wx = 2>874 *1о8-

2p(N - М)

1.2. Дополнительные задачи 39

Таким образом, t* = 287,4 млнл.н. — время расхождения с наибольшим

правдоподобием, тогда как значение наибольшего правдоподобия per se

определяется как

Lmax = L(t*) = (1 + 2pt*)~N(2pt*)M = Ю-285. п

Задача 1.19. Известно, что у высших эукариотов CpG-островки

относительно богаты динуклеотидами CpG,4 тогда как в остальной части

хромосомы эти динуклеотиды встречаются довольно редко. Принято допущение,

что частота появлений динуклеотидов CpG в GpG-острове может быть

приближена распределением Пуассона с двадцатью пятью

динуклеотидами CpG на фрагмент длины 250 п.н. в среднем, тогда как в остальной

части ДНК это среднее число — десять CpG на 250 п. н. Предложите ал-

тритм типа Байесова для опознавания CpG-островка. Как этот алгоритм

охарактеризует фрагмент ДНК длины 250 п. н., содержащий девятнадцать

динуклеотидов CpG?

Решение. Мы делаем допущение о том, что числа появлений

динуклеотидов CpG и в CpG-островках и в не-СрС-островках описываются

распределением Пуассона (с параметрами, соответственно, Ai = 25 и Аг = 10).

Если данный фрагмент ДНК длины 250 п. н. содержит п

динуклеотидов CpG, то насколько правдоподобна гипотеза о том, что этот фрагмент

ДНК принадлежит к CpG-острову? Мы должны сравнить две

апостериорные вероятности: Pi = Р(является GpG-островком при п наблюдаемых

динуклеотидах CpG) и P<i = Р(является He-CpG-островком при п

наблюдаемых динуклеотидах CpG). Допуская, что обе альтернативные гипотезы

(о том, что данный фрагмент является GpG-островком, и о том, что он

является He-GpG-островком) a priori одинаково правдоподобны, мы используем

теорему Байеса, чтобы вычислить Р\ и Рз-

Рх = Р(фр-т ДНК с п CpG имеет распр-е Пуассона с Ai = 25) =

P{nCpG\\1=2b)\

Р(п CpG\X1= 25) \ + Р{п CpG|A2 = 10)i

= 25ne"25

10ne-io + 25ne-25'

4CpG — это CG диноклеотид на одной цепи. Буква р в этом обозначении появилась для

того, чтобы не путать с Уотсон-Криковскими CG-парами, когда нуклеотиды С и G живут на

разных цепях. CpG-островки — это скопление CpG-nap, играющее биологическую (регуля-

торную) роль. — Прим. ред.

40 Глава 1

Выше мы применяли формулу для распределения Пуассона и сокращали

общий множитель п\. Точно так же

Pi = Р(фр-т ДНК с п CpG имеет распр-е Пуассона с \2 = 10) =

P(nCpG\X2 = Ю) i

Р(п CpG\Xi = 26)| + Р(п CpG\X2 = 10)|

_ 10ne~10

10ne-io _|_ 25ne"25

или P2 = 1 — Pi. Простой алгоритм опознавания в случае CpG-островка

работает следующим образом. Для данного фрагмента ДНК длины 250 п. н.

с и наблюдаемыми динуклеотидами CpG вычисляется значение Pi. Если

Pi > 0,5 (Pi > P2), то данный фрагмент ДНК опознаётся как часть CpG-

островка. В противном случае этот фрагмент опознаётся как часть не-GpG-

островка.

При п = 19 мы имеем

(25)19е~25

р. = v ; = и Q2

1 (25)19е"25 + (10)19е"10 ' '

Р2 = 1-Р1 = 0,08,

и мы заключаем, что данный фрагмент ДНК принадлежит к GpG-острову.

П

Задача 1.20. При условиях, оговорённых в задаче 1.19, принято

следующее правило принятия решения: если во фрагменте ДНК длины 250 п. н.

наблюдается более восемнадцати динукеотидов CpG, то он опознаётся как

GpG-островок. Определите частоты ложного положительного и ложного

отрицательного результатов этого метода5.

Решение. Коэффициент ложных положительных результатов (КИПР)

определяется как вероятность того, что правило опознало He-GpG-островок в

качестве GpG-островка. Поскольку число X динуклеотидов CpG в любом

5 Вообще говоря, задача не корректна, поскольку биологический объект CpG-островок

не определен и не показана выборка биологических CpG-островов. Здесь же ложно-

положительно и ложно-отрицательно определяются относительно другого метода

предсказания. — Прим. ред.

1.2. Дополнительные задачи 41

uc-CpG-ocrpoBQ описывается распределением Пуассона с параметром Л =

10, мы имеем

КЛПР = Р(более восемнадцати CpG из 250|не-СрС-островок) =

+оо 18

= Р(Х > 18|А = 10) = ^ Р(Х = п) = 1 - ^Р{Х = п) =

п=19 п=0

= 1_уе-ю!0^ о,007.

71=0

Коэффициент ложных отрицательных результатов (КЛОР)

определяется как вероятность того, что CpG-островок будет опознан как KQ-CpG-

островок. Поскольку число У динуклеотидов CpG в области CpG-островка

имеет распределение Пуассона с параметром А = 25, коэффициент ложных

отрицательных результатов определяется как

КЛОР = Р(не более восемнадцати CpG из 250|Ср6?-островок) =

18

= P(Y ^ 18|А = 25) = ^2 P(Y = *) =

18 П=°

71=0

Обратите внимание, что КИПР < КЛОР. Это означает, что более

правдоподобным будет тот исход, при котором правило классификации решит, что

ДНК Ср(7-островка является не-СрС-островком ДНК, чем

противоположный. □

Задача 1.21. Неоднородная последовательность ДНК, как известно,

содержит как области, богатые по составу С + G, так и области с

несмещённым (однородным) составом нуклеотидов. Мы делаем допущение о том,

что области с высоким содержанием С + G описывает модель

независимого порождения (модель Р) с параметрами рт = 1/8, рс = 3/8, рл = 1/8

и ра = 3/8. Области с однородным составом нуклеотидов описываются

моделью независимого порождения (модель Q) с параметрами qr = 1/4,

qc = 1/4, qa = 1/4 и qo = 1/4. Для заданного фрагмента ДНК X

определяется логарифмическое отношение шансов L = log2[P(X\P)/P(X\Q)],

и если L ^ 0, то фрагмент X классифицируется как фрагмент с высоким

содержанием С + G; если L < 0, то фрагмент X классифицируется как

несмещённый по составу. Определите вероятности ошибки первого рода

42

Глава 1

(коэффициент ложных отрицательных результатов) и ошибки второго рода

(коэффициент ложных положительных результатов) классификации

фрагмента ДНК длины п. Рассмотрите п = 10, 20 и 100.

Решение. Для последовательности ДНК X длины га, мы проверяем

нулевую гипотезу,

Но = {X принадлежит к области, богатой С + G} = {X е Р},

против альтернативной гипотезы,

На = {X принадлежит к области с однородным составом} = {X е Q}.

Логарифмическое отношение шансов определяется как

L = log2[P(X\P)/P(X\Q)\ =

1 „ ((РА\П1 /РС\П2 (РТ\ПЗ (PG\ni\

=1о(ЦЫ (w) Ы Ы ) =

13 13

= щ log2 - + п2 log2 2 + пз log2 2 + n4 log2 2 ~

« 0,585(п2 + гс4) - (ni + п3),

где щ, гс2, гс3 и П4 — соответственно, числа нуклеотидов Л, С, Г и (7,

наблюдаемые во фрагменте X. Мы принимаем гипотезу Щ (и отвергаем #а),

если L ^ 0, то есть если Р(Х|Р) ^ P(X|Q); и мы отвергаем Щ (и

принимаем На) в противном случае. Ошибка первого рода а (уровень значимости

теста) определяется из выражения

а = Р(ошибка первого рода) = Р(Н0 отвергнута|Я0 верна) =

= P(L < 0\Х еР) = Р(0,585(п2 + п4) - (ni + п3) < 0|Х е Р).

Затем мы определяем исходы бернуллиевого испытания, интерпретируя

появление А или Т в данном участке последовательности X как «успех»,

а появление С или G как «неудача». Если р — вероятность «успеха», то

число «неудач» в п бернуллиевых испытаниях, S = п\ + пз, имеет

биномиальное распределение с параметрами пир. Ошибка первого рода, а,

принимает вид

а = Р(0,585(п2 + га4) - (гц + п3) < 0|Х е Р) =

= Р(0,585(п - S) - S < 0|5 е В(п,р = 1/4)) =

1.2. Дополнительные задачи 43

P(S > 0,369n|S G B(n,p = 1/4)) =

fc /~\ п—к

- Е ©(!)(!) -(1) Е С)--

fc:0,369n<fc^n V / \ / \ / V / fe:0,369n<fe<n Ч 7

Из центральной предельной теоремы следует, что, по мере того как п —* ос,

последовательность случайных переменных (S - Е£)/VVarS слабо

сходится к стандартному нормальному распределению. Поэтому при

больших п

a = P(S> 0,369п|5 6 В(п,р = 1/4)) =

= р (s-ES > 0,369п-Е5^\

= Р

Vv™s VSferS J

S~°'^n > 0,2748Vn I « 1 - Ф(0,2748V^).

0,25V3^ J

Чдесь

*<x)-^/

e 2dt

является функцией распределения стандартного нормального

распределения.

Точно так же, вероятность ошибки второго рода мы находим как

/3 = р(ошибка второго рода) = Р(Щ принята|Яо ложная) =

= P(L ^ о\х eQ) = Р(0,585(п2 + п4) - (т + п3) ^ 0\Х е Q) =

= Р(0,585(п - S) - S ^ 0\S е В{п,р = 1/2)) =

= P(S ^ 0,369njS € В(п,р = 1/2)) =

= е o(j)'ar-a)" s о-

fc:0^fc^0,369n \/\/\/ \ / fc:0^fc^0,369n Ч 7

И снова, при больших п применение центральной предельной теоремы

ведет к равенству:

ft = P(S < 0,369n|S е B(n,p = 1/2)) = P (^Jj| < 0.369n-Eg\ =

yvVarS vVarS у

= P I S ~ °?ДП < -0,262^ | « Ф(-0,262Vn).

У 0,5v/n /

44

Глава 1

При п = 10, 20, 100 мы вычисляем:

а10 = P(S ^ 4|5 € В(10,р = 1/4)) =

= 0,1460 4- 0,0584 + 0,0162 + 0,0031 4- 0,0004 = 0,2241,

/?ю = P(S < 3|5 € В(Ю,р = 1/2)) =

= 0,001 4 0,0098 + 0,0439 + 0,1172 = 0,171;

азо = P(S > 8|5 G В(20,р = 1/4)) =

= 0,069 + 0,0271 + 0,0099 + 0,003 + 0,0008 + 0,0002 = 0,1019,

/320 = P(S < 7\S G В(20,р = 1/2)) =

= 0,0002 4 О, ООН 4 0,0046 4 0,0148 4 0,037 4- 0,0739 = 0,1316;

аюо = 1 - Ф(2,748) « 0,0028,

/?юо = Ф(-2,62)«0,0044.

Как и следовало ожидать, а и /3 убывают при возрастании длины

последовательности нуклеотидов и увеличении количества статистических данных.

□

Задача 1.22. Олигонуклеотид ТТТТАААА наблюдался в кодирующих

белок областях частично секвенированного генома бактерии с частотой 0,008.

Такой же олигонуклеотид наблюдался в некодирующих областях этого же

генома с частотой 0,003. Во вновь секвенированном фрагменте ДНК

длины 400 п. н. олигонуклеотид ТТТТАААА встретился четыре раза.

Найдите апостериорную вероятность того, что этот фрагмент является частью

кодирующего белок гена. Априорную вероятность того, что произвольно

отобранный фрагмент ДНК длины 400 п. н. находится в кодирующей белок

области, принято считать равной 0,8.

Решение. Мы определяем следующие события:

В\ = {фрагмент 400 п. н. расположен в кодирующей белок области},

Дг = {фрагмент 400 п. н. расположен в некодирующей области},

С = {ТТТТАААА встретился четыре раза во фрагменте 400 п. н.}.

По условию P(Bi) = 0,8 и Р(В2) = 1 - P(Bi) = 0,2. Апостериорная

вероятность Р(В\\С) может быть рассчитана с помощью теоремы Байеса:

P(Bl\C) Р(С\В1)Р(В1)

P(C|Bi)P(Bx) + Р(С\В2)Р(В2)

1.3. Дополнительная литература

45

Так как вероятность р «успеха» мала, а число испытаний N велико, в

качестве приближения биномиального распределения числа появлений олиго-

нуклеотида ТТТТАААА («успехов») мы используем распределение

Пуассона с параметром А = pN. Таким образом, для кодирующей и некодирую-

щей последовательностей мы имеем, соответственно, Ai = 3,2 и Х2 = 1,2.

Вероятности наблюдения четырёх олигонуклеотидов ТТТТАААА

определяются как

Р(С\Вг) = Р(четыре ТТТТАААА\Вг) = е~3'2^- = 0,1781,

Р(С\В2) = Р(четыре ТТТТАААА\В2) = е"1'2^- = 0,0260.

Тогда апостериорная вероятность того, что рассматриваемый фрагмент

ДНК длины 400 п. н. является частью кодирующего белок гена, принимает

вид

( . . _ 0,1781-0,7 _

П*1\Ч- 0,1781.0,7 + 0,026-0,3 -°>94- П

1.3. Дополнительная литература

С середины 1990-х гг. было издано много учебников по

биоинформатике и вычислительной геномике. См., например, [275], [18], [76], [161],

[132], [62]. Они отличаются подбором охваченных тем, что отражает

поразительное разнообразие задач и направлений исследований в

биоинформатике сегодняшнего дня. Также мы хотели бы упомянуть монографию по

молекулярной биологии [36], в которой содержится всестороннее и краткое

описание геномики с позиции молекулярного биолога.

Глава 2

ПОПАРНОЕ ВЫРАВНИВАНИЕ

Понятие подобия последовательностей, возможно, является самым

фундаментальным понятием анализа биологических последовательностей.

Точно так же, как подобие морфологических признаков служило

свидетельством генетических и функциональных отношений между видами в

классической генетике и биологии, подобие биологических последовательностей

могло бы во многих случаях указывать на структурную и

функциональную консервативность среди эволюционно связанных последовательностей

ДНК и белков. Введение биологически значимой количественной меры

подобия последовательностей — счёта1 подобия — представляет собой

далеко не тривиальную задачу. Ничуть не проще другая задача — разработка

алгоритмов, которые могли бы при заданной системе очков найти

выравнивание двух последовательностей с возможно лучшим счётом. Наконец,

третий необходимый компонент вычислительного анализа подобия

последовательностей — метод оценки статистической значимости выравнивания.

Такой метод, устанавливающий предельные значения, в пределах которых

наблюдаемые счета являются статистически значимыми, работает должным

образом, как только статистическое распределение счетов подобия

определено аналитически или же вычислительными методами.

Глава 2 «АБП» включает двенадцать задач, которые требуют знания

концепций и свойств алгоритмов попарного выравнивания. Традиционно

эта тема известна биологам лучше всего ввиду её огромного практического

значения. И в самом деле, исследование любой последовательности

начинается с поиска гомологичных последовательностей в базах данных с

помощью программы BLAST. Эта программа основана на очень эффективном

эвристическом алгоритме попарного выравнивания.

1В некоторых источниках для обозначения понятия счёта употребляется термин «вес»,

однако это не совсем корректно. Во-первых, для поиска подобия или выравнивания

последовательностей нередко применяются методы теории графов, и тогда понятия счетов

последовательностей и весов рёбер соотносятся друг с другом, поэтому не следует их путать. Во-

вторых, система «очков» и «штрафов» предполагает скорее накопление определённого счёта,

чем набор веса. В третьих, отрицательная величина счёта менее абстрактна, чем

отрицательное значение веса. — Прим. перев.

2.1. Оригинальные задачи

47

Дополнительные девять задач дают вспомогательную информацию,

необходимую для лучшего понимания теории эволюции белка (после

ознакомления с логарифмическими счетами шансов замен аминокислот), а

также моделей, используемых при оценке статистической значимости

наблюдаемых счетов подобия последовательностей.

2.1. Оригинальные задачи

'Задача 2.1. Аминокислоты D, Е и К являются заряженными; V, I и L —

гидрофобными. Каков средний счёт BLOSUM50 в пределах группы из трёх

заряженных аминокислот? Каков он в пределах гидрофобной группы?

Чему равен счёт между двумя группами? Дайте обоснование наблюдаемой

структуры распределения2.

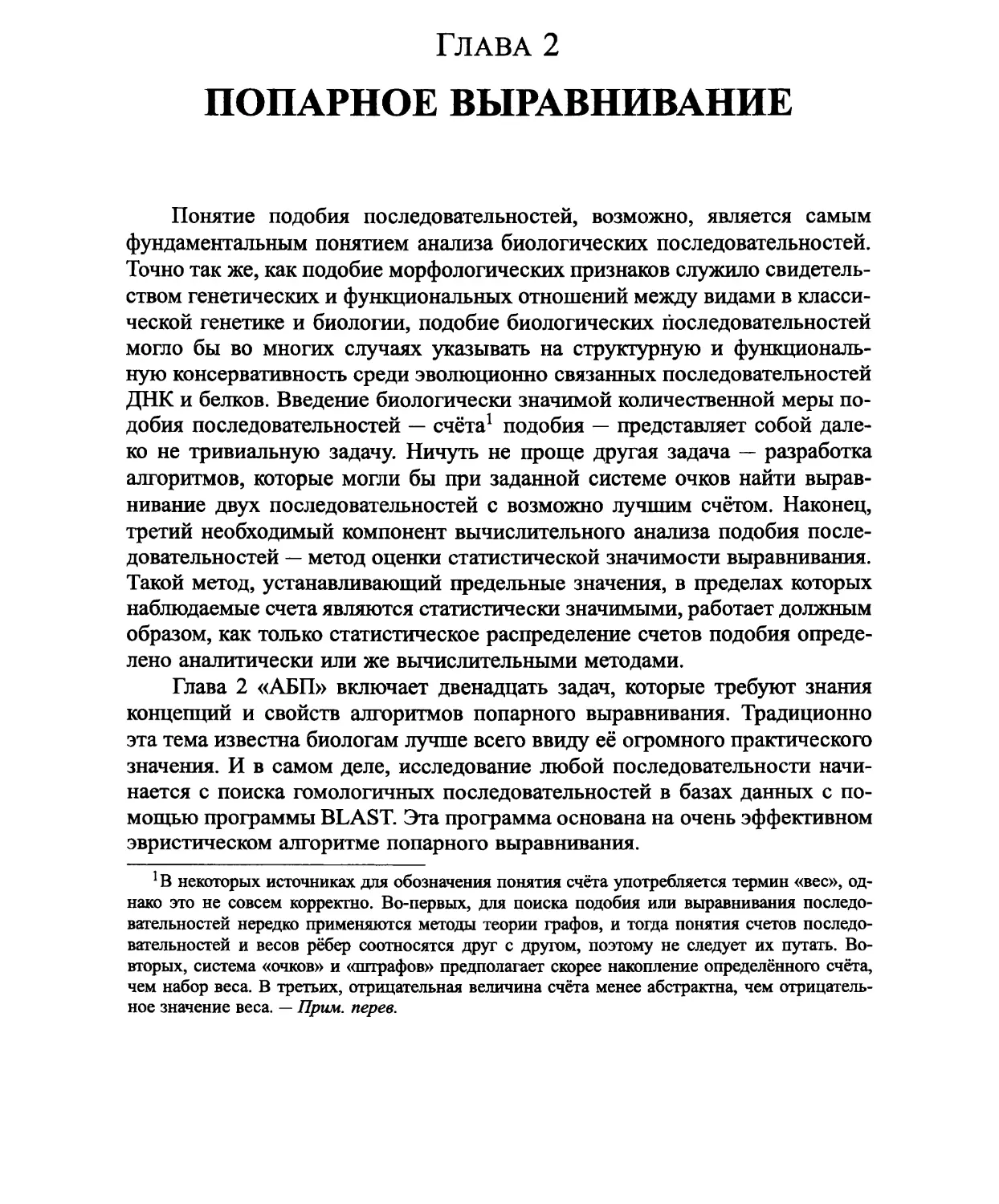

Решение. Счета замен BLOSUM50 в пределах группы заряженных

аминокислот и в пределах группы гидрофобных аминокислот были взяты из

таблицы 2.1 и показаны в таблице 2.2.

Средний счёт замен в пределах заряженной группы Sch = 2,66, а

таковой в пределах гидрофобной группы — Sh = 3,22.

Счета замен между аминокислотами из различных Ypynn приведены

в таблице 2.2, в (со средним значением S = —3,44).

Как и следовало ожидать, счета замен между аминокислотами с

подобными физико-химическими свойствами (в пределах группы заряженных

или гидрофобных аминокислот) выше, чем счета замен между

аминокислотами с различными свойствами (между группами). Алгоритмы

выравнивания последовательностей, максимизирующие полный счет, стремятся

максимизировать число выровненных пар аминокислот с подобными физико-

химическими свойствами. □

Задача 2.2. Покажите, что распределения вероятности f(g) длины

пропуска д, которые соответствуют пропорциональной и линейной схемам

штрафов за пропуски, являются геометрическими распределениями формы

f(g) = fce-Ч3

2 Строго говоря, задача не корректна, поскольку усреднение должно проводиться с учетом

частот встречаемости остатков! — Прим. ред.

3В соответствующей модели генерации пропусков — например, если пропусков устроена

так, что пропуски бывают только длины 10, то распределение вероятностей будет

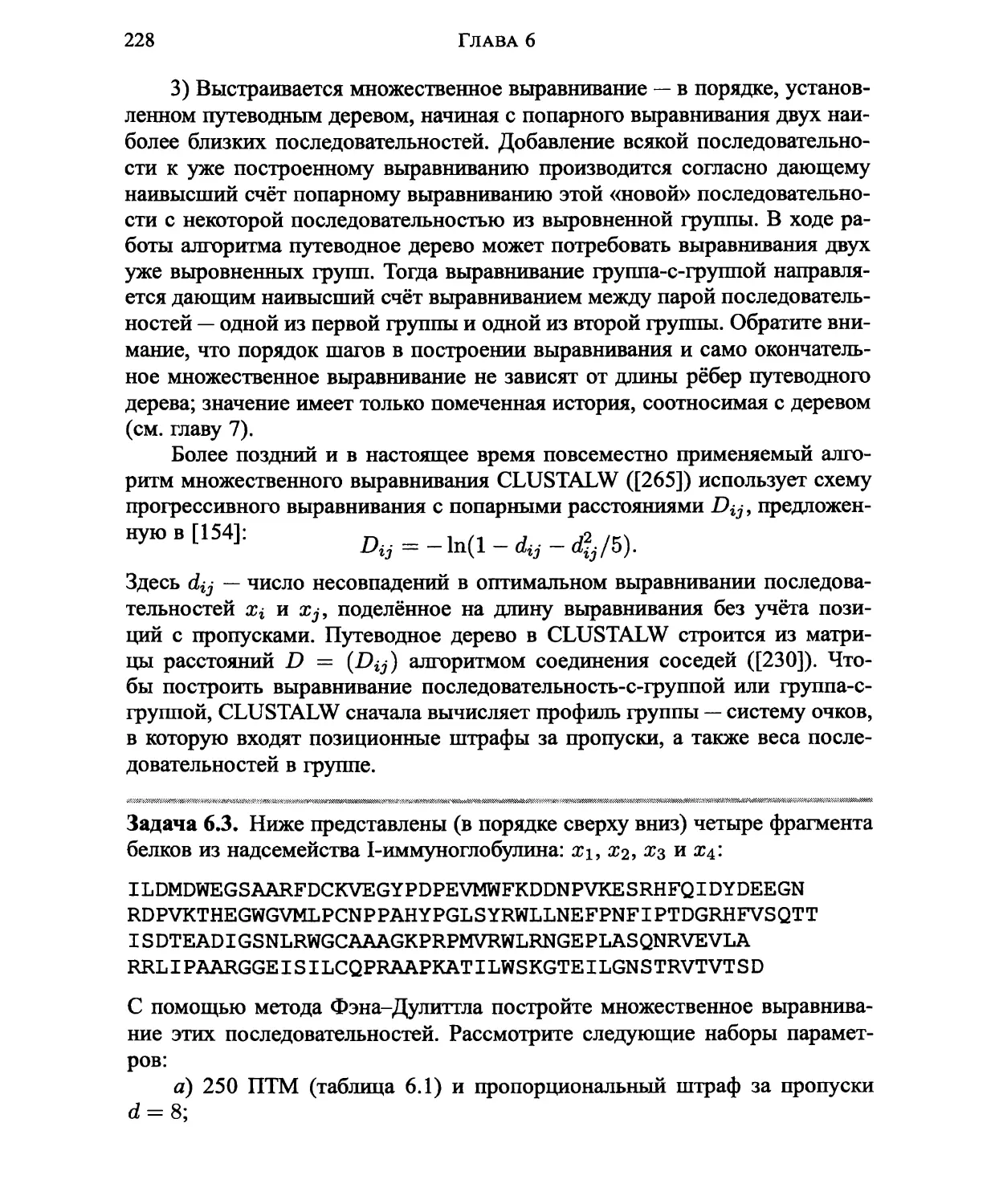

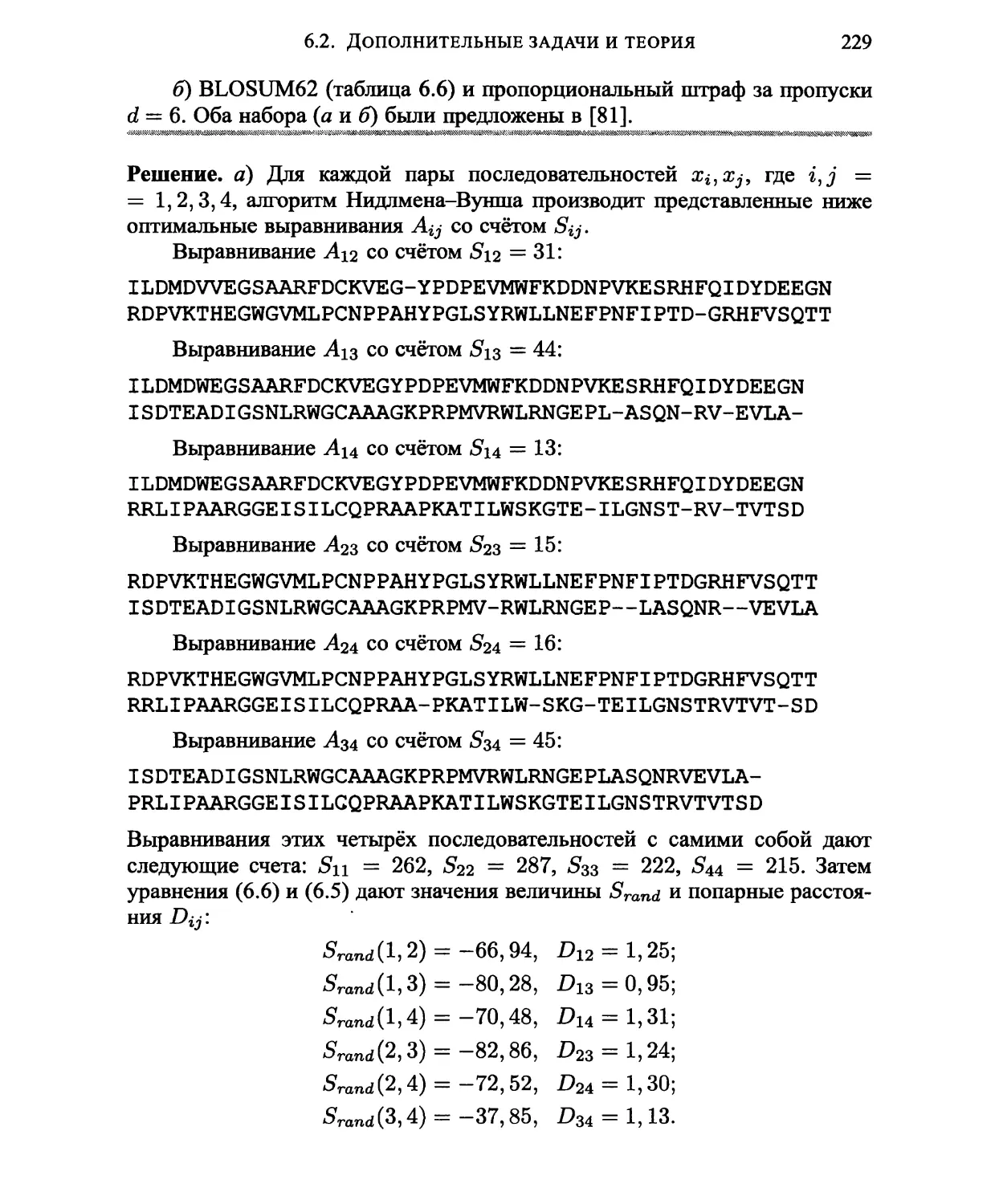

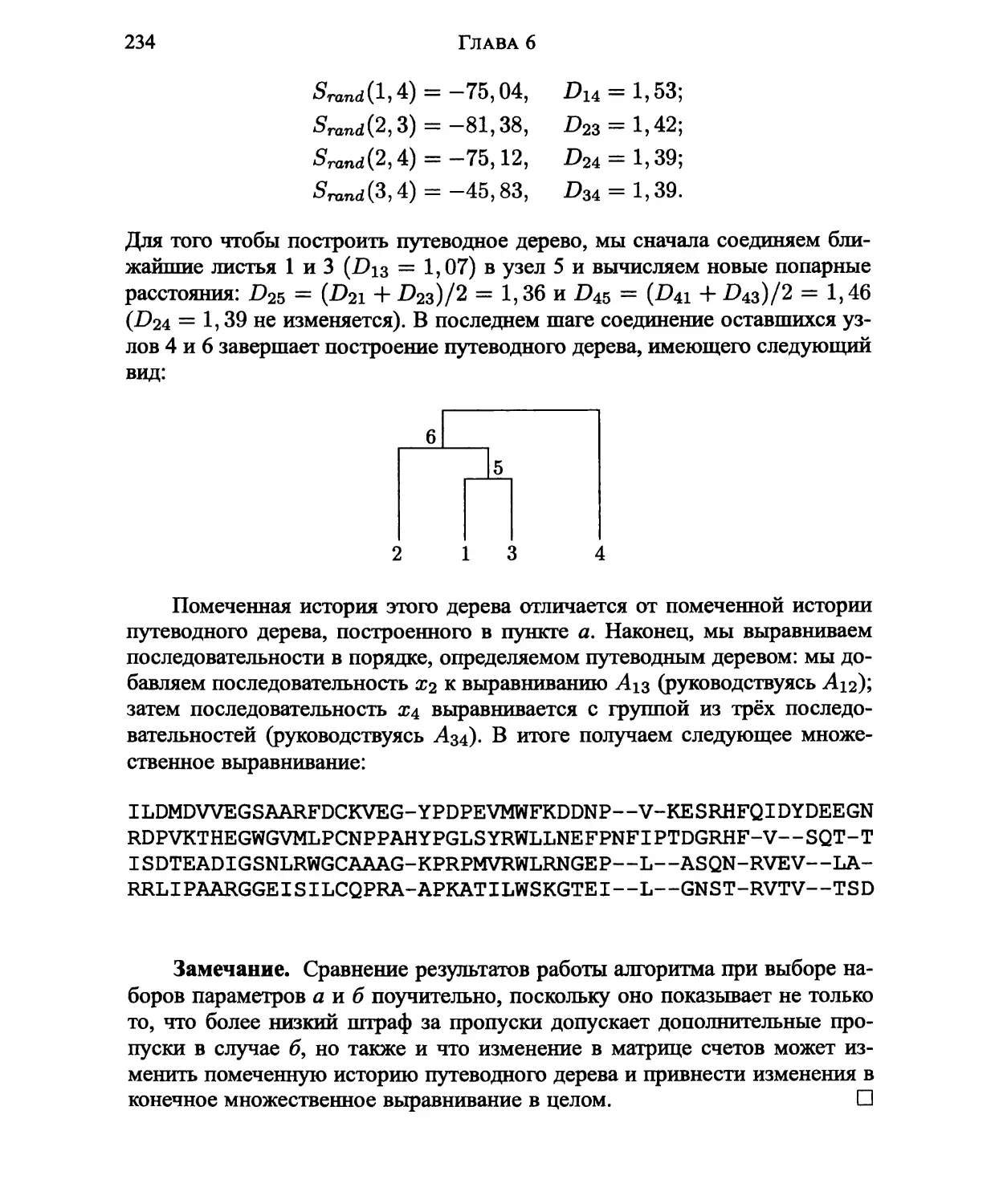

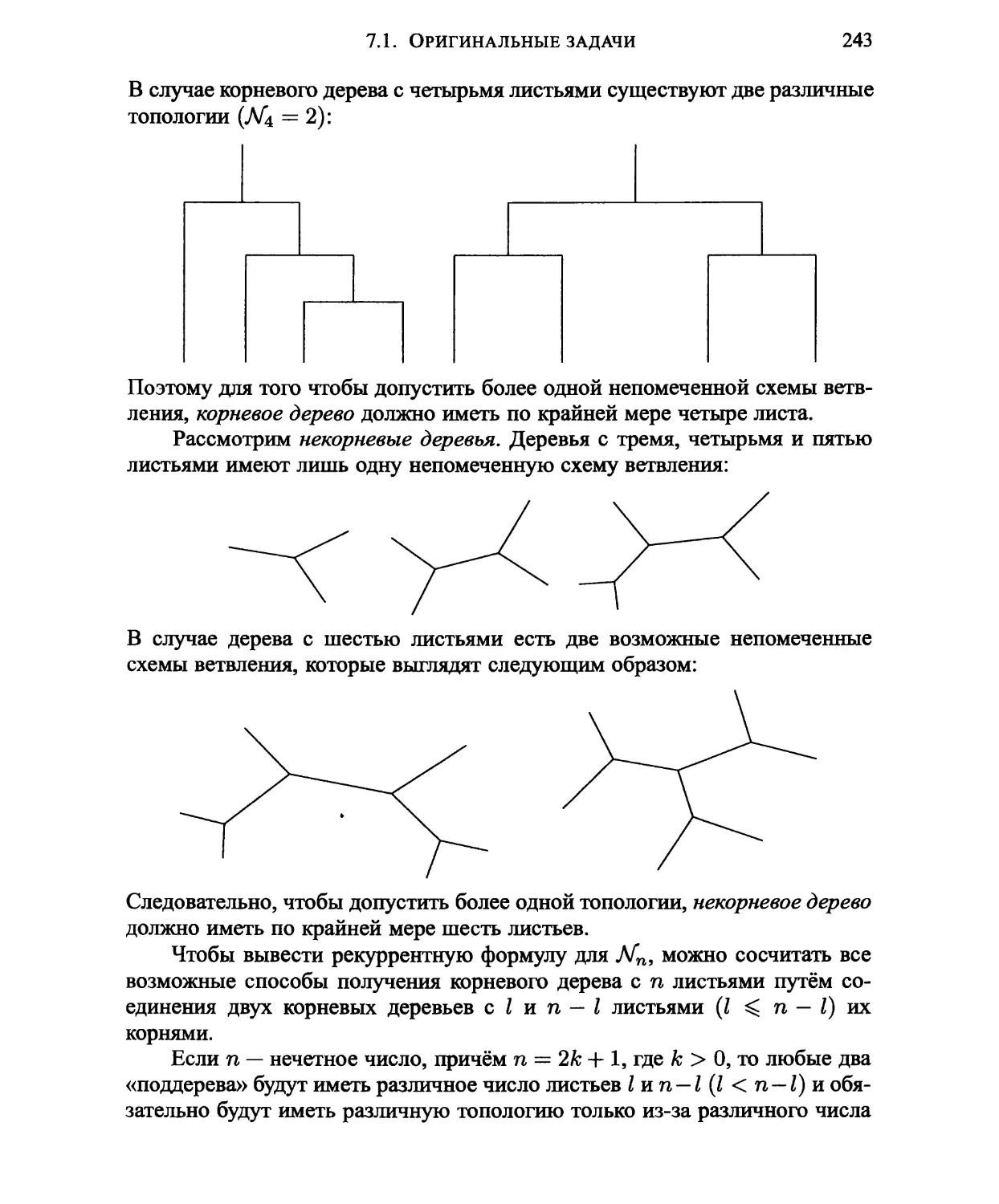

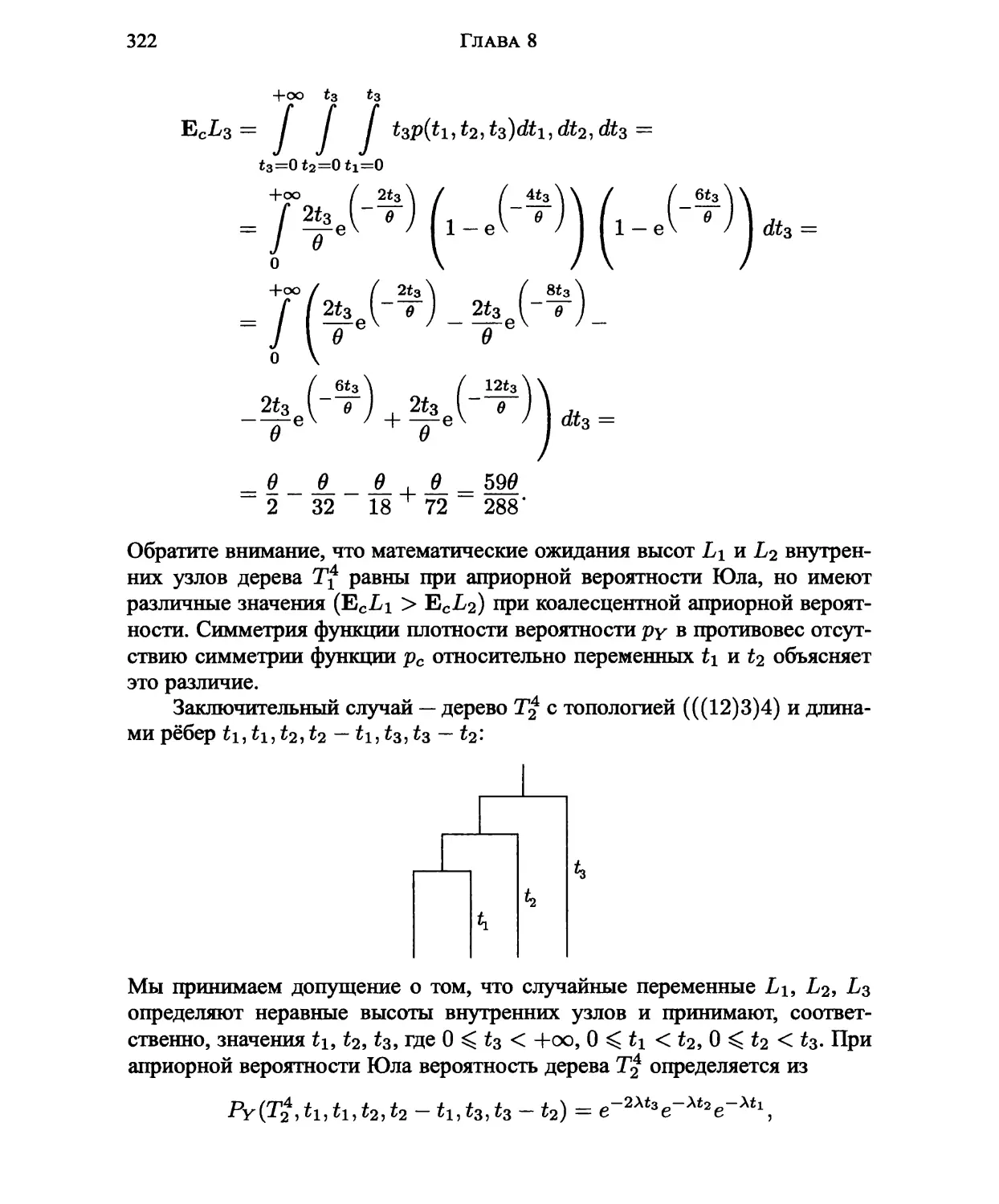

дискретным. — Прим. ред.