Автор: Кельберт М.Я. Сухов Ю.М.

Теги: теория вероятностей математическая статистика

ISBN: 978-5-94057-711-9

Год: 2010

Текст

М. Я. Кельберт, Ю. М. Сухов

ВЕРОЯТНОСТЬ И СТАТИСТИКА

В ПРИМЕРАХ И ЗАДАЧАХ

Том 2

Марковские цепи как отправная точка

теории случайных процессов и их

приложения

Глава 1

Цепи Маркова с дискретным временем

§ 1.1. Марковское свойство и немедленные

следствия из него

Нельзя выучить математику, только слушая

лекции, точно так же как нельзя выучиться

игре на пианино, только слушая пианиста.

К. Рунге (1856-1927),

немецкий математик-прикладник

Теория марковских цепей — логическое продолжение основного курса

теории вероятностей. Мы изучим класс случайных процессов, который

описывает огромное множество систем, представляющих как

теоретический, так и прикладной интерес (а иногда просто занимательных). Тот факт,

что достаточно глубокое погружение в предмет возможно без привлечения

сложного математического аппарата, также объясняет, почему цепи

Маркова популярны в самых различных дисциплинах, кажущихся достаточно

далекими от чистой математики.

Базовой моделью первой части курса будет система, которая изменяет

свое состояние в дискретные моменты времени, согласуясь с неким

случайным механизмом. Множество всех состояний называется пространством

состояний и на протяжении всего курса будет предполагаться конечным

или счетным; обозначим его /. Каждый элемент / е / называется

состоянием; наша система всегда будет находиться в одном из состояний.

Иногда будет известно, в каком состоянии находится система, а иногда

будет лишь известно, что система находится в состоянии / с некоторой

вероятностью. Поэтому имеет смысл ввести вероятностную меру, или

вероятностное распределение (или, для краткости, просто

распределение), на /. Вероятностная мера X на / — это просто совокупность (X,-, i е /)

неотрицательных чисел, сумма которых равна единице:

Х,-^0, £>, = 1. (1.1.1)

«б/

Плава 1. Цепи Маркова с дискретным временем

Мы можем рассматривать (1.1.1) как распределение единичной «массы» по

множеству /, причем точка / имеет массу X,-. По этой причине иногда удобно

говорить о вероятностной функции массы i£/n X,-. Тогда вероятность

множества УС/ равна Х(У) = ^ X/.

/е/

Если X,- = 1 для некоторого / е / и X/ = 0 при / ф i, то распределение

«сосредоточено» в точке /. Тогда состояние нашей системы становится

«детерминированным». Такое распределение обозначим 5,.

Иногда условие Х]Х,- = 1 не выполняется; тогда просто говорят, что

/б/

X — мера на /. Если общая масса ^Х,- < оо, то мера называется конеч-

16/

ной и может быть преобразована в вероятностное распределение путем

нормировки: Х, = Х,/^Ху будет вероятностной мерой на /, поскольку

^Х,- = Х^</Х)^7 = 1- Но Даж^ если ^Х,- = оо (т.е. если общая масса

/б/ /б/ ' /6/ /б/

бесконечна), можно приписать конечные значения Х(У) = ^ X, конечным

подмножествам У С /. ,6У

Случайный механизм, вызывающий изменение состояния, описывается

матрицей перехода Р с элементами рц, /, / е /. Элемент рц равен

вероятности, с которой система перейдет из состояния / в состояние / за

единицу времени. Таким образом, рц — это условная вероятность того, что

система будет находиться в состоянии / в следующий момент, при условии,

что в данный момент она находится в состоянии /. Значит, все элементы Р

неотрицательны, но не превышают 1, и сумма элементов в любой строке

равна 1:

O^pa^W/iJel и J2Pi' = l V'eA (LL2)

/6/

Матрица Р, обладающая такими свойствами, называется

стохастической. По аналогии, вероятностное распределение (X,) на / часто называют

стохастическим вектором. Тогда стохастическая матрица — это матрица,

в которой каждая строка является стохастическим вектором.

Пример 1.1.1. Простейший случай имеет вид 2x2 (пространство из

двух состояний). Не ограничивая общности, можно считать, что

состояниями являются 0 и 1; тогда элементы матрицы имеют вид рц, /, / = 0, 1,

а стохастическую матрицу можно представить в виде

/1-а а \

I p 1-р;-

где 0 < а, р < 1. В частности, при а = |3 = 0 получаем единичную матрицу,

§1.1. Марковское свойство и немедленные следствия из него

а при ос = В = 1 — антидиагональную матрицу:

(о l)' (l о]'

Система с единичной матрицей остается в начальном состоянии навсегда;

в антидиагональном случае она меняет состояние в каждый момент

времени, переходя из 0 в 1 и обратно.

С другой стороны, при ос = В = 1/2 мы получаем матрицу

/1/2 1/2\

U/2 \/2У

1/2 \/2)

В этом случае система может либо остаться в том же состоянии, либо

поменять его с вероятностью 1/2. □

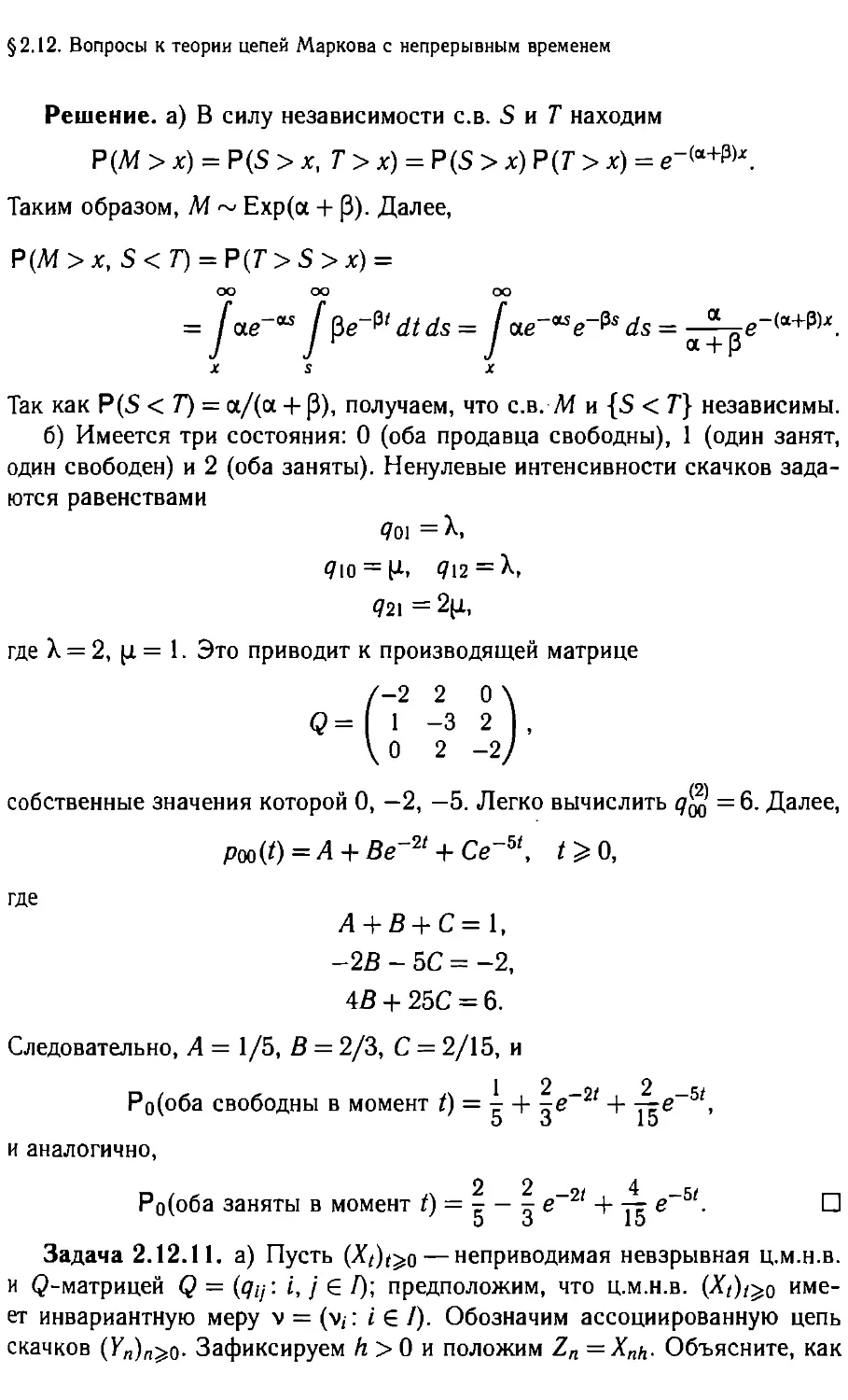

Удобно представить матрицу перехода в виде диаграммы, на которой

стрелками показаны возможные переходы, помеченные соответствующими

О

о

о о

1/2^ J1/2

1 1

Рис. 1.1

вероятностями перехода («замкнутые» стрелки, ведущие обратно к своему

началу, часто не рисуют, равно как и не обозначают детерминированные

переходы). См. рис. 1.1.

«La Dolce Beta» '

(Из серии «Фильмы, которые не вышли на большой экран».)

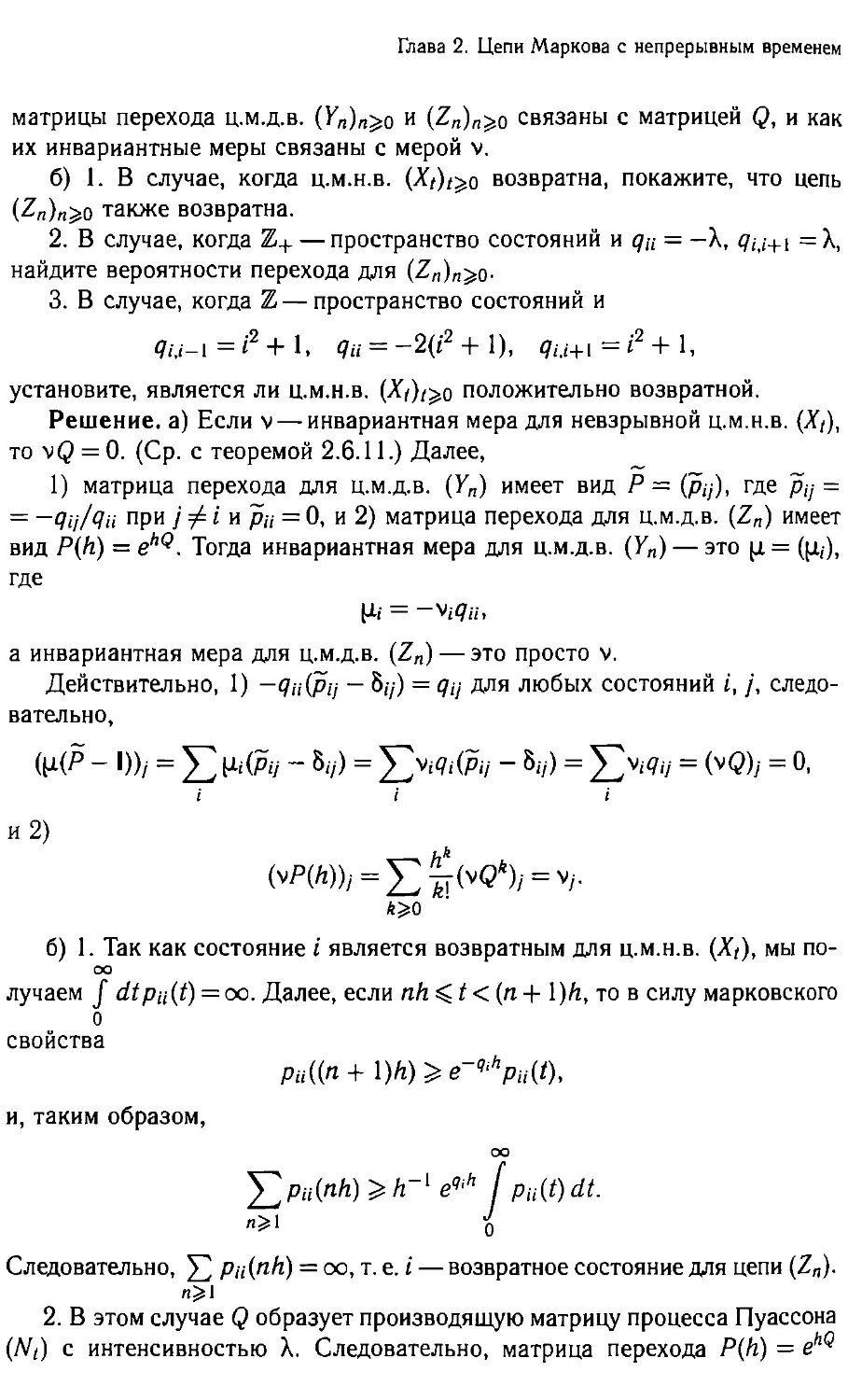

Пример 1.1.2. Матрица 4x4

О 1/3 1/3 1/3N

1/4 1/4 1/4 1/4

1/2 1/2 О О

0 0 0 1

представлена на рис. 1.2. Состояния занумеруем числами 1, 2, 3, 4. □

Время принимает значения п = 0, 1,2, ... Чтобы дополнить общую

картину, нужно указать, в каком состоянии наша система находится в

начальный момент п = 0. Как правило, мы будем предполагать, что система

Ср. с названием фильма Ф. Феллини «La Dolce Vita» («Сладкая жизнь»).

Плава 1. Цепи Маркова с дискретным временем

•4 »3

Рис. 1.2

в момент л = 0 находится в состоянии i с вероятностью X,-, где X — заданное

«начальное» распределение на /.

Обозначим через Хп состояние нашей системы в момент п. Правила,

задающие марковскую цепь с начальным распределением X и матрицей

перехода Р, таковы:

а) Хо имеет распределение X:

P(X0 = i) = h, Vie/;

б) более общим образом, Vn и i'o, • •., in £ 1 вероятность P(Xq = to, -^l =

= /i, ..., Хп = /„) того, что система находится в состояниях /о, /|, ..., /п

в моменты времени 0, 1, ..., п записывается как произведение

P(Xo = k, X\ =i\, ..., Хп = in) = \iBpioil ...pin_xin. (1.1.3)

Конечно, а) — частный случай б) при п = 0.

Важным следствием соотношения (1.1.3) являются равенства для

условной вероятности Р(Хп+\ = j\Xq = io, ..., Хп-\ = t„_i, Xn = i) того,

что состояние в момент п + 1 есть /', при условии, что заданы состояния

/о,-.., г'п-i и in = I в моменты времени 0, ..., п — 1, п:

Р(^л+1 = / | ^0 = '0. • • •. Х-п-1 = 'л-1. ^vi = 0 =

_ Р(^о = /р, .... Хп-\ = i„-\, Хп = i, Хп+\ =/') _

Р(^о = 'о, • ■ •, X„-i = гя — i, Хп = i)

=-л = /?i/'- (I-1-4)

A|0Pi0i| • • -Pi„-\i

Таким образом, при условии, что Хо = io, ..., Хп-\ = i„_i иХ„ = /, Хп+\

имеет распределение (р;у, / е /). В частности, условное распределение ^л+|

не зависит от io, ..., i„_iJ. е. зависит только от состояния i в последний

предшествующий момент п.

§1.1. Марковское свойство и немедленные следствия из него

Формула (1.1.4) иллюстрирует свойство «ограниченной памяти» цепи

Маркова.

Другое следствие (1.1.3) — это элегантная формула, содержащая

произведение матриц, для маргинального вероятностного распределения Х„.

Сейчас мы задаемся вопросом: какова вероятность Р^п =/) того, что

в момент п наша система находится в состоянии /'. Например, для п = 1

можно записать:

/6/

где / — все возможные начальные состояния. В самом деле, события

{состояние i в момент 0, состояние / в момент 1}

не пересекаются для различных / G / и их объединение равно событию

{состояние/ в момент 1}.

Теперь используем формулу (1.1.3) и напомним правила алгебры матриц:

J2 Р(*о = i, *i = /') = £ ЪРч = №i-

|'£/ 16/

Путем прямых вычислений эту формулу можно распространить на

общие значения п:

P(X„=j)= ^2 P{Xo = io, ■■■,X„-i=i„-i,X„=j) =

= £ KPi0il...Pi„.j = ^Pn)h (1-1-5)

'О 'л-I

где Рп — л-я степень матрицы Р. Таким образом, стохастический вектор,

описывающий распределение величины Хп, можно получить, применив

матрицу Рп к начальному стохастическому вектору X.

Затем аналогично предыдущему

P(Xn = i, Хп+\ = /') = 2J Р(-^о = 'о, •••, Хп-\ =i„-\, Xn = /, Х„+\ =/') =

<0 ('л-1

= Y^ ^м ■ • • Р'1«-'iPi'= О^Ърц'

10.-.1/1-1

откуда следует, что

P(Xn+i -i\Xn-i)- р^-— -^--Pli. (1.1.6)

Иными словами, элемент рц равен условной вероятности того, что в

следующий момент состояние будет /, если в данный момент оно есть i.

Глава 1. Цепи Маркова с дискретным временем

Более того,

P(X0 = i,X„=j)= £ P(Xo = i,Xl=il,...,X„-i=in-l,Xn=j) =

= £ х^,...^_,у = х,.(я"),7

!| i/1-l

И

Р(Хп =j\Xo = i) = Р{Хр^=П1)= П = ^P = {РЛ)1г (MJ)

Значит, элемент (Я"),/ матрицы Р" дает вероятность перехода за п шагов

из состояния i в состояние /. Иногда мы будем обозначать эту

вероятность р}".

В общем случае

P(Xk = i,X„+k=j) = QJ*)t(Pn),i

и

P(Xk+n-j\Xk-i) - ptf^ (ХР*). - (р )'/• (1-1-8)

Как следствие, любая степень Р" стохастической матрицы вновь

стохастическая матрица, т. е. ^ р\" =1 V/ G /. Конечно, этот факт можно

/6'

проверить с помощью непосредственных вычислений:

J2Р? = £ Ри' ■ ■ ■ Pi°-ii = ЛРъ ■ ■ ■ £*"-"' = 1'

/6/ 'I ('п-Ь/ 'I /

поскольку на каждом шаге (начиная с £]) сумма равна единице в силу

соотношений (1.1.2). '

Другое следствие состоит в том, что применяя к стохастическому

вектору стохастическую матрицу (Р или в общем случае Я"), мы вновь получим

стохастический вектор. Этот факт также подтверждается прямыми

вычислениями с использованием (1.1.1):

£<xn - £ МП, = £ h £(я% = £ х,- = 1.

Окончательно обобщает соотношение (1.1.3) формула

P(Xk, = i[, Xki = '2. • • •. Xkii = in) =

= (XP*-),, (Я*»-*'),1/2 - -. (P*--*—)/„_,*., (1.1.9)

верная для всех моментов 0 < k\ < k^ < ... < kn и состояний i\, ..., in£l-

§1.1. Марковское свойство и немедленные следствия из него

Наступило время подвести итоги наших изысканий. Предположим, что

X = (Xj) — стохастический вектор и Р = {рц) — матрица перехода на /.

Случайное состояние Хп в момент п рассматривается как случайная величина

со значениями /.

Определение 1.1.3. Говорят, что последовательность случайных

величин Х„ со значениями в конечном или счетном множестве / образует

цепь Маркова с дискретным временем (ц.м.д.в.), или, коротко, цепь

Маркова, с начальным распределением X и матрицей перехода Р, если

Vio, • • •, in 6 / совместное распределение Р(Ло = fa, ..., Хп = /„) задается

формулой (1.1.3). В этом случае мы говорим, что (Хп) — цепь Маркова

с параметрами (X, Р), или (X, Р) — цепь Маркова.

Теорема 1.1.4. Если (Хп) — цепь Маркова с параметрами (X, Я), то

а) Условная вероятность

Р(Хп+\ =/' I ^0 = '0. • • • ■ %п-\ = 'л-Ь Хп = 0

равна условной вероятности Р(Агп+| =j\Xn = i) и совпадает с рц.

Эквивалентно, условное распределение Хп+\ при условии Хо =

= fa %п-\ = in—it ^n — i не зависит от /о. • • ■, in-i " совпадает

с (pij, j e /), т. е. с i-й строкой матрицы Р.

б) Вероятность Р(Хп = i) того, что состояние в момент п есть i,

равна (ХЯЛ);.

в) Элемент р\"' матрицы Р" совпадает с условной вероятностью

Р(Хь+п =j\Xk = 0i т-е- задает вероятность перехода из I в j за п

шагов.

г) Вероятность общего вида

P(^ft, = »ii Хь2 = fa, ■ ■■, %k„ = in)

задается формулой (1.1.9).

Dial M for Markov2

(Из серии «Фильмы, которые не вышли на большой экран».)

Пример 1.1.5. Предположим, что все строки матрицы Р одинаковы,

т. е. р^ = р/ не зависит от i. Предположим также, что X; = ps, т. е. X

совпадает с любой строкой матрицы Р. Тогда в силу соотношения (1.1.3)

получаем

Р(^о = fa, Xi=ii, ..., Хп = in) = piaph ... pin.

2Cp. с названием фильма «Dial M for Murder»

Глава 1. Цепи Маркова с дискретным временем

Кроме того, в этом примере Р" = Р, так как

/,,.. .,<„_| (i h i„-\

благодаря тому что ^Pi = 1. Значит,

/е/

Р(Х„ =/) = (X/*); = 5><°? = Е^> = ^

16/ /б/

Таким образом,

Р(*о = «о, Xl=il,...,X„ = in) = Р(Х0 = io) P(*i = ii) • • • Р(*« = in).

Следовательно, (Хп) — последовательность независимых одинаково

распределенных случайных величин (или, коротко, н.о.р.с.в.). □

Пример 1.1.6. Если Р — диагональная матрица, то она должна

совпадать с единичной матрицей, у которой строка с номером / задается

стохастическим вектором 8,:

'1 0 0 ... 0>

О 1 0 ... О

О 0 1 ... О

уО 0 0 ... 1,

В этом случае любая степень Рп вновь равна единичной матрице. Значит,

в силу соотношения (1.1.4) мы получаем, Р(ХП — i) = Х,-, т. е. распределение

случайной величины (св.) Х„ такое же, как и у Л'п. Другими словами,

начальное распределение сохраняется во времени. □

Пример 1.1.7. Для ц.м.д.в. с двумя состояниями матрица Р равна

( ]. Элементы Р" можно найти с помощью непосредственного

вычисления. Действительно, Р" = РП~1Р, откуда для элемента р^

получаем равенство

рЙ,=рЙ",)(1-«) + рЙ-,,Р =

=pa-,,(i-a)+(i-pa",))P=p+(i-«-P)p&-,).

Это соотношение рекуррентно по п, с начальными значениями р^ = 1

и рдо = 1 - а. Значит,

р$=А + В(1-а-рГ,

где

А + В=1, Л+5(1 — а - Р) = 1 -а,

.1. Марковское свойство и немедленные следствия из него

куда с очевидностью следует, что

+ ТГ«(1-а-Р)Л' еслиос + (3>0,

Р . *

цемент р^ можно получить, меняя а и |3 местами, а элементы р$ и р^ —

к дополнения до 1. □

Пример 1.1.8. В общем случае для вычисления элементов Рп мож-

• использовать собственные числа и собственные векторы матрицы Р.

1ссмотрим пример с матрицей 3 х 3:

/ 0 1 О

Р= 0 2/3 1/3

\1/3 0 2/Зу

: собственные числа являются решениями характеристического уравне-

я:

/4x1 0 \

:t 0 2/3 - у. 1/3

\1/3 0 2/3-ц/

.3^4, 4

—Ix» + |lx»-±lx+l = -ax-l)(n«-ili + i)=0.

куда получаем

И-о = 1, Ц± =

1±/>/3

^скольку все собственные числа различны, матрицу Р можно диагона-

зовать: существует такая обратимая матрица D, что

lPD =

(\ 0 0 \

\°

гда

/>" = £>

1 — гл/3

, т.е. P = D

f\ 0 0 ^

о 1±±^ о

/1 О

i + iV3Y

б

о

\о о

l-i>/3

О"'.

7

1 -/ч/3\л

D

-I

/

тюбой элемент матрицы Я" имеет вид суммы

А + в('1±^Х + с(1-1^я

Глава 1. Цепи Маркова с дискретным временем

-5«W-5(c"5±"tai)-

Коэффициенты А, В к С могут быть комплексными; они меняются от

элемента к элементу, а найти их можно, подставляя я = 0, 1,2. Если п — 0,

то Р° = I — единичная матрица (точно так же, как для скаляров р° = 1 для

всех р (включая р = 0)); для п = 1 берем матрицу Р и при п = 2 возводим

ее в квадрат, чтобы получить Р2. Например, предположим, что состояния

системы — это 1, 2 и 3; в этом случае элементы имеют вид p]J , /,/'= 1,2,3.

Тогда для р\2 пишем:

p°g=A + B + C=0, pm=A + B±±{£ + C±=g£=l

,8-„+в(1^)Чс(Ц<*)'-§.

Вычисления можно упростить, если избавиться от мнимых частей

(поскольку элементы р^ матрицы Рп действительны и неотрицательны).

С этой целью сперва заметим, что \х± — комплексные сопряженные корни,

и запишем

1±<У5 I _1_± <\/3 1 _±ht/3 _ 1

6 3

Затем получаем

(i^)--(i)V-*-(i)-(«?±<*„f)

и

где а = А, р = В + С и у = i(B - С) должны быть действительными. Снова

получаем уравнения для п = 0, 1,2; для ру£ они имеют вид

а+Р=о. «+!(!е+^)=., a+^+^)=f,

откуда следует, что

3 о -3 9/5

В частности, lim pin' = 3/7. П

Пример 1.1.9. Рассмотрим другой пример матрицы, соответствующей

системе с тремя состояниями:

Л/3 0 2/3>

Р= 1/3 2/3 0

\1/3 1/3 1/3;

. 1. Марковское свойство и немедленные следствия из него

перь характеристическое уравнение имеет вид

V + fn2-5H = -(n-i)(n-5)n = o

:обственные числа равны

цо = 1, ^| = з* ^2 = 0.

[ачит, элементы р\"' имеют простой вид

pf=A + B^y + C-W.

ювь используем три начальные условия, т. е. матрицы Р°, Р и Р2 (как

ычно, считаем, что 0° = 1). Например, /?,, ищется из соотношений

А + В + С-1, А + 1В=1-, Л + (1)25 = 1,

куда получаем А = 1/3, В = 0, С = 2/3 и /?,, = 1/3, п ^ 1. Аналогично

^ = 1/3 - (1/3)" и р{$ = 1/3 + (1/3)". При п -> оо все элементы первой

эоки матрицы Р" стремятся к 1/3 (что на самом деле верно для всех

вяти элементов матрицы Рп). □

Пример 1.1.10. Сделаем ряд предварительных замечаний. Во-первых,

— собственное число любой стохастической матрицы Р. Действительно,

сть I — единичная матрица, т. е. элементы матрицы I равны 8,у, /, / € /.

гда a) detail — Р) = det(^I - Р)т = det(^l - Рт), т. е. собственные числа

трицы Р и транспонированной матрицы Р1 совпадают; и б) 1 — всегда

ляется собственным числом матрицы Рт: соответствующий собственный

ктор — это строка 1 = (1, ..., 1) из единиц. Формально \РТ = 1, или,

5 эквивалентно, Р1Т — 1т для столбца 1т. Чтобы проверить последнее

венство, заметим, что каждый элемент столбца РХ1 равен 1:

(Р1т),-=;г>7=1,

скольку матрица Р стохастическая.

Следовательно, характеристический многочлен стохастической матри-

делится на \х — 1; в случае размера 3x3 частное является квадратным

гхчленом, значит, все собственные числа можно найти явно.

Во-вторых, если \±+ — комплексное собственное число матрицы Р, то

пряженное комплексное число у.- — Ц+ также является собственным

эчением, поскольку только это дает возможность получить действитель-

й характеристический многочлен как произведение линейных одночленов

Глава 1. Цепи Маркова с дискретным временем

(имеется в виду произведение ([о, - [!+)(ц - [i_) = [i.2 - ([i+ + U-)^ + Ц+И~

c действительными коэффициентами \j.+ + ^_ и \J.+[i- = \[i±\2). Используя

запись

Ц± = l^±k±/<f> = |^±|(coscp± /sincp),

можно работать только с действительными слагаемыми вида р cos(/zcp)

и ysin(rtcp).

В-третьих, коэффициент А перед единицей в уравнении для p\J\ как

правило, определяет предел Iim р),. Это следует из того, что Ы < 1 для

п—юо '

всех собственных чисел [i матрицы Р и, «как правило» (хотя и не всегда),

любое собственное число [о,^ 1 по модулю меньше 1, |jx| < I. Это более

тонкий факт, к нему мы еще вернемся в последующих параграфах. Поэтому

в разложении

pf=A + £ В.Ц,"

собственные

числа lAi/1

все члены, кроме А, исчезают при п—>оо. (В случае Р = ( А это неверно:

собственные числа равны 1, и —1 и предел Iim /?', не существует, так как

п—>оо '

Рп осциллирует между I для четных п к Р для нечетных п.)

Необходимо отметить, что многие (даже очень простые) примеры могут

привести к достаточно громоздким формулам для /?(• . Например, матрице

Л/3 1/3 1/3N

Р= 0 1/2 1/2

\1/3 2/3 О

соответствует характеристическое уравнение

V + ё^2 + fg^ - 9 = -^ _ ') (^ + 6^ ~ э) = °

с собственными числами

, —1 ±л/Т7

1Ю=1, Ц± = j2 •

Отсюда получаем уравнение

где

§1.1. Марковское свойство и немедленные следствия из него

Например, окончательное выражение для р)$ имеет вид

19+191уГ7 Л 12 ) \9\у/П )\ 12 ) '

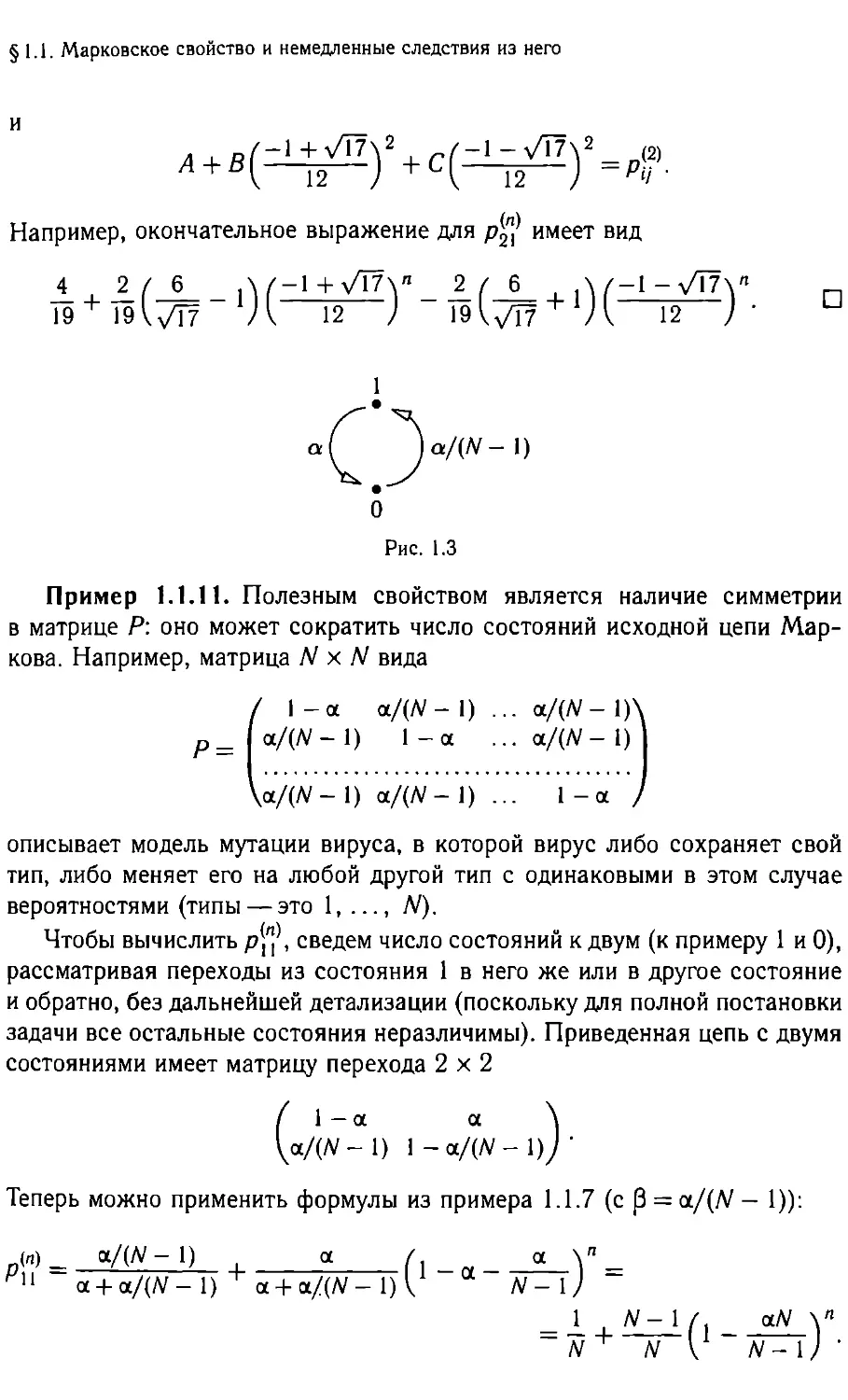

a/{N- 1)

Пример 1.1.11. Полезным свойством является наличие симметрии

в матрице Р: оно может сократить число состояний исходной цепи

Маркова. Например, матрица N х N вида

I -a a/(N- 1) ... a/{N- 1)\

Р= |«/(Л/-1) 1-« ■■■ ol/(N-1)

\ol/(N- 1) a/(N- 1) ... 1 -а /

описывает модель мутации вируса, в которой вирус либо сохраняет свой

тип, либо меняет его на любой другой тип с одинаковыми в этом случае

вероятностями (типы — это 1, ..., N).

Чтобы вычислить р\ | , сведем число состояний к двум (к примеру 1 и 0),

рассматривая переходы из состояния 1 в него же или в другое состояние

и обратно, без дальнейшей детализации (поскольку для полной постановки

задачи все остальные состояния неразличимы). Приведенная цепь с двумя

состояниями имеет матрицу перехода 2x2

1 —а а

a/(N- 1) 1 -a/(N- l)

Теперь можно применить формулы из примера 1.1.7 (с Р = а/(Л/ - 1)):

(„)_ а/(УУ-1) а. / а у

Нп a + a/(N-l) T a + a/.(N-l)\ N-\)

Глава 1. Цепи Маркова с дискретным временем

Кроме того, в силу симметрии

Теперь пора установить знаменитое марковское свойство для ц.м.д.в.

Оно состоит в том, что цепь Маркова стартует заново после любого

заданного момента времени п.

Теорема 1.1.12. Пусть (Хп) — цепь Маркова с параметрами (X, Р).

Тогда, Vm ^ 1 и i€ I при условии, что Хт = i, процесс (Хт+п, п^О) —

цепь Маркова с параметрами (8,-, Р). В частности, при условии, что

Хт = i, случайные величины Хт+\, Хт+2, ...не зависят от величин

Xq, ..., Хт~\.

Иными словами, в ц.м.д.в. прошлое (Xq, ..., Хт_\) и будущее (Хт+\,

Хт+2, ...) условно независимы при фиксированном настоящем (Хт = i).

Доказательство. Напомним, что стохастический вектор 8,

состоит из элементов 8,у, / G /. Нужно проверить, что для любого события А,

определяемого величинами Xq, ..., Хт-\, и события В, определяемого

величинами Хт+\, ..., Хт+\+п, для некоторого п, имеют место следующие

утверждения: а) условная вероятность Р(Л П В\Хт = i) представляется

в виде произведения

Р(Л П В | Хт = /) = Р(Л | Хт = /) Р(В | Хт = i), (1.1.10)

и б) условная вероятность Р(В\Хт = i) вычисляется, как в (8,-, Р)-ц.м.д.в.:

p(B\xm=i)= y, Pih-Pi.-«,- o-i-ii)

(/i Ул)ев

Пусть вначале А и В имеют вид

А — {Xq = г'о, • • •, Хт_\ = im-\}, В = {Xm+i =j\, ..., Хт+п+\ = /'«}

для некоторой последовательности состояний г'о, ..., im-\, /ь • • •. /п£ /■

Произвольные события А и В являются объединениями таких

непересекающихся «элементарных» событий.

Для событий А к В указанного вида выполняются соотношения

Р(ЛПВП {Xm = i}) =

= Р(^о = 'о, • • • I Хт-\ = im-[, Хт = /, Хт+\ = /1, ..., Хт+п+\ = /'„) =

= koPkii ■ ■ ■ Pi„,-\iPij\ ■ ■ ■ Pj„-ii„ ■

Для произвольного В нужно взять сумму по всем (j\, ...,/„)€ В:

*iaPhi\ ■ ■ ■ Pim-\i 2—1 P'i* ' ' ' Pi"-'!"-

Oi ы)ев

§1.1. Марковское свойство и немедленные следствия из него

Сумма J2 дает УСЛ0ВНУЮ вероятность Р(В | Хт = /), значит, эта веро-

(/ /«)ев

ятность действительно вычисляется так же, как в (8,-, Р)-ц.м.д.в.

Далее, для произвольного события Л просуммируем по (io,...,im-i)sA:

Р(Л П В П {Хт = i})= Y, Xi«Pkh • • • Pi.-,/ P{B\Xm = i) =

(«о im-\)€A

= P(An{Xm = i})P(B\Xm = i).

Наконец, для вычисления условной вероятности Р(Л C\B\Xm = i) разделим

ягР(Хт = 1):

Р(АПВ\Хт = 1)=Р(АП/(ХПт^ = » =

P(An{Xm=i})

P(Jf» = i)

P(B\Xm = i) = P(A\Xm = i) P(B | Xm = i),

что и требовалось доказать. □

В дальнейшем будем обозначать через Р,- условные вероятности

р(. |^0 = /), взятые при условии, что состояние системы в момент времени

0 есть /.

Пример 1.1.13. Три девочки Л, В и С играют в настольный теннис.

В каждой игре две девочки играют друг против друга, а третья отдыхает.

Победитель любой фиксированной л-й игры снова играет в (п. + 1)-й игре.

Вероятность того, что девочка х победит девочку у в любой игре, в которой

они играют друг против друга, равна sx/(sx + sy) для х,уе{А,В, С}, хфу,

где sa, sb, sq соответствуют игровым навыкам этих трех девочек.

а) Представьте этот процесс в виде ц.м.д.в., определив пространство

возможных состояний и переходные вероятности.

б) Найдите вероятность того, что те же две девочки, которые играли

друг против друга в первой игре, будут опять играть друг против друга

в четвертой игре. Покажите, что эта вероятность не зависит от того, какие

именно две девочки участвовали в первой игре.

Решение, а) Промаркируем состояния буквами А, В, С,

определяющими, какая из девочек не участвует в заданной игре. Тогда матрица

переходных вероятностей для {Л, В, С} х {А, В, С} имеет вид

/

0

%

SA+SC

%

\sA+:

%

Sfl + SC

0

sA+s,

'В

sB

Sg + Sq

A

sA

SA+SC

Глава 1. Цепи Маркова с дискретным временем

Этот процесс является цепью Маркова, потому что результаты

последовательных игр независимы.

б) Сейчас мы ищем вероятность того, что за три шага цепь вернется

в заданное начальное состояние. См. рис. 1.4.

я-Г у* с

Рис. 1.4

В силу симметрии эта вероятность одинакова для любого начального

состояния и равна

(3) _ . _ 2sA sBSc n

Раа -РавРав Рве Рса + Рас Рев Рва - (sA+sB)(sB + sc)(sc + sA)' U

Пример 1.1.14. Рок-концерт, проводящийся в холле с N

нумерованными местами, привлёк огромную толпу зрителей. Свет потушен, N — 1

место уже занято и последний зритель заходит в зал. Первым N — 1

зрителям распорядитель довольно легкомысленно посоветовал занять места

случайным образом, но последний зритель настаивает на том, чтобы занять

место, указанное в его билете. Если это место свободно, он занимает его,

и концерт начинается. Однако если это место занято, зритель настаивает,

чтобы место было освобождено. В этом случае зритель, освободивший

место, решает поступать точно также: если свободное место соответствует

его билету, он его занимает; в противном случае он настаивает, чтобы его

место освободили. Ту же политику применяет и следующий неудачливый

зритель и т. д. Каждое перемещение занимает 45 секунд. Какова ожидаемая

задержка начала концерта, вызванная этими перемещениями.

Решение (набросок). Здесь важно иметь в виду, что

первоначально N — 1 зритель распределен так, что а) вероятность того, что место /

свободно, равна 1//V, / = 1, ..., /V; б) при условии, что место / свободно,

вероятность того, что первый зритель, вошедший в зал, займет место i\,

второй займет место /г, • • •, (N — 1)-й займет место in-\, равна \/{N- 1)!,

для любой последовательности i\, ..., /yv-i из множества {1, ..., /V} \ {/}.

Рассмотрим ц.м.д.в. с состояниями /V, N — 1, ..., 0. Здесь состояние 0

обозначает, что зритель, пришедший последним, увидит свое место

свободным, состояние п, 1 < п < N - 1, означает, что (N — п)-е передвижение

было «неудачным», и N — начальное состояние системы. Тогда

вероятность перехода из состояния п в 0 равна 1/п и вероятность перехода из п

§1.1. Марковское свойство и немедленные следствия из него

в п - 1 равна (п — \)/п\ вероятность перехода из 0 в 0 равна 1. Пусть Е(п)

обозначает ожидаемое число переходов (перемещений) до того момента,

как ц.м.д.в. попадет в состояние 0 из состояния л; нас интересует E(N).

Полезное замечание: Е(п) равно ожидаемому числу перемещений в зале

с п местами.

Ключевым в решении задачи является рекуррентное соотношение:

E(n) = ^-[l+E(n-l)]+]--0=^-[l+E(n-l)], /i=l,2,...,

где £(1) = 0. Отсюда следует, что

Е(п) = -(л - 1 + л - 2 + ... + 1) = 2-Zl.

Если N = 121 (размер небольшого зала), то ожидаемое время задержки

., 120 ._ _

45 • -^- = 45 мин. П

Пример 1.1.15. Мораль следующей задачи составляет то, что часто

полезно ввести вероятности даже там, где изначально их не было.

Предположим, что окружность единичной длины С\ = lz: \z\ = =- I разбита на

два непересекающихся измеримых множества, одно из них, называемое

красным, имеет общую длину 2/3, а другое, голубое, длину 1/3. Докажите,

что всегда можно вписать в окружность квадрат так, что по меньшей мере

три из его четырех вершин будут красными.

Решение. При заданном разбиении рассмотрим квадрат, вписанный

случайным образом, причем одна из вершин распределена на С\

равномерно; это единственным образом определяет квадрат. Пронумеруем вершины

1, 2, 3, 4, например, по часовой стрелке, начиная с той первой, которая

распределена равномерно. Положим

Xj = 1 (вершина i попала в красное множество), i = 1, 2, 3, 4.

Тогда

Е(числа красных вершин) = ЕЛ1! + ЕХг + ЕХ3 + ЕХ4 = 4 ЕЛ1! = 8/3 > 2.

Таким образом, сумма ^ + X<i + X3 + Х^ принимает значения 3 или 4

с положительной вероятностью, значит, всегда можно вписать квадрат так,

как указано в задаче.

На самом деле можно оценить вероятность Р того, что по меньшей

мере три из четырех вершин будут красными. Действительно, имеет место

оценка: Р ^ Р$, где Pq = - есть корень уравнения

О

(1-Р0)2 + 4Р0 = |,

Глава 1. Цепи Маркова с дискретным временем

которое соответствует ситуации, когда с вероятностью Pq имеется четыре

красные вершины, а с дополнительной вероятностью 1 - Pq в точности

две. □

Завершая данный параграф, мы хотели бы отметить, что в определении

1.1.3 мы ввели класс так называемых однородных, или однородных

во времени, цепей Маркова. Мы будем опускать термин «однородный»,

кроме нескольких случаев, когда мы рассматриваем «неоднородные» цепи

(что имеет место для цепей Маркова с непрерывным временем, см. §2.4).

Отметим только, что в неоднородной цепи Маркова переходная

вероятность из состояния i в у зависит от времени перехода. Следовательно,

вместо одной переходной матрицы Р мы будем рассматривать семейство

матриц Р„, п = 0, 1,2,..., которое описывает вероятности переходов из

состояния i, в котором цепь находится в момент времени п, в состояние у

в момент времени п + 1.

§ 1.2. Разбиение состояний на классы

Борьба сообщающихся классов

(Из серии «Кое-что из политики».)

Разбиение на классы — это естественное разбиение пространства

состояний /, порожденное матрицей перехода Р. Если не оговорено заранее,

мы имеем в виду, что пространство состояний и соответствующая матрица

конечны.

Определение 1.2.1. Говорят, что состояния i и/ принадлежат к одному

сообщающемуся классу, если /?}"'' > 0 и /?j"2> > 0 для некоторых п\, п%>

> 0 (Напомним, что если п = 0, то Р° — единичная матрица I.) Этот факт

обозначается /«-►/. Если выполняется одно из этих условий, то пишем /—>у

или / —»/, а если мы хотим подчеркнуть, что одно из них не выполняется,

то мы будем обозначать это как i -^ у или j ■/* i.

Чтобы проверить, что это разбиение корректно определено, заметим,

что а) каждое состояние сообщается с самим собой (/ «-* /, так как ри — 1),

б) соотношение / +-* у симметрично, т. е. выполняется или не выполняется

независимо от порядка внутри пары /, у (что очевидно из определения);

в) если / 4-* у и у w k, то i ♦-» k (так как р$+П2) = £р!"')/>»2) ^ P^pW

и аналогичные оценки верны для р£' ). Тогда в силу а) каждое состояние

попадает в некоторый класс, в силу б) каждый класс корректно определен

как (неупорядоченное) подмножество /, а в силу в) каждое состояние

попадает не более чем в один класс. Состояния из разных классов, конечно,

не сообщаются.

§ 1.2. Разбиение состояний на классы

Полезно иметь в виду, что / —►/ тогда и только тогда, когда существует

последовательность таких состояний

*о = '» М. •••. tn-ii ln =j,

что pi,il+t > 0 для любой пары (li, i/+i), 0 < / < п. Действительно, /?)• =

— J2 Р"\ • ■ -P'«-\i и вся сУмма положительна тогда и только тогда, когда

/|,...(„_1

по крайней мере одно слагаемое положительно.

Определение 1.2.2. Класс сообщающихся состояний (класс

эквивалентности, сообщающийся класс) С называют замкнутым, если для

любых таких / € С и / G /, что i —► /, состояние / принадлежит С. Иначе

говоря, невозможно выйти из замкнутого класса. Если состояние (или все

состояния, что то же самое) выводит из класса, то такой класс называется

незамкнутым. Состояния, образующие незамкнутые классы

эквивалентности; часто называют несущественными, они и в самом деле несущественны

с точки зрения асимптотического поведения цепи. Состояние i называется

поглощающим, если plL — 1. Это эквивалентно тому, что

сообщающийся класс поглощающего состояния i состоит только из этого состояния

и является замкнутым.

Цепь Маркова называется неприводимой, если все ее состояния

образуют один класс сообщающихся состояний (который в этом случае должен

быть замкнутым). Изучение цепи, имеющей более одного класса

сообщающихся состояний, по сути сводится к изучению ее «сужений» на различные

классы.

Новый факт, доказанный мною, ... состоит

в том, что классовая борьба неизбежно

ведет к диктатуре пролетариата.

К. Маркс (1818-1883), немецкий философ

Пример 1.2.3. Пусть частица переходит из состояния i = 1, ..., N — 1

в состояние / +1 с вероятностью р, а в состояние /—1с вероятностью 1 — р,

где 0 < р < 1. Из состояний 0 и N невозможны переходы ни в одно другое

состояние, т. е. достигнув однажды состояния 0 или N, частица останется

там навсегда. Этот пример описывает матч двух игроков, когда в каждой

игре проигравший выплачивает победителю одну единицу («очко») и матч

продолжается до тех пор, пока один из игроков не проиграет все свои очки.

Другой интерпретацией является блуждание пьяного, который, выходя из

пивной (паба), делает шаги либо в сторону дома (дом — это состояние 0),

либо в сторону озера (озеро — это состояние N). В первом случае значение

N — это общее число очков у обоих игроков перед началом поединка;

Глава 1. Цепи Маркова с дискретным временем

вполне очевидно, что оно сохраняется неизменным в ходе игры. Во втором

случае/V — это расстояние (число шагов) между домом и озером (паб

находится где-то между домом и озером). Каждое состояние / = 0, 1, ..., N —

это число очков у первого игрока или расстояние от дома; р и 1 — р —

вероятности выигрыша и проигрыша первого игрока в каждой игре или

вероятности сделать шаг в сторону дома или озера соответственно.

Результаты игр являются независимыми, так же как и направления движения

на каждом шаге.

Здесь матрица перехода является (N + 1) х (/V+ 1)-матрицей вида

/ I 0 0 0 ... О 0 0\

1 -р 0 р 0 ... О 0 0

0 I- р 0 р ... 0 00

Р =

0

0

0

0

0

0

0 0 .

0 0..

0 0..

0 р 0

. \-р 0 р

. 0 0 1

\ 0 0 0 0 ... 0 0 1/

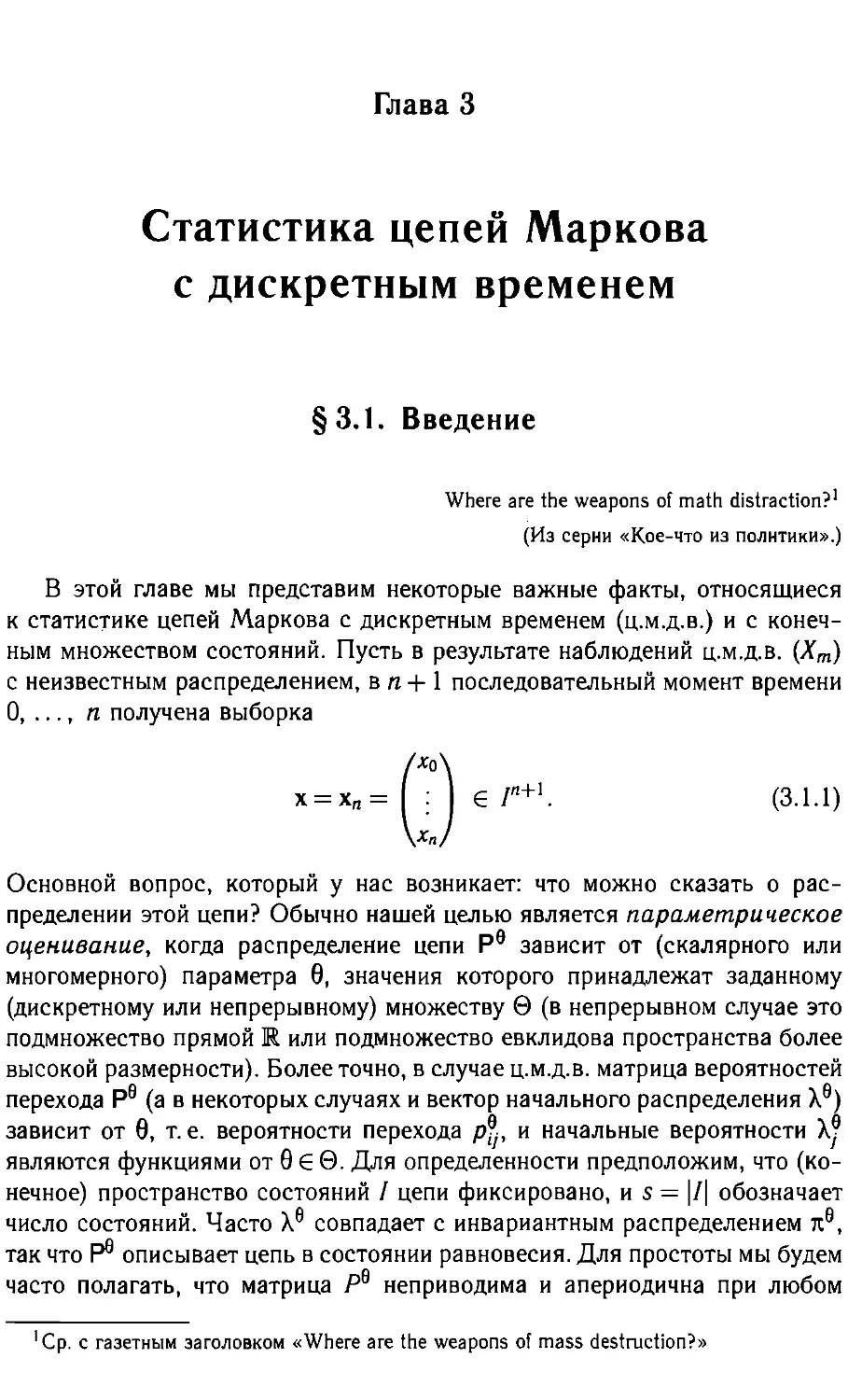

см. рис. 1.5. Сообщающимися классами являются классы {0}, {1,...

..., N — 1} и {N}, классы {0} и {N} замкнуты (т. е. состояния 0 и N

являются поглощающими). Таким образом, состояния 1, .... /V — 1 являются

несущественными, и игра обязательно закончится в одном из граничных

состояний. □

<7 =1-Р Р

Р

N- 1 N

Рнс. 1.5

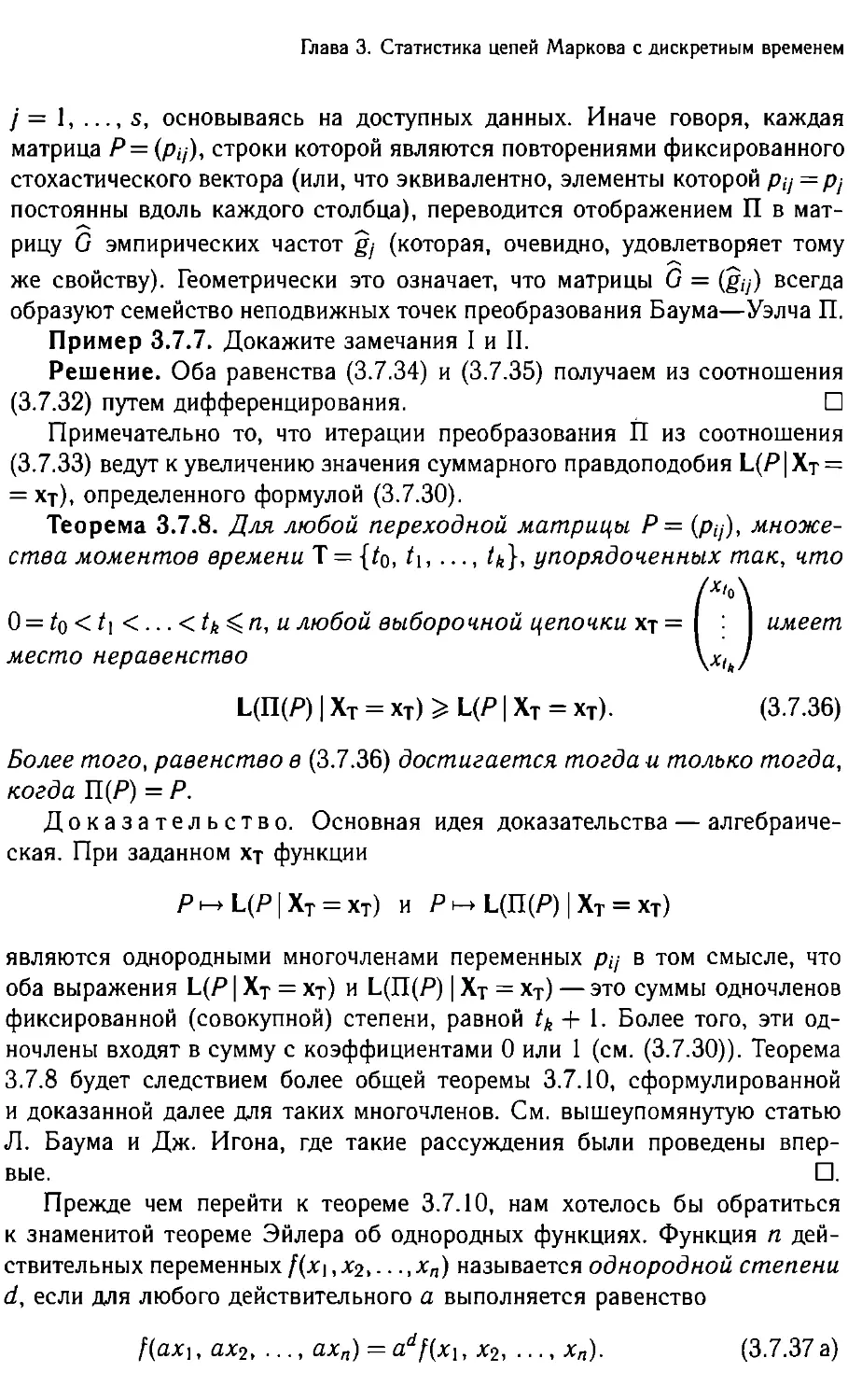

Пример 1.2.4. Рассмотрим (6 х 6)-матрицу перехода на множестве

состояний {1, 2, 3, 4, 5, 6} следующего вида:

Р =

<Л

/* о о о *

0 0*000

о о * о о *

0*00*0

* о о о о *

\о * о о о о/

где символ * обозначает ненулевой элемент, см. рис. 1.6. Сообщающимися

классами являются классы С\ = {1,5}, Сч = {2,3,6} и Сз = {4}, из которых

лишь класс Сч замкнут. Стрелки между классами показывают динамику

цепи. Если мы стартуем из класса Сг, то остаемся в Сч навсегда. Если

мы стартуем из Сз (т. е. из состояния 4), то попадаем либо в Сч (и тогда

§ 1.2. Разбиение состояний на классы

остаемся в Сг навсегда), либо в С\. Интуиция подсказывает, что, проведя

некоторое время в С\, мы должны покинуть этот класс, т.е. перейти в Сг-

В действительности так и происходит, как мы вскоре увидим. □

Рис. 1.6

Приведем простой, но полезный факт.

Теорема 1.2.5. Цепь Маркова с конечным пространством

состояний всегда имеет хотя бы один замкнутый сообщающийся класс.

Чтобы доказать это, рассмотрим любой класс, скажем С\. Если этот

класс незамкнут, возьмем следующий класс, достижимый из С\. Если

и этот класс незамкнут, будем продолжать этот процесс. В конце концов

мы достигнем замкнутого класса. □

Замечание 1.2.6. Случай счетной цепи Маркова со счетным

пространством состояний / более сложен. Здесь может не существовать ни

одного замкнутого класса. Вдобавок в бесконечном замкнутом классе

могут также быть «несущественные» состояния, в том смысле, что цепь

может побывать в каждом из таких состояний только конечное число раз,

а затем уйти в «бесконечность» (хотя все еще может оставаться в этом же

замкнутом классе).

б)

в)

Рис. 1.7

Плава 1. Цепи Маркова с дискретным временем

Самыми простыми являются примеры, когда пространство

состояний / представляет собой множество неотрицательных целых чисел Z+ =

= {0, 1,2,...}. Три примера показаны на рис. 1.7; соответствующие

матрицы перехода таковы:

а)

'0 1 0 0.

0 0 10.

0 0 0 1.

:: i;;)

. б)

/ 0 1 0 0.

11-р 0 р 0 .

1 0 1 -р 0 р .

.. 0 ...

.. 0 ...

.. 0 ...

в)

0 1 0 0 ... 0

1 -р, 0 р. 0 ... 0

0 1 - р2 0 р2 ... 0

Эти примеры описывают так называемые процессы рождения и

гибели, когда состояние i представляет собой размер популяции, а при

переходе к следующему состоянию может умереть одна особь или может

появиться одна особь. В случае а) допускаются только переходы в сторону

увеличения популяции и цепь является детерминированной. Здесь

каждое состояние i образует незамкнутый класс и является несущественным.

В модели б) «смерть» особи происходит с одной и той же вероятностью

1 — р, а рождение — с вероятностью р, независимо от размера популяции

/ в данный момент времени (если только, конечно, / не равно 0).

Примером такого процесса может служить очередь «заданий», обслуживаемых

некоторой системой (например, клиенты, ожидающие своей очереди в

парикмахерской, в которой имеется лишь одно кресло для обслуживания,

либо компьютерные программы, последовательно выполняемые

процессором). Тогда / — это число заданий в очереди. Если до того момента, когда

парикмахер закончит обслуживание текущего клиента, приходит новый

клиент, то имеем скачок / —► i+ 1; в противном случае имеем скачок

/ —» / — 1; из состояния 0 возможен лишь скачок в состояние 1 (хотя

в действительности парикмахер может ожидать некоторое время, пока

появится первый клиент). Возможны два случая: р ^ 1/2 и 0 < р < 1/2.

Интуитивно ясно, что если р ^ 1/2, то задания поступают по крайней мере

с такой же частотой, с какой происходит их обслуживание, и очередь может

превратиться в бесконечную (что, конечно, доставит удовольствие нашему

парикмахеру). В этом случае, как мы далее увидим, каждое состояние /

будет посещаться цепью лишь конечное число раз и Хп (размер очереди

в момент времени п) будет бесконечно расти с ростом п. Если 0 < р <

< 1/2, то задания будут поступать не так часто и система сможет достичь

«равновесия» с некоторым стационарным распределением длины очереди.

§ 1.2. Разбиение состояний на классы

Часто используется модификация примера б), когда состояние 0

полагают поглощающим с вероятностью роо = 1.

В более общем случае в) правила динамики популяции таковы, что для

каждой особи существует шанс погибнуть (но только для одного в каждый

момент времени); например рп = Х/(Х + пи,), 1 - рп = пи./(К + пи.), где

Х>0 и [i > О — «интенсивности» «миграции» и смерти; общая картина

становится более сложной. В дальнейшем мы обстоятельно

проанализируем некоторые из этих моделей в § 1.5—1.7.

Рис. 1.8

Вернемся к цепям Маркова с конечным числом состояний. В общем

случае если перенумеровать состояния, то матрица перехода Р с конечным

числом элементов приобретает некоторую структуру, см. рис. 1.8.

Обычно в левом верхнем углу размещают квадратный блок Оо, состоящий из

вероятностей возможных переходов между несущественными состояниями

(т.е. между и внутри незамкнутых сообщающихся классов). Этот блок

может быть нулевым, если таковых переходов нет. Далее, квадратные блоки

С|, ..., Ст размещены на главной диагонали. Эти блоки представляют

замкнутые сообщающиеся классы различных размеров; они образуют

стохастические подматрицы. Последнее означает, что для любых / = 1, ..., т

и любых состояний /' G С,- сумма ^ Pjk элементов матрицы внутри класса

А6С;

С, вдоль строки / равна 1. Цепи Маркова, соответствующие блокам С\,

..., Ст, могут изучаться по отдельности (что проще сделать ввиду их

меньшего размера). Блоки 0\, ..., От с правой стороны от Оо — это

неотрицательные прямоугольные матрицы; некоторые из них (но не все)

могут быть нулевыми. (Конечно, суммы элементов каждой строки матрицы

Плава 1. Цепн Маркова с дискретным временем

Р всегда равны 1.) Если матрица не имеет несущественных состояний, то

блоки Оо, 0\, ..., От могут просто отсутствовать.

Пространство между блоками Оо, 0\, ..., От и С\, ..., Ст заполнено

нулями. (Внутри матриц также может быть много нулей, см. ниже.)

Рис. 1.9

Мы будем называть конечную ц.м.д.в. (Хп) (или, что то же самое, ее

переходную матрицу Р) неприводимой, если она состоит из единственного

сообщающегося класса С (который автоматически является замкнутым).

Иными словами, конечная переходная матрица неприводима, если каждая

пара состояний /, /' G / сообщается, а все множество состояний образует

один замкнутый класс / = С. Графически в этом случае матрица Р сводится

к блоку С, см. рис. 1.9 а). Отличительной особенностью здесь является

то, что для любой пары состояний /, у е / элементы рц матрицы Рп (т. е.

переходные вероятности из состояния / в состояние / за п шагов) строго

больше 0 для некоторого п ^ 1 (которое, как правило, зависит от / и /').

Некоторые авторы рассматривают более сложную ситуацию и

говорят, что ц.м.д.в. неприводима, если она обладает единственным замкнутым

сообщающимся классом и несколькими незамкнутыми классами. В этом

случае конечная цепь имеет единственное инвариантное, или

стационарное, распределение, см. ниже. Соответствующая матрица приведена на

рис. 1.9 6): имеется один квадратный блок С, который составляет

стохастическую подматрицу, плюс квадратный блок Оо в верхнем левом углу,

и отдельный прямоугольный блок 0\, или просто О. При итерации такой

матрицы Р, т. е. при возведении ее во все более высокую степень п, блок

Оо будет стремиться к 0 при п —» оо. Поведение блока О более сложно:

мы проанализируем его позднее. Что же касается блока С, то он просто

будет возводиться в степень п (что удобно).

§ 1.2. Разбиение состояний на классы

Приведенные выше рассуждения наталкивают на мысль, что будет

происходить при итерации конечной переходной матрицы Р с несколькими

замкнутыми сообщающимися классами. Как и ранее, блок Оо матрицы Рп

будет стремиться к 0 при я—>оо. Как и ранее, блоки С\,..., Ст матрицы Рп

будут просто возводиться в степень п. Последнее замечание иллюстрирует

тот факт, что приводимую цепь, содержащую более чем один класс, можно

изучать, рассматривая отдельно каждый из классов.

Для простоты предположим, что конечная матрица Р неприводима.

Нетрудно догадаться, что внутри блока С у нас может быть

периодическая структура, содержащая v клеток меньшей (одинаковой) размерности,

циклически перемещаемых матрицей Р: клетка 1 «переходит» в клетку 2,

и т.д., клетка v переходит в клетку 1, см. рис. 1.10. Пространство вне

клеток снова заполнено нулями.

Эта картина соответствует разбиению пространства / (которое, по

нашему предположению, составляет отдельный (и замкнутый)

сообщающийся класс) на такие периодические подклассы W\,..., Wv, что переход

за один шаг возможен только из состояния /' е №, в состояние k Е Wi+\,

i = 1, ..., v. (Здесь сумму / + 1 следует понимать как сумму по модулю v,

так что Wv+\ = W\). Число v называется периодом класса С.

В большинстве наших примеров период замкнутого сообщающегося

класса равен единице, т. е. класс состоит из одной клетки. Такие классы

(или, что то же самое, их переходные матрицы) называются

апериодическими.

Вообще говоря, если возвести переходную матрицу Р,

соответствующую замкнутому сообщающемуся классу С с периодом v, в степень v,

то матрицу Pv можно разбить на квадратные стохастические подматрицы,

расположенные на главной диагонали. Образно говоря, периодические

подклассы W\,..., Wv играют роль замкнутых сообщающихся классов для

Глава 1. Цепи Маркова с дискретным временем

матрицы Р". (Нужно, правда, отметить, что формально такое утверждение

неверно: некоторые из подклассов W-, могут состоять из нескольких

непересекающихся замкнутых сообщающихся классов матрицы Pv.)

Мы увидим, что полная структура конечной переходной матрицы Р

может быть достаточно сложной. К счастью, большинство приложений

и интересных примеров не требуют большой степени общности, и нам

удастся сделать упрощающие предположения.

Пример 1.2.7. Рассмотрим стохастическую 7x7 матрицу

/О 1/2 0 0 0 0 1/2\

1/30000 1/3 1/3

0 1/2 0 1/2 0 0 0

Р= 0 0 0 0 10 0

0 0 0 10 0 0

0 1/20000 1/2

\1/3 1/3 0 0 0 1/3 0 /

Найдите все сообщающиеся классы соответствующей ц.м.д.в.

Рис. 1.11

Решение. См. рис. 1.11. Сообщающимися классами являются

{1,2,6,7}, {3} и {4,5}. Замкнутые классы — {1,2,6,7} и {4,5}; состояние

3 является несущественным. Класс {4, 5} имеет периодическую структуру.

Следовательно, предел величины p)J' не существует (она осциллирует) при

/ = 3, 4, 5 и / = 4, 5. Для класса {1, 2, 6, 7} подматрица перехода имеет вид

0 1/2 0 1/2N

1/3 0 1/3 1/3

0 1/2 0 1/2

,1/3 1/3 1/3 0

и обладает симметрией 1 <-» 6 и 2 <-> 7. Таким образом, если объединить

состояния 1 и 6 в (новое) состояние I, а состояния 2 и 7 объединить

§ 1.3. Времена и вероятности достижения

в состояние II, то получим цепь с двумя состояниями и матрицей перехода

12/3 1/3J-

Характеристическое уравнение для последней матрицы имеет вид

2 I 2 п

у. -з^-з=0-

корни этого уравнения равны [irj = 1, [1\ = -2/3. Следовательно, элементы

П" имеют вид А + В(—2/3)п. Подобрав должным образом постоянные,

получаем

п„ _ (2/Ъ + 3/5(-2/3)" 3/5 - 3/5(-2/3)л>

^2/5 - 2/5(-2/3)" 3/5 + 2/5(-2/3)"

Таким образом,

пл /2/5 3/5

\2/5 3/5

Тогда в силу симметрии для первоначального блока {1, 2, 6, 7} предельной

будет матрица

1/5 3/10 1/5 3/10\

1/5 3/10 1/5 3/10

1/5 3/10 1/5 3/10 '

1/5 3/10 1/5 3/10/

т. е. pf, p(g -> 1/5 и р$, рУ -+ 3/10, i = 1, 2, 6, 7. Вероятности /»g>

стремятся к - lim рг), /= 1, 2, 6, 7.

Следует подчеркнуть, что такой способ вычисления пределов lim pfj

п—юо '

не является оптимальным. В дальнейшем мы познакомимся с намного

более эффективными способами. □

§ 1.3. Времена и вероятности достижения

A hit, a very palpable hit.

Гамлет. В. Шекспир (1546—1616),

английский драматург и поэт

Напомним, что через Р; обозначается распределение ц.м.д.в. (Хп),

которая выходит из состояния /G /. Аналогично будем обозначать через

Е; математическое ожидание по мере Р,-. Пусть А С / — это некоторое

подмножество множества состояний. Момент (первого) достижения

(п)

Плава 1. Цепи Маркова с дискретным временем

НА —это момент времени, когда цепь Маркова впервые попадает в А,

т.е.

НА = Ы{п^0:ХпеА}. (1.3.1)

Вероятность достижения hf — это вероятность того, что цепь, стартующая

из состояния /, когда-нибудь попадет в А:

hf = Pi(HA<oo); (1.3.2)

если А — это замкнутый класс, то hf называют вероятностью поглощения.

Математическое ожидание величины НА обозначают kf:

kf = Ei(HA)= ^ nPi(HA = n) + oo-Pi(HA=oo). (1.3.3)

0<л<оо

Следовательно, если ?i{HA = со) > 0, то kf = оо. (По соглашению, оо • 0 =

= 0.)

Вычисление вероятностей достижения основывается на следующей

теореме.

Теорема 1.3.1. При заданном множестве Act величины hf

представляют собой минимальные неотрицательные решения

следующей линейной системы:

jhf = \, ieA,

\hf = EPiihf, i*A. (L3-4)

^ /6/

т.е. для любого решения g, ^ 0 системы (1.3.4) выполняется

неравенство gi ^ hf, i el.

Доказательство. Напомним, что hf вычисляется при условии, что

Xo = i. Если /бЛ, то НА = 0, следовательно, hf = 1. Если i&A, то НА ^ 1,

и тогда

hf = £ Pi(HA < оо, Хх = /) = £ Р,(*, = /) Р,(ЯД < оо | Xi = /) =

/€/ /€/

= (в силу марковского свойства) У^/ty' Р/(НА < сю) = ^p,jhA.

i i

Возьмем любое неотрицательное решение g,-. Если i G Л, то gi — hf — l.

Если i & А, то

8i = Y1 р>& = И Р" + Y1 Р№ = Y1РЧ + Y1РЧ (Yl pik + Yl Pi*B*)=

j j€A ЦА ieA ЦА \k£A к$А )

= Pi(X,eA) + Pi(Xl^A,X2eA)+ Y, P'iPikgk-

j&A,k£A

§ 1.3. Времена и вероятности достижения

Повторяя подстановки, для любого п находим

gi = Р,(*, е А) + ... + Р,(*, £ А, ..., *п_, g A, Xn e А) +

+ J2 ■ ■ ■ 2 P'hPhh ■ ■ ■ Pj.-il.8i.-

/ig-4 j„#A

Поскольку gi ^ 0, опустив последнюю сумму, мы уменьшим правую часть.

Первые же п слагаемых дают в сумме Р[(НА < п). Следовательно,

gi > ?i(HA < п) Уп > О,

откуда получаем

gi > lim Pi(HA < п) = Pi(HA < со) = hf. D

л—>оо

В общем случае эти уравнения предоставляют мощное средство для

вычисления вероятностей достижения даже в самых запутанных ситуациях,

особенно, когда можно воспользоваться симметрией ц.м.д.в. См.

следующие примеры.

Пример 1.3.2. Постройте граф, имеющий семь вершин, следующим

образом: возьмите правильный шестиугольник и соедините

противоположные вершины прямыми линиями; пусть вершинами графа будут вершины

шестиугольника и его центр симметрии; а ребрами графа будут стороны

шестиугольника и отрезки, соединяющие вершины с центром. В

дискретные моменты времени частица переходит от одной вершины графа

к какой-то из соседних вершин случайным образом и независимо от

прошлых переходов. Предположим, что частица начинает движение в вершине

А шестиугольника. Найдите вероятность того, что частица вернется в А,

так и не побывав в центральной вершине С.

D Е

ф

Рис. 1.12

Решение. См. рис. 1.12. Положим

hi = Р,(достичь А раньше, чем достичь С).

Тогда искомая вероятность равна Лд и в силу симметрии

Лд = йЛв.

Глава 1. Цепи Маркова с дискретным временем

Далее,

Лв = з + зЛ°' Л° = зЛв + 3Ле'

и вновь в силу симметрии

Тогда

Наконец,

1 2 3

ho = з^в + g^D- т.е. hD = jhB.

Лв = з + 7Лв' т-е-Лв = уд.

Следовательно, Лд = 7/27. □

Пример 1.3.3. Процессы рождения и гибели; см. пример 1.1.7 6). Для

процесса рождения и гибели положим Л,- = Р, (достичь 0), тогда Л,- является

минимальным неотрицательным решением системы

Ло = 1, hi = phi+i+(l-p)hi-i, />1.

При р ф- 1/2 это решение имеет вид

Л, = л + В(^£)'

Если р < 1/2, из условия минимальности и неотрицательности следует, что

В = 0 и А = 1, откуда получаем Л,- = 1. Если р > 1/2, заключаем, что Л = 0

и В = 1, и тогда

При р = 1/2 решение имеет вид

hi = A+ Bi

и вновь из условия минимальности и неотрицательности следует, что В = О

и Л = 1, значит, Л,- = 1.

Отметим, что найденные значения не зависят от выбора

вероятностей ро/. Заметим также, что Л, — это вероятность вымирания, а 1 — Л* —

вероятность выживания (условные вероятности при условии Xq = i).

Следовательно, вероятности выживания равны

1-(-^)', i>0, для ре (1/2, 1], D

0 для ре [0, 1/2].

§ 1.3. Времена и вероятности достижения

В каждую секунду один человек умирает,

. I

а 1 — человека рождается.

Ч. Бэббидж (1792—187)), английский математик

Если мы перейдем к примеру 1.1.7 в), то уравнения становятся

зависимыми от состояния:

Л0 = 1, А,- = Pihi+{ + (1 - pi)hi-i, i ^ 1.

Для отыскания решения перейдем к рассмотрению разностей

Щ = А/_1 - Л/, где PiUi+i = (1 - р1)щ

и - ' ~Piu - l ~Pi '-P'-' l ~ Pi „

И/+1 — Щ — . . . U\.

Pi Pi Pi-1 P\

„ 1 - D,_| 1 - D\

Положим у,- = — ... —, тогда, поскольку

Pi-l P\

u\ + ... + щ = A0 - hi,

мы получаем

/t, = l-y4(Yo + ... + Y*-i)-

Здесь Yo = 1 и А = u\. Постоянная А определяется из того условия, что

inf,- ht ^ 0:

, оо ч -1

4 ;=о

Таким образом,

оо

Л,- = 1, если У~] Y/ = °°>

/=о

и

оо / оо оо

^ = ХЛ;/ ХД/' если ХЛ''<0°-

/=« ' j=0 /=0

В частности, во втором случае, A;+i < А; и lim A,- = 0. Вероятности выжи-

i-too

вания теперь равны

( ОО / ОО ОО

1_&у7ХД/. если l^Y/<oo,

/•=( ' j=0 j=0

оо

0, если У~] Y/ = со-

/=о

Для средних времен достижения kf справедлива следующая теорема.

Глава I. Цепи Маркова с дискретным временем

Теорема 1.3.4. При заданном Л С / величины kf представляют

собой минимальные неотрицательные решения следующей линейной

системы:

'kf=0, /еЛ,

№

Таким образом, для любого решения gi ^ 0 системы (1.3.5)

выполняется неравенство g,- ^ kf, i e /.

Доказательство. Как и при отыскании hf, математическое

ожидание времени достижения kf вычисляется при Xq = L Если i 6 Л, то НА = О,

следовательно, и kf = 0. Если i tf. А, то НА ^ 1 и

Ei(HA\Xl=j) = l+EiHA

в силу марковского свойства. Таким образом,

kf = е,(/ул)=y, Е<<яЛ' м = л)=Е р'№ = /) Е'^л I*«= /')=

/6/ /•

=i+е р<№ =/) еу^=!+е^-а-

/(2Л /«м

Пусть теперь gi — это любое неотрицательное решение. Тогда gt = kf =

= 0 для i е Л. Если i g А, то

8i: = • + Е р'/£/ = ! + Е^l ' + Е ^'*г*

/2Л у^Л ^ *£Л

Представив 1 как Р,(#л ^ 1), а £ Ау как Р(#л ^ 2), находим

/2Л

й = Р,(//л > 1) + Р,(ЯЛ ^ 2) + 5>/ 5>/*ft.

/0Л А0Л

Повторяя подстановки, для любого я находим

gi = l+Pl(HA>l) + ... + Pl(HA>n) + 1£...1£pihPhh---PU-ill,gJ.>

ji#A j„<£A

^Р,(Ял^1) + ... + Р,(/Ул^/г),

так как g, ^ 0. Тогда при п —► оо получаем

оо

й^хр'(/ул^/г) = Е'ял = /г-л- D

л=1

§ 1.3. Времена и вероятности достижения

Отметим, что единственным неотрицательным решением системы

(1.3.5) может оказаться kf = оо, i g А. Как и в случае с величинами hf,

уравнения (1.3.5) можно эффективно использовать, особенно в случаях,

когда система обладает свойствами симметрии.

Пример 1.3.5. Для процесса рождения и гибели из примера 1.1.7 6)

положим ki = Е,-(//{°}); это среднее время достижения состояния 0. Тогда

kj является минимальным неотрицательным решением системы

k0 = 0, ki = 1 +pki+i + (1 - p)ki-\, i > 1.

Общее решение имеет вид /г,- = А + Bi; постоянные А и В задаются

равенствами А = 0, В = 1/(1 — 2р). Однако при р ^ 1/2 конечного

неотрицательного решения не существует. Следовательно, для / ^ 1 имеем

bJrhrp1 пРиО<р<1/2, п

I оо при 1/2 < р < 1.

Пример 1.3.6. Пролет лестницы состоит из N ступенек. Лягушка,

начиная движение от подножия лестницы, пытается добраться до

верхней ступени, совершая серию независимых прыжков следующим образом.

Если лягушка находится на i-й ступеньке (0 < / < N), то ей удается

перепрыгнуть на (i + 1)-ю ступеньку с вероятностью а (0 < а < 1/2), но с такой

же вероятностью а она может упасть вниз на (/ — 1)-ю ступеньку и с

дополнительной вероятностью 1 — 2а она вновь приземляется на i-ю ступеньку.

Когда лягушка находится у подножия лестницы (нулевая ступенька), ей

удается подпрыгнуть вверх так, чтобы попасть на первую ступеньку с

вероятностью р (0 <р < 1), а с вероятностью 1 — р она остается на прежнем

месте. Чему равно ожидаемое число прыжков, которые совершит лягушка,

прежде чем достигнет вершины лестницы?

Предположим, что та же лягушка начинает прыжки, находясь на

расстоянии N ступеней от вершины на бесконечной лестнице. Чему теперь

будет равно ожидаемое число прыжков, которые совершит лягушка,

прежде чем достигнет вершины лестницы?

Решение. Система уравнений для конечной лестницы [0, N] имеет вид

kN = 0,

ki = l+ a/z,_i + (1 - 2a)ki + aki+l, l^i^N-l,

k0=\+(l-p)k0 + pkl.

Общее решение имеет вид

k^A+Bi-U2,

Глава 1. Цепи Маркова с дискретным временем

а из граничных условии в точках i -

N2 - i2

ki =

2а

О и N следует, что

N-i N-i

2а + В

и

N(N-l) N

В случае бесконечной лестницы выражение А + Bi

2а1

невозможно

сделать неотрицательным для всех /. Следовательно, /г,- = со. □

Пример 1.3.7. Рассмотрим ц.м.д.в. с пространством состояний {1,2,3,

4, 5, 6} и матрицей перехода

/О 0 1/2 0 0 1/2\

1/5 1/5 1/5 1/5 1/5 0

1/3 0 1/3 0 0 1/3

1/6 1/6 1/6 1/6 1/6 1/6

0 0 0 0 10

\1/4 0 1/2 0 0 1/4/

Найдите сообщающиеся классы для этой цепи и для каждого класса

укажите, является он открытым или замкнутым.

Предположим, что цепь выходит из состояния 2; найдите вероятность

того, что когда-либо будет достигнуто состояние 6.

Предположим, что цепь выходит из состояния 3; найдите вероятность

того, что цепь попадет в состояние 6 ровно за п переходов (шагов), п ^ 1.

Решение. Структура цепи представлена на рис. 1.13.

Рис. 1.13

Состояния 1,3,6 образуют замкнутый класс, состояния 2,4 — открытый

класс, а состояние 5 является поглощающим (и образует замкнутый класс).

§ 1.3. Времена и вероятности достижения

Если hi = Р/(достигнуто состояние 6) то h\ = hz = 1,

1 1 2

hi = g/гг + g/z4 + g,

/г4 = g/z4 + g/z2 + 2-

откуда получаем hi = 13/19, /z4 = 14/19. Следовательно, ответ на второй

вопрос таков:

13

Рг(достигнуто состояние 6) = —.

Далее, для класса {1, 3, 6} матрица перехода имеет вид

О 1/2 1/2^

1/3 1/3 1/3

,1/4 1/2 1/4,

Для того чтобы найти ее собственные значения, решаем уравнение

/-Х 1/2 1/2 \

det 1/3 1/3-X 1/3 =0,

\1/4 1/2 1/4 —X/

x3-1x=-1x-1 = ,x-d(x= + Ax + 1)=o,

и находим

Х| = 1, Хг = -^, Хз = -g.

Отсюда следует, что

p%=A + B(-\y + c(-ff, « = 0,1,...

При п = 0, 1,2 получаем равенства

А + В + С = 0, А-\В-\С = \, Л + 1б + 1с=1|,

откуда следует, что

л_12 s_i c__8

значит.

рзе -35 + б( 4) 7V б) •

Глава 1. Цепи Маркова с дискретным временем

§ 1.4. Строго марковское свойство

Restore my Strong Markov property!3

(Из серии «Кое-что из политики».)

Строго марковское свойство состоит в том, что процесс начинается

заново не только после любого заданного момента времени п, но также

и после случайно выбранного момента времени. Примером такого момента

времени может служить /У' — момент первого достижения цепью заданного

состояния i б /. Сформулируем это свойство в общем случае.

Определение 1.4.1. Случайная величина Т, зависящая от Xq, Х\, ...

и принимающая значения 0, 1, 2,..., оо, называется моментом остановки,

если событие {Т = п} описывается только в терминах случайных величин

Х\, ..., Хп без привлечения величин Хп+\, Хп+2, ...

Образно говоря, наблюдая за цепью, вы знаете, когда вам следует

остановиться, и предвидеть будущие состояния вам для этого не нужно.

Время первого достижения НА является примером момента остановки,

поскольку {НА = 0} = {Хо G А}, а при п > 1 выполняются соотношения

{НА=п} = {Х0#А, ...,Xn-i#A,Xn€A}.

Когда А состоит лишь из одного состояния /, время достижения часто

называют временем первого входа:

Н> = Щп^0:Хп=/}.

Stop Man, Hit Woman4

(Из серии «Фильмы, которые не вышли на большой экран».)

С другой стороны, последний момент пребывания

LA =sup[n: Xn e А],

вообще говоря, не является моментом остановки, так как для события

{LA = п} требуется информация об ^„+i. Хп+2, ...

Теорема 1.4.2. Пусть (Л'п.я^О) — это цепь Маркова (X, Я), и

предположим, что Т — это момент остановки. Тогда, при условии Т < оо

и Хт = i последовательность (Хт+„, п^О) образует (8,-, Р)-цепь

Маркова. В частности, при условии Т < оо и Хт = i случайные величины

Хт+\, Хг+2, ■. ■ не зависят от Xq, ..., Хт~ \.

3Игра слов, основанная на том, что слово property означает «свойство», а также

«собственность» или «имущество».

4Ср. с названием фильма «Eat Drink Man Woman».

§ 1.4. Строго марковское свойство

Доказательство. Пусть Л — это событие, которое определяется

состояниями цепи до момента времени Т, т.е. величинами Хо, ..., Хт-\,

а событие В определяется состояниями цепи после момента Т, т. е.

величинами Хт+\, ..., Хт+п при некотором п. Мы хотим проверить, что для

любых п ^ 1 и / 6 / выполнены следующие условия:

а) Р(Л П В | Т < оо, Хт = 0 = Р(Л | Г < оо, Jfr = i) P(S | Г < со, Хт = /)

и б) условная вероятность Р(В \ Т < оо, Хт = i) вычисляется так, как для

случая (8,-, Я)-цепи Маркова:

P(fl|7-<oo,^ = i)= J2 Pih---Pin-Un-

(j i„)€B

Как и при доказательстве марковского свойства, предположим вначале,

что Л имеет вид {Xq = /о, • • •. Хт-\ = ir-i}, а В имеет вид {XT+i = /i,

..., Хт+п = in} ДЛЯ некоторых /0, ..., im-\, j\, .... /я € /. При заданном m

событие

АГ\{Т = пг}Г\{Хт = 1}=АГ\{Т = m, Xm = i}

совпадает с событием

{Хо = /о, ..., Xm-\ = im-\, Xm = /},

если T(io,..., im-\, i) = m, а если 7"(/о, • • •, i-m-\. О 7^w, то это пересечение

пусто. Тогда вероятность события А П В П {Г = m, Xj = /} = Л П {Т = т,

^т = /} П 5 равна

4^01. • • • Plm-\iPi}\ ■ ■ ■ Pin-iin 1 (Д'О. • • • . im-\, 0 = т).

В случае общего события В мы должны просуммировать по всем (/ь ...

...,/„) G В:

KPkii ■ ■■Pim-liHT(h, ■■■, 'm-i. О = m) ^ р(7, ..-/?;„_,/„■

(/i,..,/»)Gfl

Сумма ^Z не зависит от т; она равна условной вероятности Р(В \ Т <

(/I,- :h)€B

< оо, Хт = /) и вычисляется, как для (8;, Р)-ц.м.д.в.

В случае события А общего вида мы суммируем по всем (г*о, ...

■ ■•, im-i)sA:

P{AnBn{T = m,XT = L}) =

= Yj KPhh • ■ ■ Pim-,iHT(h im-i,i) = m)P(B\T<oo,XT = i) =

('о im-i)€A

= Р(Л П {T = m, Хт = 1}) P(B\T< оо, Хт = i).

Глава 1. Цепи Маркова с дискретным временем

Суммируя затем по т, получаем

Р(Л П В П {Т < оо, Хт = /}) = Р(Л П {Т < оо, Хт = «'}) Р(В | Г < оо, Хт = /)•

Наконец, разделив на Р(7"<оо, Xr = i), находим, что условная вероятность

Р(Л П В | Т < оо, Хт = i) равна

Р(ЛП{7"<оо, XT = i}) D/DIT ^ v .ч

Р(Т<оо,Хт = 1) F(B\T<0o<Xr = i) =

= Р(А\Т<ос,Хт = i) Р(В\Т< оо, Хт = I),

что и требовалось показать.

Условную вероятность Р(Л П {Т = пг, Хт = i} П В |Ят = /) при условии,

что Xm=i, мы находим после деления на Р(Л"Ш = /) = (ХЯШ),-: это отношение

определяется значениями Xq, ..., Xm и условной вероятностью

Р((Л П {Г = т}) П {Хт+1 = /1 А-г+п = /„} | А-ш = /) =

= Р((Л П {Т = ш}) П {A-m+, =/,,..., А-т+п =/„} | Xm = i).

В силу марковского свойства имеет место разложение

Р((Л П {Т = т}) П {Хт+] = /,,..., A-m+n =/„} 1-Ут = 0 =

= Р(Л П {Т = т} |Xm = i) P(Xm+i =/,,..., A-m+n =/„ \Хт = i) =

= Р(Л П { Г = т} | Хя = /)р<7| ... ри_,/„.

Следовательно, безусловная вероятность

Р((Л П {Г = /п}) П {Хт+1 =/,,..., А-ш+п = /„} п {Хш = «'}) =

= Р((Л П{Т = т,Хт = i}) П {А-т+1 =/, Хт+п = /„})

равна

P(An{T = m}\Xm = i)P(Xm = i)pih ...pu_lU =

= P(An{T = m,Xm = i})Pih...pin_ljn.

Суммируя по т, находим

Р((Л П {Т < оо, Хт = /} П {Хт+i =/,, ..., А-г+л = /„}) =

= Р(ЛП{Г<оо,^7- = /})/7,7|...р/п_,Ул

§ 1.4. Строго марковское свойство

и, разделив на Р(7" < оо, Хт = 0. получаем

Р(Л П {XT+i = /1 Хт+п = /„} | Т < оо, Хт = I) =

= P(A\{T<oo,XT = i})pijl...pu_lh.

Теперь для события В общего вида, определяемого значениями Хт+\, ■..

..., Хт+п, мы суммируем по всем (J\, ..., /'„) € б. □

Пример 1.4.3. Для однородного процесса рождения и гибели (см.

пример 1.3.5) найдите распределение момента достижения /У(0) = inf{n >0:

Хп = 0} (момента исчезновения). Другими словами, чему равны вероятности

Р,(/У'0) = k) при заданных i и &? Эти вероятности могут быть найдены

путем вычисления вероятностной производящей функции cp,(s) = Е,(5Я ) =

= J2 sn Р,(//(0> = п). В силу строго марковского свойства

0^п<оо

<?i(s) = (<?(s)Y, i>\,

где cp(s) = ф1 (s). Достаточно рассмотреть случай t= 1. Тогда, при условии,

что Хо = 1, функция cp(s) является корнем квадратного уравнения

pscp2 - ф + qs = 0

и равна

ф(*) = 2^0 "V1"4^2)' 0<s<1-

2ps - ,. ™^. □

Пример 1.4.4. Важным приложением строго марковского свойства

является случай, когда цепь наблюдают только в определенные моменты

времени, например, в моменты, когда она меняет свои состояния (т. е. когда

Хп+\ фХп), или когда она попадаете подмножество/С/ (т.е. Хп е/). Новая

цепь формально описывается введением моментов наблюдений Го, Т\,

т.е. моментов

Т0 = Щп>0: ХпфХп-i} или Т0 = М{п ^ 0: Хп 6 J}

Тт+1=Щп>Тт:ХпфХп^1} или Тт+{ = Щп > Тт: Хп е J}.

Тогда цепь (Yn, п ^ 0) определяется равенством Ym =Xjm-

В обоих случаях каждый момент Тт является моментом остановки.

В предположении, что Тт < оо для всех т, строго марковское свойство

будет гарантировать, что (У„) действительно является ц.м.д.в. Переходные

вероятн

модели

вероятности р\- для новой цепи вычисляются довольно легко: в первой

ft/4J_pu' ".' '.' г'-/'е/- о-4-1)

Глава 1. Цепи Маркова с дискретным временем

а во второй

P!i=PH + Yl J2 PUf-PM при/,/6/.

*=i/i /*е/\/

Здесь Р = (р^-переходная матрица исходной цепи (Хп).

(1.4.2)

П

Р =

р"

pl\'.l

рн\1

pl\J.I\J

J l\J

Рис. 1.14

Первая модель, в которой Yn+\ ф Y„, называется цепью скачков для

исходной ц.м.д.в. {Хп)\ эта модель играет важную роль в анализе цепей

Маркова с непрерывным временем, см. гл. 2. Вторая модель, у

которой Y„ e J, называется частично наблюдаемой цепью. Для частично

наблюдаемой цепи Маркова переходные вероятности pls можно записать

в терминах матричных блоков PJJ, PJ,I\J, P'\J-J и P/V./V> выделенных из Р:

p!j = (/>%• + [PJAJ(h\j -p'^r'P'XJJlr '"■ /е'■ (J-4-3)

Здесь I/у обозначает единичную матрицу на /\/. См. рис. 1.14.

§ 1.5. Возвратность и невозвратность: определения

и основные факты

Вечное безмолвие этих бесконечных

пространств наводит на меня ужас.

Б. Паскаль (1623-1662),

французский математик и философ

Возвратность и невозвратность являются важными свойствами ц.м.д.в.

со счетными пространствами состояний. В нашей книге мы перейдем от

конечного случая к счетному, просто расширив основные определения на

случай счетного пространства состояний /. Конечно, это предполагает, что

задана бесконечная переходная матрица Р = (р,у, i, j g /); мы уже

встречались с такими матрицами в примере 1.2.7. Теория бесконечных матриц

§ 1.5. Возвратность и невозвратность: определения и основные факты

более тонка, чем теория конечных матриц; некоторые ее аспекты

предполагают умение работать с бесконечномерными пространствами. Мы не

будем слишком углубляться в эту теорию, остановимся лишь на свойствах,

которые являются прямым обобщением конечномерных случаев или имеют

четкий вероятностный смысл.

Определение 1.5.1. Состояние i e I называют возвратным, если

Р<(-^л = i Для бесконечно многих п) = 1, (1-5.1)

и невозвратным, если

Pi(Xn = i для бесконечно многих п) = О, (1.5.2)

т.е.

Pi(Xn = i для конечного числа значений п)=\.

Отметим, что мы не упомянули промежуточные значения вероятности (т. е.

лежащие строго между 0 и 1), что проясняет следующая ниже теорема

1.5.2. Положим

fi := Pi(Xn = i для некоторого п ^ 1). (1.5.3)

Теорема 1.5.2. Состояние i является возвратным, если /,■ = 1,

и невозвратным, если /,■ < 1. Следовательно, каждое состояние либо

возвратно, либо невозвратно.

Доказательство. Воспользуемся моментом первого достижения

состояния i (в зависимости от контекста мы будем называть его моментом

первого входа, или моментом возвращения в состояние I):

71 = inf[n > 1: Хп = i] (1.5.4)

и положим

fi = P,-(7i < oo). (1.5.5)

Тогда, очевидно, Т-, является моментом остановки. В силу строго

марковского свойства

Pi(Xn = / по крайней мере для двух значений п ^ 1) = /f,

и, в более общем виде,

Pi(X„ = i по крайней мере для k значений п ^ 1) = /f 4k. (1.5.6)

Обозначим через BJ, следующее событие: {Л„ = i по крайней мере для k

значений п ^ 1}. Тогда, очевидно, последовательность событий BJ, убывает

Глава 1. Цепи Маркова с дискретным временем

по k: В, Э В(2 Э ..., и событие {Хп = i для бесконечно многих значений

п} равно пересечению f] B^. Следовательно,

Pi(Xn = i для бесконечно многих п) = lim Р(б[ ), (1.5.7)

к—юо

что равно 1, когда /,■ = 1, и 0, когда /, < 1, что и требовалось доказать. □

Увы,

Ушло навек твое искусство,

И никогда его не возвратить!

Дж. Мильтон (1608—1674), английский поэт

Мы также введем еще одну случайную величину (которая будет

использоваться довольно часто)

Vj = число посещений состояния / = У^ \(Хп = /), (1.5.8)

л^О

которая подсчитывает общее число посещений состояния / (учитывая и

момент времени 0, если цепь стартовала из состояния /). Иначе говоря, V,

подсчитывает суммарное время, проведенное в состояние i (включая, когда

это необходимо, состояние 0). Уравнение (1.5.6) можно переписать в виде

/? = Р,М>А). (1.5.9)

Важным параметром является среднее значение Е,-V;, вычисляется по

формуле

со

Е/^ = £Р«-М>и) = Х> (1-5.10)

л=0 л^О

С другой стороны,

E,-V/ = 53E/l(Jr„ = 0 = E',«) (1-5J1)

(здесь ри = 1, поскольку нулевая степень матрицы Р° равна единичной

матрице I). Из (1.5.10), (1.5.11) заключаем, что верно следующее

утверждение.

Теорема 1.5.3. Состояние i возвратно, если

Х>1п) = оо, (1.5.12)

и невозвратно, если

X>Ln,<°°. (1.5.13)

л>0

§ 1.5. Возвратность и невозвратность: определения и основные факты

Доказательство. В силу соотношений (1.5.10), (1.5.11) сумма

23 p\i совпадает с суммой геометрической прогрессии ^ ff. Эта сумма

л^О л^О

конечна, если /,■ < 1 (и равна 1/(1 — /,)), и бесконечна, если Д = 1. П

Теорема 1.5.3 будет неоднократно использоваться для проверки

возвратности и невозвратности состояний различных цепей.

Альтернативное доказательство теоремы 1.5.3 опирается на

использование производящих функций случайной величины 7}. Положим

Л(") = Pi(7> = л) =

= Pi(Xn=i, hoXi ^/для /= 1 п-l), О 1; (1.5.14)

F(z)(=Fi(z)) = Ez*=Ylzn№. |z|<l, (1-5.15)

л^1

тогда /,- = lim F(z).

г—>1

С другой стороны,

/#> = Pi(^„ = О = fi{n) + Ш - \)pu + ... + fi(l)P\"-l)' (1-5-16)

откуда следует, что если

t/(z)(=£/i(z)) = 53p{|,)zn, |z|<l, (1.5.17)

л^1

TO

£/(z) = F(z) + F(z)U(z), т.е. £/(z) = F{z)

\-F{zY

Следовательно, предельное значение lim U(z) конечно тогда и только тогда,

когда WmF{z) < 1. Таким образом, неравенство (1.5.13) справедливо тогда

2->|

и только тогда, когда /; < 1. □

Завершим этот параграф следующим замечанием. Равенство (1.5.2)

можно переписать в виде

Pi(Vj < оо) = 1, (1.5.18)

а (1.5.13) можно записать как

Е,1/,<оо. (1.5.19)

Мы видим, что если св. V/ (общее число посещений состояния i) конечна

с вероятностью единица, то она должна иметь конечное среднее;

марковское (а точнее, строго марковское) свойство исключает возможность

промежуточной ситуации, когда Р,-(У| < оо) = 1, но Е,-V; = оо.

Глава 1. Цепи Маркова с дискретным временем

Однако если вернуться к рассмотрению св. Г; (время возвращения

в состояние /), то ситуация становится более тонкой. Как мы уже заметили

выше, состояние / возвратно тогда и только тогда, когда Р,(7",- < оо) = 1,

т. е. время возвращения в состояние i конечно с вероятностью единица.

Однако среднее время возвращения Е,Т,- (или, что эквивалентно, lim F'(z))

2—► !

может быть как конечным, так и бесконечным. Это свойство

подразделяет возвратные состояния на две различные категории: положительные

и нулевые; см. далее.

Сообщающиеся классы для счетной ц.м.д.в. определяют таким же

образом, как и в случае конечных цепей. Для удобства мы еще раз приведем

определение.

Определение 1.5.4. Состояния i, j G / принадлежат одному и тому же

сообщающемуся классу, если р\" > О и /?'" > 0 для некоторых п, п' ^ 0.

(Как и в случае конечных цепей, будем обозначать через Р° единичную

матрицу I со строками и столбцами, которые означают состояния цепи.)

Как и ранее, сообщающиеся классы задают разбиение пространства

состояний /, и некоторые классы могут быть бесконечными; число таких классов

также может быть бесконечным. Далее, как и в «конечном» случае,

сообщающийся класс С называется замкнутым, если для любого / G С, из

условия / —► / следует, что / g С. Наконец, мы будем говорить, что цепь

нвприводима, если она состоит из единственного сообщающегося класса

(который в случае счетной ц.м.д.в. может быть замкнут или незамкнут).

Замечание 1.5.5. Заметим, что если пространство состояний /

конечно, то определение невозвратного состояния совпадает с определением

несущественного состояния (т. е. состояния, принадлежащего

незамкнутому сообщающемуся классу). Иными словами, в случае конечной

цепи каждое состояние, которое формирует незамкнутый класс, является

невозвратным, и каждое состояние, принадлежащее замкнутому классу,

возвратно. Тем не менее, как мы отметили в замечании 1.2.6, в случае

счетной ц.м.д.в. замкнутый класс может состоять только из невозвратных

состояний, которые с «физической» точки зрения несущественны. Это

показывает, что в «счетном» случае понятие невозвратности более уместно,

чем понятие замкнутого сообщающегося класса.

Мы намерены показать теперь, что если состояния /, / принадлежат

одному и тому же сообщающемуся классу, то они либо оба возвратны,

либо оба невозвратны. Иначе говоря, возвратность и невозвратность

являются свойствами класса. Поэтому мы могли бы использовать следующее

определение.

Определение 1.5.6. Сообщающийся класс называется возвратным

(невозвратным), если все его состояния возвратны (невозвратны).

§ 1.5. Возвратность и невозвратность: определения и основные факты

Теорема 1.5.7. Состояния из одного сообщающегося класса

относятся к одному и тому же типу (либо оба возвратны, либо оба

невозвратны). Любой конечный замкнутый сообщающийся класс

является возвратным.

Доказательство. Пусть С — это сообщающийся класс. Тогда для

любых различных состояний /, / £ С выполняются неравенства /?)• > О

и Pjl > 0 для некоторых т, п ^ 1. Значит, для любого г ^ О выполняются

неравенства

(п+т+г) > (т) (г) (и) (п+т+г) > (т) (г) (я)

Рц ^ Рц Рц Pji и Pa ^ Pji Pa Рц >

поскольку в правой части каждого неравенства учитывается лишь часть

возможных способов возвращения.

Следовательно,

г/Л> < Ел

ИП ^ п(т)п(п) '

и для л ^ п + т справедливо неравенство

(г) > (п) (г-п-т) (т)

Pjj г Pji Рц Рц ■

Тогда оба ряда Y^Pu и Y,Pjj сходятся либо расходятся одновременно.

Пусть теперь С — конечный замкнутый сообщающийся класс, и / 6 С.

Тогда, если Лп =/' G С, то Хп € С \/п. Следовательно, существует состояние

/ 6 С, в котором цепь побывает бесконечно много раз:

О < Pj{Vi = оо) = Pj(Ti < oo) Pi(Vi = со).

Тогда P;(V, = оо) > 0, т.е. состояние i не является невозвратным, а

следовательно, оно возвратно. Таким образом, каждое состояние из класса С

возвратно. □

Определение 1.5.8. Матрица вероятностей перехода Р (а тогда и

(X, Р)-ц.м.д.в.) называется возвратной (невозвратной), если каждое

состояние i возвратно (соответственно невозвратно).

Завершим этот параграф еще одним утверждением.

Теорема 1.5.9. Если матрица Р неприводима и возвратна, то

каждая случайная величина Г,- (момент первого посещения

состояния /) конечна с вероятностью 1, т.е. Р(7', < оо) = 1 для любого

состояния i и любого начального распределения X.

Доказательство. В силу марковского свойства

Р(7) < оо) = ^Х, Pt(Tj < оо).

Глава I. Цепи Маркова с дискретным временем

При заданном i выберем такое т, что pjj" > 0. Запишем

1 = P/(V/ = оо) ^ Pj{X„ =j для некоторого п^ т)

(очевидно, что здесь на самом деде имеет место равенство, но нас

устраивает и неравенство). Далее,

Pj(Xn =j для некоторого п^ т) =